From Intents to Conversations: Generating Intent-Driven Dialogues with Contrastive Learning for Multi-Turn Classification

作者: Junhua Liu, Yong Keat Tan, Bin Fu, Kwan Hui Lim

分类: cs.CL, cs.AI

发布日期: 2024-11-21 (更新: 2025-09-01)

备注: Accepted to Proceedings of CIKM'25

🔗 代码/项目: GITHUB

💡 一句话要点

提出Chain-of-Intent框架,结合HMM和LLM生成意图驱动的对话,并用对比学习提升多轮意图分类。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 意图分类 对话生成 隐马尔可夫模型 大型语言模型 对比学习 多轮对话 电商领域

📋 核心要点

- 现有方法难以生成大规模、领域特定、多语种的对话数据集,限制了多轮意图分类模型的训练。

- Chain-of-Intent框架结合HMM和LLM,从真实电商数据中学习意图转移模式,生成高质量对话。

- MINT-CL多任务对比学习框架提升了多轮意图分类的性能,并降低了对大规模标注数据的依赖。

📝 摘要(中文)

本文提出了一种名为Chain-of-Intent的新框架,用于生成意图驱动的对话,以解决会话AI系统中训练有效多轮意图分类模型时,缺乏大规模、领域特定、多语种对话数据集的难题。该框架结合了隐马尔可夫模型(HMM)和大型语言模型(LLM),通过自博弈生成上下文相关的对话。首先,从真实电商聊天记录中提取领域特定的意图转移模式,用于建模turn级别的动态和意图序列。然后,利用LLM参数化HMM的发射概率,生成与预测意图和对话上下文对齐的自然、连贯的语句。此外,还提出了MINT-CL,一种用于多轮意图分类的多任务对比学习框架,可在提高性能的同时,减少对大规模标注数据集的依赖。实验结果表明,该方法在对话生成质量和分类精度方面均优于现有基线,尤其是在多语种环境中。为了促进未来的研究,我们发布了MINT-E,一个全面的、多语种的、意图感知的多轮对话语料库,来源于电商领域。

🔬 方法详解

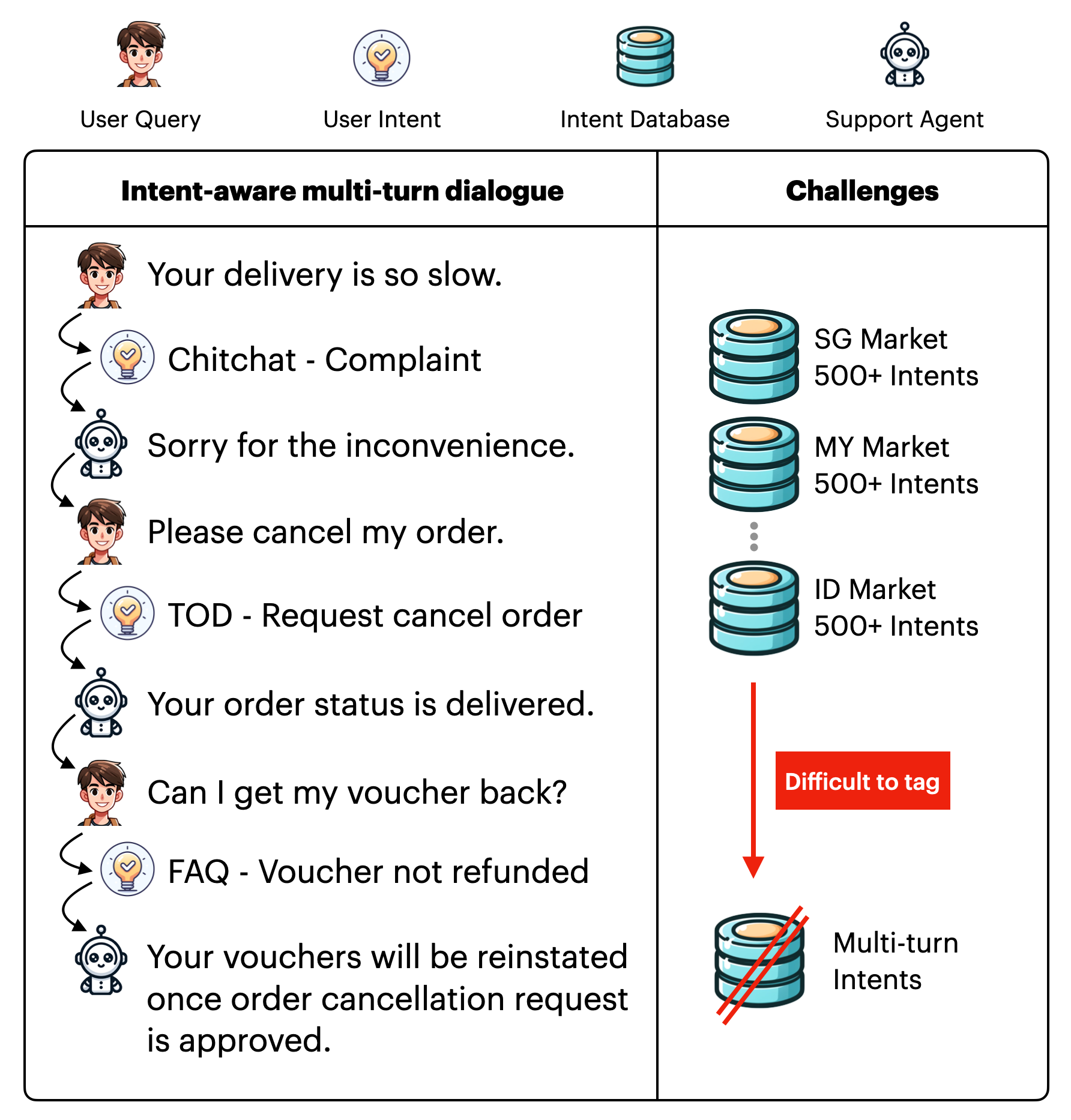

问题定义:多轮对话意图分类任务面临数据稀缺问题,尤其是在特定领域和多语种环境下,标注成本高昂。现有方法难以生成高质量的、意图明确的对话数据,导致模型泛化能力不足。

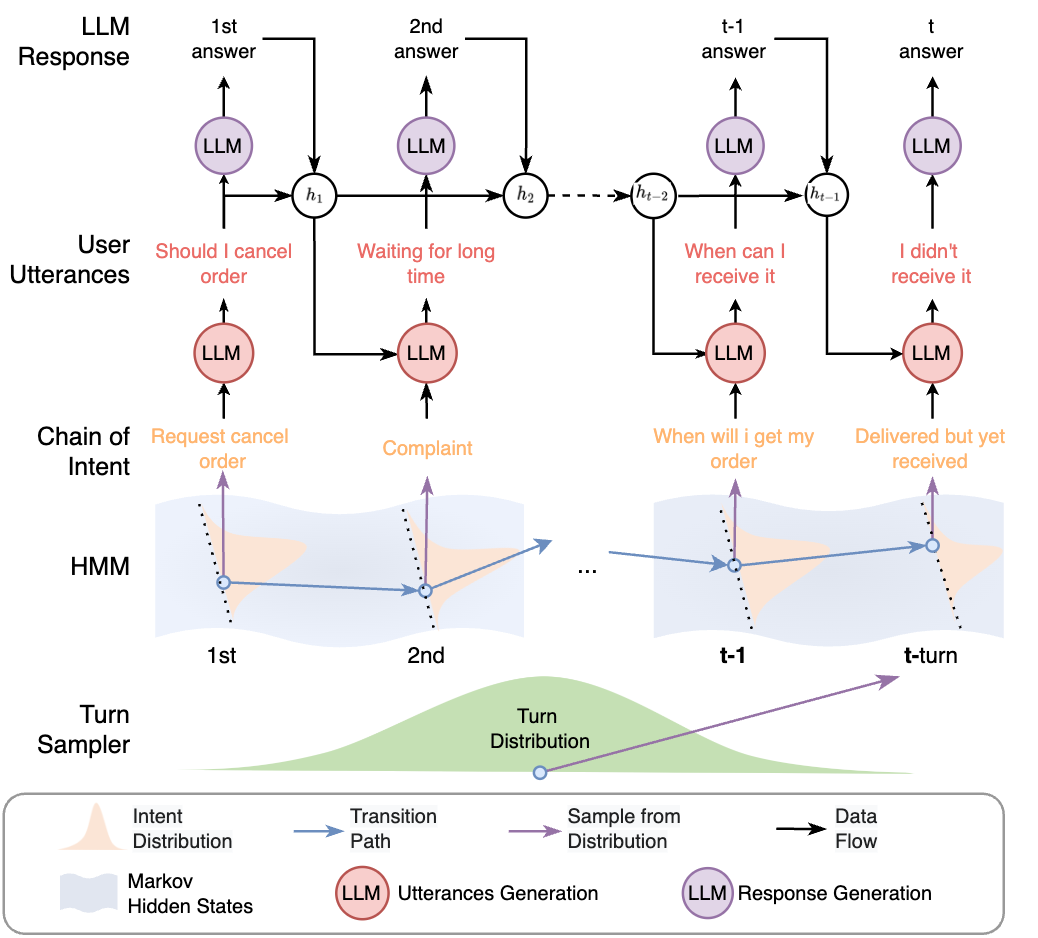

核心思路:利用隐马尔可夫模型(HMM)建模对话的意图转移过程,并使用大型语言模型(LLM)生成与意图相关的自然语言回复。通过从真实对话数据中学习意图转移模式,并结合LLM的生成能力,可以生成大量高质量的意图驱动对话数据,从而缓解数据稀缺问题。

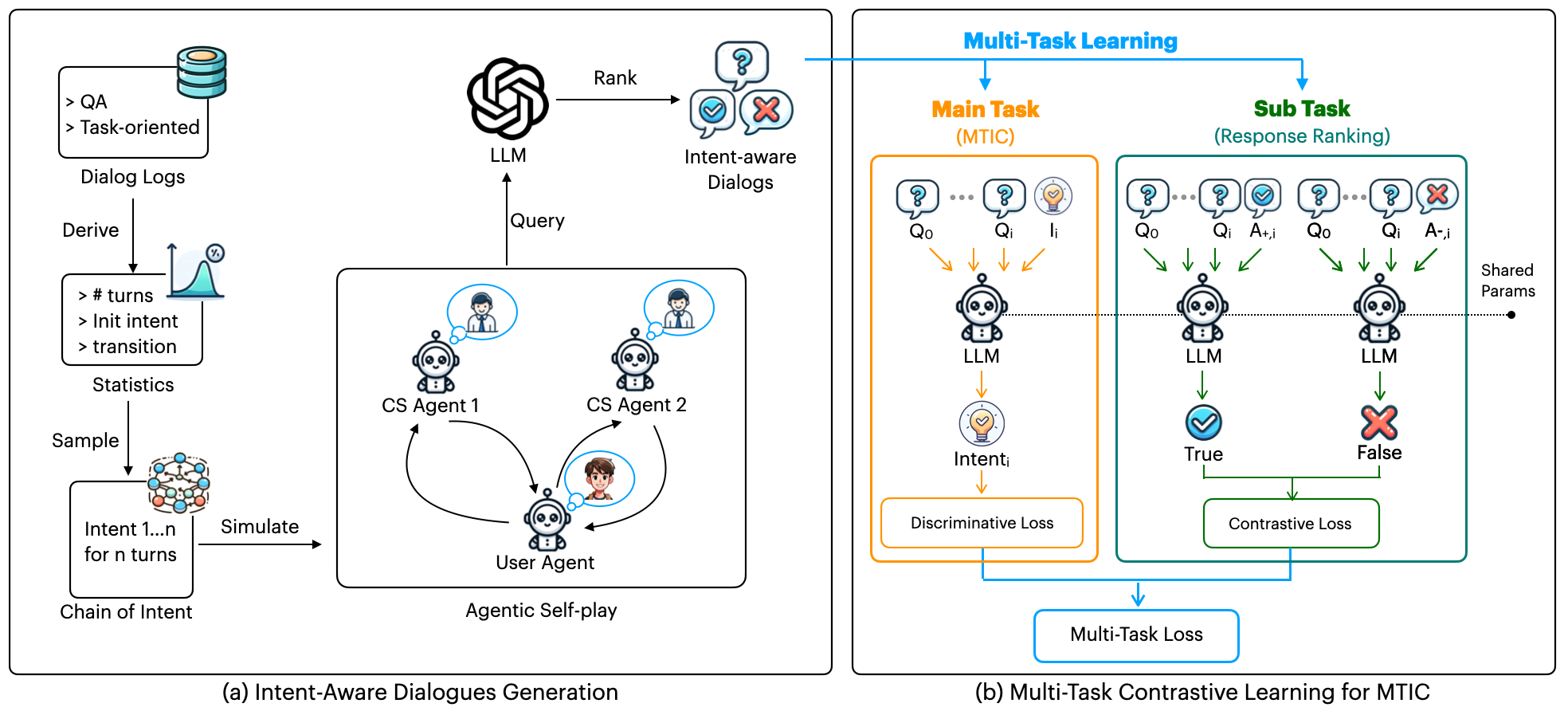

技术框架:Chain-of-Intent框架包含两个主要模块:意图转移建模和对话生成。首先,从真实电商对话数据中提取意图转移模式,构建HMM的状态转移矩阵。然后,使用LLM作为HMM的发射模型,根据当前状态(意图)和对话上下文生成相应的回复。此外,还提出了MINT-CL,一个多任务对比学习框架,用于训练多轮意图分类模型。

关键创新:该方法的核心创新在于将HMM和LLM相结合,利用HMM建模对话的意图转移过程,并利用LLM生成自然语言回复。这种方法可以有效地生成意图明确、上下文相关的对话数据,从而缓解数据稀缺问题。此外,MINT-CL多任务对比学习框架可以进一步提升多轮意图分类的性能。

关键设计:HMM的状态转移矩阵通过统计真实对话数据中的意图转移频率来估计。LLM使用预训练的语言模型进行微调,以生成与意图相关的回复。MINT-CL框架使用对比学习损失函数,鼓励模型学习区分不同意图的表示。具体参数设置和网络结构细节在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Chain-of-Intent框架在对话生成质量和分类精度方面均优于现有基线。MINT-CL多任务对比学习框架在多轮意图分类任务上取得了显著的性能提升,尤其是在多语种环境下。具体性能数据和提升幅度在论文中有详细描述(未知)。

🎯 应用场景

该研究成果可应用于各种会话AI系统,例如智能客服、聊天机器人等。通过生成大规模的意图驱动对话数据,可以提升多轮意图分类模型的性能,从而提高对话系统的智能化水平和服务质量。该方法尤其适用于数据稀缺的领域和多语种环境,具有重要的实际应用价值。

📄 摘要(原文)

In conversational AI systems, a critical challenge in training effective multi-turn intent classification models lies in the generation of large-scale, domain-specific, multilingual dialogue datasets. In this paper, we introduce Chain-of-Intent, a novel framework that integrates Hidden Markov Models (HMMs) with Large Language Models (LLMs) to generate intent-driven, context-aware dialogues through self-play. Our method first extracts domain-specific intent transition patterns from real-world e-commerce chat logs, which guide the modeling of turn-level dynamics and intent sequences. LLMs are then employed to parameterize the emission probabilities of HMMs, enabling the generation of natural, coherent utterances aligned with predicted intents and dialogue context. We also propose MINT-CL, a multi-task contrastive learning framework for multi-turn intent classification, which improves performance while reducing dependence on large-scale annotated datasets. Empirical results demonstrate that our approach outperforms competitive baselines in dialogue generation quality and classification accuracy, particularly in multilingual settings. To facilitate future research, we release MINT-E, a comprehensive, multilingual, intent-aware multi-turn dialogue corpus derived from the e-commerce domain\footnote{The reproduced source code and dataset are available at https://github.com/junhua/chain-of-intent.