Exploring Iterative Controllable Summarization with Large Language Models

作者: Sangwon Ryu, Heejin Do, Daehee Kim, Hwanjo Yu, Dongwoo Kim, Yunsu Kim, Gary Geunbae Lee, Jungseul Ok

分类: cs.CL, cs.AI

发布日期: 2024-11-19 (更新: 2026-01-07)

备注: EACL Findings 2026

💡 一句话要点

提出GTE框架,通过迭代自解释提升大语言模型在可控摘要生成中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可控摘要生成 大型语言模型 迭代优化 自我解释 属性控制

📋 核心要点

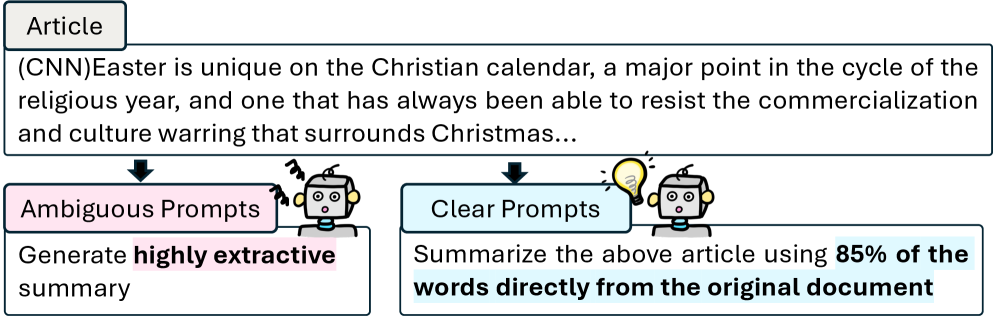

- 现有大语言模型在可控摘要生成中,难以精确控制摘要的数值属性(如长度),限制了其应用。

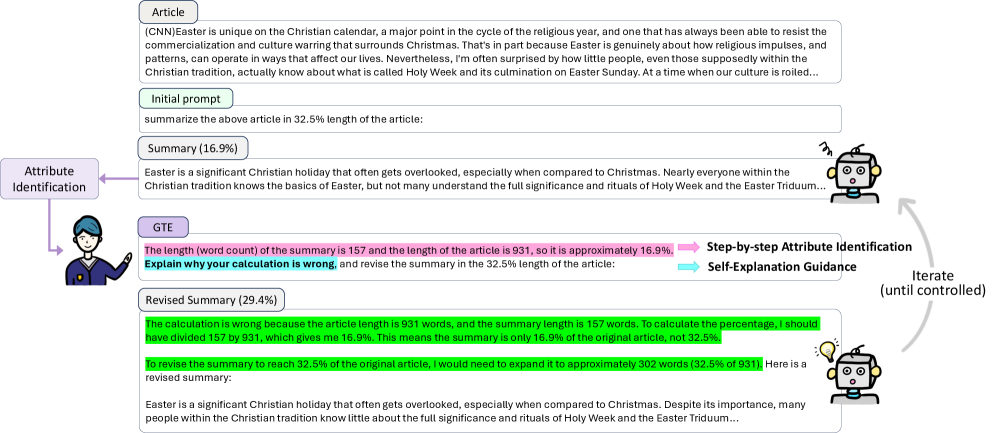

- 论文提出引导-解释框架(GTE),通过迭代让模型识别并解释摘要中的属性偏差,从而生成更符合要求的摘要。

- 实验表明,GTE框架能够以更少的迭代次数生成满足目标属性的摘要,显著提升了可控摘要生成的性能。

📝 摘要(中文)

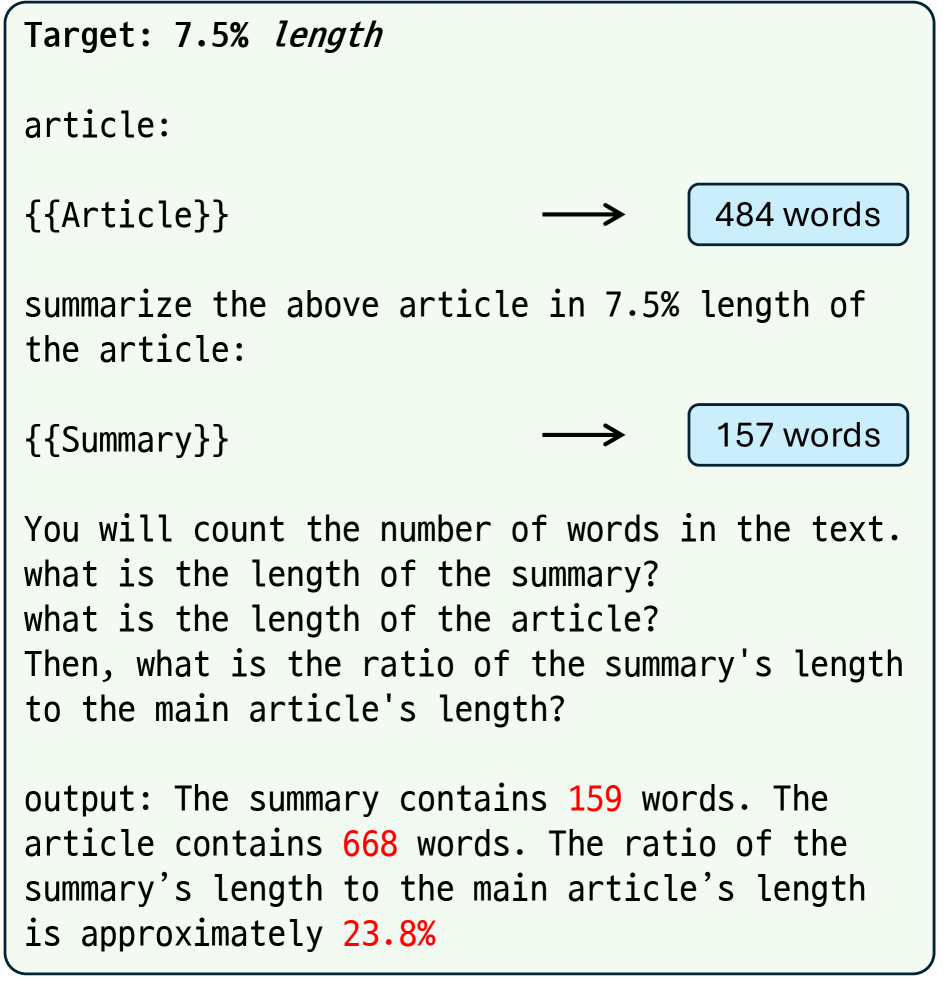

大型语言模型(LLMs)在抽象摘要任务中表现出了卓越的性能。然而,它们精确控制摘要属性(例如,长度或主题)的能力仍有待探索,这限制了它们对特定用户偏好的适应性。本文系统地探讨了LLMs的可控性。为此,我们重新审视了摘要属性的测量方法,并引入了迭代评估指标,即失败率和平均迭代次数,以精确评估LLMs的可控性,而不仅仅是评估误差。我们的研究结果表明,LLMs在处理数值属性方面比处理语言属性更困难。为了解决这个挑战,我们提出了一个用于可控摘要的引导-解释框架(GTE)。我们的GTE框架使模型能够识别初始草稿中未对齐的属性,并引导其自我解释先前输出中的错误。通过允许模型反思其未对齐之处,GTE生成了经过良好调整的摘要,以强大的有效性满足所需的属性,并且所需的迭代次数比其他迭代方法少得惊人。

🔬 方法详解

问题定义:现有的大语言模型在生成摘要时,虽然在抽象概括方面表现出色,但在精确控制摘要的特定属性(如长度、主题等)方面存在不足。尤其是在处理数值属性时,模型更容易出现偏差,难以满足用户对摘要属性的精细化需求。这限制了LLM在可控摘要生成任务中的应用。

核心思路:论文的核心思路是让模型具备“反思”和“自我纠正”的能力。通过迭代的方式,模型首先生成一个初始摘要,然后分析该摘要的属性是否符合要求,并解释其中的偏差原因。基于这些解释,模型对摘要进行调整,最终生成满足目标属性的摘要。这种迭代式的“引导-解释”过程,能够有效地提升模型的可控性。

技术框架:GTE框架主要包含以下几个阶段:1) 初始摘要生成:使用LLM生成初始摘要;2) 属性偏差识别:模型分析初始摘要的属性,并与目标属性进行比较,识别出偏差;3) 偏差原因解释:模型解释导致属性偏差的原因;4) 摘要调整:基于偏差识别和原因解释,模型对初始摘要进行调整,生成新的摘要;5) 迭代优化:重复步骤2-4,直到摘要的属性满足目标要求。

关键创新:GTE框架的关键创新在于引入了“自我解释”机制。通过让模型解释摘要属性偏差的原因,可以帮助模型更好地理解属性之间的关系,从而更有效地进行摘要调整。此外,GTE框架采用迭代的方式,逐步优化摘要的属性,避免了一次性生成可能导致的偏差。

关键设计:GTE框架的关键设计包括:1) 属性偏差识别模块:可以使用预训练的属性分类器或回归器来识别摘要的属性偏差;2) 偏差原因解释模块:可以使用LLM生成自然语言解释,说明导致属性偏差的原因;3) 摘要调整模块:可以使用LLM基于偏差识别和原因解释,对摘要进行调整。具体的参数设置、损失函数和网络结构等细节,论文中可能未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文提出了失败率和平均迭代次数作为评估可控性的指标,发现LLM在数值属性控制上表现较差。GTE框架通过迭代自解释,显著降低了生成符合目标属性摘要所需的迭代次数,验证了其有效性。具体的性能提升数据和对比基线在摘要中未提及,属于未知信息。

🎯 应用场景

该研究成果可应用于多种需要精确控制摘要属性的场景,例如:新闻摘要生成(控制摘要长度以适应不同平台)、科研论文摘要生成(突出特定研究方向)、合同条款摘要生成(强调关键法律条款)等。通过提升摘要的可控性,可以更好地满足用户的个性化需求,提高信息获取效率。

📄 摘要(原文)

Large language models (LLMs) have demonstrated remarkable performance in abstractive summarization tasks. However, their ability to precisely control summary attributes (e.g., length or topic) remains underexplored, limiting their adaptability to specific user preferences. In this paper, we systematically explore the controllability of LLMs. To this end, we revisit summary attribute measurements and introduce iterative evaluation metrics, failure rate and average iteration count to precisely evaluate controllability of LLMs, rather than merely assessing errors. Our findings show that LLMs struggle more with numerical attributes than with linguistic attributes. To address this challenge, we propose a guide-to-explain framework (GTE) for controllable summarization. Our GTE framework enables the model to identify misaligned attributes in the initial draft and guides it in self-explaining errors in the previous output. By allowing the model to reflect on its misalignment, GTE generates well-adjusted summaries that satisfy the desired attributes with robust effectiveness, requiring surprisingly fewer iterations than other iterative approaches.