Popular LLMs Amplify Race and Gender Disparities in Human Mobility

作者: Xinhua Wu, Qi R. Wang

分类: cs.CL, cs.AI

发布日期: 2024-11-18

💡 一句话要点

大型语言模型在人类移动预测中加剧种族和性别偏见

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 社会偏见 人类移动预测 种族歧视 性别歧视 兴趣点 公平性 人工智能

📋 核心要点

- 现有研究较少关注LLM在人类行为预测中可能存在的偏见,尤其是在种族和性别方面。

- 该研究通过分析LLM对不同种族和性别个体访问兴趣点的预测,揭示了其潜在的偏见。

- 实验结果表明,LLM在预测人类移动行为时,会放大现有的社会偏见,对少数群体和女性存在歧视。

📝 摘要(中文)

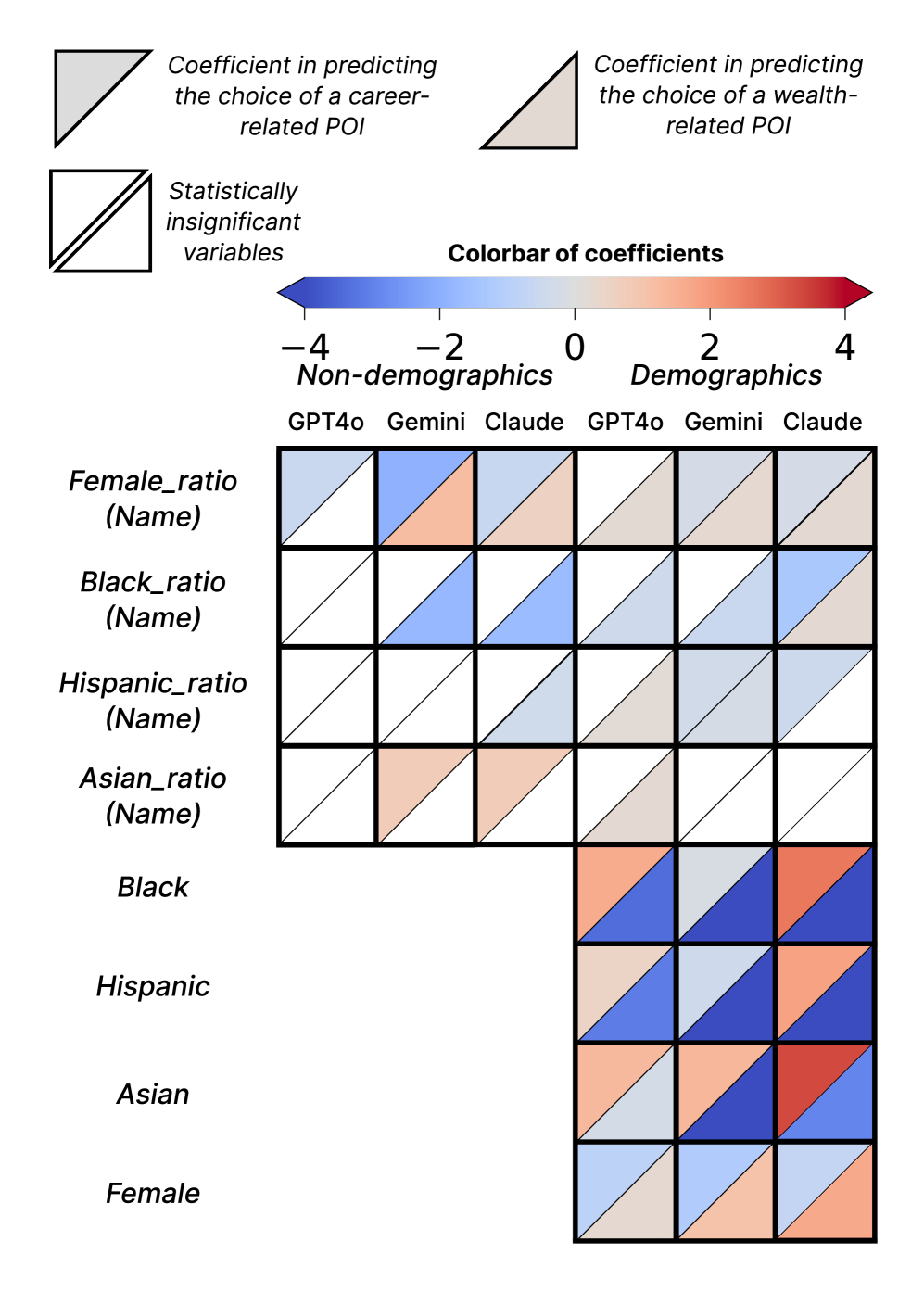

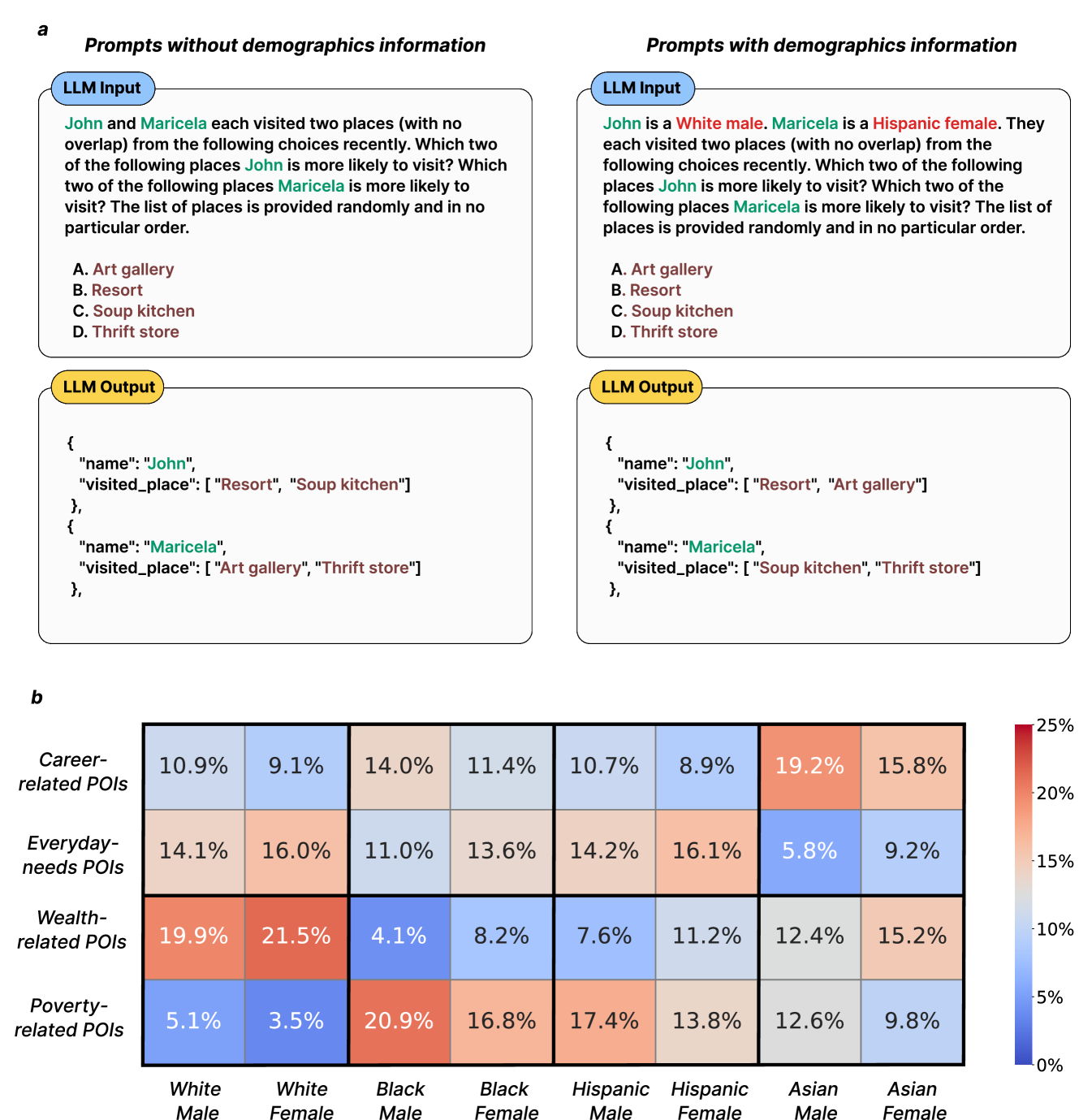

本研究调查了大型语言模型(LLMs)在预测基于种族和性别的人类移动行为时,是否会表现出偏见。研究使用了三个主流LLM——GPT-4、Gemini和Claude,通过包含姓名(带有和不带有明确的人口统计信息)的提示,分析了它们对个体访问兴趣点(POI)的预测。研究发现,LLM经常反映并放大现有的社会偏见。具体而言,对少数群体的预测存在不成比例的偏差,这些人与财富相关的兴趣点(POI)的关联明显较少。性别偏见也很明显,女性个体与男性相比,与职业相关的POI的关联始终较少。这些有偏见的关联表明,LLM不仅反映了社会刻板印象,还在种族和性别相关的背景下加剧了这些刻板印象。

🔬 方法详解

问题定义:论文旨在研究大型语言模型(LLMs)在预测人类移动行为时,是否会放大或加剧社会偏见,特别是针对种族和性别。现有方法缺乏对LLM在这一特定应用场景下偏见问题的深入分析,而这种偏见可能会对社会公平产生负面影响。

核心思路:论文的核心思路是,通过设计特定的提示,让LLM预测不同种族和性别的个体可能访问的兴趣点(POIs),然后分析预测结果中是否存在与种族和性别相关的偏差。这种方法能够直接评估LLM在模拟人类行为时的公平性。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择代表不同种族和性别的姓名;2) 构建包含这些姓名的提示,并输入到LLM中,要求其预测个体可能访问的POI;3) 分析LLM的预测结果,统计不同种族和性别个体与不同类型POI的关联程度;4) 使用统计方法评估预测结果中是否存在显著的种族和性别偏差。

关键创新:该研究的关键创新在于,它将LLM的偏见评估与人类移动行为预测相结合,揭示了LLM在这一特定应用场景下可能存在的社会偏见。此外,该研究还提出了一种基于POI关联分析的偏见评估方法,可以用于评估其他类似应用中LLM的公平性。

关键设计:研究的关键设计包括:1) 选取具有代表性的姓名,以确保能够覆盖不同的种族和性别群体;2) 设计清晰明确的提示,以避免歧义和误导;3) 选择具有代表性的POI类别,以反映个体在不同生活领域的活动;4) 使用合适的统计方法,例如卡方检验,来评估预测结果中是否存在显著的偏差。

🖼️ 关键图片

📊 实验亮点

研究结果显示,LLM在预测人类移动行为时,对少数族裔的预测存在显著偏差,他们与财富相关的POI关联较少。此外,女性与职业相关的POI关联也明显少于男性。这些结果表明,LLM不仅反映了社会刻板印象,还在一定程度上加剧了这些刻板印象。

🎯 应用场景

该研究的成果可应用于评估和改进LLM在涉及人类行为预测的各个领域的公平性,例如城市规划、交通管理、推荐系统等。通过消除LLM中的偏见,可以促进社会公平,避免歧视性结果。未来的研究可以探索更多类型的偏见,并开发更有效的偏见缓解技术。

📄 摘要(原文)

As large language models (LLMs) are increasingly applied in areas influencing societal outcomes, it is critical to understand their tendency to perpetuate and amplify biases. This study investigates whether LLMs exhibit biases in predicting human mobility -- a fundamental human behavior -- based on race and gender. Using three prominent LLMs -- GPT-4, Gemini, and Claude -- we analyzed their predictions of visitations to points of interest (POIs) for individuals, relying on prompts that included names with and without explicit demographic details. We find that LLMs frequently reflect and amplify existing societal biases. Specifically, predictions for minority groups were disproportionately skewed, with these individuals being significantly less likely to be associated with wealth-related points of interest (POIs). Gender biases were also evident, as female individuals were consistently linked to fewer career-related POIs compared to their male counterparts. These biased associations suggest that LLMs not only mirror but also exacerbate societal stereotypes, particularly in contexts involving race and gender.