SRA-MCTS: Self-driven Reasoning Augmentation with Monte Carlo Tree Search for Code Generation

作者: Bin Xu, Yiguan Lin, Yinghao Li, Yang Gao

分类: cs.CL, cs.AI

发布日期: 2024-11-17 (更新: 2025-05-09)

备注: Accepted by IJCAI2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出SRA-MCTS,通过自驱动推理增强和蒙特卡洛树搜索提升代码生成能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 大型语言模型 推理增强 蒙特卡洛树搜索 自驱动学习

📋 核心要点

- 现有大型语言模型在复杂代码生成任务中面临推理和问题分解能力不足的挑战。

- SRA-MCTS通过引导模型自主生成高质量推理路径,形成正反馈,提升代码生成能力。

- 实验表明,SRA-MCTS无需额外监督即可提升不同规模模型的性能,并在CoT失效时保持稳健。

📝 摘要(中文)

大型语言模型在简单的代码生成任务中表现出色,但在处理复杂问题时仍面临挑战,这可能源于推理和问题分解能力的不足。为了解决这个问题,我们提出了一种推理增强的数据生成过程SRA-MCTS,引导模型自主生成高质量的中间推理路径,从而形成一个正反馈循环,实现持续改进。我们的方法完全通过模型自身实现,无需额外的监督。通过综合自然语言推理路径并将其转换为可执行代码,该方法确保了分析的准确性,并提高了解决复杂任务的成功率。实验结果表明,即使没有额外的监督信号,我们的方法也能在不同的模型规模上实现性能提升,证明了小型模型自我改进的巨大潜力。此外,该方法在传统的思维链(CoT)方法表现下降时仍然保持稳健,并且在pass@10等多样性指标上观察到显著改进。我们鼓励进一步探索训练数据中的推理过程,以增强语言模型解决复杂问题的能力。我们的代码和数据已公开。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在复杂代码生成任务中推理能力不足的问题。现有方法,如直接生成代码或使用简单的思维链(Chain-of-Thought, CoT),在面对复杂问题时,难以进行有效的分解和推理,导致代码生成成功率较低。

核心思路:论文的核心思路是利用模型自身的能力,通过自驱动的方式生成高质量的推理路径,并将其融入到训练数据中,从而增强模型的推理能力。这种自驱动的推理增强方法避免了对额外监督信号的依赖,并能够形成一个正反馈循环,使模型不断改进。

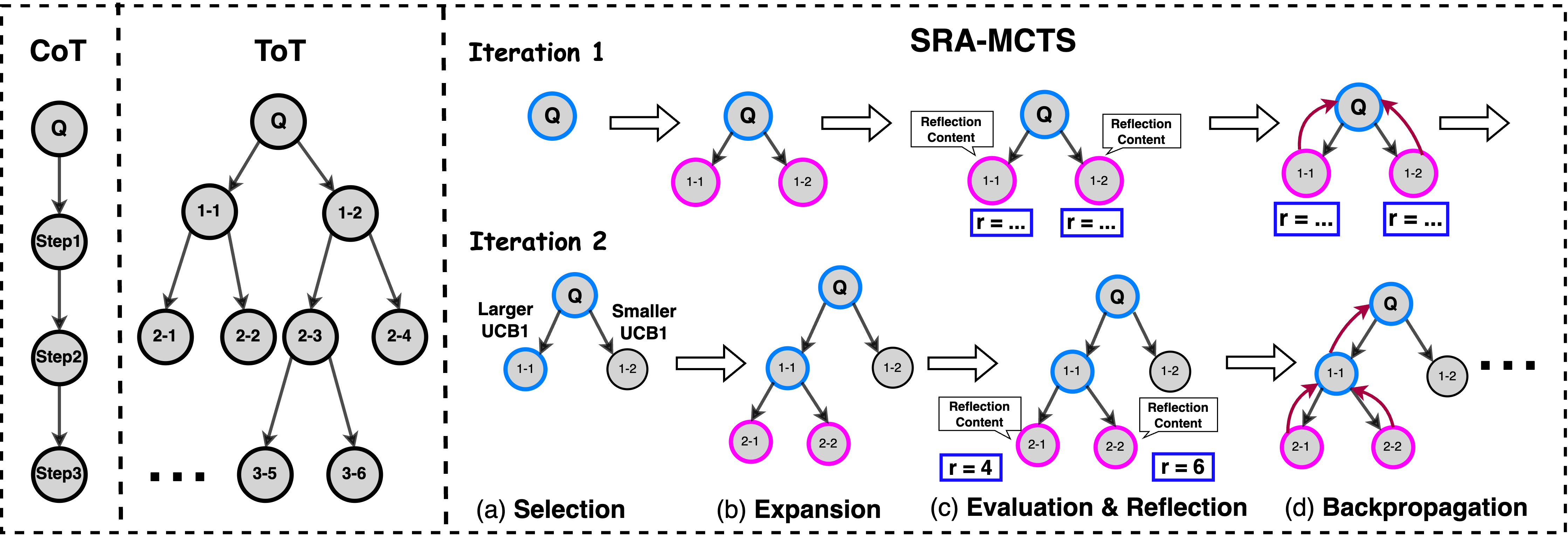

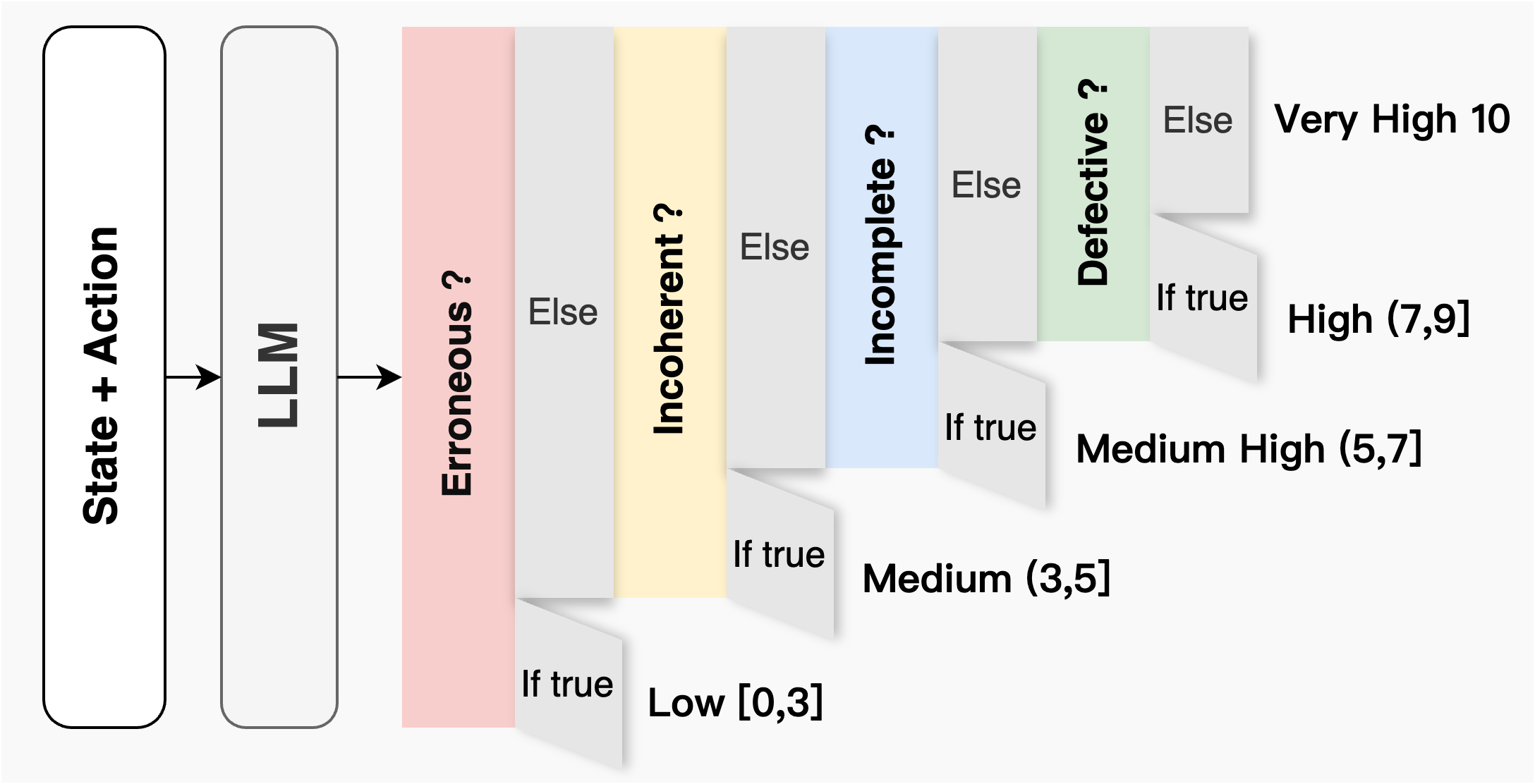

技术框架:SRA-MCTS包含以下主要阶段:1) 问题输入:将复杂的代码生成问题输入模型。2) 蒙特卡洛树搜索(MCTS):利用MCTS探索可能的推理路径,每个节点代表一个中间推理步骤。3) 推理路径生成:基于MCTS的搜索结果,生成自然语言形式的推理路径。4) 代码生成:将推理路径翻译成可执行的代码。5) 奖励评估:执行生成的代码,并根据执行结果给予奖励或惩罚,用于更新MCTS的搜索策略。6) 数据增强:将生成的推理路径和对应的代码添加到训练数据中,用于后续的模型训练。

关键创新:SRA-MCTS的关键创新在于其自驱动的推理增强机制。与传统的CoT方法相比,SRA-MCTS不需要人工设计的推理步骤,而是通过MCTS自主探索和生成推理路径。这种方法能够更好地适应不同问题的特点,并生成更有效的推理路径。此外,SRA-MCTS通过正反馈循环,不断改进模型的推理能力,使其能够更好地解决复杂问题。

关键设计:MCTS的搜索策略是SRA-MCTS的关键设计之一。论文可能采用了UCT(Upper Confidence Bound applied to Trees)等算法来平衡探索和利用,以找到最优的推理路径。奖励函数的设置也至关重要,它直接影响MCTS的搜索方向。此外,推理路径到代码的翻译过程可能涉及到一些模板或规则,以确保生成的代码的正确性和可执行性。具体的参数设置、损失函数和网络结构等技术细节需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SRA-MCTS在不同模型规模上均取得了性能提升,即使没有额外的监督信号。在传统的CoT方法表现下降时,SRA-MCTS仍然保持稳健,并在多样性指标pass@10上观察到显著改进。这些结果表明,SRA-MCTS具有很强的泛化能力和鲁棒性,能够有效地提升代码生成模型的性能。

🎯 应用场景

SRA-MCTS具有广泛的应用前景,可用于提升各种代码生成任务的性能,尤其是在需要复杂推理和问题分解的场景下。例如,可以应用于软件开发、自动化测试、数据分析等领域,帮助开发者更高效地生成高质量的代码。该方法还可以扩展到其他需要推理能力的自然语言处理任务中,例如问答系统、对话生成等。

📄 摘要(原文)

Large language models demonstrate exceptional performance in simple code generation tasks but still face challenges in tackling complex problems. These challenges may stem from insufficient reasoning and problem decomposition capabilities. To address this issue, we propose a reasoning-augmented data generation process, SRA-MCTS, which guides the model to autonomously generate high-quality intermediate reasoning paths. This creates a positive feedback loop, enabling continuous improvement. Our method operates entirely through the model itself without requiring additional supervision. By synthesizing natural language reasoning paths and translating them into executable code, the approach ensures analytical accuracy and enhances the success rate in solving complex tasks. Experimental results show that, even without additional supervisory signals, our method achieves performance improvements across different model scales, demonstrating the significant potential of self-improvement in small models. Furthermore, the method remains robust when traditional Chain-of-Thought (CoT) approaches exhibit performance degradation, with notable improvements observed in diversity metrics such as pass@10. We encourage further exploration of reasoning processes within training data to enhance the ability of language models to address complex problems. Our code and data are public at https://github.com/DIRECT-BIT/SRA-MCTS.