Learn from Downstream and Be Yourself in Multimodal Large Language Model Fine-Tuning

作者: Wenke Huang, Jian Liang, Zekun Shi, Didi Zhu, Guancheng Wan, He Li, Bo Du, Dacheng Tao, Mang Ye

分类: cs.CL, cs.AI

发布日期: 2024-11-17

💡 一句话要点

提出重要性感知权重分配策略,缓解多模态大语言模型微调中的泛化能力退化问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 微调 泛化能力 参数重要性 权重分配

📋 核心要点

- 多模态大语言模型微调时易遗忘预训练知识,导致泛化能力下降,这是核心问题。

- 论文提出重要性感知权重分配策略,选择性更新重要参数,平衡泛化和特定化。

- 实验表明,该方法在图像字幕和视觉问答任务中有效提升下游任务性能,并缓解泛化能力退化。

📝 摘要(中文)

多模态大语言模型(MLLM)由于其广泛的预训练数据集,在不同的分布和任务中表现出强大的泛化能力。微调MLLM已成为提高特定下游任务性能的常见做法。然而,在微调过程中,MLLM常常面临遗忘预训练阶段所学知识的风险,这可能导致泛化能力的下降。为了平衡泛化和特定化之间的权衡,我们提出了一种基于冻结的预训练权重幅度和累积的微调梯度值来衡量预训练和微调分布的参数重要性的方法。我们进一步应用了一种重要性感知权重分配策略,选择性地更新对下游任务相对重要的参数。我们使用各种MLLM架构在图像字幕和视觉问答任务上进行了实证评估。全面的实验分析证明了所提出解决方案的有效性,突出了关键模块在增强下游特定化性能,同时减轻MLLM微调中泛化退化的效率。

🔬 方法详解

问题定义:多模态大语言模型(MLLM)在微调过程中容易遗忘预训练阶段学习到的知识,导致泛化能力下降。现有的微调方法难以在提升下游任务性能的同时,保持模型原有的泛化能力,需要在特定化和泛化之间做出权衡。

核心思路:论文的核心思路是根据参数的重要性来决定是否更新该参数。对于预训练阶段重要的参数,尽量保持不变,以保留模型的泛化能力;对于下游任务重要的参数,则进行更新,以提升模型在特定任务上的性能。通过这种重要性感知的权重分配策略,可以更好地平衡泛化和特定化。

技术框架:该方法主要包含两个阶段:1) 参数重要性评估:基于冻结的预训练权重幅度和累积的微调梯度值来衡量参数的重要性。预训练权重幅度越大,表明该参数在预训练阶段越重要;累积的微调梯度值越大,表明该参数在下游任务中越重要。2) 重要性感知权重分配:根据参数的重要性,决定是否更新该参数。具体来说,可以设置一个阈值,只有当参数的重要性超过该阈值时,才进行更新。

关键创新:该方法最重要的技术创新点在于提出了基于预训练权重幅度和微调梯度值来衡量参数重要性的方法。这种方法能够有效地识别出对于预训练和下游任务都重要的参数,从而实现更精细的权重分配。与现有方法相比,该方法能够更好地平衡泛化和特定化,避免了过度拟合下游任务而导致的泛化能力下降。

关键设计:论文中,参数重要性的计算公式可能需要仔细设计,例如如何平衡预训练权重幅度和微调梯度值的影响。此外,阈值的设置也会影响最终的性能,需要根据具体的任务和数据集进行调整。损失函数方面,可以使用交叉熵损失函数或者其他适合特定任务的损失函数。网络结构方面,可以使用各种现有的MLLM架构,例如BLIP、Flamingo等。

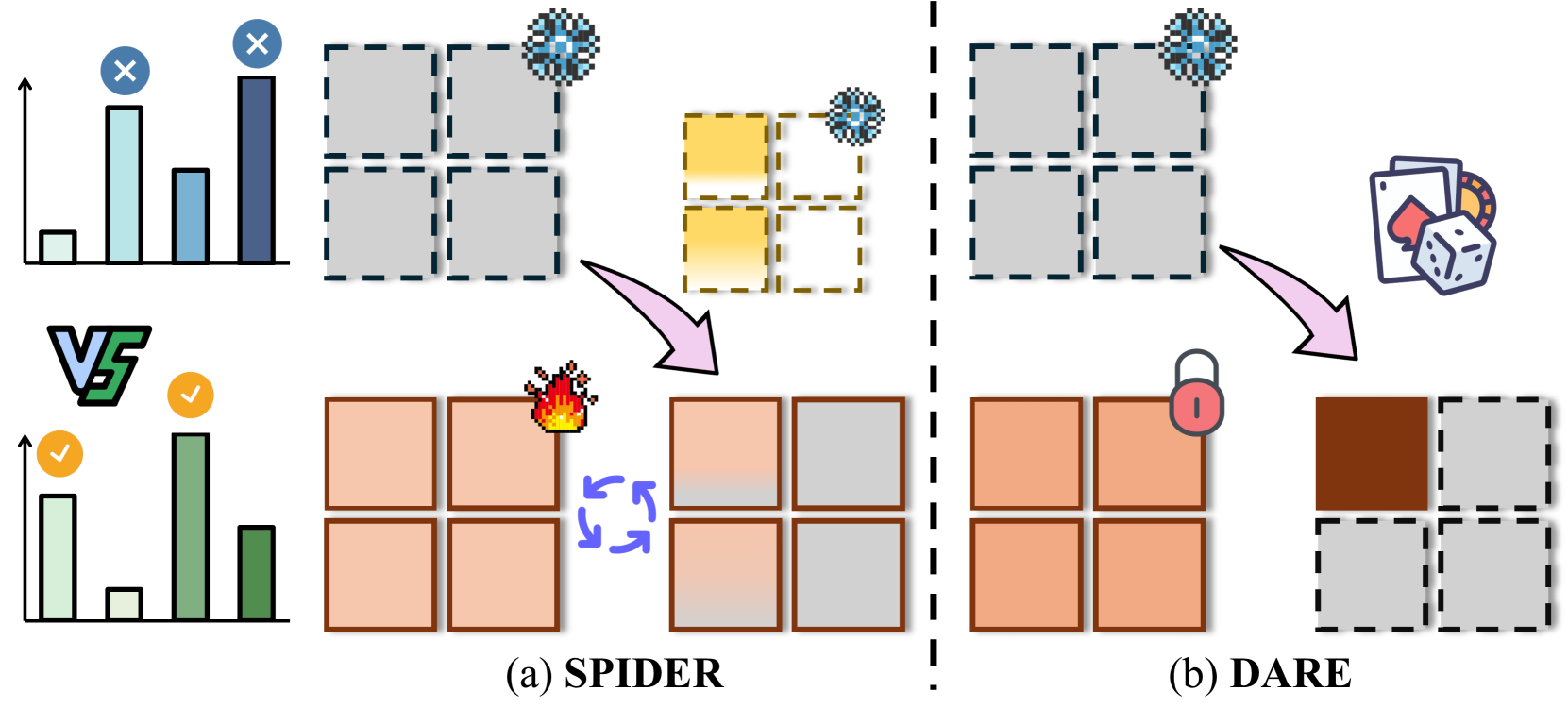

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在图像字幕和视觉问答任务上均取得了显著的性能提升。与传统的微调方法相比,该方法能够在提升下游任务性能的同时,有效地缓解泛化能力退化的问题。具体的性能数据和提升幅度需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于各种需要微调多模态大语言模型的场景,例如图像/视频理解、视觉问答、多模态对话等。通过该方法,可以提升模型在特定任务上的性能,同时保持其良好的泛化能力,从而更好地服务于实际应用。

📄 摘要(原文)

Multimodal Large Language Model (MLLM) have demonstrated strong generalization capabilities across diverse distributions and tasks, largely due to extensive pre-training datasets. Fine-tuning MLLM has become a common practice to improve performance on specific downstream tasks. However, during fine-tuning, MLLM often faces the risk of forgetting knowledge acquired during pre-training, which can result in a decline in generalization abilities. To balance the trade-off between generalization and specialization, we propose measuring the parameter importance for both pre-trained and fine-tuning distributions, based on frozen pre-trained weight magnitude and accumulated fine-tuning gradient values. We further apply an importance-aware weight allocation strategy, selectively updating relatively important parameters for downstream tasks. We conduct empirical evaluations on both image captioning and visual question-answering tasks using various MLLM architectures. The comprehensive experimental analysis demonstrates the effectiveness of the proposed solution, highlighting the efficiency of the crucial modules in enhancing downstream specialization performance while mitigating generalization degradation in MLLM Fine-Tuning.