Task-Aligned Tool Recommendation for Large Language Models

作者: Hang Gao, Yongfeng Zhang

分类: cs.CL, cs.AI

发布日期: 2024-11-14 (更新: 2025-11-21)

备注: IJCNLP-AACL 2025 Main

💡 一句话要点

提出PTR方法,为大语言模型精准推荐任务对齐的工具集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 工具推荐 任务对齐 工具集 精度驱动

📋 核心要点

- 现有工具推荐方法无法根据任务自适应地选择工具数量,导致工具冗余或不适用,阻碍了LLM快速访问最相关工具。

- PTR方法通过历史工具使用信息初始化工具集,并动态调整,最终通过多视角工具添加来优化工具集。

- 论文提出了RecTools数据集和TRACC指标,并通过实验验证了PTR方法在多个数据集上的有效性。

📝 摘要(中文)

本文研究了如何为大语言模型(LLMs)推荐精准的工具集,以增强其解决复杂问题的能力。尽管LLMs的解析能力不断提升,但由于外部工具数量庞大,同时在提示中包含所有工具是不切实际的。现有工具检索方法侧重于优化工具排序列表,并直接将排名靠前的固定数量的工具打包成工具集,但未能为LLMs提供最佳工具集。为此,本文提出了一个Precision-driven Tool Recommendation (PTR) 方法,该方法利用历史工具包使用情况获取初始工具集,并通过工具匹配动态调整工具集,最终实现基于多视角的工具添加。此外,本文还提出了一个新的数据集RecTools和一个新的指标TRACC,用于评估LLMs工具推荐的有效性。实验结果表明,PTR方法在两个开放基准测试和RecTools数据集上都表现出良好的准确性。

🔬 方法详解

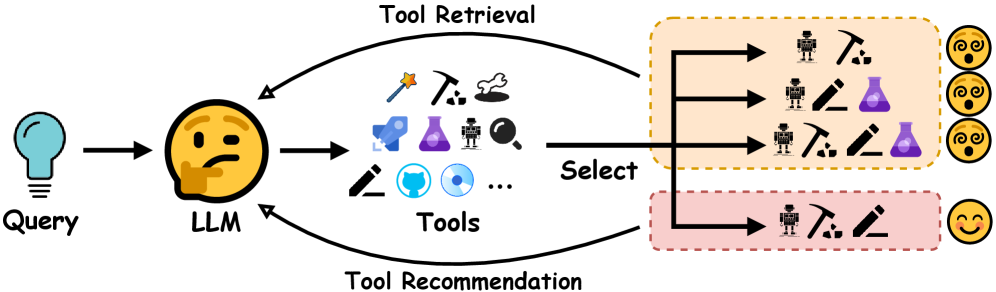

问题定义:论文旨在解决大语言模型(LLMs)工具推荐问题,即如何为特定任务选择最合适的工具集。现有方法主要集中在工具排序,并选取固定数量的Top-K工具,忽略了不同任务对工具数量的需求差异,导致工具冗余或缺失,影响LLMs的性能。

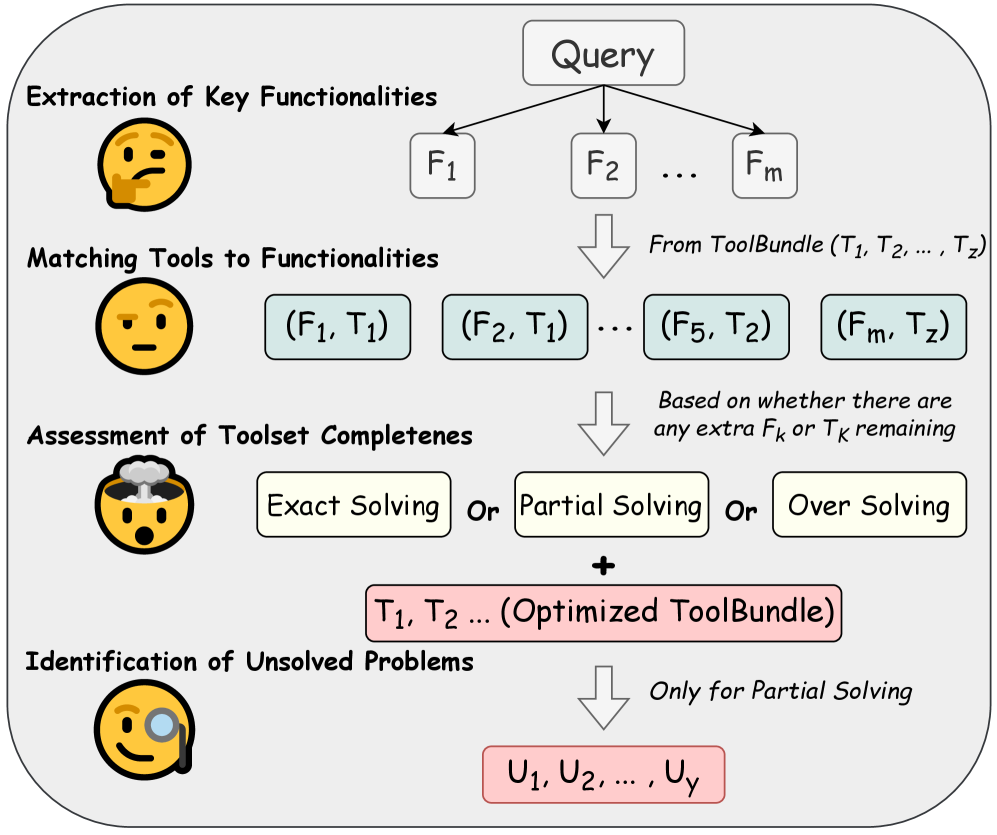

核心思路:论文的核心思路是提出一种精度驱动的工具推荐(PTR)方法,该方法能够根据任务需求动态调整工具集的大小和内容,从而为LLMs提供更精准的工具支持。PTR方法的核心在于利用历史工具使用信息,并结合多视角工具匹配,实现工具集的自适应构建。

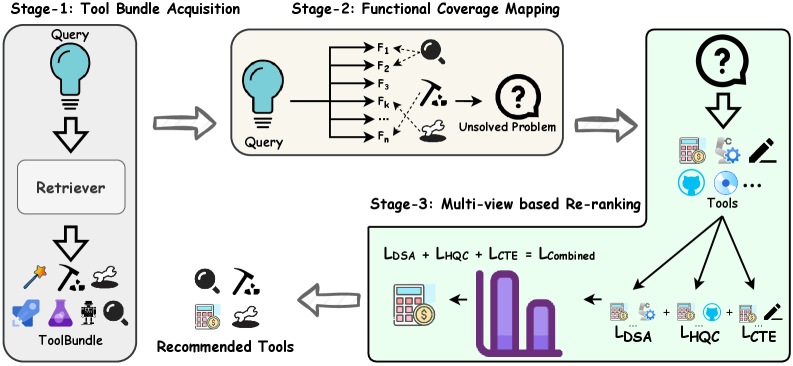

技术框架:PTR方法主要包含以下几个阶段:1) 初始工具集构建:利用历史工具包的使用情况,构建一个初始的、简洁的工具集。2) 工具匹配:根据当前任务的需求,对初始工具集进行匹配,筛选出与任务相关的工具。3) 多视角工具添加:从多个角度(例如,语义相似度、功能互补性)出发,动态地向工具集中添加新的工具,以提高工具集的完整性和有效性。

关键创新:PTR方法的关键创新在于其精度驱动的工具推荐策略,能够根据任务需求动态调整工具集的大小和内容。与现有方法相比,PTR方法更加灵活和自适应,能够为LLMs提供更精准的工具支持。此外,论文还提出了一个新的数据集RecTools和一个新的评估指标TRACC,为工具推荐领域的研究提供了新的资源和工具。

关键设计:在多视角工具添加阶段,论文可能采用了多种技术手段,例如:1) 语义相似度计算:利用预训练语言模型计算工具描述和任务描述之间的语义相似度,选择与任务相关的工具。2) 功能互补性分析:分析工具之间的功能互补性,选择能够协同完成任务的工具组合。3) 工具依赖关系建模:考虑工具之间的依赖关系,确保工具集中包含所有必要的依赖工具。具体的参数设置、损失函数、网络结构等技术细节在论文中应该有更详细的描述,此处未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PTR方法在两个开放基准测试和RecTools数据集上都表现出良好的准确性。具体的性能数据和提升幅度需要在论文中查找。该研究验证了PTR方法在工具推荐方面的有效性,并为未来的研究提供了新的方向。

🎯 应用场景

该研究成果可应用于各种需要LLMs与外部工具交互的场景,例如智能客服、自动化报告生成、代码生成等。通过精准的工具推荐,可以提高LLMs解决复杂问题的效率和准确性,降低计算成本,并提升用户体验。未来,该技术有望进一步扩展到更多领域,例如机器人控制、智能制造等。

📄 摘要(原文)

By augmenting Large Language Models (LLMs) with external tools, their capacity to solve complex problems has been significantly enhanced. However, despite ongoing advancements in the parsing capabilities of LLMs, incorporating all available tools simultaneously in the prompt remains impractical due to the vast number of external tools. Consequently, it is essential to provide LLMs with a precise set of tools tailored to the specific task, considering both quantity and quality. Current tool retrieval methods primarily focus on refining the ranking list of tools and directly packaging a fixed number of top-ranked tools as the tool set. However, these approaches often fail to equip LLMs with the optimal set of tools prior to execution, since the optimal number of tools for different tasks could be different, resulting in inefficiencies such as redundant or unsuitable tools, which impede immediate access to the most relevant tools. This paper addresses the challenge of recommending precise toolsets for LLMs. We introduce the problem of tool recommendation, define its scope, and propose a novel Precision-driven Tool Recommendation (PTR) approach. PTR captures an initial, concise set of tools by leveraging historical tool bundle usage and dynamically adjusts the tool set by performing tool matching, culminating in a multi-view-based tool addition. Additionally, we present a new dataset, RecTools, and a metric, TRACC, designed to evaluate the effectiveness of tool recommendation for LLMs. We further validate our design choices through comprehensive experiments, demonstrating promising accuracy across two open benchmarks and our RecTools dataset.