Efficient and Accurate Prompt Optimization: the Benefit of Memory in Exemplar-Guided Reflection

作者: Cilin Yan, Jingyun Wang, Lin Zhang, Ruihui Zhao, Xiaopu Wu, Kai Xiong, Qingsong Liu, Guoliang Kang, Yangyang Kang

分类: cs.CL

发布日期: 2024-11-12 (更新: 2025-05-27)

备注: ACL 2025 Main

💡 一句话要点

提出ERM框架,利用记忆机制优化Prompt,提升大语言模型生成质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Prompt工程 大语言模型 记忆机制 范例学习 反馈优化 自动Prompt优化 Exemplar引导 LLM

📋 核心要点

- 现有Prompt优化方法忽略了历史反馈信息,且范例选择仅考虑语义关系,导致优化效率和准确性受限。

- ERM框架通过范例引导反馈生成,并构建记忆模块,充分利用历史反馈信息,实现更有效的范例检索。

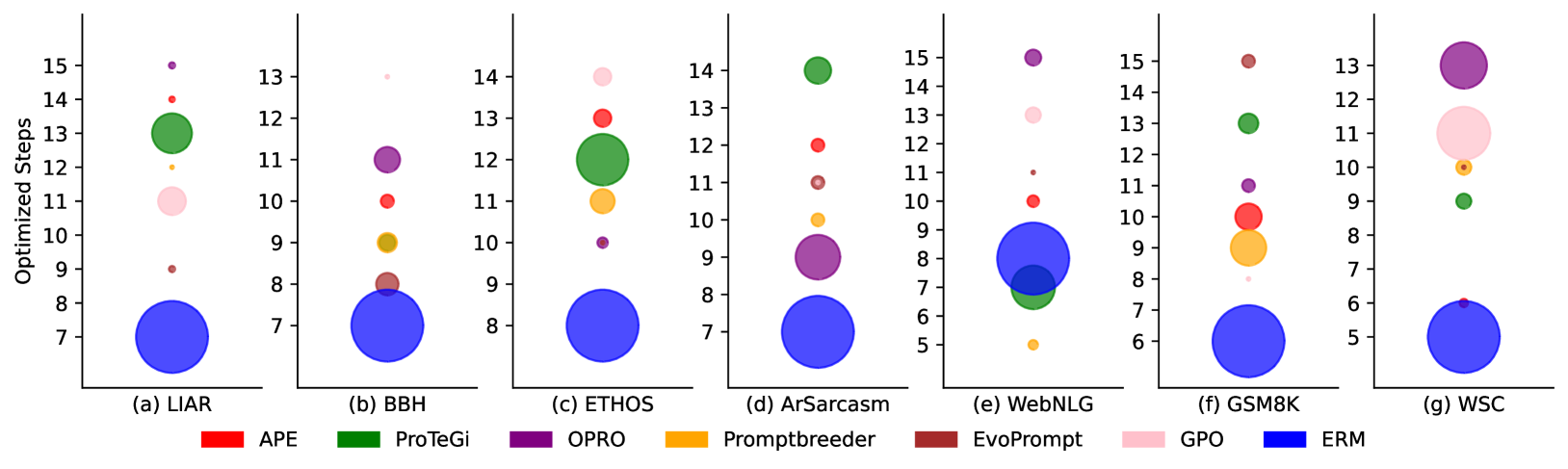

- 实验表明,ERM在更少的优化步骤下,显著提升了Prompt优化效果,并在多个数据集上超越了现有技术。

📝 摘要(中文)

本文提出了一种基于记忆机制的Exemplar引导的反思(ERM)方法,旨在实现更高效、更准确的Prompt优化,从而提升大型语言模型(LLM)的生成质量。现有方法利用错误案例的反馈来指导Prompt优化,并在推理时检索语义相关的范例,将其与优化后的Prompt连接。然而,这些方法仅利用当前步骤的反馈,忽略了历史反馈和未选择的反馈,而这些反馈可能是有益的。此外,范例的选择仅考虑了语义关系,可能并非任务性能和与优化Prompt匹配的最佳选择。ERM通过范例引导的反思机制,利用生成的范例来指导反馈生成。同时,构建两种记忆来充分利用历史反馈信息,并支持更有效的范例检索。实验结果表明,该方法在更少的优化步骤下超越了现有技术,例如在LIAR数据集上F1值提高了10.1,在ProTeGi上减少了一半的优化步骤。

🔬 方法详解

问题定义:现有自动Prompt工程方法在优化大语言模型(LLM)的生成质量时,主要依赖于错误案例的反馈。然而,这些方法存在两个主要痛点:一是仅利用当前步骤的反馈,忽略了历史反馈信息(包括未被选择的反馈),导致信息利用不充分;二是范例的选择仅基于语义相似度,而忽略了任务性能和与优化后Prompt的匹配程度,导致范例选择并非最优。

核心思路:本文的核心思路是引入记忆机制,充分利用历史反馈信息,并结合范例引导的反馈生成,从而实现更高效、更准确的Prompt优化。通过记忆模块,模型可以回顾历史经验,避免重复犯错,并更好地选择与当前Prompt相匹配的范例。

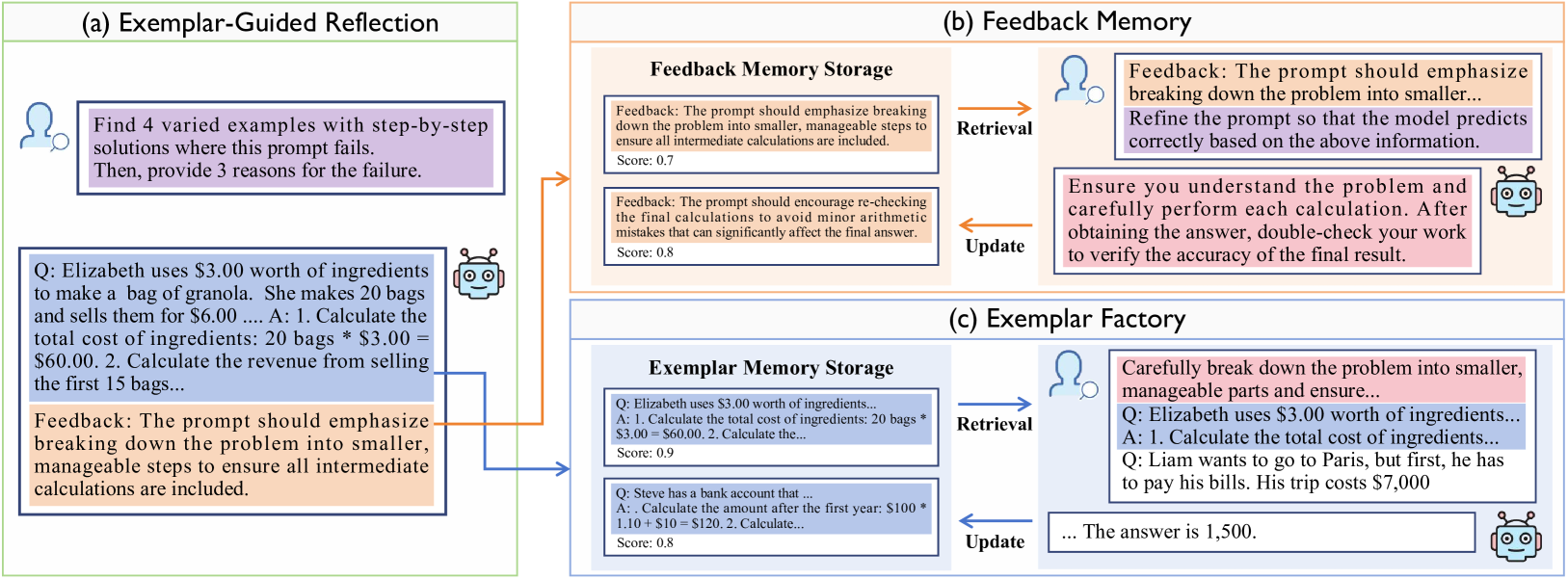

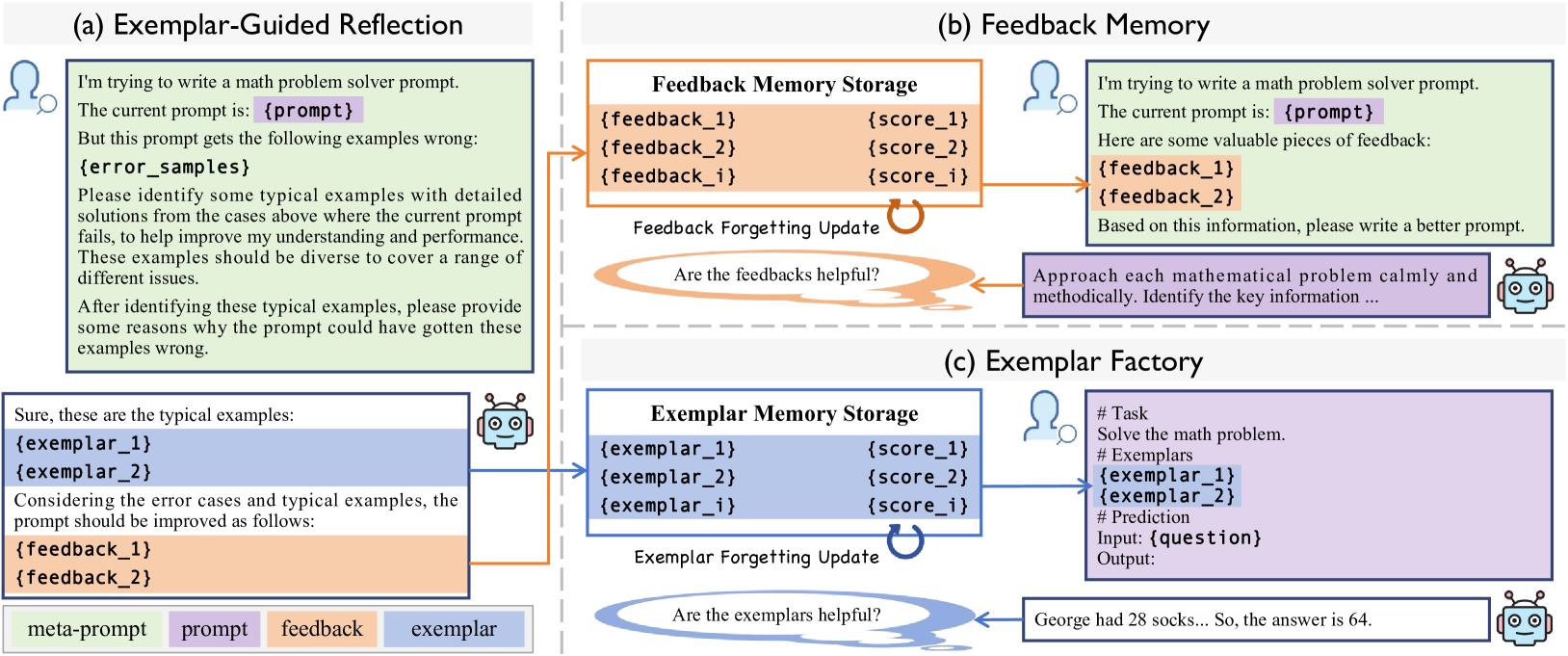

技术框架:ERM框架包含以下几个主要模块:1) 范例引导的反馈生成模块:该模块利用已生成的范例来指导反馈的生成,从而使反馈更具针对性;2) 历史反馈记忆模块:该模块存储历史反馈信息,包括已使用和未使用的反馈,以便模型回顾和学习;3) 范例检索模块:该模块基于记忆模块中的信息,检索与当前Prompt最相关的范例;4) Prompt优化模块:该模块利用生成的反馈和检索到的范例,对Prompt进行优化。整个流程是一个迭代过程,不断生成反馈、检索范例、优化Prompt,直到达到预定的性能指标。

关键创新:ERM的关键创新在于:1) 范例引导的反馈生成:通过范例引导,使反馈更具针对性,提高了反馈的质量;2) 记忆机制:通过记忆模块,充分利用了历史反馈信息,避免了信息的浪费,并提高了范例检索的准确性。与现有方法相比,ERM能够更有效地利用信息,从而实现更高效、更准确的Prompt优化。

关键设计:关于关键设计,论文中未明确给出具体的参数设置、损失函数、网络结构等技术细节。但可以推测,记忆模块可能采用了某种形式的循环神经网络(RNN)或Transformer结构,用于存储和检索历史反馈信息。范例检索模块可能使用了某种相似度度量方法,如余弦相似度或欧氏距离,来衡量范例与Prompt之间的相关性。损失函数的设计可能考虑了任务的特定目标,例如分类任务的交叉熵损失或回归任务的均方误差损失。具体实现细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ERM在多个数据集上超越了现有技术。例如,在LIAR数据集上,ERM的F1值提高了10.1。在ProTeGi数据集上,ERM将优化步骤减少了一半。这些结果表明,ERM能够更高效、更准确地优化Prompt,从而提升大语言模型的生成质量。

🎯 应用场景

ERM框架可广泛应用于各种需要Prompt工程的大语言模型应用场景,例如文本分类、问答系统、文本生成等。通过更高效、更准确的Prompt优化,可以显著提升这些应用的性能和用户体验。未来,该研究可以进一步扩展到多模态Prompt工程,例如图像和文本结合的Prompt优化。

📄 摘要(原文)

Automatic prompt engineering aims to enhance the generation quality of large language models (LLMs). Recent works utilize feedbacks generated from erroneous cases to guide the prompt optimization. During inference, they may further retrieve several semantically-related exemplars and concatenate them to the optimized prompts to improve the performance. However, those works only utilize the feedback at the current step, ignoring historical and unseleccted feedbacks which are potentially beneficial. Moreover, the selection of exemplars only considers the general semantic relationship and may not be optimal in terms of task performance and matching with the optimized prompt. In this work, we propose an Exemplar-Guided Reflection with Memory mechanism (ERM) to realize more efficient and accurate prompt optimization. Specifically, we design an exemplar-guided reflection mechanism where the feedback generation is additionally guided by the generated exemplars. We further build two kinds of memory to fully utilize the historical feedback information and support more effective exemplar retrieval. Empirical evaluations show our method surpasses previous state-of-the-arts with less optimization steps, i.e., improving F1 score by 10.1 on LIAR dataset, and reducing half of the optimization steps on ProTeGi.