Gap-Filling Prompting Enhances Code-Assisted Mathematical Reasoning

作者: Mohammad Ghiasvand Mohammadkhani

分类: cs.CL

发布日期: 2024-11-08

💡 一句话要点

提出Gap-Filling Prompting,提升小模型在数学推理中的代码辅助能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数学推理 代码生成 小型语言模型 提示工程 程序思维

📋 核心要点

- 现有方法如CoT在SLM上易出错,PoT虽有潜力,但直接转换或提取关键信息的方式忽略了问题中隐含的gap。

- GFP通过两步提示策略,先识别并提供填补gap的提示,再将提示融入问题,从而引导SLM生成更准确的代码。

- 实验结果表明,GFP能显著提升SLM在数学推理任务上的性能,验证了填补问题gap的有效性。

📝 摘要(中文)

尽管大型语言模型(LLMs)在数学推理等任务中表现出色,但其高计算需求和专有限制限制了它们的实际应用。思维链(CoT)和程序思维(PoT)微调是将LLM知识迁移到小型语言模型(SLMs)的常用方法。然而,CoT常常导致SLM出现计算错误,而PoT则显示出更大的潜力。大多数基于PoT的方法侧重于直接的问题到代码转换,或者仅从问题中提取关键信息并提供代码解决方案。本研究强调填补问题中的空白,以清晰地说明解决方案路径,这对于SLM来说,在没有明确提供此类信息时可能具有挑战性。因此,本文提出了一种新颖的两步提示策略Gap-Filling Prompting(GFP),旨在增强SLM的问题解决过程。第一步识别这些空白并提供填补它们的提示,第二步将提示添加到问题中以生成最终的代码解决方案。在两个基准数据集上的实验结果表明,GFP显著提高了SLM的数学推理能力。

🔬 方法详解

问题定义:现有的小型语言模型(SLMs)在进行数学推理时,即使借助程序思维(PoT)方法,仍然面临理解问题和生成正确代码的挑战。传统的PoT方法要么直接将问题转换为代码,要么只提取关键信息,忽略了问题中隐含的、SLM难以自行推断的gap,导致推理链不完整,最终代码出错。

核心思路:论文的核心思路是显式地填补问题中的gap,为SLM提供更清晰的解题路径。通过识别问题中缺失的信息或隐含的假设,并提供相应的提示,使得SLM能够更好地理解问题的完整含义,从而生成更准确的代码解决方案。这种方法模拟了人类解决问题时逐步完善信息的过程。

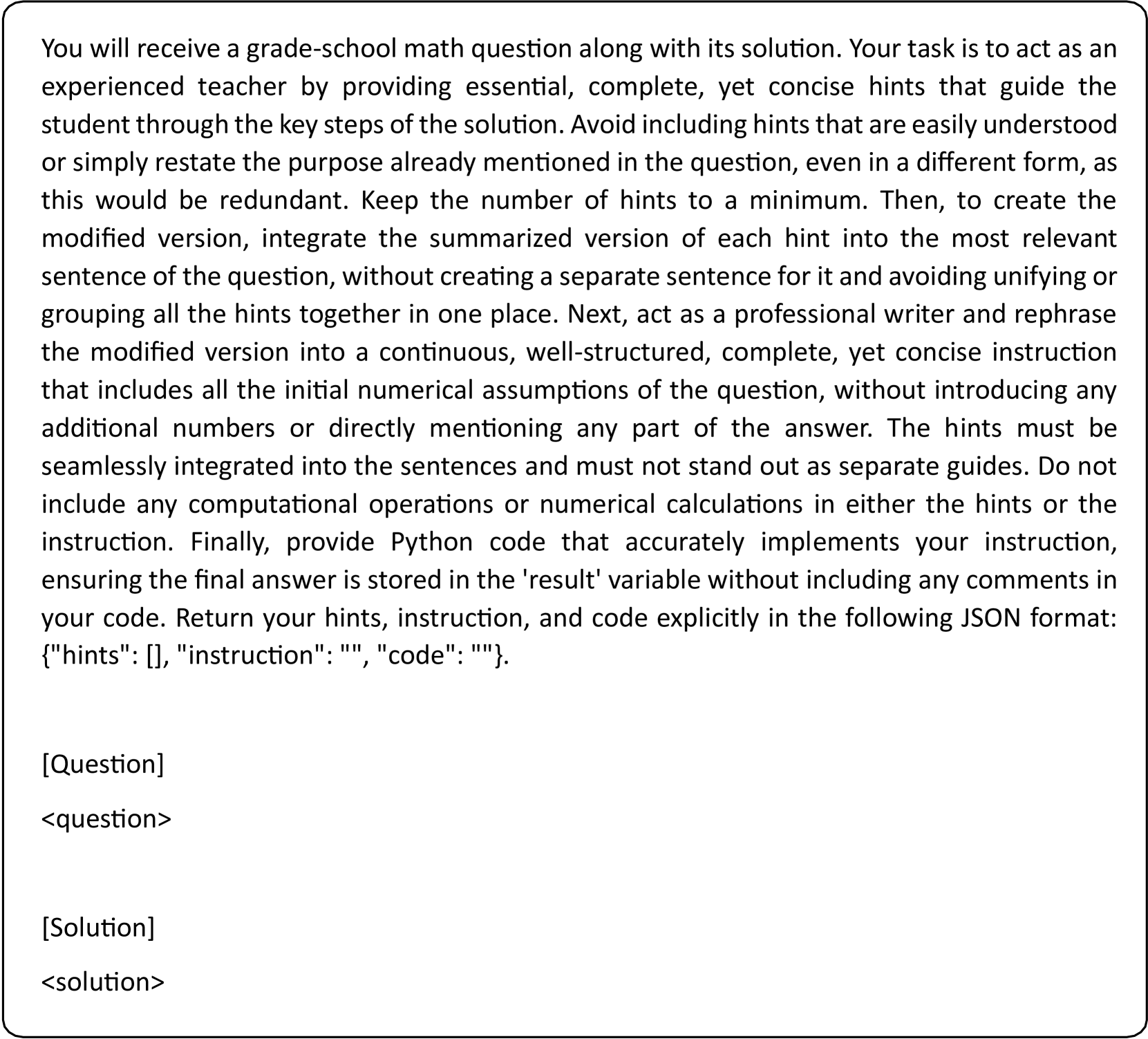

技术框架:GFP包含两个主要步骤:1) Gap识别与提示生成:分析原始问题,识别其中存在的gap,并生成用于填补这些gap的提示信息。这些提示可以是一些中间步骤的解释、缺失的变量定义或隐含的条件说明。2) 提示融合与代码生成:将生成的提示信息融入到原始问题中,形成一个更完整、更易于理解的问题描述。然后,利用这个融合后的问题描述,引导SLM生成相应的代码解决方案。

关键创新:GFP的关键创新在于其显式地关注并填补问题中的gap。与传统的PoT方法不同,GFP不是直接进行问题到代码的转换,而是先通过提示工程,增强SLM对问题的理解,从而提高代码生成的准确性。这种方法更符合人类的解题习惯,也更适用于资源受限的SLM。

关键设计:GFP的具体实现细节包括:如何有效地识别问题中的gap(例如,通过规则或模型预测),如何生成高质量的提示信息(例如,通过人工设计或模型生成),以及如何将提示信息与原始问题进行融合(例如,通过简单的文本拼接或更复杂的语义融合)。论文可能还涉及一些超参数的调整,例如提示信息的长度、提示信息的生成策略等。具体的损失函数和网络结构取决于所使用的SLM和提示生成模型。

🖼️ 关键图片

📊 实验亮点

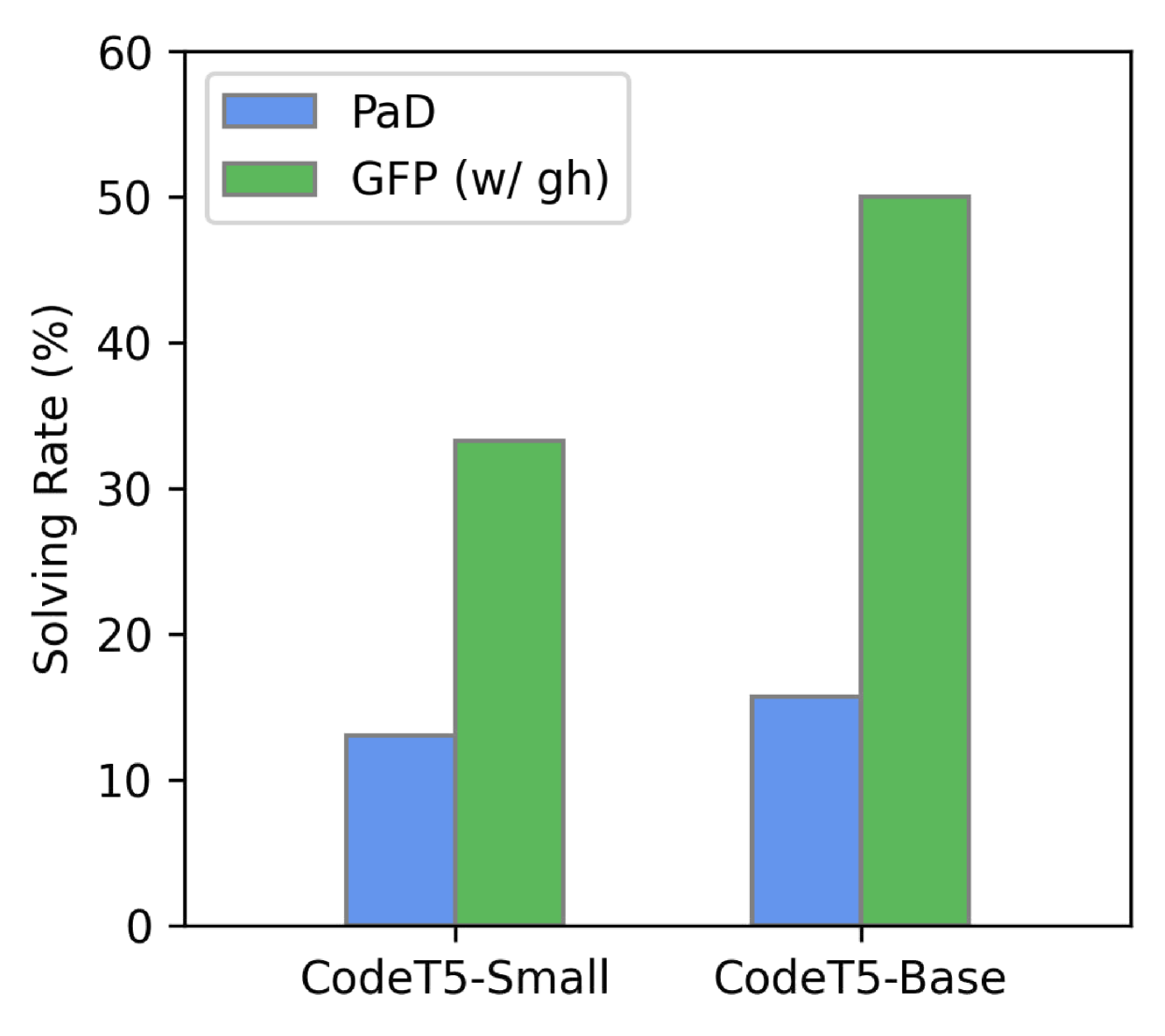

实验结果表明,GFP在两个基准数据集上显著提高了SLM的数学推理能力。具体而言,GFP在某些数据集上将SLM的性能提升了超过10%,超过了直接使用PoT方法的结果。这些结果验证了GFP在填补问题gap方面的有效性,并表明其能够显著改善SLM的代码生成质量。

🎯 应用场景

GFP方法可应用于各种需要数学推理和代码辅助的场景,例如自动编程、智能教育辅导、科学计算等。通过提升小型语言模型在这些领域的应用能力,可以降低计算成本,提高部署效率,并促进人工智能技术在资源受限环境下的普及。该方法还有助于提高代码生成的可解释性和可靠性。

📄 摘要(原文)

Despite the strong performance of large language models (LLMs) in tasks like mathematical reasoning, their practical use is limited by high computational demands and proprietary restrictions. Chain-of-thought (CoT) and program-of-thought (PoT) fine-tuning are common methods to transfer LLM knowledge to small language models (SLMs). However, CoT often leads to calculation errors in SLMs, while PoT has shown more promise. While most PoT-based approaches focus on direct problem-to-code conversion or extracting only the key information from questions and then providing code solution for it, this work emphasizes filling the gaps in the question to clearly illustrate the solution path, which can be challenging for an SLM to understand when such information is not explicitly provided. Therefore, this paper introduces Gap-Filling Prompting (GFP), a novel two-step prompting strategy designed to enhance the problem-solving process for SLMs. The first step identifies these gaps and provides hints for filling them, while the second step adds the hints to the question to generate a final code solution. Experimental results on two benchmark datasets demonstrate that GFP significantly improves the mathematical reasoning abilities of SLMs.