Improving Multi-Domain Task-Oriented Dialogue System with Offline Reinforcement Learning

作者: Dharmendra Prajapat, Durga Toshniwal

分类: cs.CL, cs.AI, cs.HC, cs.IR

发布日期: 2024-11-08

💡 一句话要点

提出一种基于离线强化学习的多领域任务型对话系统,提升任务完成率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 任务型对话系统 离线强化学习 GPT2 多领域对话 自然语言处理

📋 核心要点

- 现有任务型对话系统仅使用监督学习微调预训练模型,存在暴露偏差和token损失问题,导致模型偏离用户任务。

- 本文提出一种基于GPT2的TOD系统,结合监督学习和强化学习进行优化,利用不可微的奖励函数缓解上述问题。

- 实验结果表明,该模型在MultiWOZ2.1数据集上,信息率提升1.60%,成功率提升3.17%,验证了方法的有效性。

📝 摘要(中文)

本文提出了一种利用离线强化学习改进多领域任务型对话系统(TOD)的方法。该系统采用统一的预训练语言模型GPT2作为基础模型,并结合监督学习和强化学习进行优化。为了解决暴露偏差和token损失问题,该方法使用了一个不可微的奖励函数,该奖励函数是成功率和BLEU评估指标的加权和。成功率和BLEU指标在奖励计算中指导语言模型完成用户任务,同时确保连贯和流畅的响应。该模型通过在对话会话级别微调预训练模型获得,对话会话包括用户话语、信念状态、系统行为和系统响应。在MultiWOZ2.1上的实验结果表明,与基线相比,该模型的信息率提高了1.60%,成功率提高了3.17%。

🔬 方法详解

问题定义:现有任务型对话系统在微调预训练语言模型时,主要依赖监督学习,这导致了暴露偏差(exposure bias)和token损失问题。暴露偏差指的是模型在训练时只接触到ground truth的对话历史,而在推理时需要自己生成对话,这导致训练和推理之间的不一致。Token损失问题指的是模型在训练时只关注单个token的预测,而忽略了整个对话的连贯性和任务完成度。这些问题最终导致模型偏离用户任务,降低了对话系统的性能。

核心思路:本文的核心思路是利用离线强化学习来解决暴露偏差和token损失问题。通过引入强化学习,模型可以在与环境交互的过程中学习到更优的对话策略,从而更好地完成用户任务。同时,使用不可微的奖励函数,可以更灵活地定义任务完成的标准,并引导模型生成更连贯和流畅的响应。

技术框架:该TOD系统的整体框架包括以下几个主要模块:1) 预训练语言模型:使用GPT2作为基础模型,用于生成对话响应。2) 监督学习模块:使用监督学习方法对GPT2进行微调,使其初步具备对话能力。3) 强化学习模块:使用离线强化学习方法对模型进行进一步优化,使其更好地完成用户任务。4) 奖励函数:使用成功率和BLEU评估指标的加权和作为奖励函数,用于评估模型的对话质量和任务完成度。

关键创新:本文的关键创新在于将离线强化学习应用于多领域任务型对话系统,并设计了一个不可微的奖励函数。传统的强化学习方法需要与环境进行在线交互,这在对话系统中是昂贵且耗时的。离线强化学习则可以利用已有的对话数据进行训练,避免了在线交互的成本。此外,使用不可微的奖励函数可以更灵活地定义任务完成的标准,并引导模型生成更符合用户需求的响应。

关键设计:在奖励函数的设计上,使用了成功率和BLEU评估指标的加权和。成功率用于评估模型是否成功完成了用户任务,BLEU评估指标用于评估模型生成的响应的流畅性和连贯性。通过调整成功率和BLEU评估指标的权重,可以控制模型在任务完成和对话质量之间的平衡。此外,在强化学习的训练过程中,使用了策略梯度算法,通过不断调整模型的参数,使其能够获得更高的奖励。

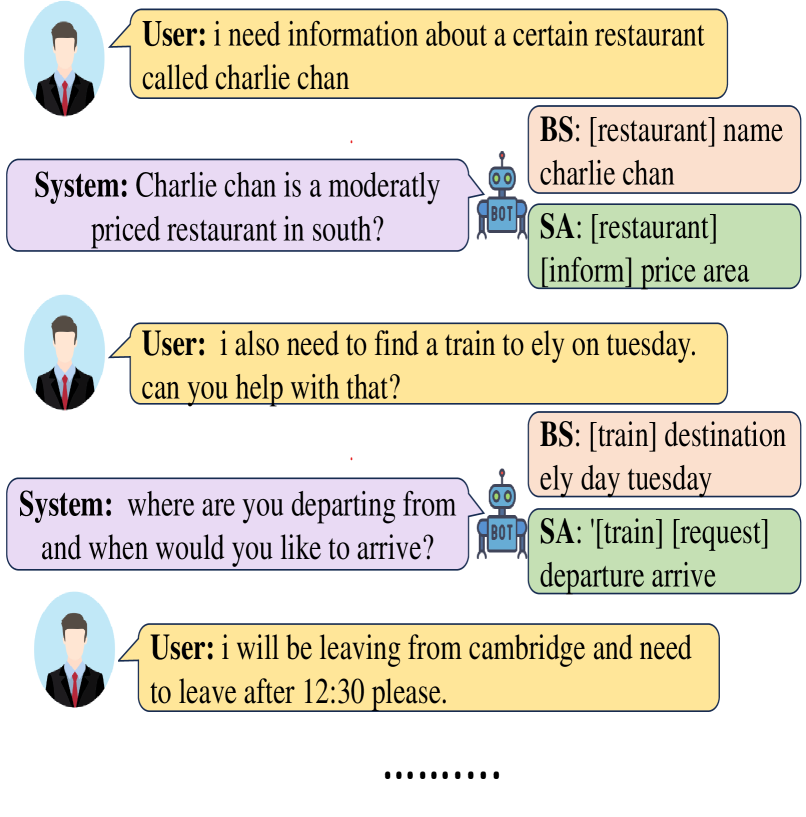

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在MultiWOZ2.1数据集上取得了显著的性能提升。与基线模型相比,信息率提高了1.60%,成功率提高了3.17%。这些数据表明,该方法能够有效地解决暴露偏差和token损失问题,提高对话系统的任务完成能力和对话质量。该结果验证了离线强化学习在任务型对话系统中的有效性。

🎯 应用场景

该研究成果可应用于智能客服、虚拟助手等领域,提升人机对话的自然度和任务完成效率。通过强化学习优化对话策略,系统能够更好地理解用户意图,提供更准确、更个性化的服务,从而改善用户体验,并降低人工客服的运营成本。未来,该技术有望扩展到更复杂的对话场景,例如多轮对话、情感对话等。

📄 摘要(原文)

Task-oriented dialogue (TOD) system is designed to accomplish user-defined tasks through dialogues. The TOD system has progressed towards end-to-end modeling by leveraging pre-trained large language models. Fine-tuning the pre-trained language models using only supervised learning leads to the exposure bias and token loss problem and it deviates the models from completing the user's task. To address these issues, we propose a TOD system that leverages a unified pre-trained language model, GPT2, as a base model. It is optimized using supervised learning and reinforcement learning (RL). The issues in the TOD system are mitigated using a non-differentiable reward function. The reward is calculated using the weighted sum of the success rate and BLEU evaluation metrics. The success rate and BLEU metrics in reward calculation guide the language model for user task completion while ensuring a coherent and fluent response. Our model is acquired by fine-tuning a pre-trained model on the dialogue-session level which comprises user utterance, belief state, system act, and system response. Experimental results on MultiWOZ2.1 demonstrate that our model increases the inform rate by 1.60% and the success rate by 3.17% compared to the baseline.