Abstract2Appendix: Academic Reviews Enhance LLM Long-Context Capabilities

作者: Shengzhi Li, Kittipat Kampa, Rongyu Lin, Bohang Li, Shichao Pei

分类: cs.CL, cs.AI

发布日期: 2024-11-07

备注: We share our latest dataset on https://github.com/findalexli/Abstract2Appendix

💡 一句话要点

利用学术评审数据增强LLM长文本处理能力,DPO方法优于SFT。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本理解 大型语言模型 学术评审 直接偏好优化 DPO 监督微调 SFT

📋 核心要点

- 现有LLM在长文本处理方面存在不足,难以有效利用长文本中的信息进行推理和问答。

- 利用高质量的学术同行评审数据,通过微调LLM来提升其长文本处理能力,特别是信息检索和推理能力。

- 实验表明,使用DPO方法微调的模型在长文本问答任务上取得了显著提升,优于SFT方法和其他基线模型。

📝 摘要(中文)

大型语言模型(LLMs)在各种任务中表现出色,但处理长文本阅读能力仍然具有挑战性。本研究探索了利用高质量学术同行评审数据对LLMs进行微调,以增强其长文本处理能力的有效性。我们将直接偏好优化(DPO)方法与监督微调(SFT)方法进行了比较,证明了DPO的优越性和数据效率。实验表明,微调后的模型仅使用2000个样本,在phi-3上实现了4.04分的提升,在Qasper基准测试上实现了2.6%的提升。尽管面临数据规模和处理成本的限制,但本研究强调了DPO和高质量数据在提升LLM性能方面的潜力。此外,零样本基准测试结果表明,高质量的人工评审压倒性地优于LLM生成的响应,即使是最强大的模型如GPT-4o也是如此。这表明高质量的人工评审在信息、推理和长文本检索方面非常丰富,即使是最先进的模型也尚未完全掌握这些能力。这些发现突出了利用人工评审进一步推进该领域的高效用性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在处理长文本时面临的挑战,特别是信息检索和推理能力不足的问题。现有的LLM虽然在各种任务中表现出色,但在长文本阅读理解方面仍然存在局限性,难以有效利用长文本中的信息进行推理和问答。

核心思路:论文的核心思路是利用高质量的学术同行评审数据对LLM进行微调,从而增强其长文本处理能力。学术评审数据包含丰富的专业知识、推理过程和上下文信息,可以帮助LLM更好地理解和利用长文本中的信息。此外,论文对比了直接偏好优化(DPO)和监督微调(SFT)两种微调方法,发现DPO方法在数据效率和性能方面更具优势。

技术框架:论文的技术框架主要包括数据准备、模型选择、微调方法和评估指标四个部分。首先,收集高质量的学术同行评审数据,并进行预处理。然后,选择合适的LLM作为基础模型,并使用DPO或SFT方法进行微调。最后,使用Qasper等基准测试数据集评估微调后模型的性能。

关键创新:论文的关键创新在于利用学术同行评审数据作为训练数据来增强LLM的长文本处理能力。与传统的训练数据相比,学术评审数据具有更高的质量和更丰富的专业知识,可以帮助LLM更好地理解和利用长文本中的信息。此外,论文还发现DPO方法在微调LLM时具有更好的数据效率和性能。

关键设计:论文的关键设计包括:1) 使用高质量的学术同行评审数据进行微调;2) 采用直接偏好优化(DPO)方法,该方法通过优化模型对不同响应的偏好来提高性能;3) 使用Qasper等基准测试数据集评估模型的长文本问答能力。具体参数设置和损失函数等细节在论文中未详细说明,属于未知信息。

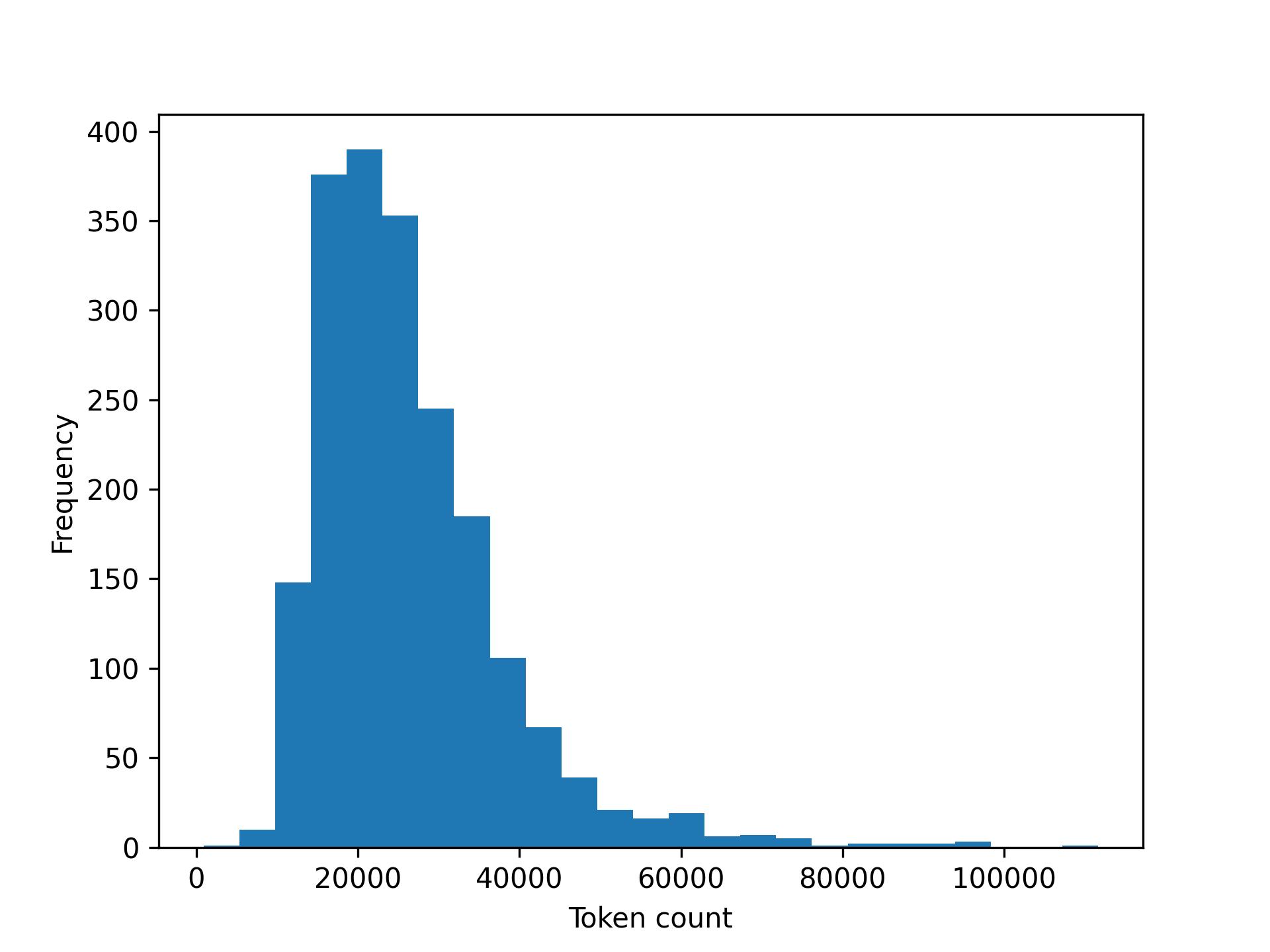

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用DPO方法微调后的模型在phi-3上实现了4.04分的提升,在Qasper基准测试上实现了2.6%的提升,仅使用了2000个样本。此外,零样本测试表明,高质量的人工评审结果明显优于即使是GPT-4o等最先进的LLM生成的答案,突出了高质量人工标注数据的价值。

🎯 应用场景

该研究成果可应用于多个领域,例如:智能文档处理、自动论文评审、智能客服、知识图谱构建等。通过提升LLM的长文本处理能力,可以更有效地从大量文本数据中提取信息、进行推理和生成高质量的文本内容,从而提高工作效率和决策质量。未来,该方法有望应用于更广泛的自然语言处理任务中。

📄 摘要(原文)

Large language models (LLMs) have shown remarkable performance across various tasks, yet their ability to handle long-context reading remains challenging. This study explores the effectiveness of leveraging high-quality academic peer review data for fine-tuning LLMs to enhance their long-context capabilities. We compare the Direct Preference Optimization (DPO) method with the Supervised Fine-Tuning (SFT) method, demonstrating DPO's superiority and data efficiency. Our experiments show that the fine-tuned model achieves a 4.04-point improvement over phi-3 and a 2.6\% increase on the Qasper benchmark using only 2000 samples. Despite facing limitations in data scale and processing costs, this study underscores the potential of DPO and high-quality data in advancing LLM performance. Additionally, the zero-shot benchmark results indicate that aggregated high-quality human reviews are overwhelmingly preferred over LLM-generated responses, even for the most capable models like GPT-4o. This suggests that high-quality human reviews are extremely rich in information, reasoning, and long-context retrieval, capabilities that even the most advanced models have not fully captured. These findings highlight the high utility of leveraging human reviews to further advance the field.