Leveraging LLMs to Enable Natural Language Search on Go-to-market Platforms

作者: Jesse Yao, Saurav Acharya, Priyaranjan Parida, Srinivas Attipalli, Ali Dasdan

分类: cs.CL, cs.AI, cs.DB, cs.IR, cs.LG

发布日期: 2024-11-07

备注: 11 pages, 5 figures

💡 一句话要点

利用LLM在GTM平台上实现自然语言搜索,提升企业信息检索效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自然语言搜索 大型语言模型 实体提取 GTM平台 Prompt工程

📋 核心要点

- 现有GTM平台高级搜索复杂繁琐,用户需掌握大量配置信息,自然语言搜索是更理想的解决方案。

- 利用LLM进行实体提取,将自然语言查询转化为结构化搜索字段,消除语法错误,简化ground truth。

- 通过prompt工程和Llama-3-8B-Instruct微调,实验表明该方法在GTM平台搜索中具有高准确率。

📝 摘要(中文)

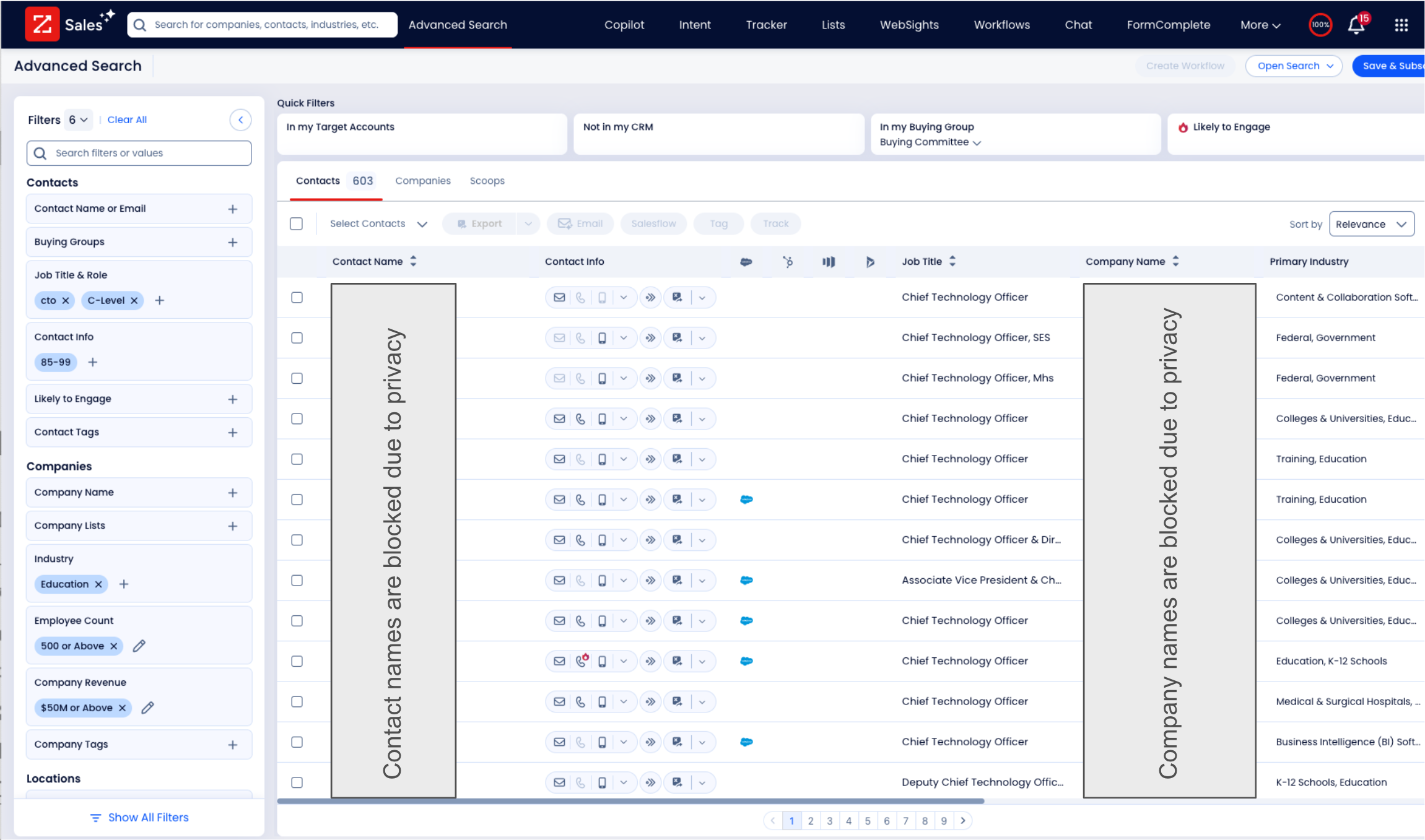

企业搜索通常要求用户具备复杂的查询、配置和元数据知识,这使得他们难以按需访问信息。大多数go-to-market (GTM) 平台采用高级搜索,允许用户通过各种字段(使用类别或关键词)过滤查询。然而,这种方式非常繁琐,用户需要面对大量的选项、字段和按钮。因此,自然语言查询一直是理想的选择,而大型语言模型 (LLM) 的出现进一步增强了这一可能性。本文针对Zoominfo的销售产品,实现并评估了一个解决方案,该方案使用自然语言提示LLM,通过实体提取生成搜索字段,然后将其转换为搜索查询。中间搜索字段为每个查询提供了诸多优势,包括消除语法错误、简化ground truth以及为LLM提供直观的解释格式。我们结合了许多先进的prompt工程策略,包括复杂的系统消息、few-shot prompting、chain-of-thought (CoT) 推理和执行优化。此外,我们手动创建了500多个自然语言查询的ground truth,从而能够对Llama-3-8B-Instruct进行监督微调,并引入复杂的数值指标。通过对单个搜索实体进行精确匹配、Jaccard系数、余弦相似度和语义相似度的综合实验,我们使用闭源、开源和微调的LLM模型,证明了该方法的有效性。总体而言,最准确的闭源模型平均每个查询的准确率为97%,只有一个字段的准确率低于90%,微调模型也观察到了类似的结果。

🔬 方法详解

问题定义:论文旨在解决企业级GTM平台中,用户使用传统高级搜索界面进行信息检索时遇到的困难。现有方法需要用户具备复杂的查询知识,界面选项繁多,导致检索效率低下,用户体验差。

核心思路:核心思路是利用LLM理解用户的自然语言查询,并将其转化为平台可理解的结构化搜索字段。通过实体提取,将用户意图映射到具体的搜索条件,从而简化查询过程,提高检索效率。

技术框架:整体框架包含以下几个主要阶段:1) 接收用户的自然语言查询;2) 使用LLM进行实体提取,生成中间搜索字段;3) 将搜索字段转换为平台可执行的搜索查询;4) 执行查询并返回结果。该框架的核心是LLM驱动的实体提取模块。

关键创新:关键创新在于将LLM应用于GTM平台的自然语言搜索,并设计了一套完整的解决方案,包括prompt工程、模型微调和评估指标。与传统的关键词匹配或规则引擎相比,该方法能够更好地理解用户意图,并生成更准确的搜索查询。

关键设计:论文采用了多种prompt工程策略,包括复杂的系统消息、few-shot prompting和chain-of-thought (CoT) 推理,以提高LLM的实体提取能力。此外,还手动创建了500多个自然语言查询的ground truth,用于监督微调Llama-3-8B-Instruct模型。评估指标包括精确匹配、Jaccard系数、余弦相似度和语义相似度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在Zoominfo产品中取得了显著的性能提升。最准确的闭源模型平均每个查询的准确率为97%,只有一个字段的准确率低于90%。微调后的Llama-3-8B-Instruct模型也取得了可比的结果,证明了该方法在实际应用中的有效性。

🎯 应用场景

该研究成果可广泛应用于各类企业级GTM平台,提升销售人员和市场人员的信息检索效率,助力企业更好地了解市场和客户。未来,该方法还可以扩展到其他领域的企业搜索,例如客户关系管理 (CRM) 系统、供应链管理系统等,具有广阔的应用前景。

📄 摘要(原文)

Enterprise searches require users to have complex knowledge of queries, configurations, and metadata, rendering it difficult for them to access information as needed. Most go-to-market (GTM) platforms utilize advanced search, an interface that enables users to filter queries by various fields using categories or keywords, which, historically, however, has proven to be exceedingly cumbersome, as users are faced with seemingly hundreds of options, fields, and buttons. Consequently, querying with natural language has long been ideal, a notion further empowered by Large Language Models (LLMs). In this paper, we implement and evaluate a solution for the Zoominfo product for sellers, which prompts the LLM with natural language, producing search fields through entity extraction that are then converted into a search query. The intermediary search fields offer numerous advantages for each query, including the elimination of syntax errors, simpler ground truths, and an intuitive format for the LLM to interpret. We paired this pipeline with many advanced prompt engineering strategies, featuring an intricate system message, few-shot prompting, chain-of-thought (CoT) reasoning, and execution refinement. Furthermore, we manually created the ground truth for 500+ natural language queries, enabling the supervised fine-tuning of Llama-3-8B-Instruct and the introduction of sophisticated numerical metrics. Comprehensive experiments with closed, open source, and fine-tuned LLM models were conducted through exact, Jaccard, cosine, and semantic similarity on individual search entities to demonstrate the efficacy of our approach. Overall, the most accurate closed model had an average accuracy of 97% per query, with only one field performing under 90%, with comparable results observed from the fine-tuned models.