Prompt-Guided Internal States for Hallucination Detection of Large Language Models

作者: Fujie Zhang, Peiqi Yu, Biao Yi, Baolei Zhang, Tong Li, Zheli Liu

分类: cs.CL

发布日期: 2024-11-07 (更新: 2025-05-22)

💡 一句话要点

提出PRISM框架,利用Prompt引导LLM内部状态,提升幻觉检测跨域泛化能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 幻觉检测 跨域泛化 Prompt工程 内部状态

📋 核心要点

- 现有基于LLM内部状态的幻觉检测器在跨领域泛化能力上存在不足,难以适应新领域。

- PRISM框架通过Prompt引导LLM内部状态,使文本真实性相关的结构更加显著和一致,从而提升跨域泛化性。

- 实验表明,PRISM框架能有效提升现有幻觉检测方法在不同领域数据集上的性能。

📝 摘要(中文)

大型语言模型(LLMs)在各个领域的任务中展现了卓越的能力。然而,它们有时会产生逻辑上连贯但事实不正确或具有误导性的回应,这被称为LLM幻觉。数据驱动的监督方法通过利用LLM的内部状态来训练幻觉检测器,但是针对特定领域训练的检测器通常难以很好地泛化到其他领域。本文旨在仅使用领域内数据来增强监督检测器的跨域性能。我们提出了一个新颖的框架,即prompt引导的LLM幻觉检测内部状态(PRISM)。通过利用适当的prompt来引导LLM内部状态中与文本真实性相关的结构发生变化,我们使该结构在来自不同领域的文本中更加显著和一致。我们将我们的框架与现有的幻觉检测方法集成,并在来自不同领域的数据集上进行了实验。实验结果表明,我们的框架显著增强了现有幻觉检测方法的跨域泛化能力。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)幻觉检测器在跨领域泛化能力不足的问题。现有的监督学习方法依赖于特定领域的数据进行训练,导致模型在面对新领域的数据时表现不佳。痛点在于如何利用有限的领域内数据,提升模型在未知领域的幻觉检测性能。

核心思路:论文的核心思路是通过Prompt引导LLM的内部状态,使其内部状态中与文本真实性相关的结构更加突出和一致。通过精心设计的Prompt,可以影响LLM在处理不同领域文本时的内部表征,从而使幻觉检测器能够更好地识别和区分真实信息和虚假信息。这种方法的核心在于利用Prompt来操纵LLM的内部知识,而不是直接修改模型参数。

技术框架:PRISM框架主要包含以下几个阶段:1) Prompt设计:设计能够引导LLM关注文本真实性的Prompt。2) 内部状态提取:利用Prompt处理输入文本,并提取LLM的内部状态(例如,特定层的激活值)。3) 特征表示:对提取的内部状态进行特征表示,以便后续的幻觉检测。4) 幻觉检测器训练:利用领域内数据训练幻觉检测器,该检测器使用Prompt引导的内部状态作为输入。5) 跨域泛化:将训练好的幻觉检测器应用于其他领域的数据,评估其泛化性能。

关键创新:PRISM框架的关键创新在于利用Prompt来引导LLM的内部状态,从而增强幻觉检测器的跨领域泛化能力。与传统的监督学习方法不同,PRISM不直接修改模型参数,而是通过Prompt来操纵LLM的内部知识,使其更好地适应不同领域的数据。这种方法可以有效地利用LLM的预训练知识,并减少对领域外数据的依赖。

关键设计:Prompt的设计至关重要,需要精心选择能够有效引导LLM关注文本真实性的Prompt。论文中可能使用了多种Prompt,并进行了实验评估,以确定最佳的Prompt策略。此外,内部状态的提取和特征表示也需要仔细设计,以确保能够有效地捕捉到与文本真实性相关的信息。具体的参数设置、损失函数和网络结构等技术细节未知,需要参考论文原文。

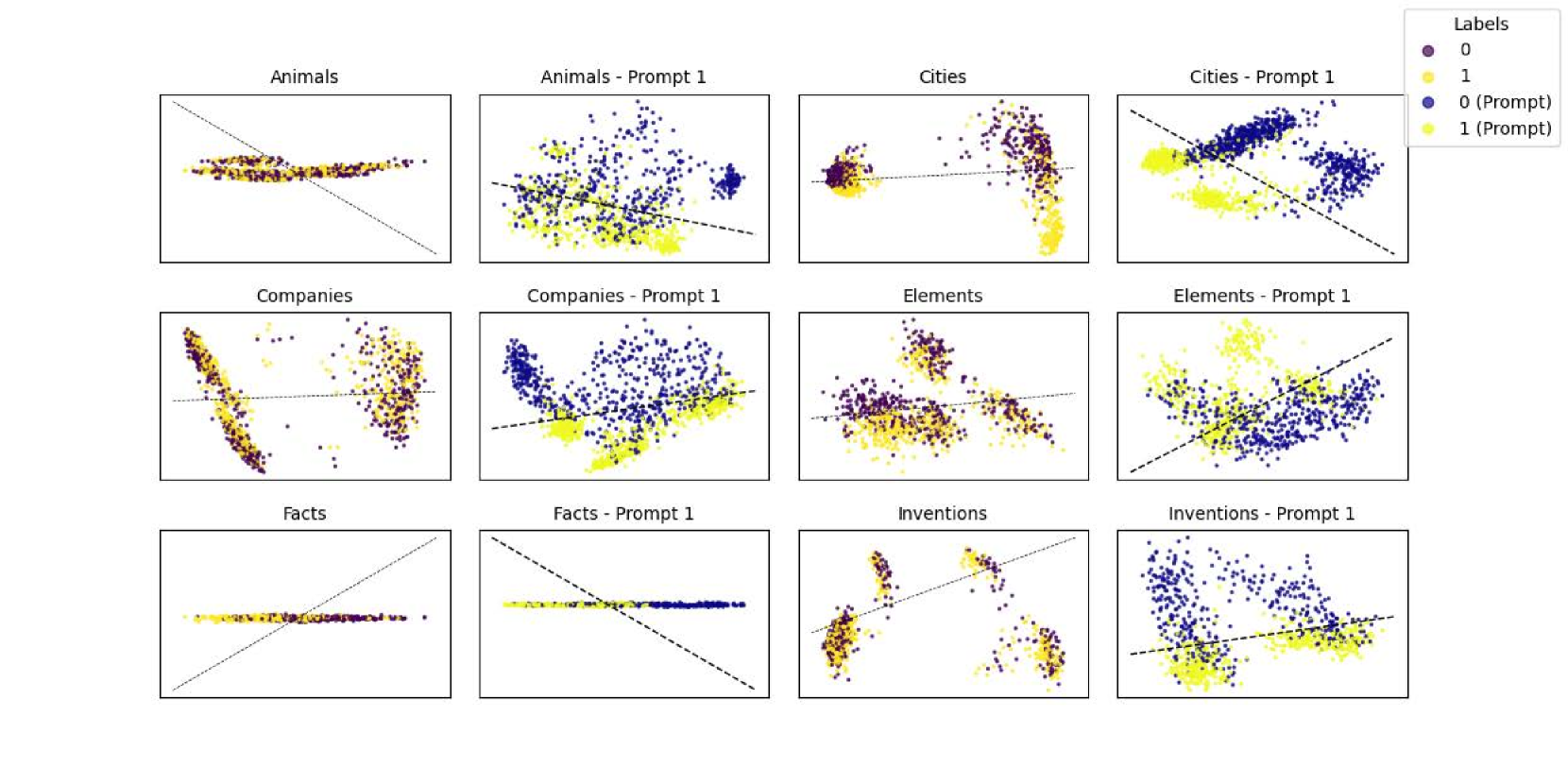

🖼️ 关键图片

📊 实验亮点

实验结果表明,PRISM框架能够显著提升现有幻觉检测方法的跨域泛化能力。具体的性能数据和提升幅度未知,但摘要强调了“显著增强”,表明PRISM在跨域幻觉检测方面取得了重要进展。通过与现有方法的集成,PRISM展示了其良好的兼容性和实用性。

🎯 应用场景

该研究成果可应用于各种需要确保信息准确性的场景,例如新闻审核、医疗诊断、金融分析等。通过提高LLM幻觉检测的准确性,可以减少虚假信息的传播,提高决策的可靠性,并降低潜在的风险。未来,该技术有望集成到LLM应用中,实现自动化的内容审核和质量控制。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable capabilities across a variety of tasks in different domains. However, they sometimes generate responses that are logically coherent but factually incorrect or misleading, which is known as LLM hallucinations. Data-driven supervised methods train hallucination detectors by leveraging the internal states of LLMs, but detectors trained on specific domains often struggle to generalize well to other domains. In this paper, we aim to enhance the cross-domain performance of supervised detectors with only in-domain data. We propose a novel framework, prompt-guided internal states for hallucination detection of LLMs, namely PRISM. By utilizing appropriate prompts to guide changes to the structure related to text truthfulness in LLMs' internal states, we make this structure more salient and consistent across texts from different domains. We integrated our framework with existing hallucination detection methods and conducted experiments on datasets from different domains. The experimental results indicate that our framework significantly enhances the cross-domain generalization of existing hallucination detection methods.