Improving Radiology Report Conciseness and Structure via Local Large Language Models

作者: Iryna Hartsock, Cyrillo Araujo, Les Folio, Ghulam Rasool

分类: cs.CL, cs.AI

发布日期: 2024-11-06 (更新: 2025-06-03)

备注: published version

DOI: 10.1007/s10278-025-01510-w

💡 一句话要点

利用本地大语言模型提升放射科报告的简洁性和结构化程度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 放射科报告 大语言模型 自然语言处理 文本压缩 结构化报告

📋 核心要点

- 放射科报告冗长且缺乏结构,导致医生难以快速定位关键信息,增加了信息遗漏的风险。

- 该研究利用机构内部署的私有大语言模型,结合LangChain框架,通过优化提示策略,实现报告的自动压缩和结构化。

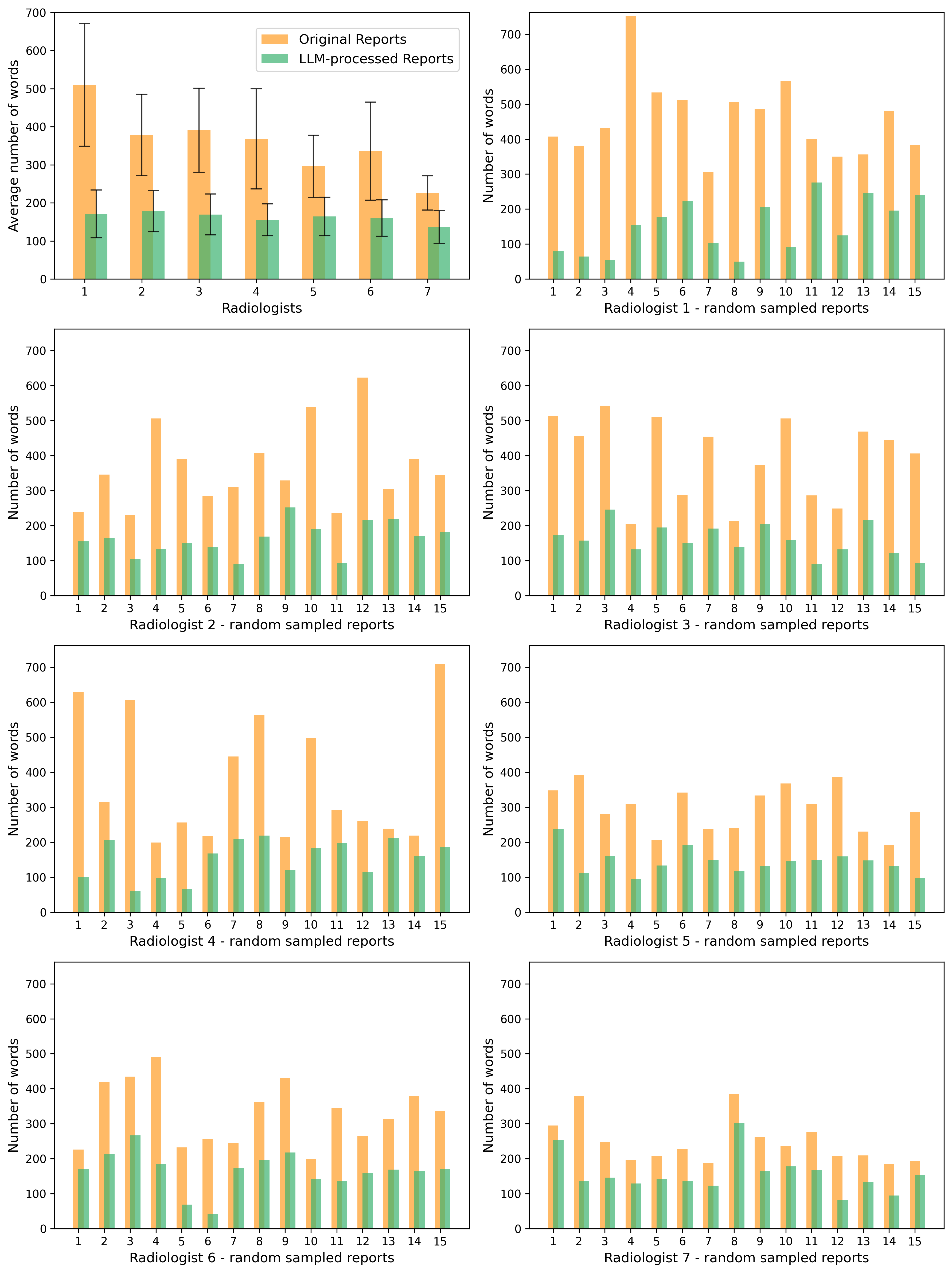

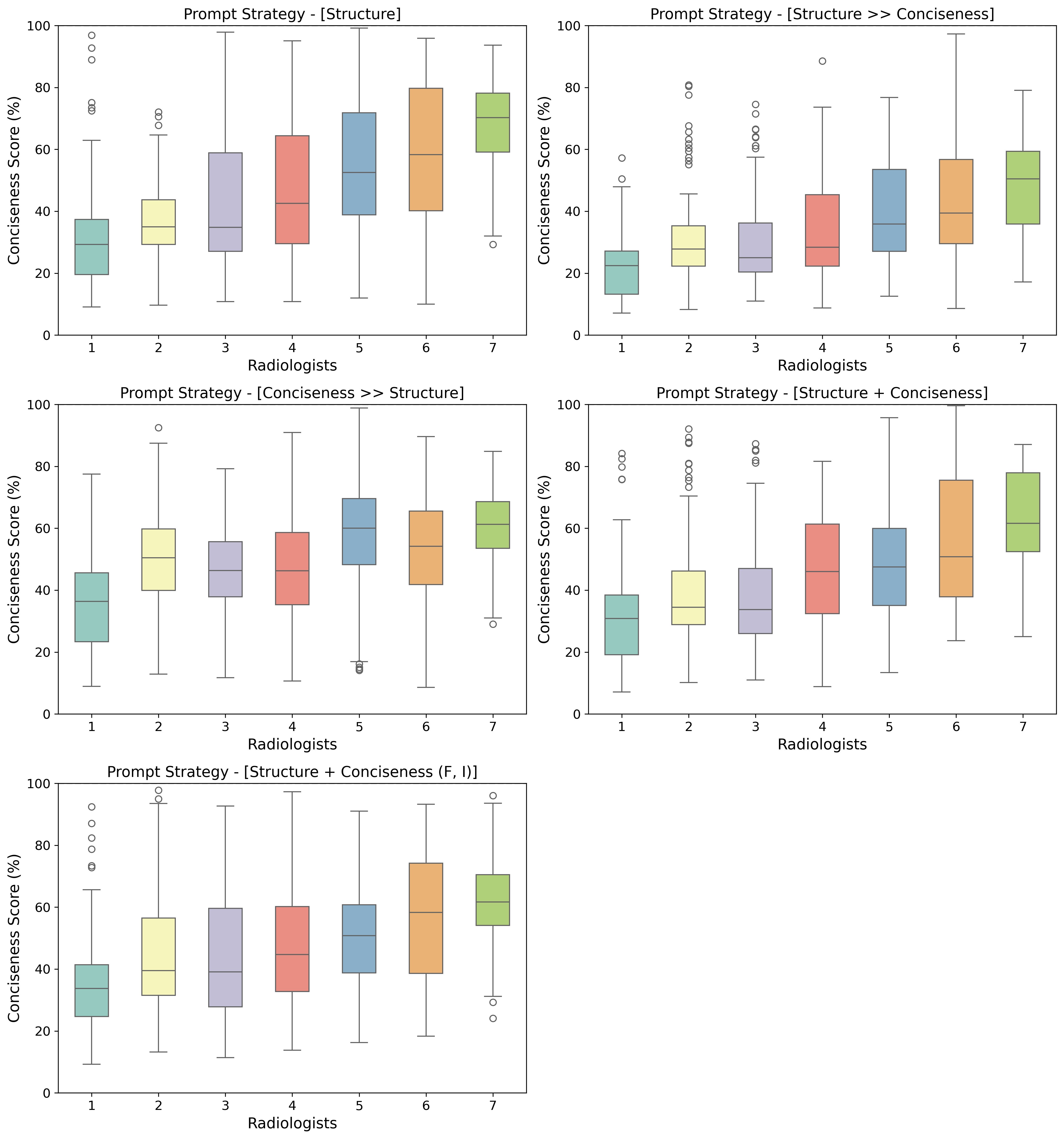

- 实验结果表明,Mixtral LLM在减少冗余字数方面表现出色,平均减少超过53%,显著提升了报告的简洁性和可读性。

📝 摘要(中文)

放射科报告通常冗长且结构松散,这使得转诊医生难以快速识别关键影像学发现,并增加了信息遗漏的风险。本回顾性研究旨在通过使放射科报告简洁且结构良好,并按相关器官组织结果来增强报告。为此,我们利用部署在我们机构防火墙内的私有大语言模型(LLM),以确保数据安全并最大限度地降低计算成本。我们使用了来自莫菲特癌症中心七位委员会认证的身体放射科医生的814份放射科报告的数据集,在LangChain框架内测试了五种提示策略。在评估了几个模型后,Mixtral LLM在格式要求方面表现出优于Llama等替代方案的性能。最佳策略是首先压缩报告,然后根据具体说明应用结构化格式,从而减少冗余并提高清晰度。在所有放射科医生和报告中,Mixtral LLM减少了超过53%的冗余字数。这些发现突出了本地部署的开源LLM在简化放射科报告方面的潜力。通过生成简洁、结构良好的报告,这些模型增强了信息检索,更好地满足了转诊医生的需求,最终改善了临床工作流程。

🔬 方法详解

问题定义:放射科报告的冗长和非结构化是主要问题。现有方法依赖人工编写,效率低且易出错,导致信息检索困难,增加医生负担。报告缺乏统一的结构,使得关键信息难以快速定位,影响诊断效率。

核心思路:利用大语言模型(LLM)的文本生成和理解能力,自动压缩和结构化放射科报告。核心在于通过特定的提示工程(Prompt Engineering),引导LLM按照预定的格式输出,从而提高报告的简洁性和可读性。本地部署保证数据安全和降低计算成本。

技术框架:整体流程包括数据准备、模型选择、提示策略设计、模型评估和结果分析。首先,收集放射科报告数据集。然后,选择合适的LLM(如Mixtral, Llama)并在本地部署。接着,在LangChain框架下,设计不同的提示策略,例如先压缩再结构化。最后,评估模型在简洁性和结构化方面的表现。

关键创新:该研究的关键创新在于探索了本地部署的开源LLM在放射科报告优化中的应用潜力。通过精细设计的提示策略,实现了报告的自动压缩和结构化,显著提高了报告的质量和效率。强调了数据安全和成本控制的重要性,为其他医疗机构提供了可借鉴的方案。

关键设计:研究测试了五种不同的提示策略,最终确定了“先压缩后结构化”的最佳策略。模型选择方面,Mixtral LLM在格式遵循方面优于Llama。数据集包含来自七位放射科医生的814份报告。评估指标主要关注报告的冗余字数减少比例和结构化程度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Mixtral LLM在所有放射科医生和报告中,平均减少了超过53%的冗余字数。该模型在遵循预设格式方面表现出色,优于其他模型,证明了本地部署的开源LLM在简化放射科报告方面的有效性。

🎯 应用场景

该研究成果可应用于医疗影像报告的自动生成和优化,提高放射科医生的工作效率,减少信息遗漏的风险。结构化报告有助于转诊医生快速获取关键信息,提升诊断效率和患者护理质量。未来可扩展到其他类型的医疗文本处理,例如病历摘要、药物说明等。

📄 摘要(原文)

Radiology reports are often lengthy and unstructured, posing challenges for referring physicians to quickly identify critical imaging findings while increasing the risk of missed information. This retrospective study aimed to enhance radiology reports by making them concise and well-structured, with findings organized by relevant organs. To achieve this, we utilized private large language models (LLMs) deployed locally within our institution's firewall, ensuring data security and minimizing computational costs. Using a dataset of 814 radiology reports from seven board-certified body radiologists at Moffitt Cancer Center, we tested five prompting strategies within the LangChain framework. After evaluating several models, the Mixtral LLM demonstrated superior adherence to formatting requirements compared to alternatives like Llama. The optimal strategy involved condensing reports first and then applying structured formatting based on specific instructions, reducing verbosity while improving clarity. Across all radiologists and reports, the Mixtral LLM reduced redundant word counts by more than 53%. These findings highlight the potential of locally deployed, open-source LLMs to streamline radiology reporting. By generating concise, well-structured reports, these models enhance information retrieval and better meet the needs of referring physicians, ultimately improving clinical workflows.