What Really is Commonsense Knowledge?

作者: Quyet V. Do, Junze Li, Tung-Duong Vuong, Zhaowei Wang, Yangqiu Song, Xiaojuan Ma

分类: cs.CL, cs.AI

发布日期: 2024-11-06

备注: Code and data will be released together with the next version of the paper

💡 一句话要点

提出常识知识统一定义,揭示常识QA数据集中的非常识实例问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 常识知识 常识推理 数据集质量 自然语言处理 大型语言模型

📋 核心要点

- 现有常识推理基准测试数据集存在大量非常识知识实例,影响模型常识推理能力的准确评估。

- 论文提出常识知识的统一定义,用于区分常识知识与非常识知识,从而更准确地评估模型。

- 实验表明,CommonsenseQA数据集中存在大量非常识知识实例,LLM在常识知识实例上的表现相对较差。

📝 摘要(中文)

常识数据集在自然语言处理领域得到了很好的发展,主要通过众包人工标注的方式构建。然而,关于常识推理基准测试的真实性存在争议。具体来说,一些常识基准测试中的很大一部分实例并不涉及常识知识。这个问题会削弱对评估模型真正常识推理能力的衡量。有人认为,这个问题源于常识知识概念的模糊,与其他类型的知识区分不明显。为了揭示上述所有问题,本研究调查了现有的常识知识定义,将其归纳为定义概念的三个框架,并将其整合为一个多框架统一的常识知识定义(即所谓的综合定义)。然后,我们使用综合定义对CommonsenseQA和CommonsenseQA 2.0数据集进行注释和实验,以检验上述主张。我们的研究表明,这两个数据集中存在很大一部分非常识知识实例,并且在这两个子集上存在很大的性能差距,其中大型语言模型(LLM)在常识知识实例上的表现更差。

🔬 方法详解

问题定义:论文旨在解决常识推理数据集(如CommonsenseQA)中包含大量非常识知识实例的问题。现有方法的痛点在于,对“常识知识”的定义模糊,导致数据集构建过程中混入了非常识知识,从而影响了模型常识推理能力的评估。

核心思路:论文的核心思路是首先对常识知识进行明确的定义,然后利用该定义对现有数据集进行重新标注,区分常识知识实例和非常识知识实例,最后通过实验验证数据集质量对模型性能的影响。通过明确常识知识的定义,可以更准确地评估模型的常识推理能力。

技术框架:论文的技术框架主要包含三个阶段:1) 常识知识定义阶段:通过调研现有定义,将其归纳为三个框架,并整合为一个统一的定义。2) 数据集标注阶段:利用统一的常识知识定义,对CommonsenseQA和CommonsenseQA 2.0数据集进行重新标注,区分常识知识实例和非常识知识实例。3) 实验验证阶段:在重新标注的数据集上进行实验,比较LLM在常识知识实例和非常识知识实例上的性能差异。

关键创新:论文最重要的技术创新点在于提出了一个多框架统一的常识知识定义,该定义能够更准确地描述常识知识的本质特征,从而为数据集的构建和评估提供更可靠的基础。与现有方法相比,该定义更加全面和细致,能够有效区分常识知识与非常识知识。

关键设计:论文的关键设计在于常识知识的统一定义,具体的技术细节未知,摘要中没有明确说明定义的内容。标注过程和实验设置的具体参数也未知。

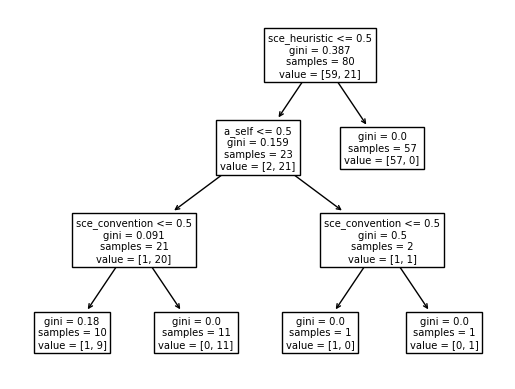

🖼️ 关键图片

📊 实验亮点

实验结果表明,CommonsenseQA和CommonsenseQA 2.0数据集中存在大量非常识知识实例。大型语言模型在常识知识实例上的表现明显低于非常识知识实例,表明现有模型在处理真正的常识推理问题时仍存在不足。具体的性能数据和提升幅度未知。

🎯 应用场景

该研究成果可应用于构建更高质量的常识推理数据集,提升常识推理模型的评估准确性。同时,明确的常识知识定义有助于指导模型的训练,提高模型在实际应用中的常识推理能力,例如在智能问答、对话系统、机器人等领域。

📄 摘要(原文)

Commonsense datasets have been well developed in Natural Language Processing, mainly through crowdsource human annotation. However, there are debates on the genuineness of commonsense reasoning benchmarks. In specific, a significant portion of instances in some commonsense benchmarks do not concern commonsense knowledge. That problem would undermine the measurement of the true commonsense reasoning ability of evaluated models. It is also suggested that the problem originated from a blurry concept of commonsense knowledge, as distinguished from other types of knowledge. To demystify all of the above claims, in this study, we survey existing definitions of commonsense knowledge, ground into the three frameworks for defining concepts, and consolidate them into a multi-framework unified definition of commonsense knowledge (so-called consolidated definition). We then use the consolidated definition for annotations and experiments on the CommonsenseQA and CommonsenseQA 2.0 datasets to examine the above claims. Our study shows that there exists a large portion of non-commonsense-knowledge instances in the two datasets, and a large performance gap on these two subsets where Large Language Models (LLMs) perform worse on commonsense-knowledge instances.