Exploring Large Language Models for Specialist-level Oncology Care

作者: Anil Palepu, Vikram Dhillon, Polly Niravath, Wei-Hung Weng, Preethi Prasad, Khaled Saab, Ryutaro Tanno, Yong Cheng, Hanh Mai, Ethan Burns, Zainub Ajmal, Kavita Kulkarni, Philip Mansfield, Dale Webster, Joelle Barral, Juraj Gottweis, Mike Schaekermann, S. Sara Mahdavi, Vivek Natarajan, Alan Karthikesalingam, Tao Tu

分类: cs.HC, cs.CL

发布日期: 2024-11-05

💡 一句话要点

利用大型语言模型AMIE探索肿瘤专科级别的乳腺癌诊疗辅助

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 乳腺肿瘤 临床决策支持 知识检索 自我批评 医疗人工智能 肿瘤专科 AMIE

📋 核心要点

- 现有大型语言模型在复杂医学场景,特别是肿瘤亚专科的应用潜力未被充分挖掘。

- 论文提出利用AMIE,一个研究型对话式AI系统,结合网络搜索和自我批评机制,辅助乳腺肿瘤诊疗决策。

- 实验表明,AMIE在乳腺癌病例评估中表现优于实习医生和专科医生,但仍不及主治医师。

📝 摘要(中文)

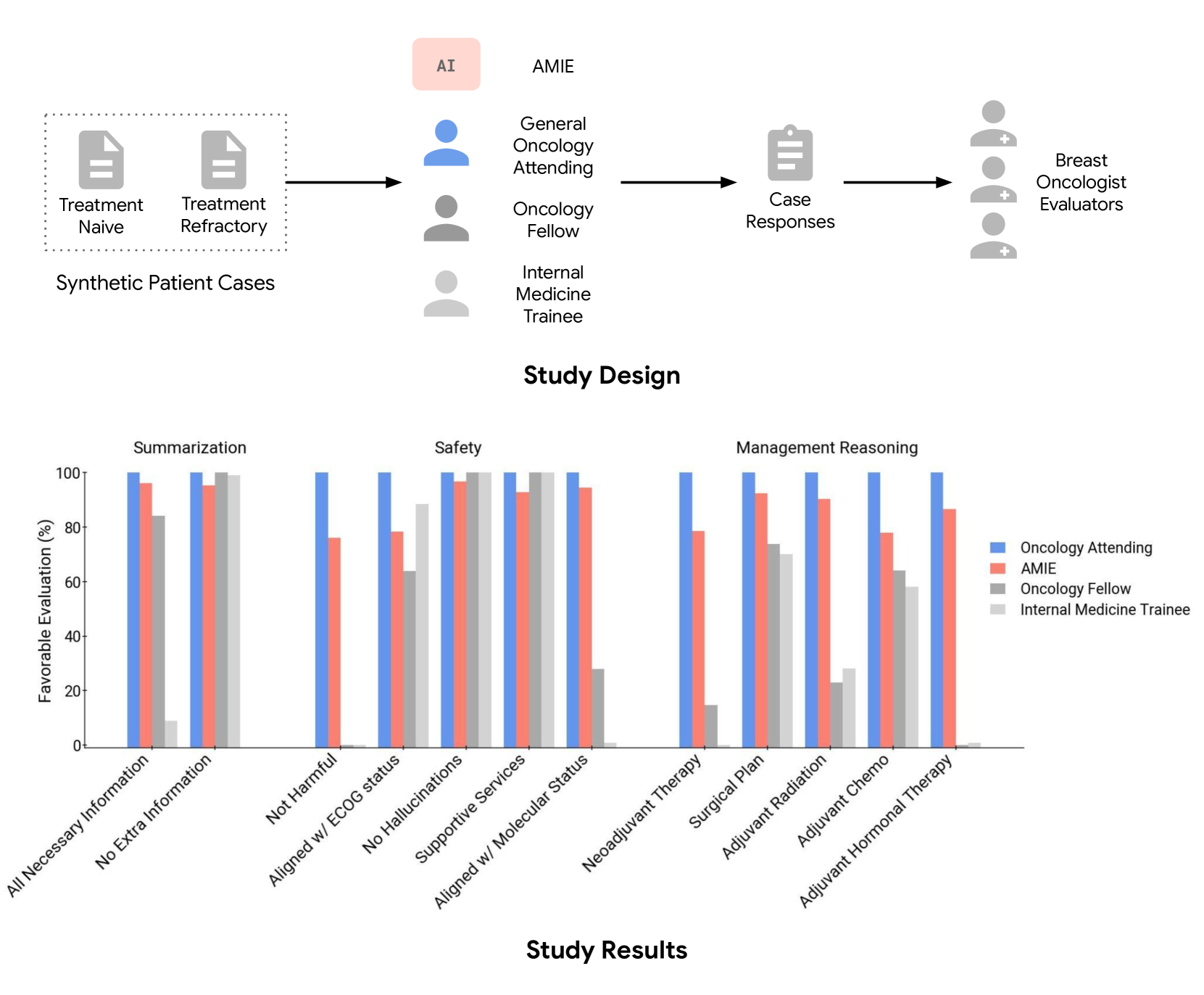

大型语言模型(LLMs)在编码临床知识和以适当的临床推理回应复杂的医学查询方面取得了显著进展。然而,它们在亚专科或复杂医疗环境中的适用性仍未得到充分探索。本文研究了研究型对话式诊断AI系统AMIE在乳腺肿瘤护理亚专科领域的性能,而没有针对这一具有挑战性的领域进行专门的微调。为了进行评估,我们策划了一组50个合成乳腺癌病例,代表了一系列未经治疗和难治性病例,并反映了多学科肿瘤委员会用于决策的关键信息(随本文公开发布)。我们开发了一个详细的临床评估标准来评估管理计划,包括病例总结的质量、拟议护理计划的安全性以及化疗、放疗、手术和激素治疗的建议等维度。为了提高性能,我们增强了AMIE的推理时网络搜索检索能力,以收集相关的最新临床知识,并通过多阶段自我批评流程来改进其响应。我们将AMIE的响应质量与内科实习生、肿瘤科研究员和普通肿瘤科主治医师在自动和专科临床医生评估下进行了比较。在我们的评估中,AMIE的性能优于实习生和研究员,证明了该系统在这个具有挑战性和重要领域中的潜力。我们通过定性示例进一步展示了AMIE等系统如何促进对话式交互以协助临床医生进行决策。然而,AMIE的总体表现不如主治肿瘤医师,这表明在考虑前瞻性用途之前需要进一步研究。

🔬 方法详解

问题定义:论文旨在评估大型语言模型在乳腺肿瘤专科领域的应用潜力,解决现有LLM在处理复杂、专业性强的医学问题时,知识覆盖面不足、推理能力有限的问题。现有方法难以提供高质量的诊疗建议,无法满足专科医生的需求。

核心思路:论文的核心思路是利用AMIE,一个预训练的对话式AI系统,结合外部知识检索和自我批评机制,提升其在乳腺肿瘤诊疗方面的专业能力。通过网络搜索获取最新临床知识,并利用多阶段自我批评流程优化响应,从而提高诊疗建议的准确性和可靠性。

技术框架:整体框架包括以下几个主要模块:1)病例输入:将乳腺癌病例信息输入AMIE;2)知识检索:AMIE利用网络搜索检索相关的最新临床知识;3)诊疗建议生成:AMIE基于病例信息和检索到的知识生成诊疗建议;4)自我批评:AMIE通过多阶段自我批评流程,对生成的诊疗建议进行评估和改进;5)输出:输出最终的诊疗建议。

关键创新:论文的关键创新在于将外部知识检索和自我批评机制融入到AMIE中,使其能够利用最新的临床知识,并不断优化自身的诊疗建议。这种方法有效地提升了AMIE在乳腺肿瘤专科领域的专业能力,使其能够提供更准确、更可靠的诊疗建议。与现有方法相比,该方法能够更好地适应临床实践的需求,提供更具实用价值的辅助决策支持。

关键设计:论文中,多阶段自我批评流程是关键设计之一。该流程包括多个阶段,每个阶段都对AMIE生成的诊疗建议进行评估和改进。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细描述,属于AMIE系统本身的内部实现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AMIE在乳腺癌病例评估中表现优于内科实习生和肿瘤科研究员,但在总体表现上仍不及主治肿瘤医师。这表明AMIE在特定任务上具有潜力,但仍需进一步提升其专业知识和临床推理能力。该研究为大型语言模型在专科医疗领域的应用提供了有价值的参考。

🎯 应用场景

该研究成果可应用于临床辅助决策支持系统,帮助肿瘤科医生制定更精准的诊疗方案,尤其是在资源有限的地区或基层医院。未来,结合患者的基因组数据、影像资料等多模态信息,有望实现更个性化的诊疗方案推荐,提升患者生存率和生活质量。

📄 摘要(原文)

Large language models (LLMs) have shown remarkable progress in encoding clinical knowledge and responding to complex medical queries with appropriate clinical reasoning. However, their applicability in subspecialist or complex medical settings remains underexplored. In this work, we probe the performance of AMIE, a research conversational diagnostic AI system, in the subspecialist domain of breast oncology care without specific fine-tuning to this challenging domain. To perform this evaluation, we curated a set of 50 synthetic breast cancer vignettes representing a range of treatment-naive and treatment-refractory cases and mirroring the key information available to a multidisciplinary tumor board for decision-making (openly released with this work). We developed a detailed clinical rubric for evaluating management plans, including axes such as the quality of case summarization, safety of the proposed care plan, and recommendations for chemotherapy, radiotherapy, surgery and hormonal therapy. To improve performance, we enhanced AMIE with the inference-time ability to perform web search retrieval to gather relevant and up-to-date clinical knowledge and refine its responses with a multi-stage self-critique pipeline. We compare response quality of AMIE with internal medicine trainees, oncology fellows, and general oncology attendings under both automated and specialist clinician evaluations. In our evaluations, AMIE outperformed trainees and fellows demonstrating the potential of the system in this challenging and important domain. We further demonstrate through qualitative examples, how systems such as AMIE might facilitate conversational interactions to assist clinicians in their decision making. However, AMIE's performance was overall inferior to attending oncologists suggesting that further research is needed prior to consideration of prospective uses.