MM-Embed: Universal Multimodal Retrieval with Multimodal LLMs

作者: Sheng-Chieh Lin, Chankyu Lee, Mohammad Shoeybi, Jimmy Lin, Bryan Catanzaro, Wei Ping

分类: cs.CL, cs.AI, cs.CV, cs.IR, cs.LG

发布日期: 2024-11-04 (更新: 2025-02-22)

备注: Accepted at ICLR 2025. We release the model weights at: https://huggingface.co/nvidia/MM-Embed

💡 一句话要点

提出MM-Embed,利用多模态LLM实现通用多模态检索,并在M-BEIR和MTEB上取得SOTA。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态检索 多模态LLM 模态感知 硬负例挖掘 持续学习 信息检索 跨模态学习

📋 核心要点

- 现有检索模型通常只支持单一模态,且检索任务固定,无法满足复杂多模态场景的需求。

- 提出MM-Embed,通过微调多模态LLM,并引入模态感知硬负例挖掘,缓解模态偏差,提升多模态检索能力。

- MM-Embed在M-BEIR和MTEB基准测试中均取得了SOTA性能,验证了其在通用多模态检索方面的有效性。

📝 摘要(中文)

本文提出了一种利用多模态大型语言模型(MLLM)推进信息检索的技术,旨在实现更广泛的搜索场景,即通用多模态检索,该场景支持多种模态和不同的检索任务。首先,研究了在10个数据集上微调MLLM作为双编码器检索器,这些数据集包含16个检索任务。实验结果表明,微调后的MLLM检索器能够理解由文本和图像组成的复杂查询,但在跨模态检索任务中,由于MLLM表现出的模态偏差,其性能不如较小的CLIP检索器。为了解决这个问题,提出了模态感知硬负例挖掘,以减轻MLLM检索器表现出的模态偏差。其次,提出了持续微调通用多模态检索器,以增强其文本检索能力,同时保持多模态检索能力。最终模型MM-Embed在涵盖多个领域和任务的多模态检索基准M-BEIR上实现了最先进的性能,同时也超过了最先进的文本检索模型NV-Embed-v1在MTEB检索基准上的性能。此外,还探索了提示现成的MLLM作为零样本重排序器,以改进多模态检索器候选结果的排序。研究发现,通过提示和重排序,当用户查询(例如,文本-图像组合查询)更复杂且难以理解时,MLLM可以进一步提高多模态检索性能。这些发现也为未来推进通用多模态检索铺平了道路。

🔬 方法详解

问题定义:现有检索模型通常只支持单一模态的查询和检索结果,无法处理复杂的多模态信息检索任务。此外,即使是多模态模型,也往往针对特定任务进行优化,缺乏通用性。MLLM虽然具备强大的多模态理解能力,但直接应用于检索任务时,存在模态偏差问题,导致跨模态检索性能不佳。

核心思路:本文的核心思路是利用MLLM强大的多模态理解能力,通过微调和优化,使其适应通用多模态检索任务。通过模态感知硬负例挖掘来缓解MLLM的模态偏差,并采用持续微调策略,在保持多模态检索能力的同时,提升文本检索性能。

技术框架:MM-Embed的整体框架包含以下几个主要阶段:1) MLLM微调:使用包含多种模态和检索任务的数据集对MLLM进行微调,使其具备初步的多模态检索能力。2) 模态感知硬负例挖掘:针对MLLM的模态偏差,设计模态感知的硬负例挖掘策略,提升模型对不同模态信息的区分能力。3) 持续微调:在文本检索数据集上持续微调模型,增强其文本检索能力,同时保持多模态检索能力。4) 零样本重排序:利用现成的MLLM作为零样本重排序器,对检索结果进行重排序,进一步提升检索精度。

关键创新:本文最重要的技术创新点在于提出了模态感知硬负例挖掘策略,有效缓解了MLLM在多模态检索中存在的模态偏差问题。此外,通过持续微调策略,在提升文本检索能力的同时,保持了多模态检索能力,实现了通用多模态检索。

关键设计:模态感知硬负例挖掘的关键在于选择合适的负例。具体来说,对于一个文本-图像查询,选择与查询文本相似但与图像不相关的负例,以及与查询图像相似但与文本不相关的负例。损失函数采用对比学习损失,通过拉近正例对的距离,推远负例对的距离,来优化模型。持续微调阶段,采用较小的学习率,以避免破坏模型已学习到的多模态知识。

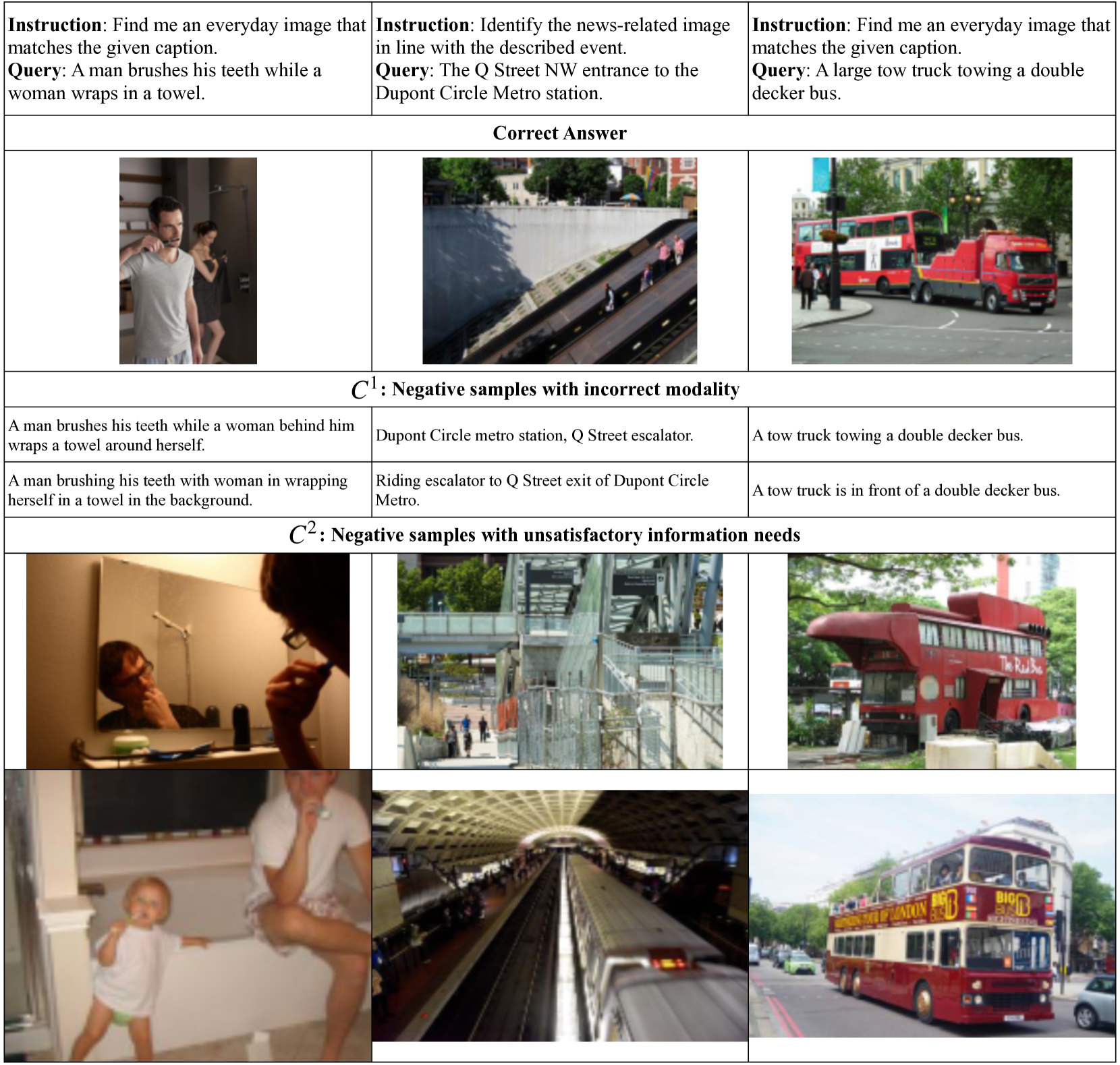

🖼️ 关键图片

📊 实验亮点

MM-Embed在M-BEIR多模态检索基准上取得了SOTA性能,相较于之前的最佳模型有显著提升。同时,在MTEB文本检索基准上,也超越了SOTA文本检索模型NV-Embed-v1。实验结果表明,MM-Embed在通用多模态检索方面具有强大的能力。

🎯 应用场景

MM-Embed可应用于多种场景,例如:电商平台中,用户可以通过上传商品图片和描述文字来搜索相似商品;智能问答系统中,可以根据用户提供的文本和图片信息来回答问题;在信息检索领域,可以实现跨模态的信息检索,例如,用户可以通过文本描述来搜索相关的图片或视频。

📄 摘要(原文)

State-of-the-art retrieval models typically address a straightforward search scenario, in which retrieval tasks are fixed (e.g., finding a passage to answer a specific question) and only a single modality is supported for both queries and retrieved results. This paper introduces techniques for advancing information retrieval with multimodal large language models (MLLMs), enabling a broader search scenario, termed universal multimodal retrieval, where multiple modalities and diverse retrieval tasks are accommodated. To this end, we first study fine-tuning an MLLM as a bi-encoder retriever on 10 datasets with 16 retrieval tasks. Our empirical results show that the fine-tuned MLLM retriever is capable of understanding challenging queries, composed of both text and image, but it underperforms compared to a smaller CLIP retriever in cross-modal retrieval tasks due to the modality bias exhibited by MLLMs. To address the issue, we propose modality-aware hard negative mining to mitigate the modality bias exhibited by MLLM retrievers. Second, we propose continuously fine-tuning the universal multimodal retriever to enhance its text retrieval capability while preserving multimodal retrieval capability. As a result, our model, MM-Embed, achieves state-of-the-art performance on the multimodal retrieval benchmark M-BEIR, which spans multiple domains and tasks, while also surpassing the state-of-the-art text retrieval model, NV-Embed-v1, on the MTEB retrieval benchmark. We also explore prompting the off-the-shelf MLLMs as zero-shot rerankers to refine the ranking of the candidates from the multimodal retriever. We find that, through prompt-and-reranking, MLLMs can further improve multimodal retrieval when the user queries (e.g., text-image composed queries) are more complex and challenging to understand. These findings also pave the way for advancing universal multimodal retrieval in the future.