Improving Scientific Hypothesis Generation with Knowledge Grounded Large Language Models

作者: Guangzhi Xiong, Eric Xie, Amir Hassan Shariatmadari, Sikun Guo, Stefan Bekiranov, Aidong Zhang

分类: cs.CL, cs.AI

发布日期: 2024-11-04

💡 一句话要点

提出KG-CoI框架,通过知识图谱增强大语言模型在科学假设生成中的准确性和可信度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 知识图谱 科学假设生成 幻觉检测 推理链

📋 核心要点

- 大型语言模型在科学假设生成中存在“幻觉”问题,导致生成不准确或误导性的结论。

- KG-CoI通过整合知识图谱的外部知识,引导LLM进行结构化推理,减少幻觉。

- 实验表明,KG-CoI提高了LLM生成假设的准确性,并减少了推理链中的幻觉。

📝 摘要(中文)

大型语言模型(LLMs)在科学领域展现了卓越的能力,但其生成“幻觉”的问题,即输出听起来合理但事实不正确的内容,对需要严格准确性和可验证性的科学领域构成了重大挑战。为了克服这些挑战,我们提出了KG-CoI(Knowledge Grounded Chain of Ideas),一种通过整合来自知识图谱(KGs)的外部结构化知识来增强LLM假设生成的系统。KG-CoI引导LLM进行结构化的推理过程,将其输出组织为思想链(CoI),并包含一个KG支持的模块来检测幻觉。通过在我们新构建的假设生成数据集上进行的实验,我们证明了KG-CoI不仅提高了LLM生成假设的准确性,还减少了其推理链中的幻觉,突出了其在推进现实世界科学研究中的有效性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在科学假设生成过程中产生的“幻觉”问题。现有方法,即直接使用LLM生成假设,容易产生听起来合理但实际上不正确的结论,这在需要高度准确性和可验证性的科学研究中是不可接受的。现有方法的痛点在于缺乏对生成内容的有效约束和事实核查机制,导致LLM自由发散,容易偏离真实知识。

核心思路:论文的核心思路是利用知识图谱(KGs)作为外部知识源,对LLM的推理过程进行引导和约束。通过将LLM的推理过程组织成一个结构化的“思想链”(Chain of Ideas, CoI),并结合KG支持的幻觉检测模块,KG-CoI能够显著提高生成假设的准确性和可信度。这种设计旨在让LLM在已知的知识框架内进行推理,减少其自由发散的可能性。

技术框架:KG-CoI的整体框架包含以下几个主要模块:1) 知识图谱检索模块:根据输入的问题或研究方向,从知识图谱中检索相关的实体和关系。2) 思想链生成模块:利用LLM,在知识图谱信息的引导下,生成一系列相互关联的推理步骤,形成“思想链”。3) 幻觉检测模块:基于知识图谱,对思想链中的每个步骤进行事实核查,识别并纠正可能存在的幻觉。4) 假设生成模块:根据经过验证的思想链,生成最终的科学假设。

关键创新:KG-CoI的关键创新在于将知识图谱与LLM的推理过程紧密结合,实现了一种知识驱动的假设生成方法。与直接使用LLM生成假设的方法相比,KG-CoI能够显著提高生成假设的准确性和可信度。此外,KG-CoI提出的“思想链”概念,为LLM的推理过程提供了一种结构化的组织方式,有助于提高推理的可解释性。

关键设计:在知识图谱检索模块中,论文可能采用了基于实体链接和关系推理的方法,从KG中提取与问题相关的子图。在思想链生成模块中,论文可能使用了prompt engineering技术,设计特定的prompt来引导LLM生成符合要求的推理步骤。在幻觉检测模块中,论文可能使用了基于知识图谱的实体关系验证方法,判断LLM生成的陈述是否与KG中的事实相符。具体的参数设置、损失函数和网络结构等技术细节在论文中可能有所描述,但在此处未知。

🖼️ 关键图片

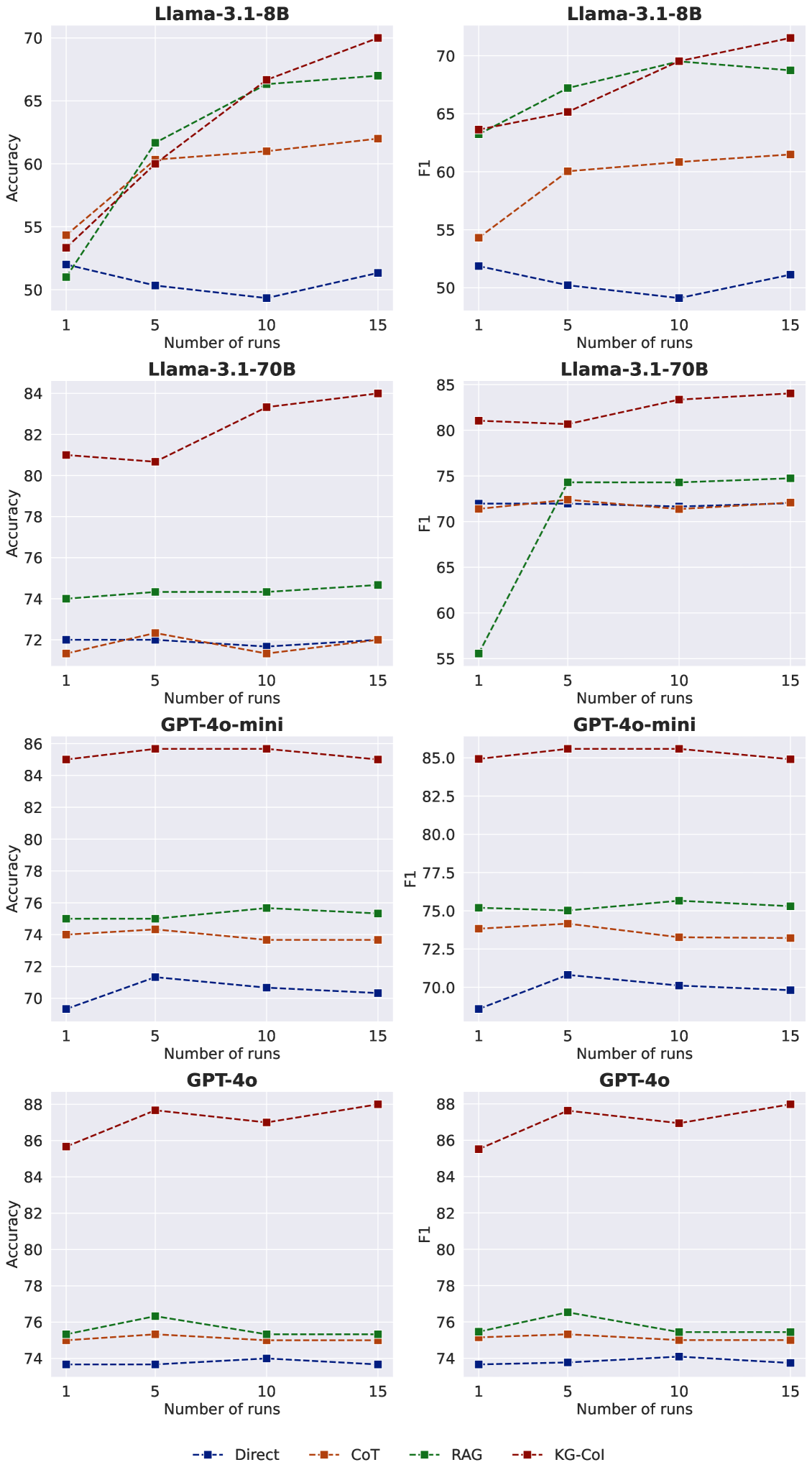

📊 实验亮点

实验结果表明,KG-CoI在假设生成任务中显著优于基线方法。具体而言,KG-CoI不仅提高了生成假设的准确率,还大幅降低了推理链中的幻觉比例。论文构建了一个新的假设生成数据集,为评估相关方法提供了基准。具体的性能数据和提升幅度在论文中有所描述,但在此处未知。

🎯 应用场景

KG-CoI在药物发现、材料科学、生物信息学等领域具有广泛的应用前景。它可以帮助科学家快速生成新的研究假设,加速科学发现的进程。此外,KG-CoI还可以用于辅助文献综述、实验设计等任务,提高科研效率。未来,KG-CoI有望成为科研人员的重要工具,推动科学研究的进步。

📄 摘要(原文)

Large language models (LLMs) have demonstrated remarkable capabilities in various scientific domains, from natural language processing to complex problem-solving tasks. Their ability to understand and generate human-like text has opened up new possibilities for advancing scientific research, enabling tasks such as data analysis, literature review, and even experimental design. One of the most promising applications of LLMs in this context is hypothesis generation, where they can identify novel research directions by analyzing existing knowledge. However, despite their potential, LLMs are prone to generating ``hallucinations'', outputs that are plausible-sounding but factually incorrect. Such a problem presents significant challenges in scientific fields that demand rigorous accuracy and verifiability, potentially leading to erroneous or misleading conclusions. To overcome these challenges, we propose KG-CoI (Knowledge Grounded Chain of Ideas), a novel system that enhances LLM hypothesis generation by integrating external, structured knowledge from knowledge graphs (KGs). KG-CoI guides LLMs through a structured reasoning process, organizing their output as a chain of ideas (CoI), and includes a KG-supported module for the detection of hallucinations. With experiments on our newly constructed hypothesis generation dataset, we demonstrate that KG-CoI not only improves the accuracy of LLM-generated hypotheses but also reduces the hallucination in their reasoning chains, highlighting its effectiveness in advancing real-world scientific research.