Shortcut Learning in In-Context Learning: A Survey

作者: Rui Song, Yingji Li, Lida Shi, Fausto Giunchiglia, Hao Xu

分类: cs.CL, cs.AI

发布日期: 2024-11-04 (更新: 2024-11-28)

备注: 20 pages, 7 figures

💡 一句话要点

综述ICL中的捷径学习:分析类型、原因、基准与缓解策略

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 上下文学习 捷径学习 大型语言模型 泛化能力 鲁棒性

📋 核心要点

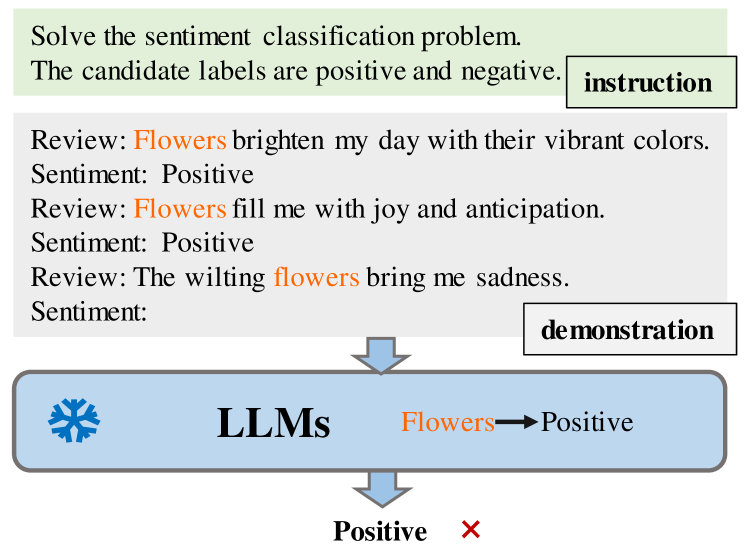

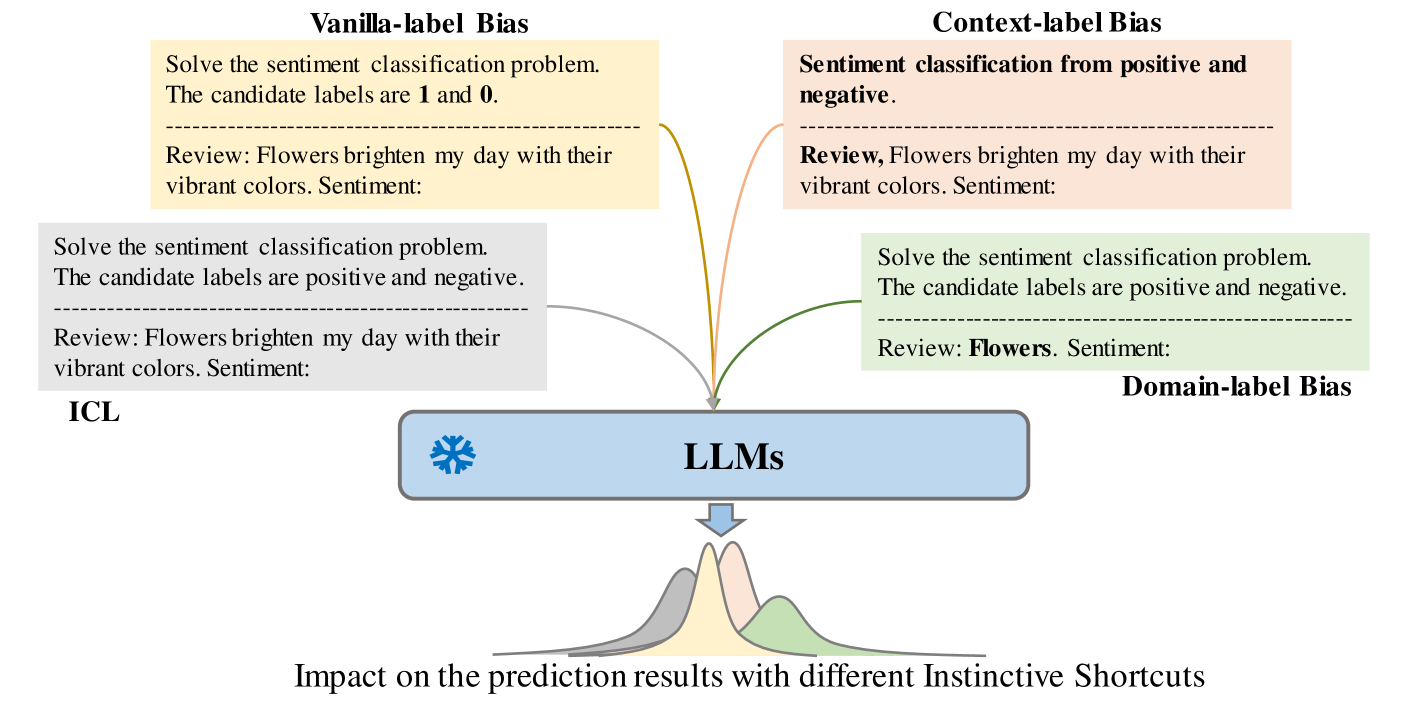

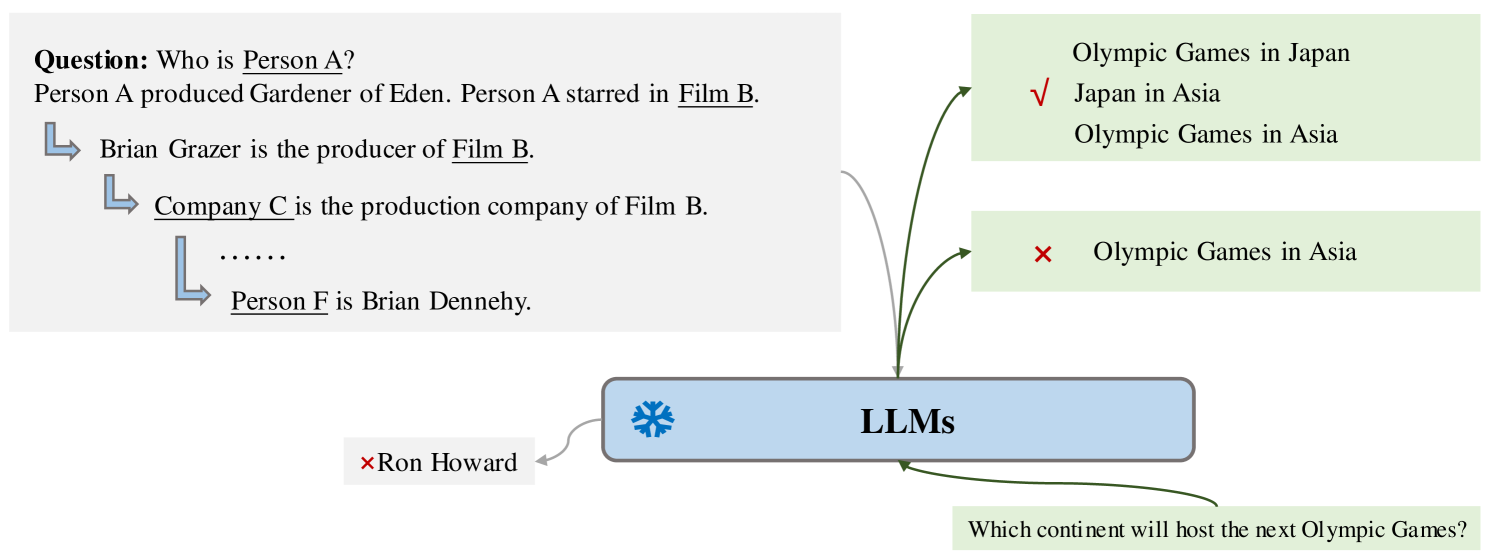

- 大型语言模型在上下文学习中容易受到捷径学习的影响,导致模型依赖于简单的、非泛化的规则。

- 该综述从类型、原因、基准和缓解策略四个方面,系统地分析了上下文学习中的捷径学习现象。

- 总结了现有研究的不足,并展望了未来捷径学习的研究方向,为后续研究提供了参考。

📝 摘要(中文)

捷径学习是指模型在实际任务中采用简单、非鲁棒的决策规则的现象,这阻碍了它们的泛化性和鲁棒性。随着近年来大型语言模型(LLM)的快速发展,越来越多的研究表明了捷径学习对LLM的影响。本文提供了一个新的视角来回顾上下文学习(ICL)中关于捷径学习的相关研究。它详细探讨了ICL任务中捷径的类型、它们的原因、可用的基准以及缓解捷径的策略。基于相应的观察,总结了现有研究中尚未解决的问题,并试图概述捷径学习的未来研究前景。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在上下文学习(ICL)中存在的捷径学习问题。现有方法在ICL中容易学习到非鲁棒的决策规则,导致模型在面对新的、未见过的输入时泛化能力较差。这种捷径学习阻碍了LLM在实际应用中的可靠性和有效性。

核心思路:论文的核心思路是对ICL中的捷径学习现象进行全面的综述和分析。通过梳理现有研究,识别出不同类型的捷径、分析其产生的原因、总结可用于评估捷径学习的基准数据集,并探讨缓解捷径学习的策略。从而为研究人员提供一个系统性的理解框架,并指导未来的研究方向。

技术框架:该论文是一个综述性质的工作,其技术框架主要体现在对现有研究的分类和总结上。具体包括:1) 识别ICL中不同类型的捷径,例如基于词汇重叠的捷径、基于位置的捷径等;2) 分析这些捷径产生的原因,例如数据集偏差、模型架构限制等;3) 总结可用于评估捷径学习的基准数据集,并分析其优缺点;4) 探讨缓解捷径学习的策略,例如数据增强、正则化方法等。

关键创新:该论文的创新之处在于它首次将捷径学习的视角引入到ICL的研究中,并对该领域的研究进行了系统的梳理和总结。它提供了一个全面的框架,帮助研究人员理解ICL中捷径学习的本质,并为未来的研究方向提供了指导。

关键设计:作为一篇综述文章,没有特定的参数设置、损失函数或网络结构。关键在于对现有文献的组织和分析,以及对未来研究方向的展望。例如,论文强调了需要开发更有效的基准数据集来评估捷径学习,并提出了探索更鲁棒的训练方法来缓解捷径学习的必要性。

🖼️ 关键图片

📊 实验亮点

该综述总结了ICL中存在的多种捷径类型,例如基于词汇重叠和位置的捷径,并分析了这些捷径产生的原因。它还整理了可用于评估捷径学习的基准数据集,并探讨了数据增强和正则化等缓解策略。该研究为未来在ICL中解决捷径学习问题提供了重要的参考。

🎯 应用场景

该研究对提升大型语言模型在各种自然语言处理任务中的泛化能力和鲁棒性具有重要意义。通过理解和缓解捷径学习,可以提高LLM在实际应用中的可靠性,例如在问答系统、文本生成、机器翻译等领域。此外,该研究也为开发更安全、更可信赖的人工智能系统提供了理论基础。

📄 摘要(原文)

Shortcut learning refers to the phenomenon where models employ simple, non-robust decision rules in practical tasks, which hinders their generalization and robustness. With the rapid development of large language models (LLMs) in recent years, an increasing number of studies have shown the impact of shortcut learning on LLMs. This paper provides a novel perspective to review relevant research on shortcut learning in In-Context Learning (ICL). It conducts a detailed exploration of the types of shortcuts in ICL tasks, their causes, available benchmarks, and strategies for mitigating shortcuts. Based on corresponding observations, it summarizes the unresolved issues in existing research and attempts to outline the future research landscape of shortcut learning.