Can Language Models Perform Robust Reasoning in Chain-of-thought Prompting with Noisy Rationales?

作者: Zhanke Zhou, Rong Tao, Jianing Zhu, Yiwen Luo, Zengmao Wang, Bo Han

分类: cs.CL, cs.LG

发布日期: 2024-10-31

备注: Accepted by NeurIPS 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出CD-CoT方法,提升大语言模型在噪声推理链提示下的鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 推理链 噪声数据 鲁棒性 对比学习

📋 核心要点

- 现有大语言模型在推理链提示中,易受噪声推理过程的干扰,鲁棒性不足。

- 提出对比去噪方法CD-CoT,通过对比噪声和干净推理链,提升模型去噪能力。

- 实验表明,CD-CoT在NoRa数据集上显著提升模型准确率,平均提升达17.8%。

📝 摘要(中文)

本文研究了大语言模型(LLMs)中一个未被充分探索的挑战:带噪声推理链的提示。这种噪声存在于上下文学习的示例中,包含不相关或不准确的推理过程。我们构建了NoRa数据集,专门用于评估在存在噪声推理的情况下模型的鲁棒性。在NoRa数据集上的实验结果表明,当前LLMs普遍存在对此类噪声的脆弱性,现有的鲁棒方法(如自我纠正和自我一致性)效果有限。与使用干净推理链的提示相比,基础LLM在存在不相关推理时准确率下降1.4%-19.8%,在存在不准确推理时下降2.2%-40.4%。为了应对这一挑战,本文提出了一种对比去噪方法,即CD-CoT,它通过对比噪声推理链和单个干净推理链来增强LLMs的去噪推理能力。该方法遵循探索和利用的原则:(1) 在输入空间中重新措辞和选择推理链,以实现显式去噪;(2) 在输出空间中探索不同的推理路径并对答案进行投票。实验结果表明,CD-CoT的准确率比基础模型平均提高了17.8%,并且比基线方法表现出明显更强的去噪能力。源代码已公开。

🔬 方法详解

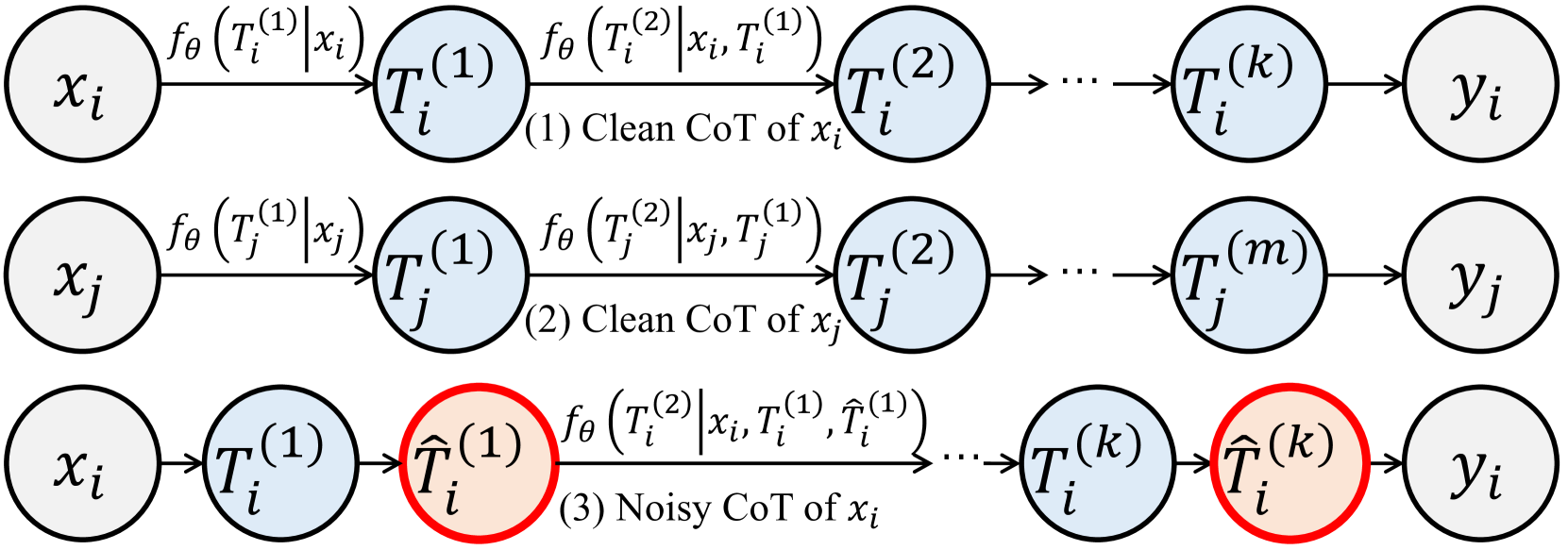

问题定义:论文旨在解决大语言模型在使用链式思考(Chain-of-Thought, CoT)提示时,面对包含噪声(不相关或不准确)的推理过程时,鲁棒性不足的问题。现有方法,如自我纠正和自我一致性,在应对此类噪声时效果有限,模型性能显著下降。

核心思路:论文的核心思路是通过对比学习的方式,让模型学习区分和抑制噪声推理链的影响。具体来说,CD-CoT方法利用少量的干净推理链作为对比的“锚点”,引导模型识别并排除噪声推理链的干扰,从而提升推理的准确性。这种对比学习的思路旨在让模型学习到更可靠的推理模式。

技术框架:CD-CoT方法主要包含两个阶段:(1) 输入空间去噪:通过重新措辞和选择输入中的推理链,显式地减少噪声的影响。这可能涉及到对多个噪声推理链进行筛选,或者生成更清晰的推理链替代原始的噪声链。(2) 输出空间探索:通过探索不同的推理路径并对答案进行投票,来提高答案的可靠性。这类似于集成学习的思想,通过多个模型的投票来减少单个模型出错的概率。

关键创新:CD-CoT的关键创新在于其对比去噪的思路,它不同于以往的自我纠正或自我一致性方法,而是通过引入外部的干净推理链作为对比,更有效地引导模型学习到正确的推理模式。这种对比学习的方式能够更直接地抑制噪声的影响,从而提高模型的鲁棒性。

关键设计:CD-CoT的关键设计包括:(1) 如何选择或生成干净的推理链,这可能需要人工标注或使用高质量的知识库。(2) 如何在输入空间中进行推理链的重措辞和选择,这可能涉及到自然语言处理技术,如文本相似度计算和文本生成。(3) 如何在输出空间中进行推理路径的探索和投票,这可能涉及到集成学习的技术,如模型加权和模型选择。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CD-CoT方法在NoRa数据集上取得了显著的性能提升,平均准确率比基础模型提高了17.8%。与现有的鲁棒方法相比,CD-CoT表现出更强的去噪能力,能够有效地抑制噪声推理链的干扰。这些结果表明,CD-CoT是一种有效的提升大语言模型在噪声环境下推理鲁棒性的方法。

🎯 应用场景

该研究成果可应用于各种需要大语言模型进行复杂推理的场景,例如问答系统、对话系统、智能客服等。通过提高模型在噪声环境下的鲁棒性,可以提升这些应用在实际场景中的可靠性和用户体验。未来,该方法可以进一步扩展到其他类型的噪声数据,并与其他鲁棒性技术相结合,以构建更强大的大语言模型。

📄 摘要(原文)

This paper investigates an under-explored challenge in large language models (LLMs): chain-of-thought prompting with noisy rationales, which include irrelevant or inaccurate reasoning thoughts within examples used for in-context learning. We construct NoRa dataset that is tailored to evaluate the robustness of reasoning in the presence of noisy rationales. Our findings on NoRa dataset reveal a prevalent vulnerability to such noise among current LLMs, with existing robust methods like self-correction and self-consistency showing limited efficacy. Notably, compared to prompting with clean rationales, base LLM drops by 1.4%-19.8% in accuracy with irrelevant thoughts and more drastically by 2.2%-40.4% with inaccurate thoughts. Addressing this challenge necessitates external supervision that should be accessible in practice. Here, we propose the method of contrastive denoising with noisy chain-of-thought (CD-CoT). It enhances LLMs' denoising-reasoning capabilities by contrasting noisy rationales with only one clean rationale, which can be the minimal requirement for denoising-purpose prompting. This method follows a principle of exploration and exploitation: (1) rephrasing and selecting rationales in the input space to achieve explicit denoising and (2) exploring diverse reasoning paths and voting on answers in the output space. Empirically, CD-CoT demonstrates an average improvement of 17.8% in accuracy over the base model and shows significantly stronger denoising capabilities than baseline methods. The source code is publicly available at: https://github.com/tmlr-group/NoisyRationales.