Explainable Behavior Cloning: Teaching Large Language Model Agents through Learning by Demonstration

作者: Yanchu Guan, Dong Wang, Yan Wang, Haiqing Wang, Renen Sun, Chenyi Zhuang, Jinjie Gu, Zhixuan Chu

分类: cs.CL

发布日期: 2024-10-30

备注: 20 pages

💡 一句话要点

提出EBC-LLMAgent,通过模仿学习提升LLM在移动应用交互中的自主性和可解释性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 行为克隆 大型语言模型 移动应用交互 自主代理 可解释性

📋 核心要点

- 移动应用日益复杂,开发能够有效导航和交互的智能代理面临巨大挑战。

- EBC-LLMAgent 结合 LLM 和行为克隆,通过学习演示生成可解释的自主交互代理。

- 实验表明,EBC-LLMAgent 在任务完成、泛化能力和解释生成方面表现出色。

📝 摘要(中文)

本文提出了一种名为可解释行为克隆LLM Agent (EBC-LLMAgent) 的新方法,该方法结合了大型语言模型 (LLMs) 和行为克隆,通过学习演示来创建用于自主移动应用交互的智能且可解释的代理。EBC-LLMAgent 由三个核心模块组成:演示编码、代码生成和 UI 映射,它们协同工作以捕获用户演示、生成可执行代码,并在代码和 UI 元素之间建立准确的对应关系。我们引入了行为克隆链融合技术,以增强代理的泛化能力。在来自不同领域的五个流行的移动应用程序上进行的大量实验表明,EBC-LLMAgent 具有卓越的性能,在任务完成方面实现了高成功率,能够有效地泛化到未见过的场景,并生成有意义的解释。

🔬 方法详解

问题定义:现有方法难以让LLM有效地自主与复杂的移动应用交互,缺乏足够的泛化能力和可解释性,难以适应新的应用场景。因此,需要一种能够学习用户演示、生成可执行代码并提供交互解释的智能代理。

核心思路:EBC-LLMAgent 的核心思路是通过行为克隆,让 LLM 从用户演示中学习交互策略。通过将用户操作转化为可执行代码,并建立代码与 UI 元素的映射关系,实现自主交互。同时,通过链融合技术增强泛化能力,并生成交互过程的解释。

技术框架:EBC-LLMAgent 包含三个主要模块:1) 演示编码:将用户演示转化为 LLM 可以理解的表示;2) 代码生成:根据编码后的演示生成可执行的代码;3) UI 映射:建立代码与 UI 元素之间的对应关系。这三个模块协同工作,实现自主移动应用交互。此外,还使用了行为克隆链融合技术来提升泛化能力。

关键创新:EBC-LLMAgent 的关键创新在于将行为克隆与 LLM 结合,并引入了行为克隆链融合技术。与传统的基于规则或有限状态机的移动应用交互方法相比,EBC-LLMAgent 能够从用户演示中学习,具有更强的泛化能力和适应性。同时,能够生成交互过程的解释,提高了可解释性。

关键设计:演示编码模块的具体实现细节未知,代码生成模块可能使用了某种prompt工程技术来引导LLM生成代码,UI映射模块的具体实现也未知。行为克隆链融合技术的具体实现细节也未知,但推测可能涉及多个行为克隆模型的集成或加权平均。

🖼️ 关键图片

📊 实验亮点

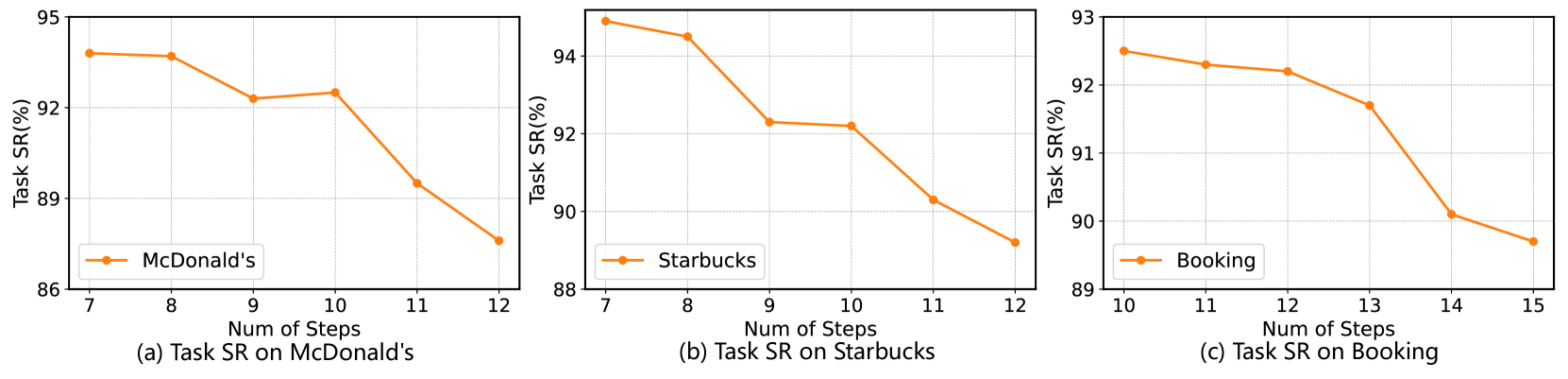

EBC-LLMAgent 在五个流行的移动应用上进行了实验,结果表明其在任务完成方面取得了很高的成功率,并且能够有效地泛化到未见过的场景。此外,EBC-LLMAgent 能够生成有意义的解释,提高了交互的可解释性。具体的性能数据和对比基线在摘要中未提及,因此无法提供更详细的实验亮点。

🎯 应用场景

EBC-LLMAgent 可应用于自动化测试、智能助手、用户行为分析等领域。例如,可以用于自动化测试移动应用的功能,帮助用户自动完成重复性任务,或者分析用户在移动应用中的行为模式,从而优化应用设计和用户体验。该研究有助于提升移动应用交互的智能化水平,并为开发更智能、更易用的移动应用提供技术支持。

📄 摘要(原文)

Autonomous mobile app interaction has become increasingly important with growing complexity of mobile applications. Developing intelligent agents that can effectively navigate and interact with mobile apps remains a significant challenge. In this paper, we propose an Explainable Behavior Cloning LLM Agent (EBC-LLMAgent), a novel approach that combines large language models (LLMs) with behavior cloning by learning demonstrations to create intelligent and explainable agents for autonomous mobile app interaction. EBC-LLMAgent consists of three core modules: Demonstration Encoding, Code Generation, and UI Mapping, which work synergistically to capture user demonstrations, generate executable codes, and establish accurate correspondence between code and UI elements. We introduce the Behavior Cloning Chain Fusion technique to enhance the generalization capabilities of the agent. Extensive experiments on five popular mobile applications from diverse domains demonstrate the superior performance of EBC-LLMAgent, achieving high success rates in task completion, efficient generalization to unseen scenarios, and the generation of meaningful explanations.