Natural Language Inference Improves Compositionality in Vision-Language Models

作者: Paola Cascante-Bonilla, Yu Hou, Yang Trista Cao, Hal Daumé, Rachel Rudinger

分类: cs.CL, cs.CV

发布日期: 2024-10-29

备注: Project page: https://cece-vlm.github.io/

💡 一句话要点

提出CECE方法,利用自然语言推理提升视觉-语言模型中的组合性推理能力

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 组合性推理 自然语言推理 文本扩展 蕴含 矛盾 图像-文本对齐

📋 核心要点

- 现有视觉-语言模型在组合性推理上存在不足,难以准确理解对象、属性和空间关系。

- CECE方法利用自然语言推理生成蕴含和矛盾,扩展文本描述,提升模型对深层语义的理解。

- 实验表明,CECE能有效提升模型性能,在Winoground和EqBen等基准测试上取得了显著的提升。

📝 摘要(中文)

视觉-语言模型(VLMs)在组合性推理方面仍然面临挑战,这些模型通常难以关联对象、属性和空间关系。最近的方法试图通过依赖文本描述的语义来解决这些限制,使用大型语言模型(LLMs)将其分解为问题和答案的子集。然而,这些方法主要在表面层面操作,未能纳入更深层次的词汇理解,同时引入了LLM产生的错误假设。为了解决这些问题,我们提出了一种名为Caption Expansion with Contradictions and Entailments (CECE)的原则性方法,该方法利用自然语言推理(NLI)从给定的前提生成蕴含和矛盾。CECE产生词汇上多样的句子,同时保持其核心含义。通过大量的实验,我们表明CECE增强了解释性,并减少了对有偏见或肤浅特征的过度依赖。通过平衡CECE与原始前提,我们在不需要额外微调的情况下,在评估图像-文本对齐的人工判断一致性的基准测试中取得了显著的改进,并实现了Winoground上+19.2%(组得分)和EqBen上+12.9%(组得分)的性能提升,超过了之前最好的工作(使用目标数据进行微调)。

🔬 方法详解

问题定义:视觉-语言模型在理解组合性概念时面临挑战,例如理解对象之间的关系、属性以及空间位置等。现有方法依赖大型语言模型分解文本描述,但往往停留在表面语义,忽略了深层词汇理解,并且容易引入LLM的错误假设。这些问题导致模型难以进行准确的组合性推理。

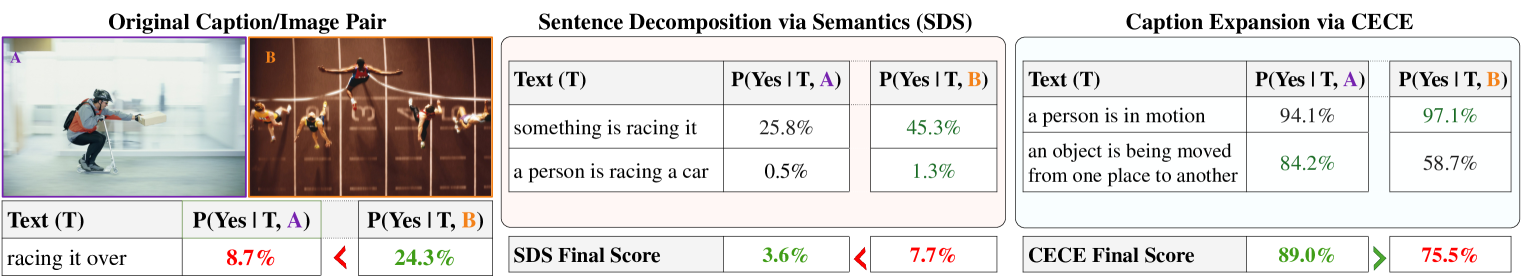

核心思路:CECE的核心思路是利用自然语言推理(NLI)技术,从给定的文本描述(前提)生成蕴含(entailments)和矛盾(contradictions)的句子。通过这种方式,CECE能够扩展原始文本描述,引入更多样化的词汇和表达方式,同时保持核心语义不变。这样可以帮助模型更好地理解文本的深层含义,从而提升组合性推理能力。

技术框架:CECE方法主要包含以下几个阶段:1) 前提输入:输入原始的文本描述(例如,图像的标题)。2) NLI生成:使用自然语言推理模型,基于原始文本生成蕴含和矛盾的句子。3) 文本扩展:将生成的蕴含和矛盾句子与原始文本结合,形成扩展后的文本描述。4) 视觉-语言模型处理:将扩展后的文本描述输入到视觉-语言模型中进行处理,例如进行图像-文本匹配或视觉问答等任务。

关键创新:CECE的关键创新在于利用自然语言推理来生成文本的蕴含和矛盾,从而在不改变核心语义的前提下,扩展了文本的词汇多样性。这与以往依赖大型语言模型直接生成问题和答案的方法不同,CECE更加注重对文本深层语义的理解和利用。此外,CECE不需要额外的微调,可以直接应用于现有的视觉-语言模型,具有较好的通用性。

关键设计:CECE的关键设计包括:1) NLI模型的选择:选择合适的自然语言推理模型至关重要,需要考虑模型的准确性和效率。2) 蕴含和矛盾的平衡:需要平衡蕴含和矛盾句子的数量,以避免引入过多的噪声或偏差。3) 文本扩展策略:需要设计合理的文本扩展策略,例如如何将生成的句子与原始文本结合,以及如何控制扩展后的文本长度。

🖼️ 关键图片

📊 实验亮点

CECE方法在多个基准测试中取得了显著的性能提升。在Winoground上,CECE的组得分提升了19.2%,在EqBen上提升了12.9%,超过了之前最好的方法(使用目标数据进行微调)。这些结果表明,CECE能够有效提升视觉-语言模型的组合性推理能力,并且具有较好的泛化性能。

🎯 应用场景

CECE方法可应用于多种视觉-语言任务,例如图像-文本检索、视觉问答、图像描述生成等。该方法能够提升模型对复杂场景和细粒度语义的理解能力,具有广泛的应用前景。未来,该方法还可以应用于机器人导航、自动驾驶等领域,帮助机器人更好地理解人类指令和周围环境。

📄 摘要(原文)

Compositional reasoning in Vision-Language Models (VLMs) remains challenging as these models often struggle to relate objects, attributes, and spatial relationships. Recent methods aim to address these limitations by relying on the semantics of the textual description, using Large Language Models (LLMs) to break them down into subsets of questions and answers. However, these methods primarily operate on the surface level, failing to incorporate deeper lexical understanding while introducing incorrect assumptions generated by the LLM. In response to these issues, we present Caption Expansion with Contradictions and Entailments (CECE), a principled approach that leverages Natural Language Inference (NLI) to generate entailments and contradictions from a given premise. CECE produces lexically diverse sentences while maintaining their core meaning. Through extensive experiments, we show that CECE enhances interpretability and reduces overreliance on biased or superficial features. By balancing CECE along the original premise, we achieve significant improvements over previous methods without requiring additional fine-tuning, producing state-of-the-art results on benchmarks that score agreement with human judgments for image-text alignment, and achieving an increase in performance on Winoground of +19.2% (group score) and +12.9% on EqBen (group score) over the best prior work (finetuned with targeted data).