ProMQA: Question Answering Dataset for Multimodal Procedural Activity Understanding

作者: Kimihiro Hasegawa, Wiradee Imrattanatrai, Zhi-Qi Cheng, Masaki Asada, Susan Holm, Yuran Wang, Ken Fukuda, Teruko Mitamura

分类: cs.CL

发布日期: 2024-10-29 (更新: 2025-11-04)

备注: NAACL2025, Code and Data: https://github.com/kimihiroh/promqa

💡 一句话要点

提出ProMQA多模态问答数据集,用于评估程序性活动理解能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态问答 程序性活动理解 数据集构建 人机协作 大型语言模型

📋 核心要点

- 现有系统在程序性活动理解方面通常在动作识别等传统分类任务上评估,缺乏面向实际应用场景的评估。

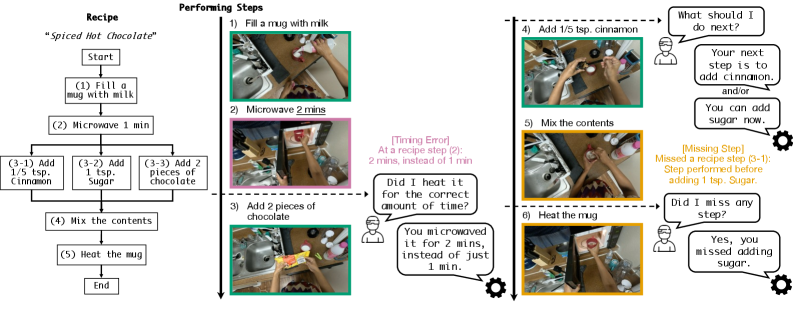

- ProMQA数据集通过多模态问答对,结合用户活动记录和指令,更贴近实际应用场景,评估系统理解能力。

- 实验结果表明,现有模型在ProMQA数据集上的表现与人类水平差距较大,突显了多模态理解的挑战。

📝 摘要(中文)

本文提出了一个新的评估数据集ProMQA,用于衡量系统在面向应用的场景中,理解程序性活动的能力。ProMQA包含401个多模态程序性问答对,这些问答对基于用户记录的程序性活动(如烹饪)及其对应的指令/食谱。问答标注采用了一种经济高效的人工-LLM协作方法,即先利用LLM生成问答对,然后由人工进行验证。论文提供了基准测试结果,以设定ProMQA上的基线性能。实验表明,包括有竞争力的专有多模态模型在内,当前系统的性能与人类水平之间存在显著差距。该数据集旨在揭示模型多模态理解能力的新方面。

🔬 方法详解

问题定义:论文旨在解决多模态程序性活动理解的评估问题。现有方法主要集中在动作识别和时间动作分割等任务上,缺乏针对实际应用场景,例如辅助用户完成烹饪等任务的评估。现有数据集和评估方法无法充分衡量模型在理解和推理程序性活动方面的能力,尤其是在结合视觉信息和文本指令的情况下。

核心思路:论文的核心思路是构建一个多模态问答数据集,该数据集包含用户执行程序性活动(如烹饪)的视频记录,以及相应的文本指令(如食谱)。通过设计与这些活动相关的问答对,可以更全面地评估模型对程序性活动的理解能力。这种问答形式能够促使模型进行更深层次的推理和理解,而不仅仅是简单的分类或分割。

技术框架:ProMQA数据集的构建流程主要包括以下几个阶段:1) 收集用户执行程序性活动的视频记录和相应的文本指令;2) 利用大型语言模型(LLM)生成与这些活动相关的问答对;3) 由人工专家对LLM生成的问答对进行验证和修正,确保问答的准确性和相关性;4) 将最终的问答对与视频和文本指令进行关联,构建成完整的多模态数据集。

关键创新:ProMQA数据集的关键创新在于其面向应用的场景设计和问答对的构建方法。与以往的数据集相比,ProMQA更注重评估模型在实际应用中的表现,例如在辅助用户完成特定任务时的理解能力。此外,采用人工-LLM协作的标注方法,既提高了标注效率,又保证了标注质量。

关键设计:在问答对的设计上,ProMQA涵盖了多种类型的问题,例如关于活动步骤、所需材料、操作方法等。这些问题旨在考察模型对程序性活动的各个方面的理解能力。此外,数据集还包含了负样本,即不正确的答案,以提高模型的鲁棒性。在基线模型的选择上,论文选择了具有竞争力的专有多模态模型,以更全面地评估ProMQA的难度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是目前最先进的多模态模型,在ProMQA数据集上的表现也远低于人类水平,这突显了多模态程序性活动理解的挑战性。该数据集为未来的研究提供了一个有价值的基准,并鼓励开发更强大的多模态理解模型。

🎯 应用场景

该研究成果可应用于开发智能助手,辅助用户完成各种程序性活动,如烹饪、维修、组装等。通过理解用户的操作和指令,智能助手可以提供实时的指导和建议,提高效率和安全性。未来,该数据集可以促进多模态理解和推理技术的发展,推动人机协作的智能化。

📄 摘要(原文)

Multimodal systems have great potential to assist humans in procedural activities, where people follow instructions to achieve their goals. Despite diverse application scenarios, systems are typically evaluated on traditional classification tasks, e.g., action recognition or temporal action segmentation. In this paper, we present a novel evaluation dataset, ProMQA, to measure system advancements in application-oriented scenarios. ProMQA consists of 401 multimodal procedural QA pairs on user recording of procedural activities, i.e., cooking, coupled with their corresponding instructions/recipes. For QA annotation, we take a cost-effective human-LLM collaborative approach, where the existing annotation is augmented with LLM-generated QA pairs that are later verified by humans. We then provide the benchmark results to set the baseline performance on ProMQA. Our experiment reveals a significant gap between human performance and that of current systems, including competitive proprietary multimodal models. We hope our dataset sheds light on new aspects of models' multimodal understanding capabilities.