Can Machines Think Like Humans? A Behavioral Evaluation of LLM Agents in Dictator Games

作者: Ji Ma

分类: cs.CL, cs.AI, cs.CY, cs.LG, econ.GN

发布日期: 2024-10-28 (更新: 2025-11-17)

💡 一句话要点

评估大型语言模型在独裁者游戏中的亲社会行为

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 亲社会行为 独裁者游戏 人机交互 社会科学

📋 核心要点

- 现有研究对LLM代理在亲社会行为方面的理解不足,尤其是在与人类行为的比较上存在挑战。

- 论文通过引入社会科学方法,探讨不同角色和实验框架如何影响LLM代理在独裁者游戏中的行为。

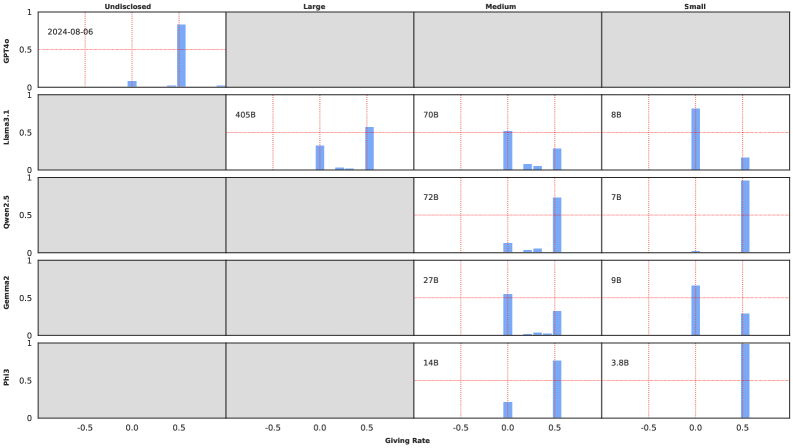

- 实验结果显示,LLM代理的行为与人类行为的对齐程度因模型架构和提示设计而异,且没有明确的规律可循。

📝 摘要(中文)

随着基于大型语言模型(LLM)的代理越来越多地与人类社会互动,我们对其亲社会行为的理解也愈加重要。本文研究了不同角色如何影响LLM代理的亲社会行为,并与人类行为进行了基准比较。研究发现,仅仅赋予LLM人类身份并不能产生人类般的行为,且其决策与人类行为的对齐程度在不同模型架构和提示设计中存在显著差异。这些发现表明,亲社会人工智能的研究在社会科学中具有重要的现实意义。

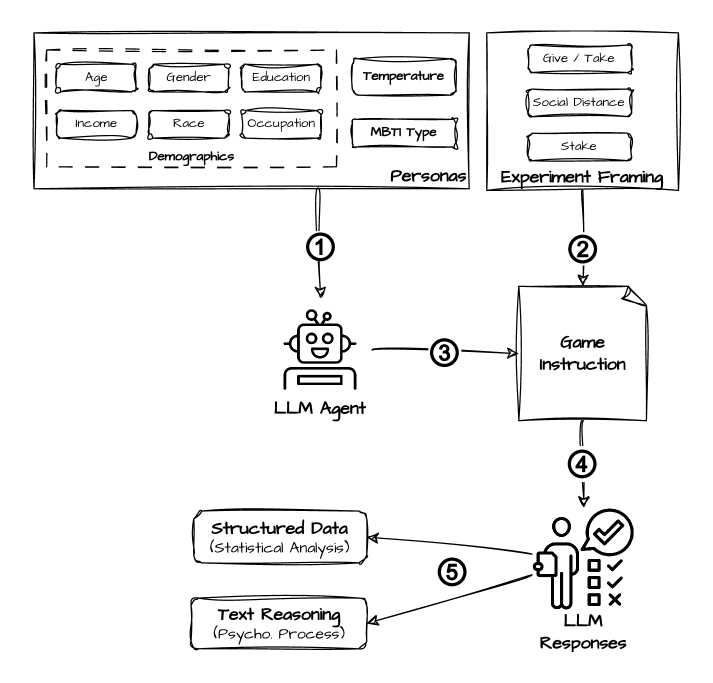

🔬 方法详解

问题定义:本文旨在解决如何评估LLM代理在亲社会行为方面的表现,现有方法未能有效揭示其与人类行为的关系。

核心思路:通过不同角色的赋予和实验框架的设计,探讨其对LLM代理在独裁者游戏中行为的影响,进而评估其决策过程。

技术框架:研究采用了多种LLM模型,设计了不同的实验场景,比较了LLM代理与人类参与者在独裁者游戏中的表现。主要模块包括角色赋予、行为评估和结果分析。

关键创新:论文的创新在于引入社会科学的视角来评估LLM代理的决策行为,揭示了其与人类行为之间的复杂关系。

关键设计:在实验中,设置了多种角色和提示,采用了定量和定性的评估方法,确保了对行为的全面分析。

🖼️ 关键图片

📊 实验亮点

实验结果显示,赋予人类身份的LLM代理并未表现出与人类相似的亲社会行为,其行为的对齐程度在不同模型架构和提示设计中存在显著差异,且未遵循明确的模式。这一发现为未来的亲社会AI研究提供了重要的启示。

🎯 应用场景

该研究为理解和设计更具亲社会行为的人工智能系统提供了理论基础,尤其在社会服务、教育和人机交互等领域具有重要的应用潜力。未来,随着机器智能的普及,推动亲社会人工智能的研究将有助于构建更和谐的人机社会。

📄 摘要(原文)

As Large Language Model (LLM)-based agents increasingly engage with human society, how well do we understand their prosocial behaviors? We (1) investigate how LLM agents' prosocial behaviors can be induced by different personas and benchmarked against human behaviors; and (2) introduce a social science approach to evaluate LLM agents' decision-making. We explored how different personas and experimental framings affect these AI agents' altruistic behavior in dictator games and compared their behaviors within the same LLM family, across various families, and with human behaviors. The findings reveal that merely assigning a human-like identity to LLMs does not produce human-like behaviors. These findings suggest that LLM agents' reasoning does not consistently exhibit textual markers of human decision-making in dictator games and that their alignment with human behavior varies substantially across model architectures and prompt formulations; even worse, such dependence does not follow a clear pattern. As society increasingly integrates machine intelligence, "Prosocial AI" emerges as a promising and urgent research direction in philanthropic studies.