AgentSense: Benchmarking Social Intelligence of Language Agents through Interactive Scenarios

作者: Xinyi Mou, Jingcong Liang, Jiayu Lin, Xinnong Zhang, Xiawei Liu, Shiyue Yang, Rong Ye, Lei Chen, Haoyu Kuang, Xuanjing Huang, Zhongyu Wei

分类: cs.CL, cs.CY

发布日期: 2024-10-25 (更新: 2024-11-23)

🔗 代码/项目: GITHUB

💡 一句话要点

AgentSense:通过交互式场景评估语言智能体的社会智能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社会智能 语言智能体 基准测试 交互式场景 大型语言模型

📋 核心要点

- 现有方法在评估LLM的社会智能时,面临场景多样性不足、复杂度有限以及缺乏多角度评估的挑战。

- AgentSense借鉴戏剧理论,自下而上构建了包含1225个社会场景的基准,用于多轮交互中评估智能体的目标完成和隐式推理能力。

- 实验结果表明,LLM在复杂社会场景中,尤其是在高层次需求方面表现不足,私有信息推理能力仍有待提高。

📝 摘要(中文)

大型语言模型(LLMs)越来越多地被用于赋能自主智能体,以在行为研究的各个领域模拟人类。然而,评估它们驾驭复杂社会交互的能力仍然是一个挑战。以往的研究由于场景多样性、复杂性和单一视角关注的不足而面临局限性。为此,我们引入了AgentSense:通过交互式场景评估语言智能体的社会智能。AgentSense借鉴了戏剧理论,采用自下而上的方法,从大量的剧本中构建了1225个不同的社会场景。我们通过多轮交互评估LLM驱动的智能体,强调目标完成和隐式推理。我们使用ERG理论分析目标,并进行全面的实验。我们的研究结果表明,LLM在复杂的社会场景中难以实现目标,尤其是在高层次的成长需求方面,即使是GPT-4o在私有信息推理方面也需要改进。

🔬 方法详解

问题定义:现有评估语言智能体社会智能的方法,在场景多样性、复杂度和评估视角上存在局限性。缺乏一个全面、细致的基准来衡量智能体在复杂社会互动中的表现,尤其是在涉及隐式推理和高层次目标时。以往研究往往侧重于单一视角,难以捕捉社会互动的复杂性。

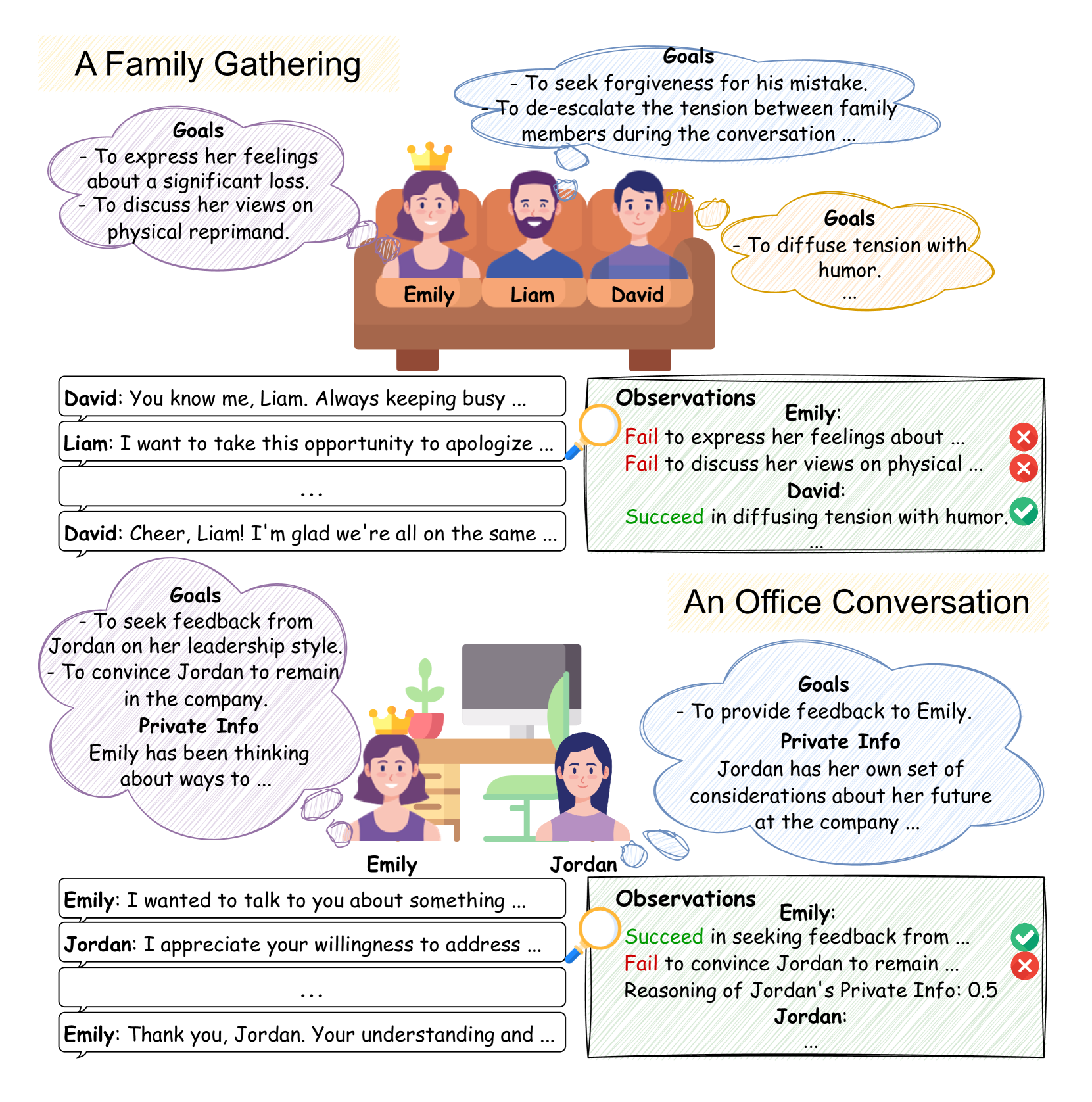

核心思路:AgentSense的核心思路是构建一个更全面、更复杂的社会互动场景基准,并从多角度评估语言智能体的社会智能。借鉴戏剧理论,将社会互动分解为多个角色和场景,并强调智能体在多轮交互中的目标完成情况和隐式推理能力。通过自下而上的方式,从大量剧本中提取和构建场景,保证了场景的多样性和真实性。

技术框架:AgentSense的整体框架包括以下几个主要模块:1) 场景构建模块:基于戏剧理论,从大量剧本中提取和构建1225个不同的社会场景。2) 智能体交互模块:允许LLM驱动的智能体在构建的场景中进行多轮交互。3) 目标分析模块:使用ERG理论分析智能体的目标,并评估其目标完成情况。4) 评估模块:从多个角度评估智能体的社会智能,包括目标完成情况、隐式推理能力和私有信息处理能力。

关键创新:AgentSense的关键创新在于:1) 场景构建方法:采用自下而上的方法,从大量剧本中构建场景,保证了场景的多样性和真实性。2) 评估框架:从多角度评估智能体的社会智能,包括目标完成情况、隐式推理能力和私有信息处理能力。3) 目标分析方法:使用ERG理论分析智能体的目标,并评估其目标完成情况。

关键设计:AgentSense的关键设计包括:1) 场景多样性:构建了1225个不同的社会场景,涵盖了各种社会互动类型。2) 多轮交互:允许智能体在场景中进行多轮交互,模拟真实的社会互动过程。3) ERG理论应用:使用ERG理论分析智能体的目标,并评估其目标完成情况。4) 评估指标:设计了多个评估指标,从不同角度评估智能体的社会智能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM在复杂的社会场景中难以实现目标,尤其是在高层次的成长需求方面。即使是GPT-4o在私有信息推理方面也需要改进。具体而言,在某些场景下,LLM的目标完成率低于人类水平,表明其在社会智能方面仍有很大的提升空间。AgentSense为评估和改进LLM的社会智能提供了一个有价值的基准。

🎯 应用场景

AgentSense的研究成果可应用于开发更具社会智能的AI助手、社交机器人和虚拟角色。通过提高AI在复杂社会互动中的理解和推理能力,可以改善人机交互体验,并促进AI在教育、医疗和社会服务等领域的应用。此外,该基准还可以用于评估和改进LLM的社会推理能力,推动通用人工智能的发展。

📄 摘要(原文)

Large language models (LLMs) are increasingly leveraged to empower autonomous agents to simulate human beings in various fields of behavioral research. However, evaluating their capacity to navigate complex social interactions remains a challenge. Previous studies face limitations due to insufficient scenario diversity, complexity, and a single-perspective focus. To this end, we introduce AgentSense: Benchmarking Social Intelligence of Language Agents through Interactive Scenarios. Drawing on Dramaturgical Theory, AgentSense employs a bottom-up approach to create 1,225 diverse social scenarios constructed from extensive scripts. We evaluate LLM-driven agents through multi-turn interactions, emphasizing both goal completion and implicit reasoning. We analyze goals using ERG theory and conduct comprehensive experiments. Our findings highlight that LLMs struggle with goals in complex social scenarios, especially high-level growth needs, and even GPT-4o requires improvement in private information reasoning. Code and data are available at \url{https://github.com/ljcleo/agent_sense}.