Exploring Forgetting in Large Language Model Pre-Training

作者: Chonghua Liao, Ruobing Xie, Xingwu Sun, Haowen Sun, Zhanhui Kang

分类: cs.CL

发布日期: 2024-10-22

💡 一句话要点

探索大型语言模型预训练阶段的遗忘现象及缓解方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 预训练 灾难性遗忘 知识保留 评估指标

📋 核心要点

- 大型语言模型预训练中存在灾难性遗忘问题,但现有研究主要集中在微调阶段,缺乏对预训练阶段遗忘现象的系统性研究。

- 论文通过修正遗忘评估指标,引入新指标检测实体记忆保留,并探索低成本方法缓解预训练阶段的遗忘,深入分析学习曲线。

- 实验评估表明,论文提出的方法能够有效检测并缓解预训练阶段的遗忘问题,为未来LLM研究提供参考。

📝 摘要(中文)

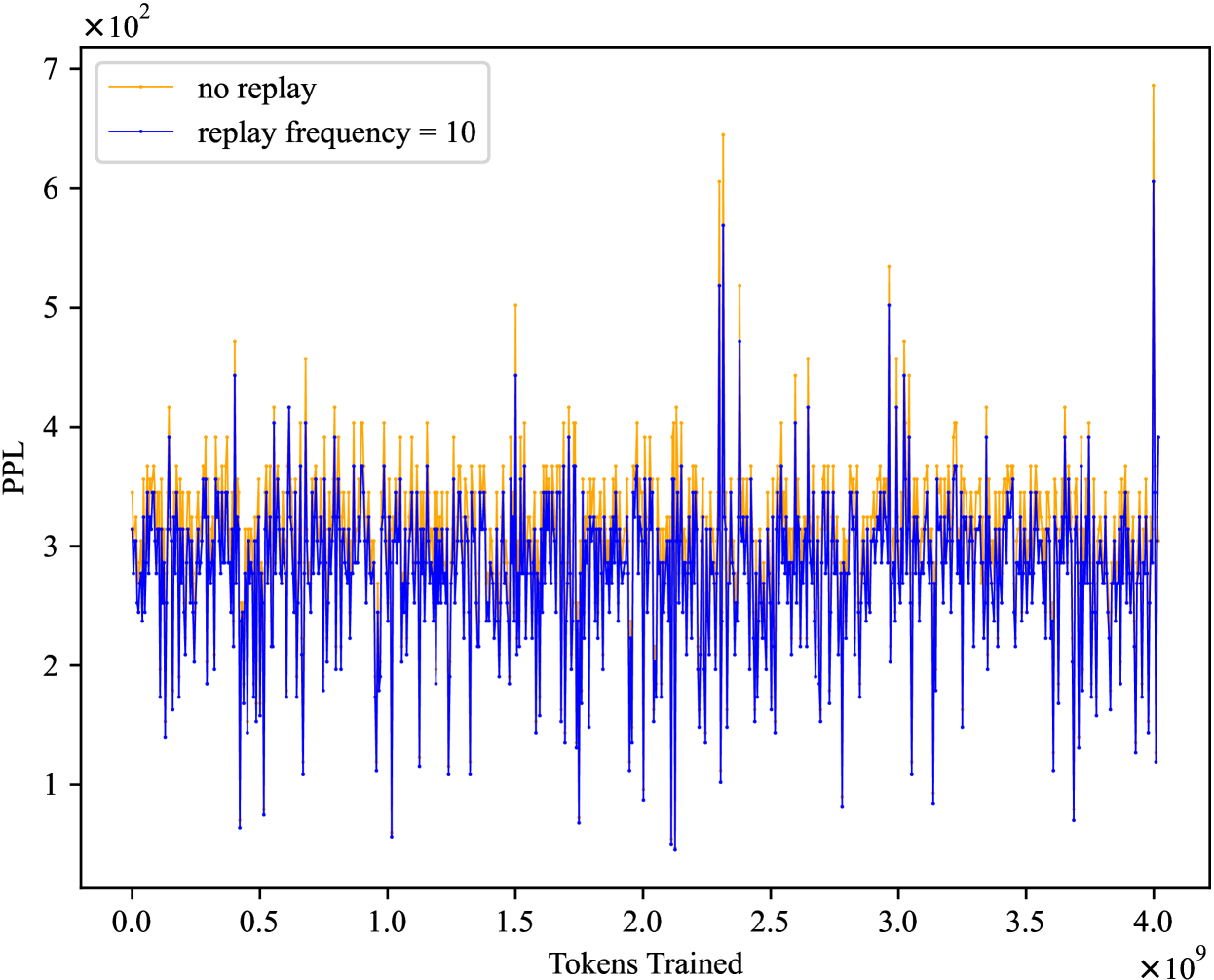

灾难性遗忘仍然是构建大型语言模型(LLM)全知模型的一大障碍。尽管在LLM微调中关于任务级别遗忘的研究已经取得了一些进展,但对预训练期间的遗忘关注甚少。本文系统地探索了预训练中遗忘现象的存在和测量方法,质疑了传统的困惑度(PPL)等指标,并引入了新的指标来更好地检测实体记忆的保留情况。基于对遗忘指标的修正评估,探索了低成本、直接的方法来缓解预训练阶段的遗忘。此外,仔细分析了学习曲线,提供了对遗忘动态的深入了解。对预训练遗忘的广泛评估和分析可以促进未来对LLM的研究。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在预训练阶段出现的灾难性遗忘问题。现有方法主要关注微调阶段的遗忘,忽略了预训练阶段的遗忘现象。传统的困惑度(PPL)等指标无法准确反映模型对特定实体记忆的遗忘程度,导致无法有效评估和缓解预训练过程中的遗忘。

核心思路:论文的核心思路是重新审视和改进遗忘的评估指标,使其能够更准确地反映模型对特定知识的遗忘程度。在此基础上,探索低成本的策略来缓解预训练过程中的遗忘,并深入分析学习曲线,理解遗忘发生的动态过程。通过更精确的评估和针对性的缓解策略,提升模型在预训练阶段的知识保留能力。

技术框架:论文的研究框架主要包含三个部分:1) 重新评估和修正遗忘的评估指标,引入新的指标来更准确地检测实体记忆的保留情况;2) 探索低成本、直接的方法来缓解预训练阶段的遗忘,例如通过特定的数据增强或训练策略;3) 仔细分析学习曲线,观察模型在训练过程中遗忘发生的动态变化,从而更好地理解遗忘的本质。

关键创新:论文的关键创新在于:1) 提出了更有效的遗忘评估指标,能够更准确地反映模型对特定实体记忆的遗忘程度,克服了传统困惑度指标的局限性;2) 探索了低成本的遗忘缓解策略,能够在不显著增加计算资源的情况下,有效提升模型在预训练阶段的知识保留能力;3) 对学习曲线的深入分析,揭示了遗忘发生的动态过程,为理解和缓解遗忘提供了新的视角。

关键设计:论文的关键设计可能包括:1) 新的遗忘评估指标的具体计算方法,例如如何选择和构建用于评估的实体集合,以及如何量化模型对这些实体的记忆程度;2) 低成本遗忘缓解策略的具体实现方式,例如采用何种数据增强方法或训练策略;3) 学习曲线分析的具体方法,例如如何选择合适的指标来观察遗忘的动态变化,以及如何从学习曲线中提取有用的信息。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了传统困惑度指标在评估预训练遗忘方面的局限性,并证明了新提出的遗忘评估指标的有效性。实验结果表明,采用低成本的遗忘缓解策略可以显著提升模型在预训练阶段的知识保留能力,具体性能提升幅度未知,但为后续研究提供了有价值的参考。

🎯 应用场景

该研究成果可应用于提升大型语言模型的知识保留能力,尤其是在需要长期记忆和持续学习的场景下,例如智能助手、知识图谱构建、信息检索等领域。通过缓解预训练阶段的遗忘,可以提高模型在下游任务中的性能和泛化能力,减少对大量标注数据的依赖。

📄 摘要(原文)

Catastrophic forgetting remains a formidable obstacle to building an omniscient model in large language models (LLMs). Despite the pioneering research on task-level forgetting in LLM fine-tuning, there is scant focus on forgetting during pre-training. We systematically explored the existence and measurement of forgetting in pre-training, questioning traditional metrics such as perplexity (PPL) and introducing new metrics to better detect entity memory retention. Based on our revised assessment of forgetting metrics, we explored low-cost, straightforward methods to mitigate forgetting during the pre-training phase. Further, we carefully analyzed the learning curves, offering insights into the dynamics of forgetting. Extensive evaluations and analyses on forgetting of pre-training could facilitate future research on LLMs.