Trustworthy Alignment of Retrieval-Augmented Large Language Models via Reinforcement Learning

作者: Zongmeng Zhang, Yufeng Shi, Jinhua Zhu, Wengang Zhou, Xiang Qi, Peng Zhang, Houqiang Li

分类: cs.CL

发布日期: 2024-10-22

备注: ICML 2024

期刊: Proceedings of the 41st International Conference on Machine Learning, PMLR 235:59827-59850, 2024

💡 一句话要点

提出Trustworthy-Alignment算法,通过强化学习提升检索增强大语言模型的可靠性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强 大语言模型 强化学习 可靠性对齐 幻觉抑制

📋 核心要点

- 检索增强大语言模型易受参数知识干扰,产生幻觉,降低了其可靠性。

- 提出Trustworthy-Alignment算法,利用强化学习使模型仅依赖外部证据生成响应。

- 实验证明,该算法能有效提升模型的可信度,使其在无显式监督下探索内在能力。

📝 摘要(中文)

本文关注检索增强大语言模型在实际应用中的可靠性问题。尽管有外部证据支持,检索增强生成仍然存在幻觉,主要原因是上下文知识和参数知识之间的冲突。我们认为检索增强语言模型本身具备根据上下文知识和参数知识提供响应的能力。受人类偏好对齐语言模型的启发,我们首次尝试将检索增强语言模型对齐到一种仅依赖外部证据响应,并忽略参数知识干扰的状态。具体而言,我们提出了一种基于强化学习的算法Trustworthy-Alignment,从理论和实验上证明了大语言模型在没有显式监督的情况下达到可信状态的能力。我们的工作突出了大语言模型探索自身内在能力的潜力,并将对齐的应用场景从满足人类偏好扩展到创建可信代理。

🔬 方法详解

问题定义:检索增强的大语言模型在生成答案时,容易受到自身参数知识的干扰,产生与检索到的外部证据相悖的幻觉。现有方法缺乏有效手段,使模型完全依赖外部证据,忽略内部知识的干扰,从而降低了模型的可靠性。

核心思路:该论文的核心思路是利用强化学习,训练模型仅根据检索到的外部证据生成答案,从而消除内部参数知识的干扰。通过奖励模型对仅依赖外部证据的响应进行正向激励,促使模型学习到可信的生成策略。

技术框架:Trustworthy-Alignment算法主要包含以下几个阶段:1) 使用检索增强的大语言模型生成初始响应;2) 设计奖励函数,评估响应对外部证据的依赖程度;3) 使用强化学习算法(如PPO)优化生成策略,最大化奖励函数;4) 迭代训练,直至模型生成高度依赖外部证据的响应。

关键创新:该论文的关键创新在于将强化学习应用于检索增强大语言模型的可靠性对齐。不同于以往依赖人工标注或规则的方法,该方法通过奖励函数引导模型自主学习,探索其内在能力,从而实现可信的生成。

关键设计:奖励函数的设计是关键。奖励函数需要能够准确评估响应对外部证据的依赖程度。具体实现可能包括:1) 衡量响应与外部证据之间的语义相似度;2) 惩罚响应中包含的与外部证据相悖的信息;3) 鼓励响应简洁明了,避免冗余信息。强化学习算法的选择也很重要,需要选择适合大规模语言模型训练的算法,如PPO。

🖼️ 关键图片

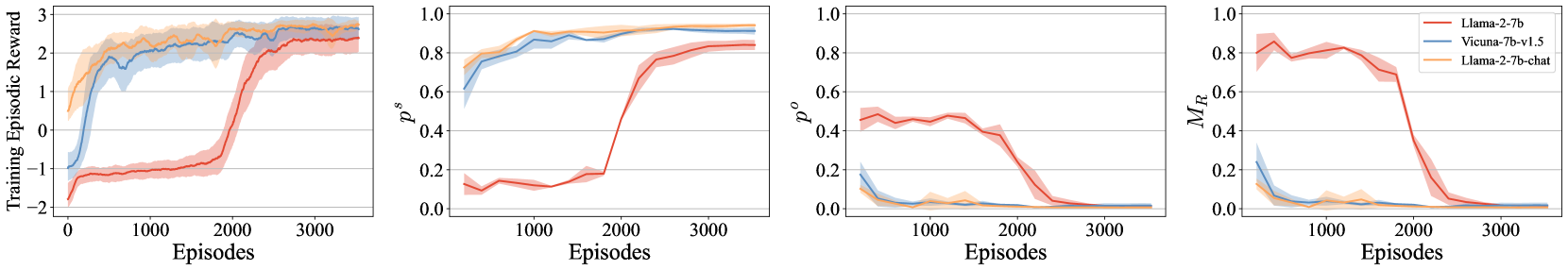

📊 实验亮点

该论文提出了Trustworthy-Alignment算法,通过强化学习使检索增强大语言模型更加依赖外部证据,减少幻觉。实验结果表明,该算法能够有效提升模型的可信度,使其在没有显式监督的情况下,自主学习到可信的生成策略,从而验证了大语言模型探索自身内在能力的潜力。

🎯 应用场景

该研究成果可应用于需要高度可靠性的问答系统、信息检索、内容生成等领域。例如,在医疗咨询、金融分析等场景中,确保模型提供的答案完全基于可信的外部证据至关重要。该方法有助于提升大语言模型在这些领域的应用价值,并降低因幻觉带来的风险。

📄 摘要(原文)

Trustworthiness is an essential prerequisite for the real-world application of large language models. In this paper, we focus on the trustworthiness of language models with respect to retrieval augmentation. Despite being supported with external evidence, retrieval-augmented generation still suffers from hallucinations, one primary cause of which is the conflict between contextual and parametric knowledge. We deem that retrieval-augmented language models have the inherent capabilities of supplying response according to both contextual and parametric knowledge. Inspired by aligning language models with human preference, we take the first step towards aligning retrieval-augmented language models to a status where it responds relying merely on the external evidence and disregards the interference of parametric knowledge. Specifically, we propose a reinforcement learning based algorithm Trustworthy-Alignment, theoretically and experimentally demonstrating large language models' capability of reaching a trustworthy status without explicit supervision on how to respond. Our work highlights the potential of large language models on exploring its intrinsic abilities by its own and expands the application scenarios of alignment from fulfilling human preference to creating trustworthy agents.