Pangea: A Fully Open Multilingual Multimodal LLM for 39 Languages

作者: Xiang Yue, Yueqi Song, Akari Asai, Seungone Kim, Jean de Dieu Nyandwi, Simran Khanuja, Anjali Kantharuban, Lintang Sutawika, Sathyanarayanan Ramamoorthy, Graham Neubig

分类: cs.CL, cs.CV

发布日期: 2024-10-21 (更新: 2025-01-26)

备注: 54 pages, 27 figures

💡 一句话要点

Pangea:一个面向39种语言的完全开放的多语言多模态大语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言模型 多模态学习 跨文化理解 指令数据集 大语言模型

📋 核心要点

- 现有的多模态大语言模型主要集中在英语和西方数据集上,缺乏对世界大多数语言和文化背景的覆盖。

- Pangea通过构建包含39种语言的PangeaIns指令数据集,并训练多语言多模态大语言模型,实现了跨文化覆盖。

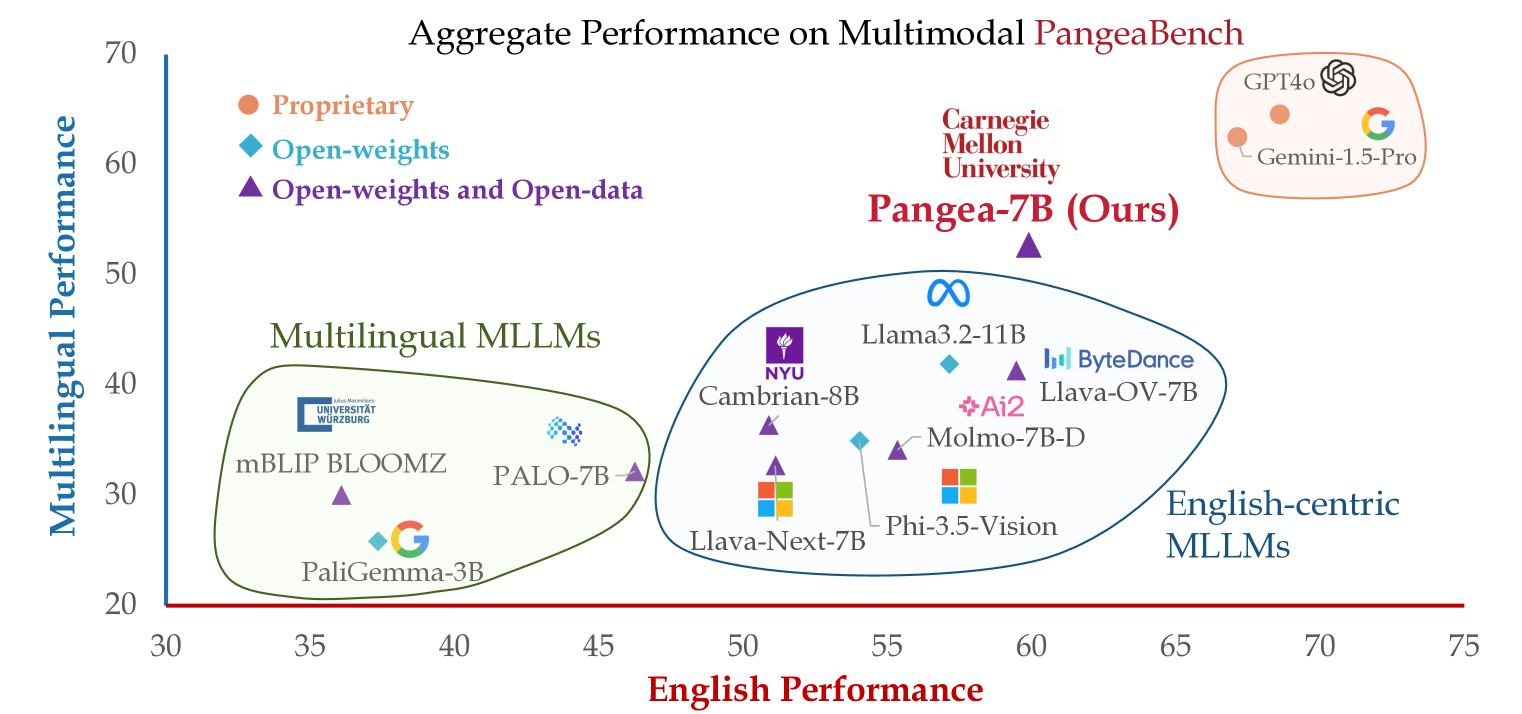

- Pangea在PangeaBench评估套件上显著优于现有开源模型,证明了其在多语言环境下的有效性。

📝 摘要(中文)

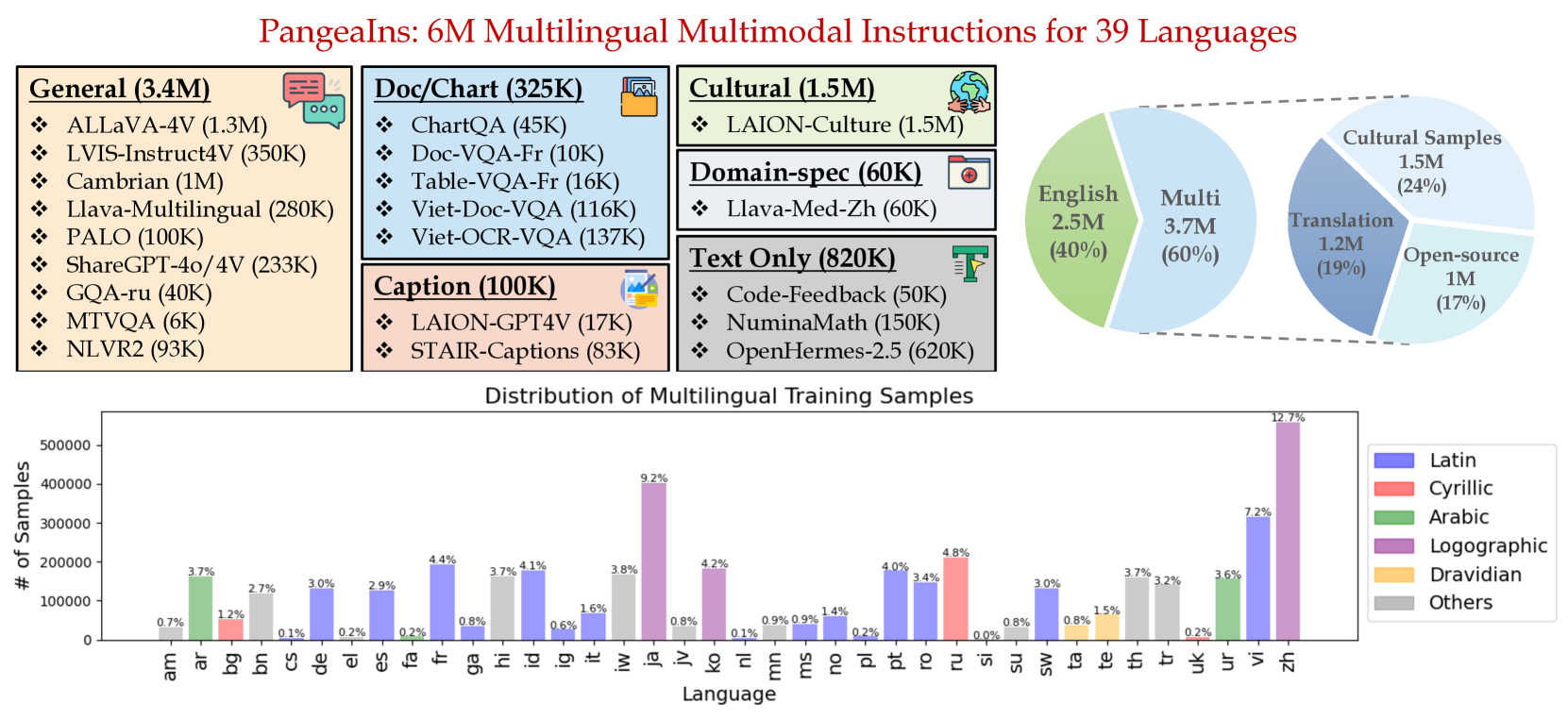

本文介绍了Pangea,一个多语言多模态大语言模型,它在包含39种语言的PangeaIns数据集上训练而成,该数据集包含600万条指令。PangeaIns的特点是:1) 高质量的英文指令,2) 经过精心机器翻译的指令,3) 与文化相关的多模态任务,以确保跨文化覆盖。为了严格评估模型的能力,我们引入了PangeaBench,一个包含14个数据集、覆盖47种语言的综合评估套件。结果表明,Pangea在多语言环境和不同的文化背景下,显著优于现有的开源模型。消融研究进一步揭示了英语数据比例、语言流行度和多模态训练样本数量对整体性能的重要性。我们完全开源了我们的数据、代码和训练后的检查点,以促进包容和强大的多语言多模态LLM的开发,从而在更广泛的语言和文化范围内促进公平和可访问性。

🔬 方法详解

问题定义:现有的大型多模态语言模型(MLLMs)在很大程度上忽略了非英语语言和文化背景,导致这些模型在处理多语言和跨文化任务时表现不佳。现有的数据集和评估方法也主要集中在英语上,缺乏对其他语言和文化的有效支持。因此,如何构建一个能够理解和生成多种语言,并且能够处理不同文化背景下的多模态信息的MLLM是一个重要的挑战。

核心思路:Pangea的核心思路是通过构建一个大规模、多语言、多模态的指令数据集(PangeaIns),并在此数据集上训练MLLM,从而使模型能够学习到不同语言和文化背景下的知识。此外,还构建了一个综合性的评估基准(PangeaBench),用于全面评估模型在多语言和跨文化任务上的性能。

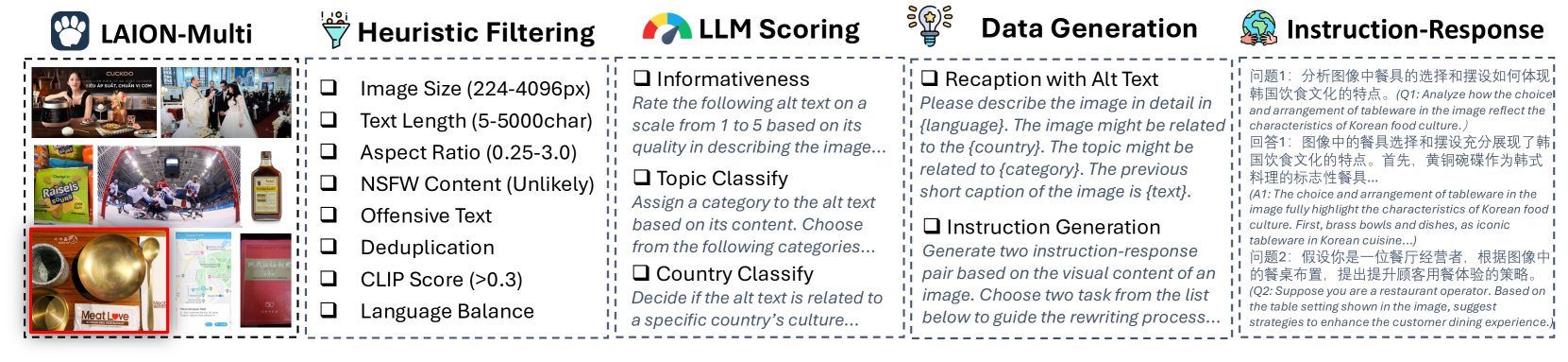

技术框架:Pangea的整体框架包括以下几个主要部分:1) PangeaIns数据集的构建,包括高质量的英文指令、机器翻译的指令以及与文化相关的多模态任务;2) 基于PangeaIns数据集训练MLLM;3) 使用PangeaBench评估MLLM的性能。具体来说,PangeaIns数据集的构建过程包括数据收集、数据清洗、数据增强和数据标注等步骤。MLLM的训练过程包括预训练和微调两个阶段。PangeaBench评估基准包括多个数据集,涵盖了不同的语言和文化背景。

关键创新:Pangea的关键创新在于:1) 构建了一个大规模、多语言、多模态的指令数据集(PangeaIns),该数据集覆盖了39种语言,并且包含了与文化相关的多模态任务;2) 提出了一个综合性的评估基准(PangeaBench),用于全面评估模型在多语言和跨文化任务上的性能;3) 通过实验证明了Pangea在多语言环境和不同的文化背景下,显著优于现有的开源模型。与现有方法相比,Pangea更加注重多语言和跨文化的支持,并且提供了更加全面和有效的评估方法。

关键设计:PangeaIns数据集的关键设计包括:1) 英文指令的质量控制,确保指令的清晰度和准确性;2) 机器翻译指令的质量评估和校正,确保翻译的准确性和流畅性;3) 多模态任务的设计,确保任务与文化相关,并且能够有效地评估模型的多模态理解能力。PangeaBench评估基准的关键设计包括:1) 数据集的多样性,涵盖不同的语言和文化背景;2) 评估指标的全面性,包括准确率、召回率、F1值等;3) 评估过程的标准化,确保评估结果的可比性。

🖼️ 关键图片

📊 实验亮点

Pangea在PangeaBench评估套件上进行了广泛的实验,结果表明,Pangea在多语言环境和不同的文化背景下,显著优于现有的开源模型。例如,在某些多语言任务上,Pangea的性能提升了10%以上。消融研究还表明,英语数据比例、语言流行度和多模态训练样本数量对整体性能有显著影响。

🎯 应用场景

Pangea的研究成果可以广泛应用于多语言和跨文化的人工智能应用中,例如多语言聊天机器人、跨文化图像理解、多语言文档摘要等。该研究有助于推动人工智能技术的普及,使其能够更好地服务于全球用户,促进不同文化之间的交流和理解。未来,Pangea可以进一步扩展到更多的语言和文化,并应用于更复杂的任务中。

📄 摘要(原文)

Despite recent advances in multimodal large language models (MLLMs), their development has predominantly focused on English- and western-centric datasets and tasks, leaving most of the world's languages and diverse cultural contexts underrepresented. This paper introduces Pangea, a multilingual multimodal LLM trained on PangeaIns, a diverse 6M instruction dataset spanning 39 languages. PangeaIns features: 1) high-quality English instructions, 2) carefully machine-translated instructions, and 3) culturally relevant multimodal tasks to ensure cross-cultural coverage. To rigorously assess models' capabilities, we introduce PangeaBench, a holistic evaluation suite encompassing 14 datasets covering 47 languages. Results show that Pangea significantly outperforms existing open-source models in multilingual settings and diverse cultural contexts. Ablation studies further reveal the importance of English data proportions, language popularity, and the number of multimodal training samples on overall performance. We fully open-source our data, code, and trained checkpoints, to facilitate the development of inclusive and robust multilingual MLLMs, promoting equity and accessibility across a broader linguistic and cultural spectrum.