Revealing and Mitigating the Local Pattern Shortcuts of Mamba

作者: Wangjie You, Zecheng Tang, Juntao Li, Lili Yao, Min Zhang

分类: cs.CL, cs.AI

发布日期: 2024-10-21

💡 一句话要点

揭示并缓解Mamba模型局部模式捷径问题,提升长程依赖处理能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Mamba模型 状态空间模型 长程依赖 全局选择 局部模式捷径

📋 核心要点

- Mamba模型在处理长上下文任务时,虽然具有线性复杂度和恒定内存优势,但在处理分布式关键信息时存在性能瓶颈。

- 论文提出向Mamba模型中引入全局选择模块,旨在克服其对局部模式捷径的依赖,从而提升处理分布式信息的能力。

- 实验结果表明,该方法仅需少量额外参数,即可显著提升Mamba模型在分布式信息任务上的性能,验证了其有效性。

📝 摘要(中文)

大型语言模型(LLMs)由于注意力机制而取得了显著进展,但其二次复杂度以及线性内存需求限制了它们在长上下文任务中的性能。最近,研究人员引入了Mamba,这是一种基于状态空间模型(SSM)的先进模型,它提供了线性复杂度和恒定内存。尽管据报道Mamba在性能上与基于注意力的模型相匹配或超越,但我们的分析揭示了一个性能差距:Mamba擅长处理涉及局部关键信息的任务,但在处理需要处理分布式关键信息的任务时面临挑战。我们的受控实验表明,这种不一致源于Mamba对局部模式捷径的依赖,这使得模型能够在有限的内存中记住局部关键信息,但阻碍了其保留更分散信息的能力。因此,我们向Mamba模型中引入了一个全局选择模块来解决这个问题。在现有和提出的合成任务以及真实世界任务上的实验证明了我们方法的有效性。值得注意的是,仅引入4M额外参数,我们的方法就使Mamba模型(130M)在具有分布式信息的任务上取得了显著改进,将其性能从0提高到80.54分。

🔬 方法详解

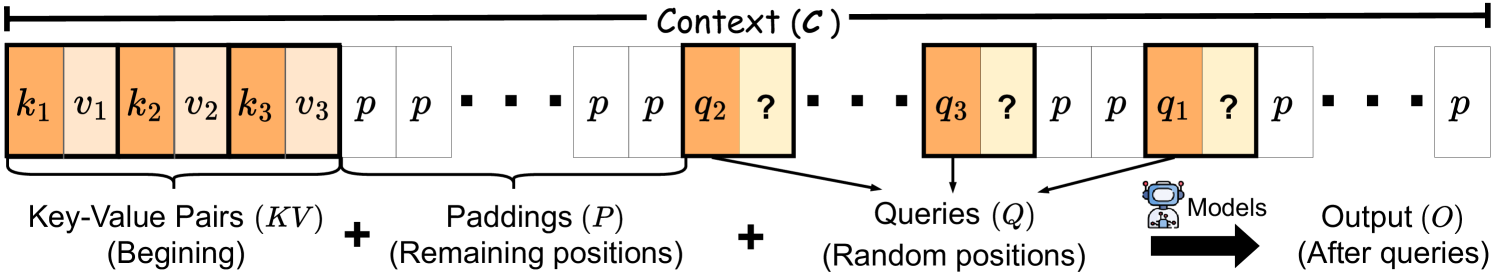

问题定义:Mamba模型虽然在长序列建模上具有优势,但其性能依赖于局部模式的识别。当关键信息分散在整个序列中时,Mamba模型难以有效地捕捉和利用这些信息,导致性能下降。现有方法缺乏对全局信息的有效整合机制,使得模型容易陷入局部最优解。

核心思路:论文的核心思路是通过引入一个全局选择模块,增强Mamba模型对全局信息的感知和利用能力。该模块能够从整个序列中选择重要的信息片段,并将其融入到Mamba模型的处理流程中,从而克服局部模式捷径的限制。

技术框架:该方法在Mamba模型的基础上,增加了一个全局选择模块。该模块首先对输入序列进行全局分析,然后选择出与任务相关的关键信息片段。这些片段随后被整合到Mamba模型的状态更新过程中,从而影响模型的输出。整体流程包括:输入序列 -> 全局选择模块 -> Mamba模型 -> 输出。

关键创新:该方法最重要的创新点在于全局选择模块的设计。该模块能够自适应地选择重要的信息片段,并将其融入到Mamba模型的处理流程中。与现有方法相比,该方法能够更有效地利用全局信息,从而提升模型在处理分布式信息任务上的性能。

关键设计:全局选择模块的具体实现方式未知,但可以推测其可能采用注意力机制或其他选择算法来确定信息片段的重要性。论文提到仅引入了4M额外参数,暗示该模块的设计较为轻量级。损失函数和网络结构的具体细节也未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,引入全局选择模块后,Mamba模型(130M)在具有分布式信息的任务上取得了显著改进,性能从0提高到80.54分。该方法仅引入了4M额外参数,表明其具有较高的参数效率。这些结果验证了该方法在提升Mamba模型长程依赖处理能力方面的有效性。

🎯 应用场景

该研究成果可应用于需要处理长程依赖和分布式信息的各种自然语言处理任务,例如文档摘要、机器翻译、问答系统等。通过提升模型对全局信息的感知能力,可以提高模型在这些任务上的性能和鲁棒性。此外,该方法还可以推广到其他序列建模任务中,例如时间序列预测和语音识别。

📄 摘要(原文)

Large language models (LLMs) have advanced significantly due to the attention mechanism, but their quadratic complexity and linear memory demands limit their performance on long-context tasks. Recently, researchers introduced Mamba, an advanced model built upon State Space Models(SSMs) that offers linear complexity and constant memory. Although Mamba is reported to match or surpass the performance of attention-based models, our analysis reveals a performance gap: Mamba excels in tasks that involve localized key information but faces challenges with tasks that require handling distributed key information. Our controlled experiments suggest that this inconsistency arises from Mamba's reliance on local pattern shortcuts, which enable the model to remember local key information within its limited memory but hinder its ability to retain more dispersed information. Therefore, we introduce a global selection module into the Mamba model to address this issue. Experiments on both existing and proposed synthetic tasks, as well as real-world tasks, demonstrate the effectiveness of our method. Notably, with the introduction of only 4M extra parameters, our approach enables the Mamba model(130M) to achieve a significant improvement on tasks with distributed information, increasing its performance from 0 to 80.54 points.