The Geometry of Numerical Reasoning: Language Models Compare Numeric Properties in Linear Subspaces

作者: Ahmed Oumar El-Shangiti, Tatsuya Hiraoka, Hilal AlQuabeh, Benjamin Heinzerling, Kentaro Inui

分类: cs.CL

发布日期: 2024-10-17 (更新: 2025-02-08)

💡 一句话要点

探究LLM数值推理几何:语言模型在线性子空间中比较数值属性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数值推理 嵌入空间 线性子空间 因果干预

📋 核心要点

- 现有方法缺乏对LLM如何进行数值推理的深入理解,尤其是在嵌入空间中数值信息的表示方式。

- 论文提出通过识别和干预嵌入空间中编码数值属性的线性子空间,来研究LLM的数值推理机制。

- 实验结果表明,LLM确实利用线性编码的数值信息进行推理,并且可以通过操纵这些子空间来改变LLM的判断。

📝 摘要(中文)

本文研究了大型语言模型(LLM)在回答涉及数值比较的问题时,是否利用了编码在嵌入空间的低维子空间中的数值属性,例如“克里斯蒂亚诺是否比梅西更早出生?”。我们首先使用偏最小二乘回归识别出这些子空间,这些子空间有效地编码了比较提示中与实体相关的数值属性。 此外,我们通过干预这些子空间来操纵隐藏状态,从而改变LLM的比较结果,以此来证明因果关系。 在三个不同的LLM上进行的实验表明,我们的结果适用于不同的数值属性,表明LLM利用线性编码的信息进行数值推理。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)如何利用数值信息进行推理的问题。现有方法缺乏对LLM内部数值表示的理解,特别是如何将数值属性编码到其嵌入空间中。因此,无法解释LLM进行数值比较的内在机制,也难以控制或预测其行为。

核心思路:论文的核心思路是假设LLM将数值属性编码在嵌入空间的低维线性子空间中。通过识别这些子空间,并对其进行干预,可以观察LLM的推理行为变化,从而推断LLM是否以及如何利用这些数值信息。这种方法类似于在神经网络中进行“概念擦除”或“因果干预”,但专注于数值属性。

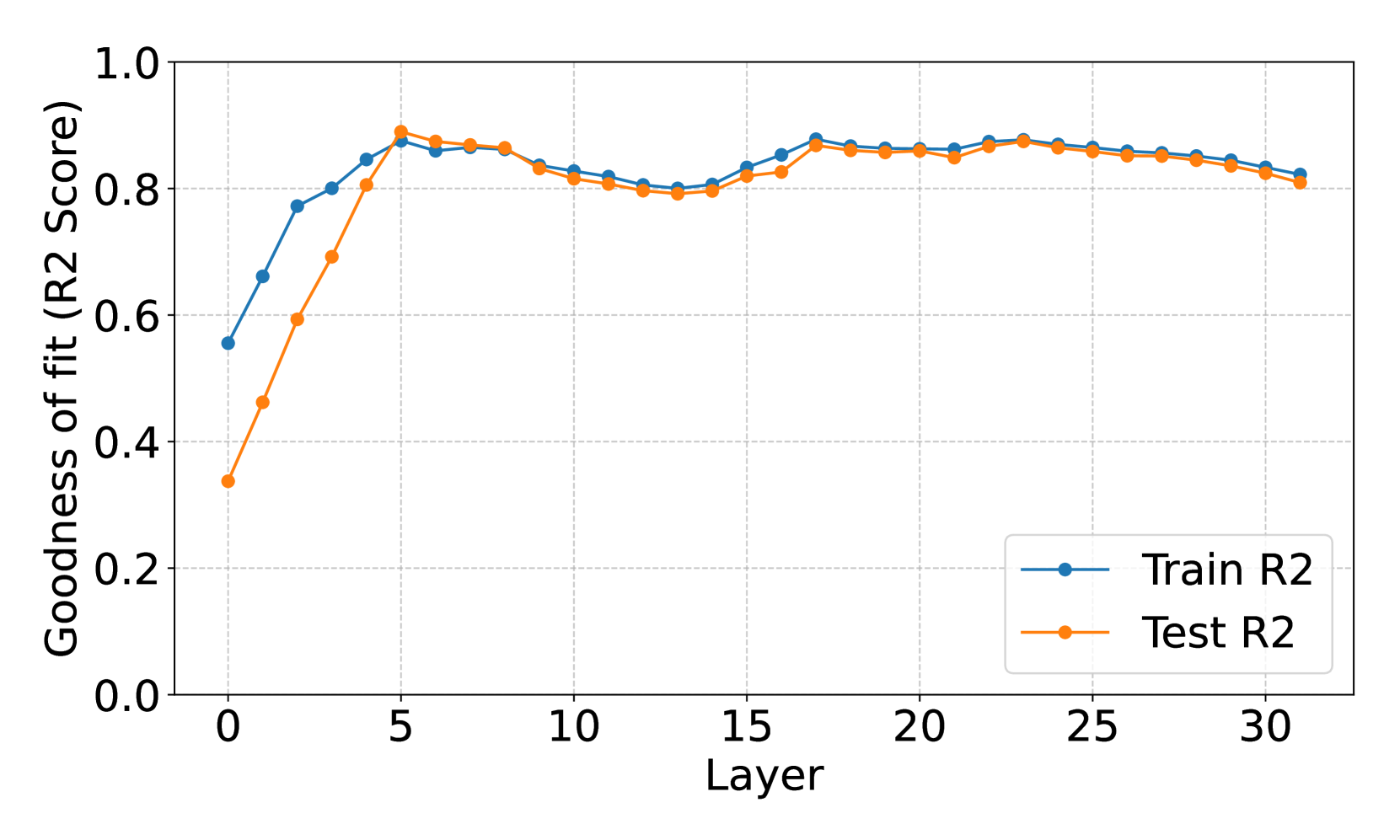

技术框架:整体框架包含以下几个步骤:1)构建包含数值比较问题的提示数据集;2)使用LLM处理这些提示,并提取隐藏状态;3)使用偏最小二乘回归(PLSR)从隐藏状态中识别编码数值属性的线性子空间;4)通过操纵这些子空间中的向量,改变隐藏状态;5)使用修改后的隐藏状态输入LLM,观察其输出结果的变化。

关键创新:最重要的技术创新在于使用偏最小二乘回归(PLSR)来识别编码数值属性的线性子空间。PLSR是一种降维技术,可以找到隐藏状态中与数值属性相关性最强的线性组合。此外,通过干预这些子空间,论文建立了数值属性与LLM推理结果之间的因果关系,而不仅仅是相关性。

关键设计:关键设计包括:1)选择合适的LLM架构(论文中使用了三个不同的LLM);2)设计包含不同数值属性的提示数据集(例如,出生年份、人口数量等);3)使用PLSR时选择合适的成分数量;4)设计合理的干预策略,例如,将子空间中的向量设置为零,或添加噪声。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过干预编码数值属性的线性子空间,可以显著改变LLM的比较结果。例如,通过操纵出生年份的子空间,可以使LLM错误地判断“梅西比克里斯蒂亚诺更早出生”。这证明了LLM确实利用线性编码的数值信息进行推理,并且可以通过干预这些子空间来控制其行为。实验在三个不同的LLM上进行了验证,表明结果具有一定的普适性。

🎯 应用场景

该研究成果可应用于提升LLM的数值推理能力,例如,通过增强其对数值信息的编码和利用,提高其在金融、科学计算等领域的表现。此外,该研究也为理解LLM的内部机制提供了新的视角,有助于开发更可控、更可靠的LLM系统。未来,可以进一步探索如何利用这些线性子空间来编辑或修正LLM的知识。

📄 摘要(原文)

This paper investigates whether large language models (LLMs) utilize numerical attributes encoded in a low-dimensional subspace of the embedding space when answering questions involving numeric comparisons, e.g., Was Cristiano born before Messi? We first identified, using partial least squares regression, these subspaces, which effectively encode the numerical attributes associated with the entities in comparison prompts. Further, we demonstrate causality, by intervening in these subspaces to manipulate hidden states, thereby altering the LLM's comparison outcomes. Experiments conducted on three different LLMs showed that our results hold across different numerical attributes, indicating that LLMs utilize the linearly encoded information for numerical reasoning.