Improving the Language Understanding Capabilities of Large Language Models Using Reinforcement Learning

作者: Bokai Hu, Sai Ashish Somayajula, Xin Pan, Pengtao Xie

分类: cs.CL, cs.AI

发布日期: 2024-10-14 (更新: 2025-09-26)

💡 一句话要点

利用强化学习提升大型语言模型在自然语言理解任务上的能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 自然语言理解 大型语言模型 近端策略优化 指令微调 奖励函数 GLUE基准

📋 核心要点

- 现有指令微调LLM在NLU任务上表现不佳,难以超越小型模型,面临性能瓶颈。

- 论文提出利用PPO强化学习框架,将NLU任务建模为token生成动作序列,优化奖励信号。

- 实验结果表明,PPO显著提升了LLM在GLUE等基准测试上的性能,甚至超越了GPT-4o。

📝 摘要(中文)

参数小于140亿的指令微调大型语言模型(LLMs)在自然语言理解(NLU)任务上的表现仍然不佳,通常落后于BERT-base等较小模型在GLUE和SuperGLUE等基准测试上的表现。受到强化学习在推理任务中取得成功的启发(例如,DeepSeek),我们探索近端策略优化(PPO)作为一种框架,以提高LLMs的NLU能力。我们将NLU构建为强化学习环境,将token生成视为一系列动作,并根据与ground-truth标签的对齐来优化奖励信号。PPO始终优于监督微调,在GLUE上平均提高了6.3个点,并且分别超过了zero-shot和few-shot prompting 38.7和26.1个点。值得注意的是,经过PPO调整的模型在情感分析和自然语言推理任务中,平均优于GPT-4o超过4%,包括在Mental Health数据集上提高了7.3%,在SIGA-nli上提高了10.9%。这项工作强调了一个有希望的方向,即通过将LLMs重新定义为强化学习问题来使其适应新任务,从而能够通过简单的端到端任务奖励而不是大量的数据整理来进行学习。

🔬 方法详解

问题定义:论文旨在解决指令微调后的小型LLM(参数小于14B)在自然语言理解(NLU)任务中表现不佳的问题。现有方法依赖于大量数据进行监督微调,成本高昂且泛化能力有限。这些模型在GLUE和SuperGLUE等基准测试中,性能往往不如更小的模型如BERT-base,表明其NLU能力有待提升。

核心思路:论文的核心思路是将NLU任务重新建模为一个强化学习问题。具体来说,将token的生成过程视为智能体采取的一系列动作,并根据生成的token序列与ground truth标签的对齐程度来设计奖励函数。通过强化学习,模型可以直接优化最终的NLU性能,而无需依赖大量的标注数据。这种方法借鉴了强化学习在推理任务中的成功经验,旨在提升LLM的NLU能力。

技术框架:整体框架包括以下几个主要部分:1) LLM作为智能体,负责生成token序列;2) NLU任务作为环境,接收智能体的动作并返回奖励信号;3) 奖励函数,用于评估生成的token序列与ground truth标签的对齐程度;4) PPO算法,用于优化LLM的策略,使其能够生成更高质量的token序列。整个训练过程通过不断迭代,使LLM逐渐学会如何更好地完成NLU任务。

关键创新:论文的关键创新在于将NLU任务重新定义为强化学习问题,并利用PPO算法进行优化。这种方法与传统的监督微调方法有本质区别,它不需要大量的标注数据,而是通过奖励信号来引导模型的学习。此外,论文还探索了不同的奖励函数设计,以更好地反映NLU任务的特点。

关键设计:论文使用了Proximal Policy Optimization (PPO)算法来训练LLM。奖励函数的设计至关重要,论文可能采用了基于token级别或序列级别的奖励,例如,与ground truth标签的交叉熵损失的负值。具体的参数设置(例如,PPO的clip参数、学习率等)和网络结构(例如,LLM的层数、隐藏层大小等)可能需要根据具体的NLU任务进行调整。此外,探索如何有效地利用PPO来避免策略崩溃也是一个重要的技术细节。

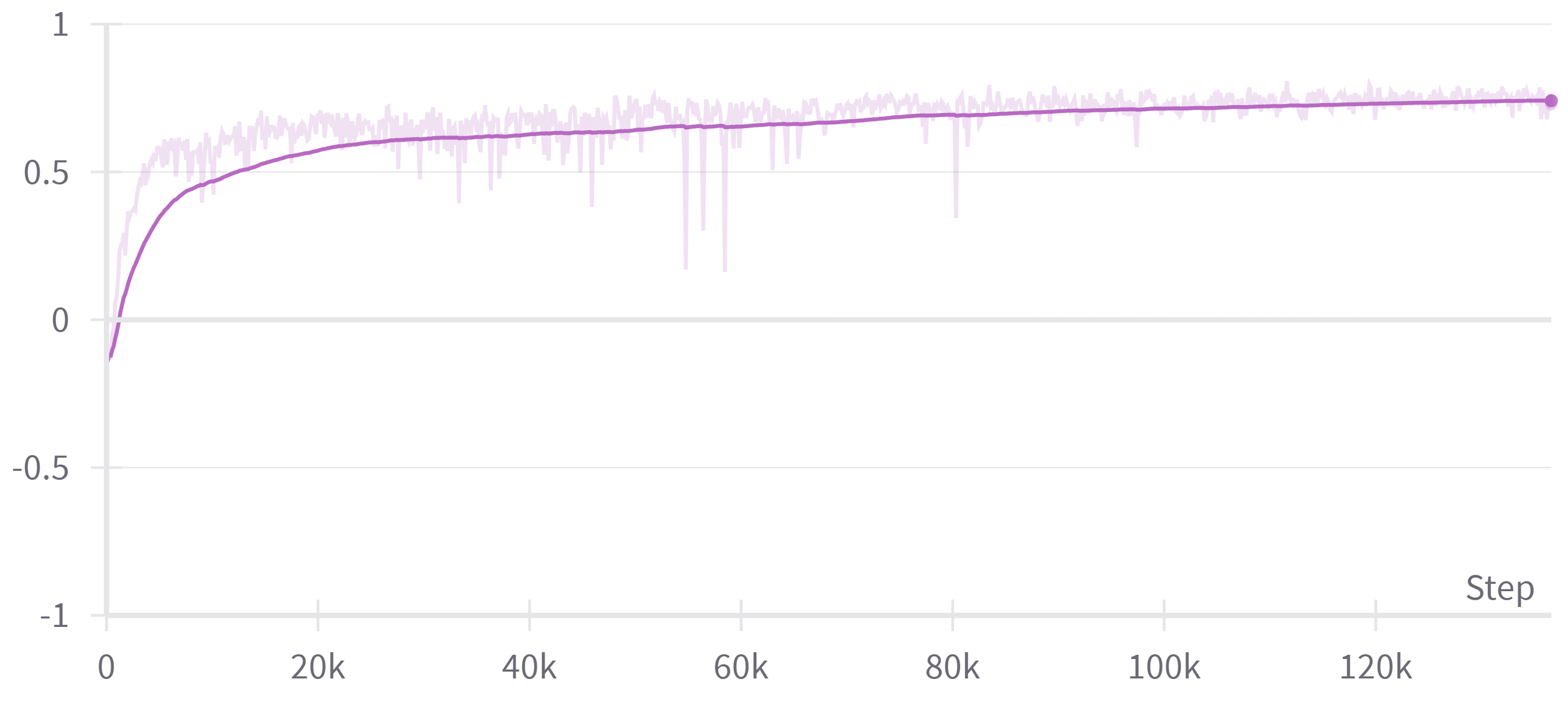

🖼️ 关键图片

📊 实验亮点

实验结果表明,PPO方法在GLUE基准测试上平均提高了6.3个点,显著优于监督微调。更重要的是,PPO调整后的模型在情感分析和自然语言推理任务中,平均优于GPT-4o超过4%,在Mental Health数据集上提高了7.3%,在SIGA-nli上提高了10.9%。这些结果表明,强化学习是提升LLM在NLU任务中性能的有效途径。

🎯 应用场景

该研究成果可应用于各种自然语言理解任务,如情感分析、文本分类、自然语言推理等。通过强化学习提升LLM的NLU能力,可以降低数据标注成本,提高模型在实际应用中的泛化能力。未来,该方法有望推广到更多复杂的NLP任务中,例如对话系统、机器翻译等,从而推动人工智能技术的发展。

📄 摘要(原文)

Instruction-fine-tuned large language models (LLMs) under 14B parameters continue to underperform on natural language understanding (NLU) tasks, often trailing smaller models like BERT-base on benchmarks such as GLUE and SuperGLUE. Motivated by the success of reinforcement learning in reasoning tasks (e.g., DeepSeek), we explore Proximal Policy Optimization (PPO) as a framework to improve the NLU capabilities of LLMs. We frame NLU as a reinforcement learning environment, treating token generation as a sequence of actions and optimizing for reward signals based on alignment with ground-truth labels. PPO consistently outperforms supervised fine-tuning, yielding an average improvement of 6.3 points on GLUE, and surpasses zero-shot and few-shot prompting by 38.7 and 26.1 points, respectively. Notably, PPO-tuned models outperform GPT-4o by over 4\% on average across sentiment and natural language inference tasks, including gains of 7.3\% on the Mental Health dataset and 10.9\% on SIGA-nli. This work highlights a promising direction for adapting LLMs to new tasks by reframing them as reinforcement learning problems, enabling learning through simple end-task rewards rather than extensive data curation.