COrAL: Order-Agnostic Language Modeling for Efficient Iterative Refinement

作者: Yuxi Xie, Anirudh Goyal, Xiaobao Wu, Xunjian Yin, Xiao Xu, Min-Yen Kan, Liangming Pan, William Yang Wang

分类: cs.CL

发布日期: 2024-10-12

备注: 12 pages, 7 figures, 3 tables (23 pages, 9 figures, 4 tables including references and appendices)

🔗 代码/项目: GITHUB

💡 一句话要点

提出COrAL:一种高效的、与顺序无关的语言模型,用于迭代优化大型语言模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 迭代优化 语言模型 顺序无关建模 推理加速 上下文建模

📋 核心要点

- 现有迭代优化方法依赖自回归模型,存在推理延迟高的问题,限制了大型语言模型在复杂任务中的应用。

- COrAL将迭代优化融入LLM架构,通过上下文窗口建模token依赖,实现并行迭代优化,提高推理效率。

- 实验表明,COrAL在推理任务上提升了性能和速度,但在代码生成方面存在质量-速度的权衡。

📝 摘要(中文)

迭代优化已成为增强大型语言模型(LLM)在复杂任务上能力的一种有效范例。然而,现有方法通常在应用或提示层面实现迭代优化,依赖于自回归(AR)建模。AR模型中的顺序token生成会导致高推理延迟。为了克服这些挑战,我们提出了上下文相关的顺序无关语言建模(COrAL),它将迭代优化直接融入LLM架构,同时保持计算效率。我们的方法在可管理的上下文窗口内建模多个token依赖关系,使模型能够在生成过程中内部执行迭代优化。利用COrAL的顺序无关特性,我们引入了滑动分块顺序无关解码,它在上下文窗口内执行多token前向预测和后向重构。这允许模型在滑动块中并行地迭代优化其输出,有效地捕获各种依赖关系,而无需顺序生成的高推理成本。在推理任务上的经验评估表明,COrAL提高了性能和推理速度,在GSM8K上实现了4.6%的绝对精度提升,在LogiQA上实现了4.0%的绝对精度提升,并且推理速度比next-token基线提高了3.9倍。代码生成方面的初步结果表明,由于顺序无关输出的不一致性,通过率有所下降,突出了固有的质量-速度权衡。我们的代码已在https://github.com/YuxiXie/COrAL上公开。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在迭代优化过程中推理速度慢的问题。现有方法主要依赖于自回归(AR)模型,其顺序生成token的方式导致高延迟,限制了LLM在需要快速响应的复杂任务中的应用。

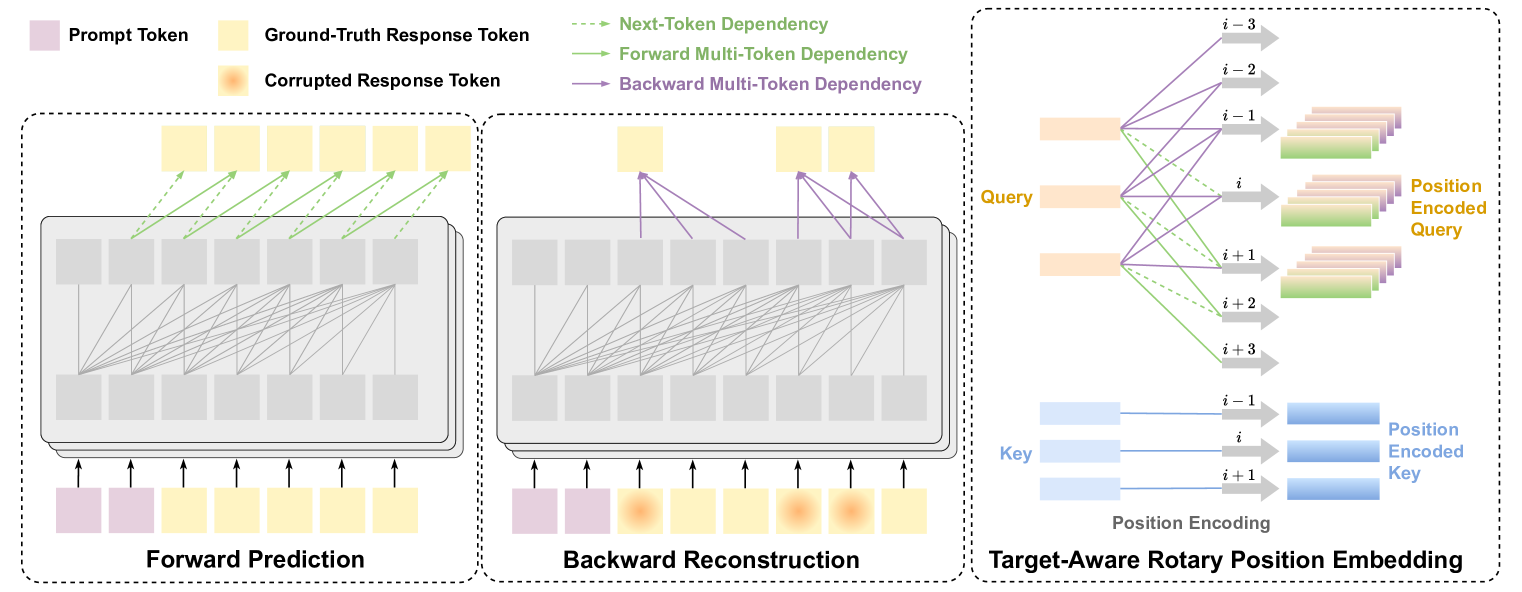

核心思路:论文的核心思路是提出一种上下文相关的顺序无关语言建模(COrAL)方法,将迭代优化直接集成到LLM架构中。通过在上下文窗口内建模多个token之间的依赖关系,COrAL能够并行地进行迭代优化,从而显著提高推理速度。这种设计避免了传统AR模型的顺序生成方式,允许模型同时考虑多个token,从而更快地收敛到更优的解。

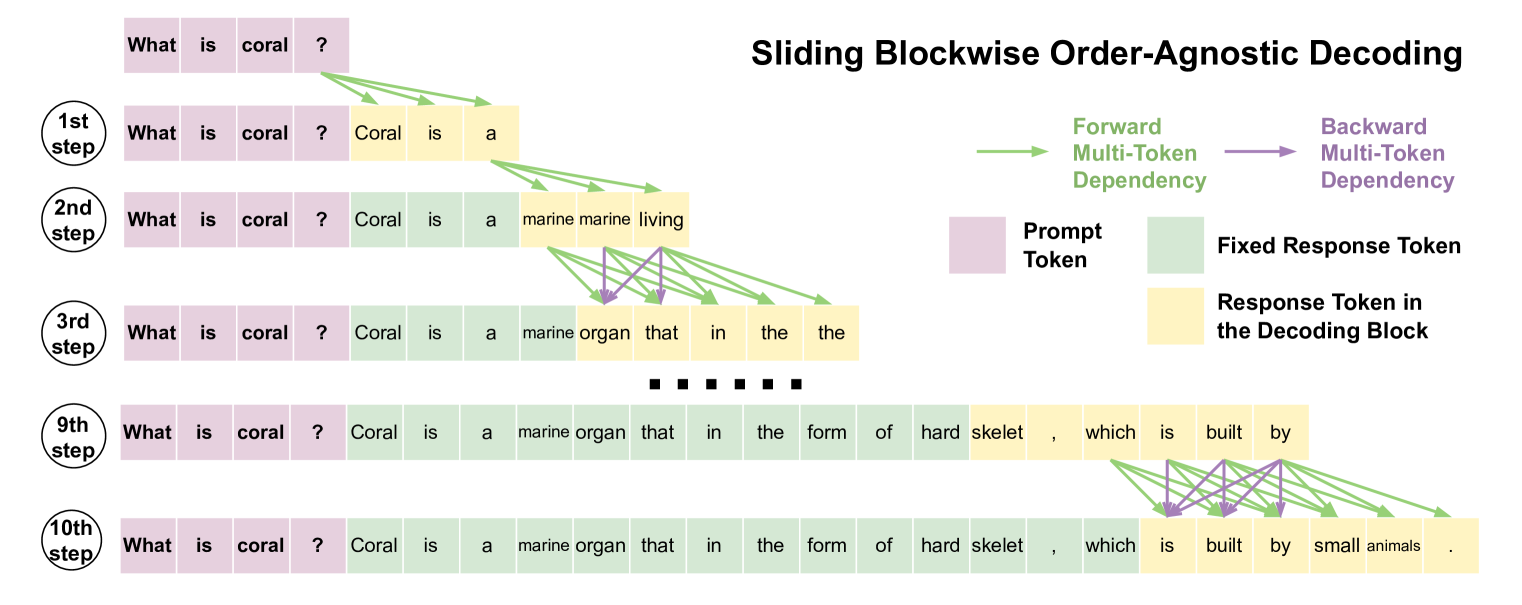

技术框架:COrAL的技术框架主要包括以下几个部分:1) 上下文窗口建模:将输入序列划分为多个上下文窗口,每个窗口包含多个token。2) 顺序无关建模:在每个上下文窗口内,模型学习token之间的依赖关系,而不依赖于token的顺序。3) 滑动分块顺序无关解码:采用滑动窗口的方式,在每个窗口内进行多token的前向预测和后向重构,实现迭代优化。4) 损失函数:采用合适的损失函数来训练模型,使其能够准确地预测和重构token。

关键创新:COrAL最重要的技术创新点在于其顺序无关的建模方式。与传统的自回归模型不同,COrAL不依赖于token的顺序进行生成,而是通过上下文窗口内的依赖关系来预测和重构token。这种顺序无关的特性使得模型能够并行地进行迭代优化,从而显著提高推理速度。此外,COrAL将迭代优化直接集成到LLM架构中,避免了在应用或提示层面进行迭代优化所带来的额外开销。

关键设计:COrAL的关键设计包括:1) 上下文窗口的大小:需要根据具体的任务和数据集进行调整,以平衡计算复杂度和建模能力。2) 顺序无关建模的方式:可以使用Transformer等模型来学习上下文窗口内的token依赖关系。3) 滑动窗口的大小和步长:需要根据具体的任务和数据集进行调整,以平衡推理速度和优化效果。4) 损失函数的设计:可以使用交叉熵损失函数等来训练模型,使其能够准确地预测和重构token。

🖼️ 关键图片

📊 实验亮点

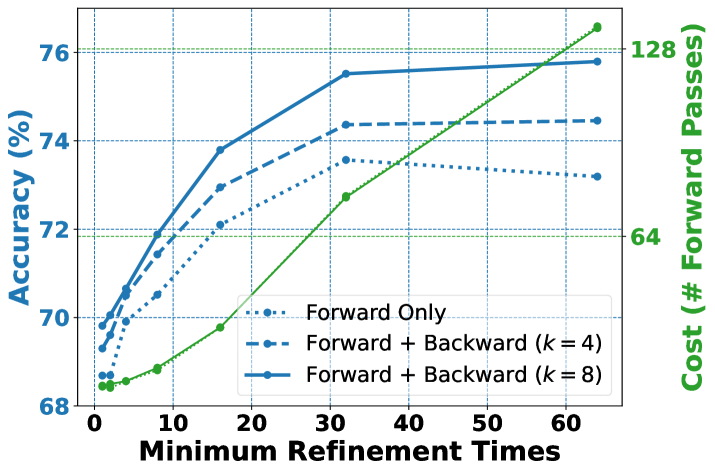

COrAL在GSM8K和LogiQA推理任务上分别取得了4.6%和4.0%的绝对精度提升,并且推理速度比next-token基线提高了3.9倍。这些结果表明,COrAL在提高LLM的性能和推理速度方面具有显著的优势。然而,在代码生成方面,由于顺序无关输出的不一致性,COrAL的通过率有所下降,突出了固有的质量-速度权衡。

🎯 应用场景

COrAL具有广泛的应用前景,尤其是在需要快速响应的复杂任务中,例如实时对话系统、在线推理和决策等。通过提高LLM的推理速度,COrAL可以使这些应用更加实用和高效。此外,COrAL还可以应用于资源受限的设备上,例如移动设备和嵌入式系统,从而扩展LLM的应用范围。未来的研究可以探索COrAL在更多领域的应用,例如自然语言生成、机器翻译和代码生成等。

📄 摘要(原文)

Iterative refinement has emerged as an effective paradigm for enhancing the capabilities of large language models (LLMs) on complex tasks. However, existing approaches typically implement iterative refinement at the application or prompting level, relying on autoregressive (AR) modeling. The sequential token generation in AR models can lead to high inference latency. To overcome these challenges, we propose Context-Wise Order-Agnostic Language Modeling (COrAL), which incorporates iterative refinement directly into the LLM architecture while maintaining computational efficiency. Our approach models multiple token dependencies within manageable context windows, enabling the model to perform iterative refinement internally during the generation process. Leveraging the order-agnostic nature of COrAL, we introduce sliding blockwise order-agnostic decoding, which performs multi-token forward prediction and backward reconstruction within context windows. This allows the model to iteratively refine its outputs in parallel in the sliding block, effectively capturing diverse dependencies without the high inference cost of sequential generation. Empirical evaluations on reasoning tasks demonstrate that COrAL improves performance and inference speed, respectively, achieving absolute accuracy gains of $4.6\%$ on GSM8K and $4.0\%$ on LogiQA, along with inference speedups of up to $3.9\times$ over next-token baselines. Preliminary results on code generation indicate a drop in pass rates due to inconsistencies in order-agnostic outputs, highlighting the inherent quality--speed trade-off. Our code is publicly available at https://github.com/YuxiXie/COrAL.