AERA Chat: An Interactive Platform for Automated Explainable Student Answer Assessment

作者: Jiazheng Li, Artem Bobrov, Runcong Zhao, Cesare Aloisi, Yulan He

分类: cs.CL

发布日期: 2024-10-12 (更新: 2025-09-28)

备注: Accepted at EMNLP 2025

💡 一句话要点

AERA Chat:用于自动可解释学生答案评估的交互式平台

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动评分 可解释性 大型语言模型 交互式平台 学生答案评估

📋 核心要点

- 现有自动评分系统缺乏高质量、可靠的解释性理由,严重依赖大型语言模型,但其生成结果往往不准确。

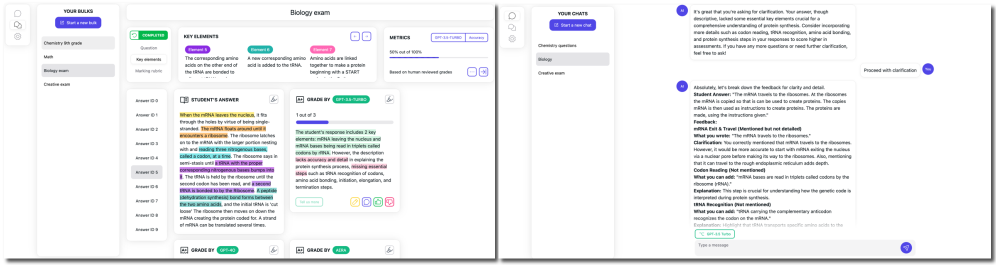

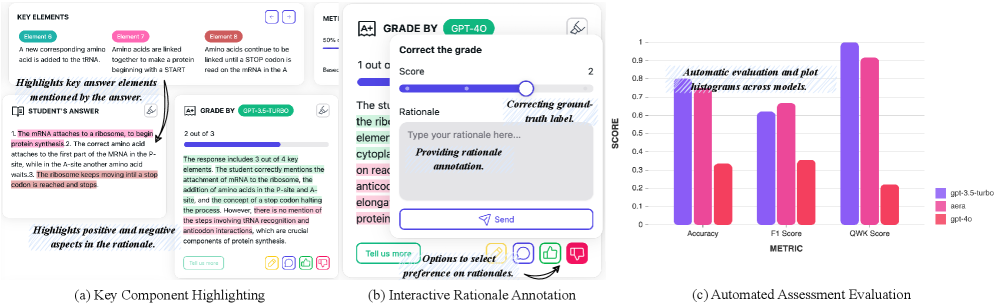

- AERA Chat平台利用多个大型语言模型并行评分并生成解释,通过可视化突出答案关键部分和理由依据。

- 平台提供直观的标注和评估工具,方便教育者进行任务标注,研究者评估不同模型生成的理由质量。

📝 摘要(中文)

自动学生答案评分系统中的可解释性对于建立信任和增强教育工作者的可用性至关重要。然而,由于缺乏带注释的数据以及手动验证的高昂成本,生成高质量的评估理由仍然具有挑战性,这导致严重依赖大型语言模型(LLM)生成的理由,但这些理由通常是嘈杂且不可靠的。为了解决这些限制,我们提出了AERA Chat,这是一个交互式可视化平台,专为自动可解释的学生答案评估而设计。AERA Chat利用多个LLM同时对学生答案进行评分并生成解释性理由,提供创新的可视化功能,突出显示关键答案组成部分和理由依据。该平台还集成了直观的注释和评估工具,支持教育工作者标记任务,并支持研究人员评估来自不同模型的理由质量。我们通过在多个数据集上评估多种理由生成方法来证明我们平台的有效性,展示了其促进稳健的理由评估和比较分析的能力。

🔬 方法详解

问题定义:论文旨在解决自动学生答案评分系统中缺乏高质量、可信赖的解释性理由的问题。现有方法依赖大型语言模型生成理由,但这些理由通常带有噪声,可靠性低,且缺乏人工验证,难以满足教育工作者对系统可解释性的需求。

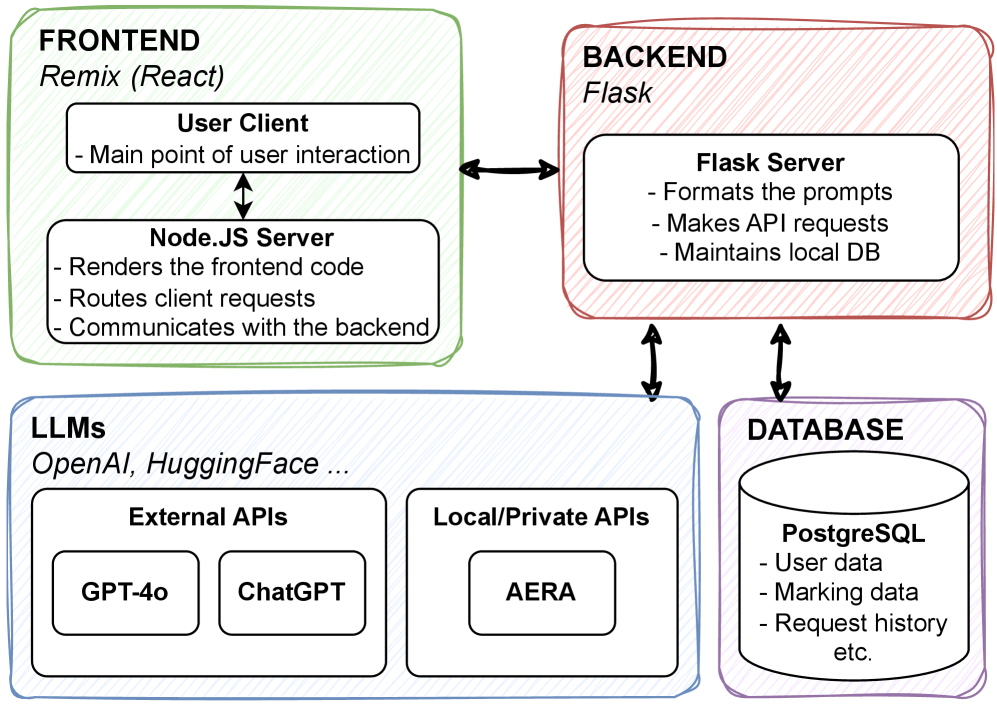

核心思路:论文的核心思路是构建一个交互式平台,利用多个大型语言模型并行生成学生答案的评分和解释性理由,并通过可视化手段突出关键信息,同时提供标注和评估工具,方便人工干预和验证,从而提高理由的质量和可信度。

技术框架:AERA Chat平台包含以下主要模块:1) 学生答案输入模块;2) 多个大型语言模型(LLM)并行评分和理由生成模块;3) 可视化模块,用于突出显示答案的关键组成部分和理由依据;4) 交互式标注和评估工具,允许用户对评分和理由进行修改和评价;5) 结果展示和分析模块。整个流程旨在提高评分和理由生成的可解释性和可靠性。

关键创新:该平台的主要创新在于:1) 整合多个LLM,利用其多样性来提高评分和理由生成的准确性和鲁棒性;2) 创新的可视化设计,能够清晰地展示答案的关键信息和理由依据,方便用户理解;3) 集成交互式标注和评估工具,允许人工干预和验证,从而提高理由的质量和可信度。

关键设计:论文未详细描述具体的参数设置、损失函数或网络结构等技术细节。平台的核心在于整合多个LLM,并提供交互式界面,方便用户进行标注和评估。具体使用的LLM模型和可视化方法可能根据实际应用场景进行选择和调整。标注工具的设计需要考虑用户体验,确保易用性和高效性。

🖼️ 关键图片

📊 实验亮点

论文通过在多个数据集上评估多种理由生成方法,证明了AERA Chat平台的有效性。具体性能数据和对比基线未在摘要中给出,但强调了该平台能够促进稳健的理由评估和比较分析,表明其在提高理由质量和可信度方面具有潜力。

🎯 应用场景

AERA Chat平台可应用于在线教育、智能阅卷、教学辅助等领域。它可以帮助教师更高效地评估学生答案,并提供可解释的评分理由,从而提高教学质量和学生的学习效果。此外,该平台还可以用于研究不同大型语言模型在教育领域的应用,促进自然语言处理技术在教育领域的进一步发展。

📄 摘要(原文)

Explainability in automated student answer scoring systems is critical for building trust and enhancing usability among educators. Yet, generating high-quality assessment rationales remains challenging due to the scarcity of annotated data and the prohibitive cost of manual verification, prompting heavy reliance on rationales produced by large language models (LLMs), which are often noisy and unreliable. To address these limitations, we present AERA Chat, an interactive visualization platform designed for automated explainable student answer assessment. AERA Chat leverages multiple LLMs to concurrently score student answers and generate explanatory rationales, offering innovative visualization features that highlight critical answer components and rationale justifications. The platform also incorporates intuitive annotation and evaluation tools, supporting educators in marking tasks and researchers in evaluating rationale quality from different models. We demonstrate the effectiveness of our platform through evaluations of multiple rationale-generation methods on several datasets, showcasing its capability for facilitating robust rationale evaluation and comparative analysis.