StructRAG: Boosting Knowledge Intensive Reasoning of LLMs via Inference-time Hybrid Information Structurization

作者: Zhuoqun Li, Xuanang Chen, Haiyang Yu, Hongyu Lin, Yaojie Lu, Qiaoyu Tang, Fei Huang, Xianpei Han, Le Sun, Yongbin Li

分类: cs.CL, cs.AI

发布日期: 2024-10-11 (更新: 2024-10-25)

💡 一句话要点

StructRAG:通过推理时混合信息结构化增强LLM的知识密集型推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 知识密集型推理 信息结构化 大型语言模型 认知推理

📋 核心要点

- 现有RAG方法难以应对知识密集型推理任务,因为相关信息分散,难以准确识别和全局推理。

- StructRAG框架通过识别最佳结构类型,将原始文档重构为结构化格式,并基于此结构进行推理。

- 实验表明,StructRAG在知识密集型任务中取得了SOTA性能,尤其在复杂场景下表现突出。

📝 摘要(中文)

检索增强生成(RAG)是有效增强大型语言模型(LLM)在许多基于知识的任务中的关键手段。然而,现有的RAG方法在知识密集型推理任务中表现不佳,因为完成这些任务所需的有用信息非常分散。这种特性使得现有的RAG方法难以准确识别关键信息,并使用这种嘈杂的增强信息进行全局推理。本文受到认知理论的启发,即人类在处理知识密集型推理时会将原始信息转换为各种结构化知识,提出了一种新的框架StructRAG,它可以识别适合当前任务的最佳结构类型,将原始文档重构为这种结构化格式,并基于生成的结构推断答案。在各种知识密集型任务中进行的大量实验表明,StructRAG实现了最先进的性能,尤其是在具有挑战性的场景中表现出色,证明了其作为增强LLM在复杂现实世界应用中的有效解决方案的潜力。

🔬 方法详解

问题定义:论文旨在解决现有检索增强生成(RAG)方法在知识密集型推理任务中的不足。现有方法难以从分散的信息中准确识别关键信息,并进行有效的全局推理,导致性能下降。这些方法无法有效地将原始信息转化为结构化知识,从而限制了LLM的推理能力。

核心思路:StructRAG的核心思路是模拟人类认知过程,将原始文档转换为结构化知识,以便LLM更好地进行推理。通过在推理时动态地将信息组织成最适合任务的结构,StructRAG能够更有效地利用检索到的信息,提高推理的准确性和效率。

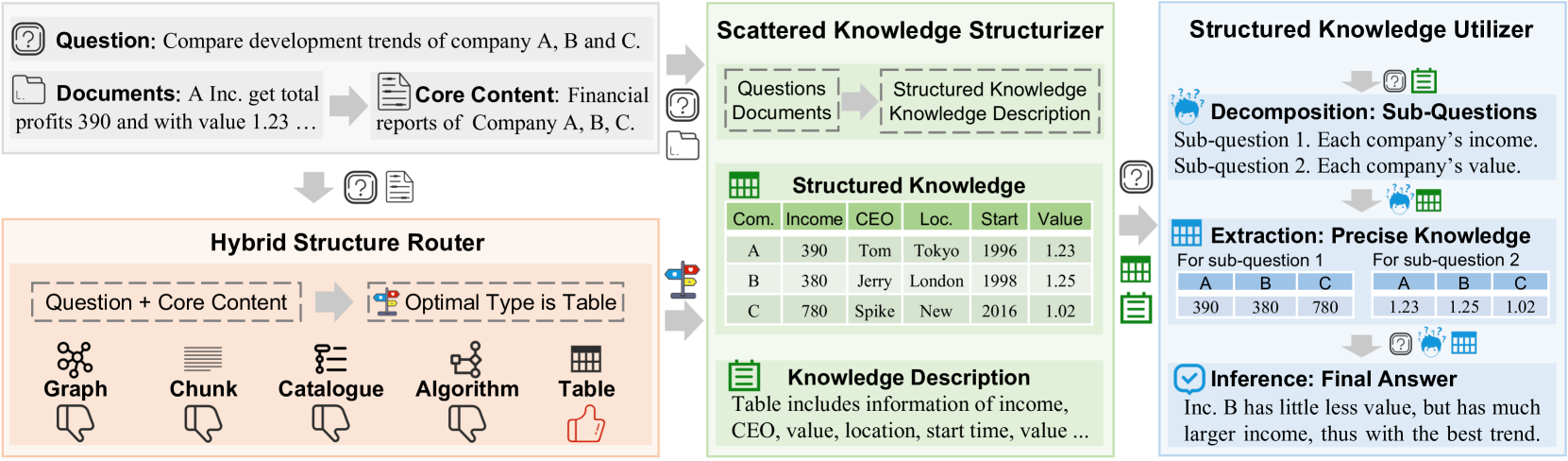

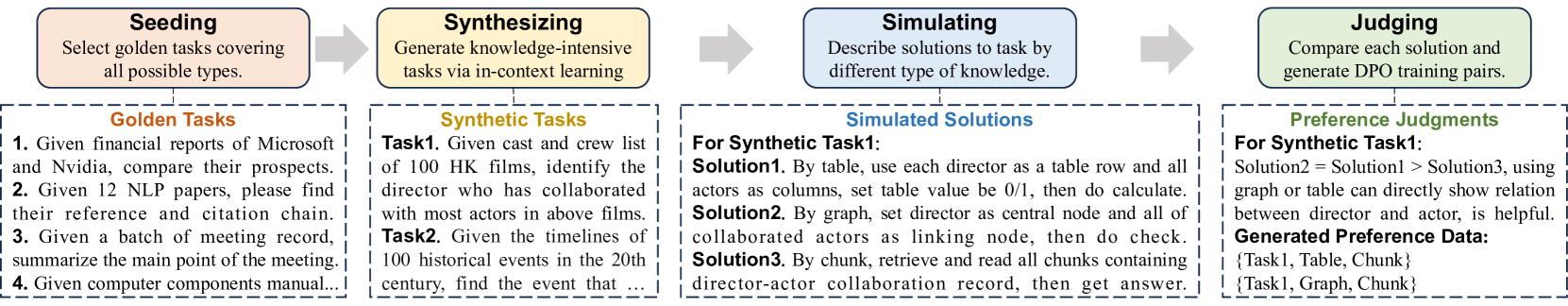

技术框架:StructRAG框架包含以下主要模块:1) 结构类型识别:根据任务特点,自动识别最佳的结构类型(例如,列表、表格、图等)。2) 文档重构:将原始文档转换为选定的结构化格式。3) 结构化推理:基于重构后的结构化知识,利用LLM进行推理,生成答案。整个流程在推理时动态进行,无需预先对所有文档进行结构化。

关键创新:StructRAG的关键创新在于推理时混合信息结构化的概念。与传统RAG方法直接使用原始文档或预定义的结构不同,StructRAG能够根据任务动态地选择和构建最合适的结构。这种动态结构化方法能够更好地适应不同任务的需求,提高知识利用率和推理性能。

关键设计:StructRAG的具体实现细节包括:1) 使用LLM进行结构类型识别,通过prompt工程引导LLM选择合适的结构。2) 设计了特定的文档重构算法,将原始文档转换为选定的结构化格式,例如使用关系抽取模型构建知识图谱。3) 在结构化推理阶段,利用LLM进行多步推理,并结合结构信息进行约束和引导。具体的参数设置和损失函数选择取决于具体的任务和数据集。

🖼️ 关键图片

📊 实验亮点

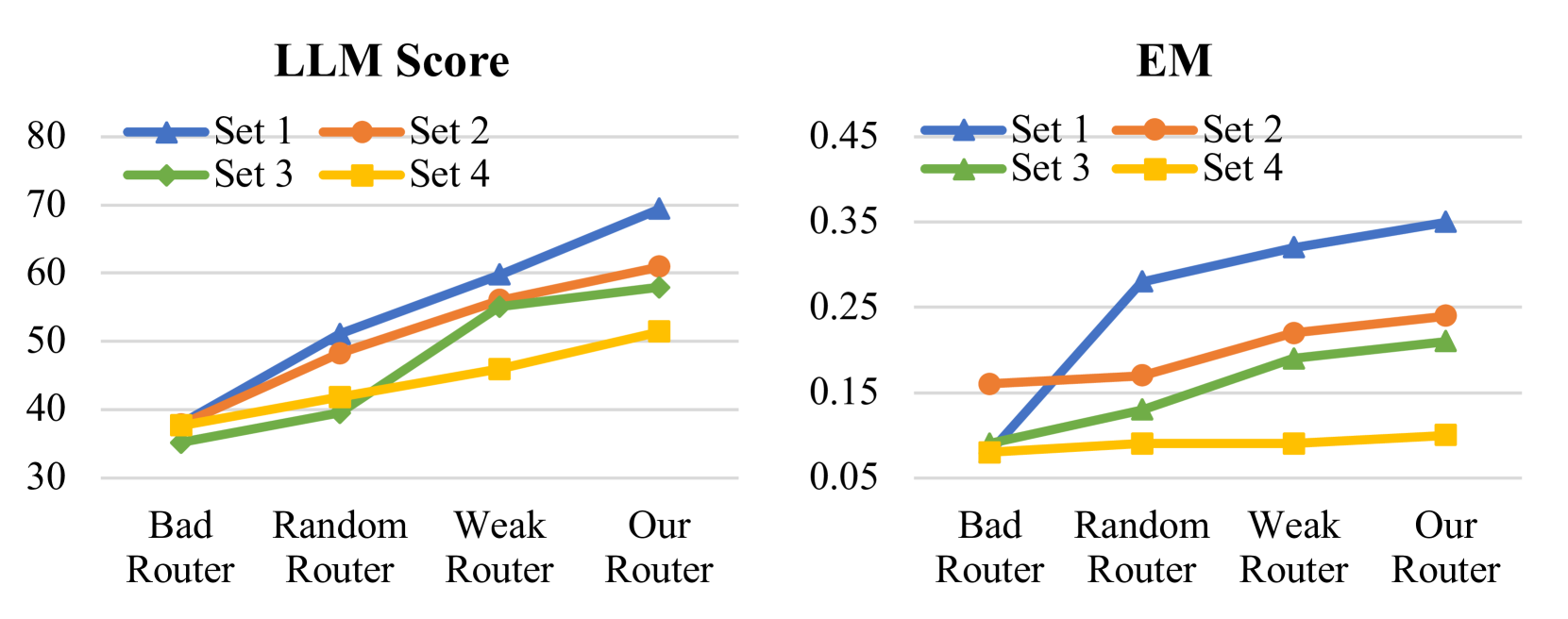

实验结果表明,StructRAG在多个知识密集型任务上取得了显著的性能提升,达到了SOTA水平。例如,在某些任务上,StructRAG的准确率比现有RAG方法提高了10%以上。尤其是在需要复杂推理的场景下,StructRAG的优势更加明显。实验还验证了StructRAG在不同结构类型下的有效性,证明了其动态结构化能力的优越性。

🎯 应用场景

StructRAG可应用于各种知识密集型任务,例如问答系统、知识图谱构建、智能文档处理等。它能够提升LLM在复杂推理场景下的性能,具有广泛的应用前景。例如,在金融领域,可以用于分析复杂的财务报表;在医疗领域,可以用于辅助诊断和治疗方案制定。StructRAG的动态结构化能力使其能够适应不同领域的知识特点,具有很高的实用价值。

📄 摘要(原文)

Retrieval-augmented generation (RAG) is a key means to effectively enhance large language models (LLMs) in many knowledge-based tasks. However, existing RAG methods struggle with knowledge-intensive reasoning tasks, because useful information required to these tasks are badly scattered. This characteristic makes it difficult for existing RAG methods to accurately identify key information and perform global reasoning with such noisy augmentation. In this paper, motivated by the cognitive theories that humans convert raw information into various structured knowledge when tackling knowledge-intensive reasoning, we proposes a new framework, StructRAG, which can identify the optimal structure type for the task at hand, reconstruct original documents into this structured format, and infer answers based on the resulting structure. Extensive experiments across various knowledge-intensive tasks show that StructRAG achieves state-of-the-art performance, particularly excelling in challenging scenarios, demonstrating its potential as an effective solution for enhancing LLMs in complex real-world applications.