Semantic Self-Consistency: Enhancing Language Model Reasoning via Semantic Weighting

作者: Tim Knappe, Ryan Li, Ayush Chauhan, Kaylee Chhua, Kevin Zhu, Sean O'Brien

分类: cs.CL

发布日期: 2024-10-10 (更新: 2025-01-28)

备注: Accepted to MATH-AI at NeurIPS 2024

💡 一句话要点

提出语义自洽性方法,通过语义加权增强语言模型推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型 推理能力 自洽性 语义信息 语义相似度

📋 核心要点

- 现有自洽性方法忽略了推理路径中的语义信息,导致推理能力受限。

- 提出语义自洽性方法,通过语义加权,更有效地利用推理路径信息。

- 实验表明,该方法提高了推理路径的可靠性,并在复杂推理任务中表现出更强的鲁棒性。

📝 摘要(中文)

大型语言模型(LLMs)在各种任务上的性能迅速提升,但在推理任务中仍存在不足。随着LLMs在各种实际任务中的集成度越来越高,提升其推理能力对于解决复杂问题至关重要。Wang等人提出的自洽性框架表明,在进行多数投票之前,对多个推理路径进行采样可以可靠地提高模型在各种闭卷问答推理任务中的性能。基于该框架的标准方法聚合这些推理路径的最终决策,但未能利用逐步推理路径中详细的语义信息。本文提出了语义自洽性,通过结合和分析这些推理路径的推理过程及其最终决策,增强了这种方法,然后再进行多数投票。这些方法不仅提高了推理路径的可靠性,而且在复杂的推理任务中表现出更强的鲁棒性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在复杂推理任务中表现不足的问题。现有自洽性方法虽然通过采样多个推理路径并进行多数投票来提高性能,但忽略了推理路径中蕴含的丰富语义信息,仅依赖最终决策进行聚合,导致信息利用率不高,推理结果可能不够准确。

核心思路:论文的核心思路是引入语义信息,对不同的推理路径进行加权。具体来说,就是不仅考虑每个推理路径的最终答案,还考虑其推理过程中的语义内容,通过分析推理路径的语义相似性,赋予更合理的权重,从而提高最终决策的准确性。这样设计的目的是为了更充分地利用模型生成的推理过程,提高模型对复杂问题的理解和解决能力。

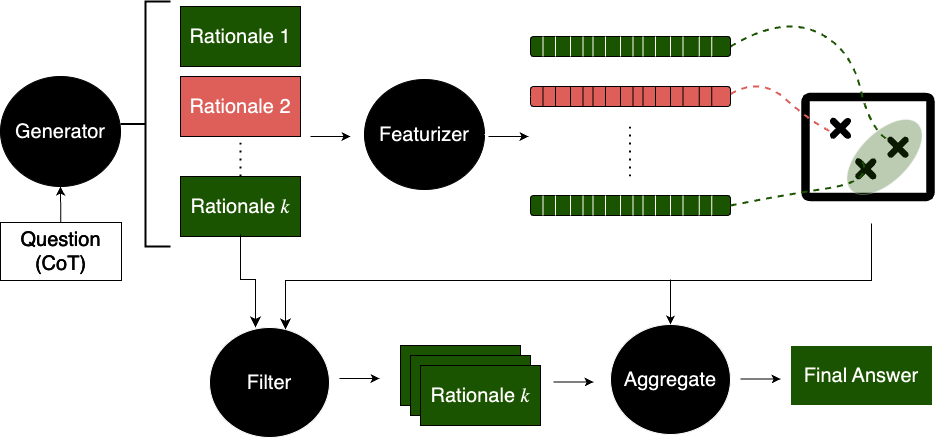

技术框架:整体框架可以分为以下几个阶段:1) 使用语言模型生成多个推理路径;2) 提取每个推理路径的语义信息(具体方法未知);3) 计算不同推理路径之间的语义相似度;4) 基于语义相似度对推理路径进行加权;5) 根据加权后的推理路径进行多数投票,得到最终答案。

关键创新:最重要的创新点在于将语义信息融入到自洽性框架中。与传统方法仅关注最终答案不同,该方法充分利用了推理过程中的语义信息,通过语义相似度来评估不同推理路径的质量,并进行加权,从而提高了推理的可靠性和鲁棒性。

关键设计:论文的关键设计在于如何提取和利用推理路径的语义信息,以及如何根据语义相似度进行加权。具体的语义信息提取方法和加权策略未知,但可以推测可能使用了诸如句子嵌入、语义角色标注等技术来表示和比较推理路径的语义内容。加权策略可能采用了基于相似度分数的归一化方法,使得相似度高的推理路径获得更高的权重。

🖼️ 关键图片

📊 实验亮点

论文提出了语义自洽性方法,通过利用推理路径的语义信息,提高了语言模型在复杂推理任务中的性能。虽然具体的实验数据未知,但摘要中提到该方法提高了推理路径的可靠性,并在复杂推理任务中表现出更强的鲁棒性。与传统的自洽性方法相比,该方法能够更有效地利用模型生成的推理过程,从而获得更准确的推理结果。

🎯 应用场景

该研究成果可应用于各种需要复杂推理能力的场景,例如智能客服、自动问答系统、医疗诊断辅助、金融风险评估等。通过提高语言模型的推理能力,可以使其更好地理解和解决现实世界中的复杂问题,从而提升相关应用的智能化水平和实用价值。未来,该方法有望进一步扩展到其他类型的推理任务和语言模型中。

📄 摘要(原文)

While large language models (LLMs) have rapidly improved their performance on a broad number of tasks, they still often fall short on reasoning tasks. As LLMs become more integrated in diverse real-world tasks, advancing their reasoning capabilities is crucial to their effectiveness in nuanced, complex problems. Wang et al.'s self-consistency framework reveals that sampling multiple rationales before taking a majority vote reliably improves model performance across various closed-answer reasoning tasks. Standard methods based on this framework aggregate the final decisions of these rationales but fail to utilize the semantic information detailed in the step-by-step reasoning paths. Our work introduces semantic self-consistency, enhancing this approach by incorporating and analyzing both the reasoning paths of these rationales in addition to their final decisions before taking a majority vote. These methods not only improve the reliability of reasoning paths but also cause more robust performance on complex reasoning tasks.