No Free Lunch: Retrieval-Augmented Generation Undermines Fairness in LLMs, Even for Vigilant Users

作者: Mengxuan Hu, Hongyi Wu, Zihan Guan, Ronghang Zhu, Dongliang Guo, Daiqing Qi, Sheng Li

分类: cs.IR, cs.CL

发布日期: 2024-10-10

💡 一句话要点

RAG增强大语言模型在提升性能的同时,可能损害公平性,即使对于有防范意识的用户。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 大语言模型 公平性 偏见 威胁模型

📋 核心要点

- 现有RAG方法在提升LLM性能的同时,忽略了可能引入或加剧的公平性问题,尤其是在用户对公平性有不同程度认知的情况下。

- 该研究从用户公平意识出发,构建三级威胁模型,分析不同审查程度的数据集对RAG公平性的影响,揭示了RAG潜在的公平性风险。

- 实验表明,即使使用经过审查的无偏数据集,RAG仍可能产生偏差输出,表明现有对齐方法在RAG场景下存在局限性。

📝 摘要(中文)

检索增强生成(RAG)因其在缓解大语言模型(LLM)的幻觉问题和增强领域特定生成能力方面的有效性和成本效益而被广泛采用。然而,这种有效性和成本效益真的是免费的午餐吗?在本研究中,我们通过提出一个从用户公平意识角度出发的实用的三级威胁模型,全面地研究了与RAG相关的公平性成本。具体来说,不同程度的用户公平意识会导致对外部数据集进行不同程度的公平性审查。我们使用未审查、部分审查和完全审查的数据集来检验RAG的公平性影响。我们的实验表明,无需微调或重新训练,通过RAG可以很容易地破坏公平性对齐。即使使用完全审查且据称无偏的外部数据集,RAG也可能导致有偏见的输出。我们的发现强调了当前对齐方法在基于RAG的LLM中的局限性,并突出了对新策略以确保公平性的迫切需求。我们提出了潜在的缓解措施,并呼吁进一步研究以开发基于RAG的LLM中强大的公平性保障。

🔬 方法详解

问题定义:论文旨在研究检索增强生成(RAG)框架在应用于大型语言模型(LLM)时,对公平性的潜在负面影响。现有方法通常关注RAG在提升生成质量和减少幻觉方面的优势,而忽略了其可能引入或加剧偏见,从而损害公平性的问题。尤其是在用户对公平性有不同程度的意识和审查能力时,RAG的公平性风险更加复杂。

核心思路:论文的核心思路是构建一个三级威胁模型,模拟不同公平意识水平的用户对外部数据集的审查程度,并分析这些不同审查程度的数据集如何影响RAG的公平性表现。通过这种方式,研究揭示了RAG在不同场景下可能存在的公平性风险,并强调了现有对齐方法在RAG框架下的局限性。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 构建三级威胁模型,定义用户对公平性的不同意识水平(未审查、部分审查、完全审查);2) 准备不同审查程度的外部数据集,模拟不同用户场景;3) 使用RAG框架增强LLM,并使用这些数据集进行生成;4) 评估生成结果的公平性,分析RAG对公平性的影响。

关键创新:该研究的关键创新在于:1) 提出了一个从用户公平意识角度出发的三级威胁模型,更贴近实际应用场景;2) 系统地研究了不同审查程度的数据集对RAG公平性的影响,揭示了RAG潜在的公平性风险;3) 强调了现有对齐方法在RAG框架下的局限性,并呼吁开发新的公平性保障策略。

关键设计:论文的关键设计包括:1) 三级威胁模型的具体定义,如何量化用户的公平意识;2) 数据集的审查方法,如何模拟不同程度的公平性审查;3) 公平性评估指标的选择,如何客观地衡量生成结果的公平性;4) RAG框架的具体实现,包括检索策略、生成模型等。

🖼️ 关键图片

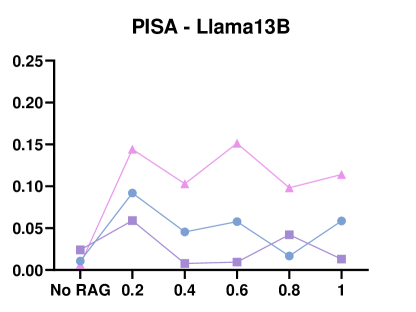

📊 实验亮点

实验结果表明,即使使用完全审查且据称无偏的外部数据集,RAG仍然可能导致有偏见的输出。这表明现有的对齐方法在RAG框架下存在局限性,无法有效防止偏见的传播。该研究强调了在RAG系统中实施更强大的公平性保障措施的必要性,并为未来的研究方向提供了指导。

🎯 应用场景

该研究成果对RAG在各个领域的应用具有重要意义,尤其是在涉及敏感信息或需要高度公平性的场景,如医疗诊断、法律咨询、金融服务等。通过提高人们对RAG潜在公平性风险的认识,并开发相应的缓解措施,可以确保RAG技术在提升效率的同时,不会加剧社会不公,从而促进负责任的人工智能发展。

📄 摘要(原文)

Retrieval-Augmented Generation (RAG) is widely adopted for its effectiveness and cost-efficiency in mitigating hallucinations and enhancing the domain-specific generation capabilities of large language models (LLMs). However, is this effectiveness and cost-efficiency truly a free lunch? In this study, we comprehensively investigate the fairness costs associated with RAG by proposing a practical three-level threat model from the perspective of user awareness of fairness. Specifically, varying levels of user fairness awareness result in different degrees of fairness censorship on the external dataset. We examine the fairness implications of RAG using uncensored, partially censored, and fully censored datasets. Our experiments demonstrate that fairness alignment can be easily undermined through RAG without the need for fine-tuning or retraining. Even with fully censored and supposedly unbiased external datasets, RAG can lead to biased outputs. Our findings underscore the limitations of current alignment methods in the context of RAG-based LLMs and highlight the urgent need for new strategies to ensure fairness. We propose potential mitigations and call for further research to develop robust fairness safeguards in RAG-based LLMs.