MINER: Mining the Underlying Pattern of Modality-Specific Neurons in Multimodal Large Language Models

作者: Kaichen Huang, Jiahao Huo, Yibo Yan, Kun Wang, Yutao Yue, Xuming Hu

分类: cs.CL

发布日期: 2024-10-07

💡 一句话要点

提出MINER框架以解决多模态大语言模型的可解释性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 可解释性 模态特定神经元 神经网络 模型性能

📋 核心要点

- 现有的多模态大语言模型缺乏可解释性,限制了其在需要透明决策的场景中的应用。

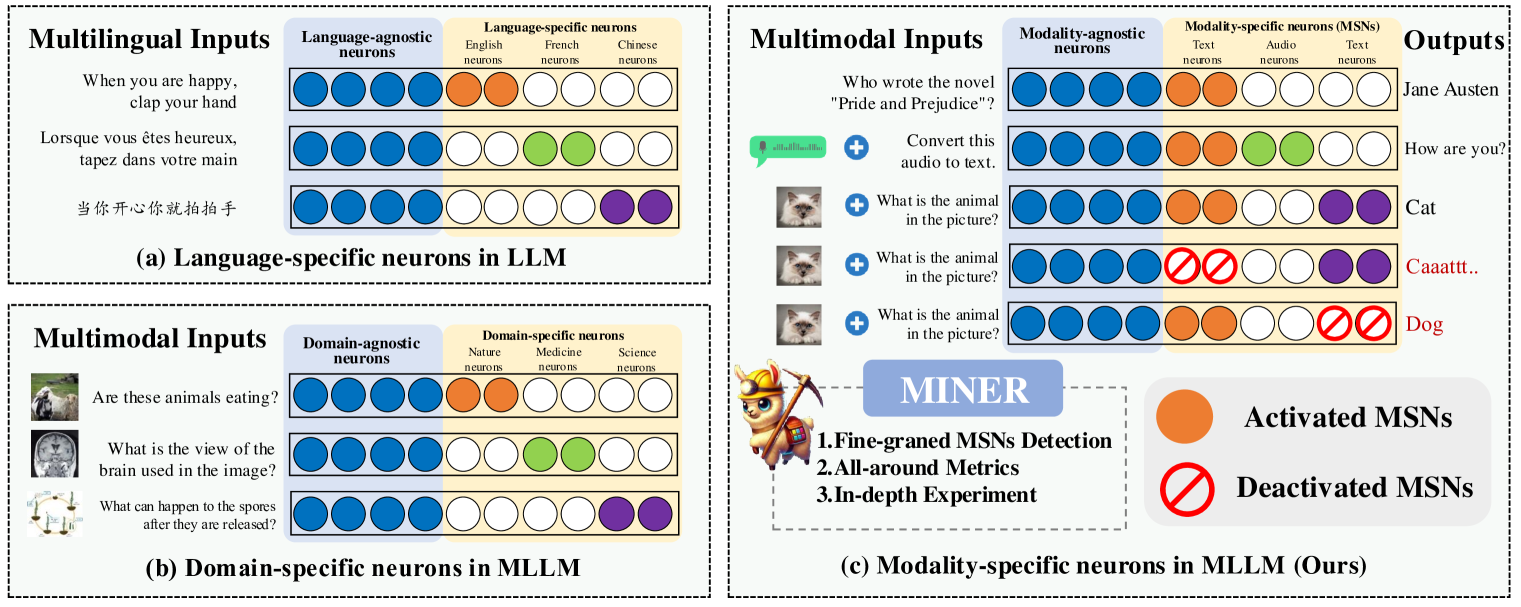

- 本文提出MINER框架,通过四个阶段挖掘模态特定神经元,以提高模型的可解释性。

- 实验结果显示,仅停用2%的MSNs就能显著降低模型性能,且不同模态在低层收敛,揭示了MSNs的重要性。

📝 摘要(中文)

近年来,多模态大语言模型(MLLMs)取得了显著进展,能够将多种模态整合到不同应用中。然而,缺乏可解释性仍然是其在需要决策透明度场景中应用的主要障碍。现有的神经元级解释方法主要集中于知识定位或语言和领域特定分析,未能充分探索多模态性。为了解决这些挑战,本文提出了MINER,一个可迁移的框架,用于挖掘MLLMs中的模态特定神经元(MSNs),该框架包括四个阶段:模态分离、重要性评分计算、重要性评分聚合和模态特定神经元选择。通过在六个基准和两个代表性MLLMs上的广泛实验,结果表明:仅停用2%的MSNs显著降低了MLLMs的性能,且不同模态主要在低层收敛,MSNs影响不同模态关键信息如何汇聚到最后一个token。

🔬 方法详解

问题定义:本文旨在解决多模态大语言模型的可解释性问题,现有方法主要关注知识定位,未能有效探索模态特定神经元的作用。

核心思路:MINER框架通过模态分离和重要性评分计算,识别和选择对模型性能影响最大的模态特定神经元,从而提升可解释性。

技术框架:MINER框架包括四个主要阶段:1) 模态分离,2) 重要性评分计算,3) 重要性评分聚合,4) 模态特定神经元选择。每个阶段都有明确的目标和方法。

关键创新:MINER的创新在于其可迁移性和对模态特定神经元的系统挖掘,填补了现有方法在多模态性探索上的空白。

关键设计:在重要性评分计算中,采用了特定的评分算法,确保评分的准确性和有效性,同时在模态分离阶段使用了先进的分离技术,以提高后续分析的精度。

🖼️ 关键图片

📊 实验亮点

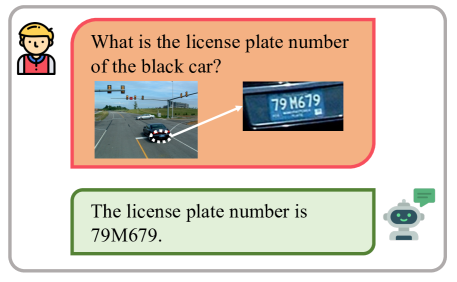

实验结果显示,仅停用2%的模态特定神经元(MSNs)就能使Qwen2-VL模型的性能从0.56降至0.24,Qwen2-Audio模型的性能从0.69降至0.31,表明MSNs在模型性能中的关键作用。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、计算机视觉和人机交互等。通过提高多模态大语言模型的可解释性,MINER能够帮助开发更透明的AI系统,增强用户信任,并促进在医疗、金融等关键领域的应用。

📄 摘要(原文)

In recent years, multimodal large language models (MLLMs) have significantly advanced, integrating more modalities into diverse applications. However, the lack of explainability remains a major barrier to their use in scenarios requiring decision transparency. Current neuron-level explanation paradigms mainly focus on knowledge localization or language- and domain-specific analyses, leaving the exploration of multimodality largely unaddressed. To tackle these challenges, we propose MINER, a transferable framework for mining modality-specific neurons (MSNs) in MLLMs, which comprises four stages: (1) modality separation, (2) importance score calculation, (3) importance score aggregation, (4) modality-specific neuron selection. Extensive experiments across six benchmarks and two representative MLLMs show that (I) deactivating ONLY 2% of MSNs significantly reduces MLLMs performance (0.56 to 0.24 for Qwen2-VL, 0.69 to 0.31 for Qwen2-Audio), (II) different modalities mainly converge in the lower layers, (III) MSNs influence how key information from various modalities converges to the last token, (IV) two intriguing phenomena worth further investigation, i.e., semantic probing and semantic telomeres. The source code is available at this URL.