Can LLMs Improve Multimodal Fact-Checking by Asking Relevant Questions?

作者: Alimohammad Beigi, Bohan Jiang, Dawei Li, Zhen Tan, Pouya Shaeri, Tharindu Kumarage, Amrita Bhattacharjee, Huan Liu

分类: cs.CL

发布日期: 2024-10-06 (更新: 2025-02-20)

💡 一句话要点

提出LRQ-FACT框架,利用LLM生成相关问题以提升多模态事实核查效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态事实核查 大型语言模型 问题生成 证据检索 信息验证

📋 核心要点

- 现有事实核查依赖人工构建问题,效率低且成本高,LLM虽能自动化证据检索,但缺乏有效的问题生成机制。

- LRQ-FACT框架利用LLM自动生成相关的事实核查问题,引导证据检索,从而提升多模态事实核查的准确性。

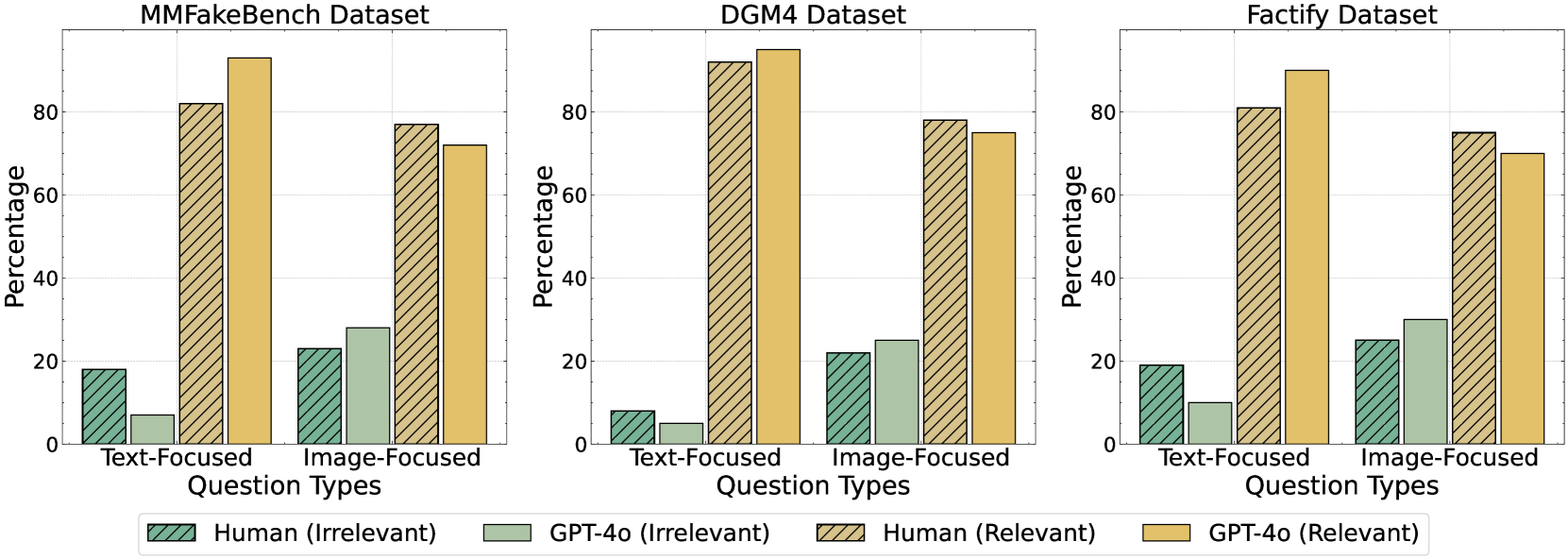

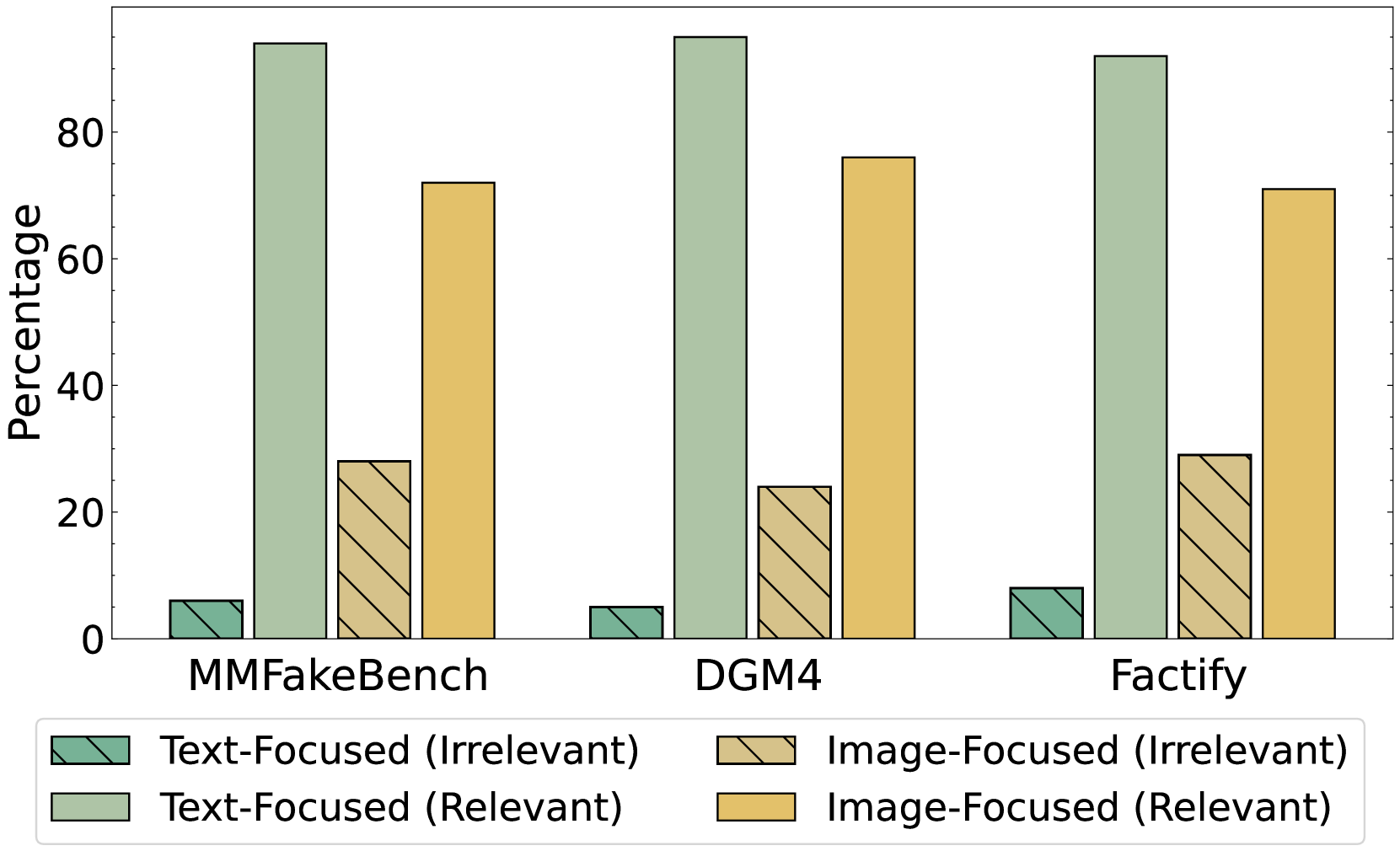

- 实验结果表明,LRQ-FACT能够生成不同类型的相关问题,并在多模态事实核查任务中显著优于现有基线方法。

📝 摘要(中文)

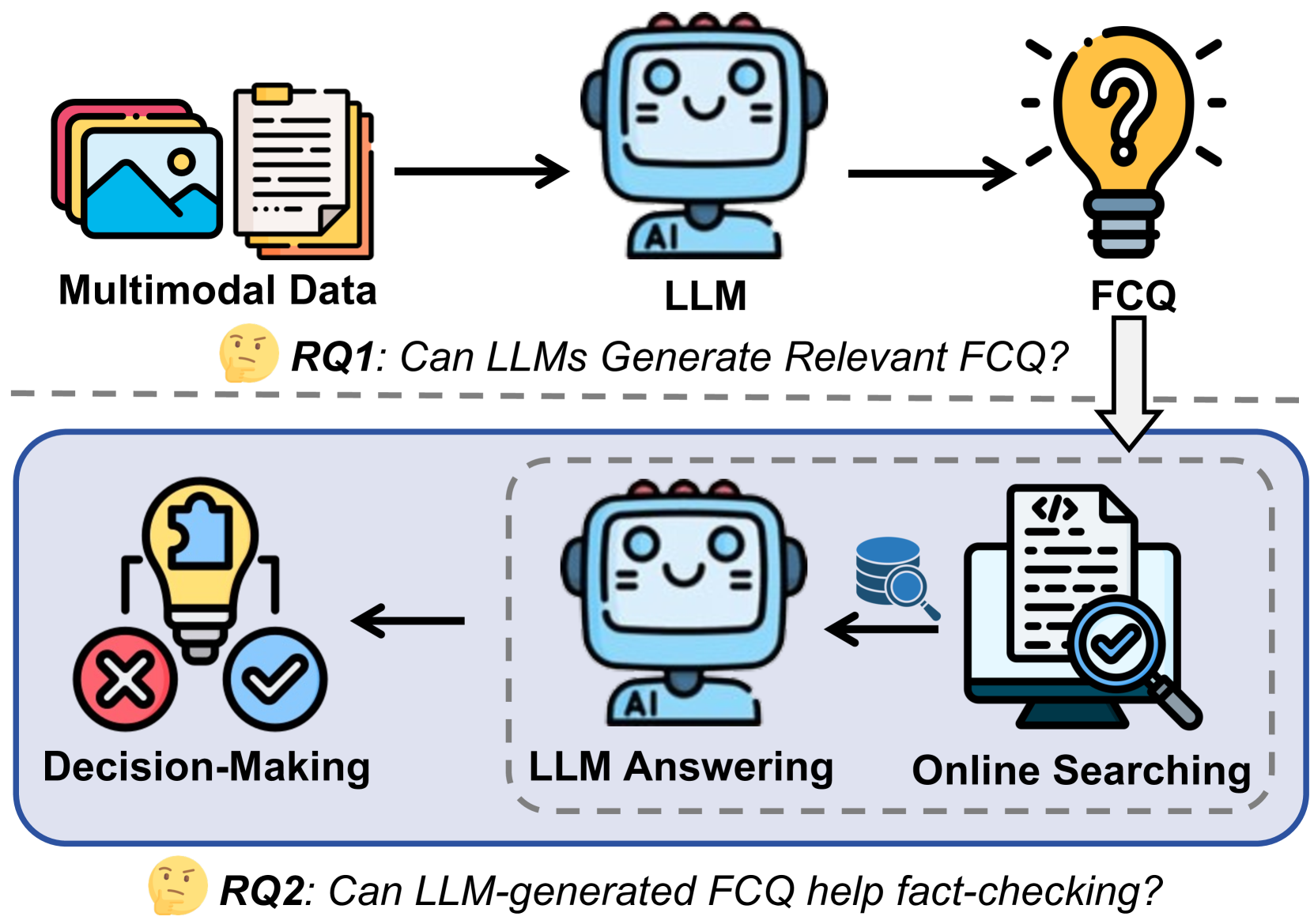

传统的事实核查依赖于人工构建相关且有针对性的事实核查问题(FCQ),搜索证据并验证声明的真实性。虽然大型语言模型(LLM)已被广泛用于大规模自动化证据检索和事实性验证,但由于缺乏FCQ构建,其在事实核查方面的有效性受到限制。为了弥合这一差距,我们旨在回答两个研究问题:(1)LLM能否生成相关的FCQ?(2)LLM生成的FCQ能否改善多模态事实核查?因此,我们引入了一个框架LRQ-FACT,该框架使用LLM生成相关的FCQ,以促进证据检索并通过探测跨多种模态的信息来增强事实核查。通过大量的实验,我们验证了LRQ-FACT是否可以生成不同类型的相关FCQ,以及LRQ-FACT是否可以在多模态事实核查中始终优于基线方法。进一步的分析说明了LRQ-FACT中的每个组件如何协同工作以提高事实核查性能。

🔬 方法详解

问题定义:论文旨在解决多模态事实核查中,缺乏有效的事实核查问题(FCQ)生成方法的问题。现有方法依赖人工构建FCQ,效率低下且成本高昂。即使利用LLM进行证据检索和事实性验证,也因缺乏高质量的FCQ而效果受限。

核心思路:论文的核心思路是利用LLM的强大生成能力,自动生成与待验证声明相关的FCQ。这些FCQ旨在引导证据检索过程,从而更有效地从多模态数据中提取相关信息,最终提升事实核查的准确性。通过让LLM主动提问,模拟人类专家进行事实核查的思维过程。

技术框架:LRQ-FACT框架包含以下主要模块:1) 问题生成模块:使用LLM根据待验证的声明生成一系列FCQ。2) 证据检索模块:利用生成的FCQ,从多模态数据源(例如文本、图像)中检索相关证据。3) 事实核查模块:基于检索到的证据,使用LLM或专门的模型来验证声明的真实性。整个流程通过迭代的方式进行,可以多次生成问题、检索证据和进行验证,以提高准确性。

关键创新:该论文的关键创新在于将LLM应用于FCQ的自动生成,并将其与多模态事实核查流程相结合。与传统方法相比,LRQ-FACT无需人工干预即可生成大量高质量的FCQ,从而显著提高了事实核查的效率和准确性。此外,该框架能够生成不同类型的FCQ,从而更全面地探测相关信息。

关键设计:论文中关于LLM的选择和prompt的设计是关键。具体使用的LLM型号未知,但prompt的设计需要引导LLM生成与声明相关的、可用于证据检索的FCQ。此外,证据检索模块需要针对不同的模态选择合适的检索方法。事实核查模块可以使用预训练的语言模型或专门训练的多模态事实核查模型。损失函数和网络结构等细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LRQ-FACT框架在多模态事实核查任务中显著优于基线方法。具体性能数据和提升幅度在摘要中未给出,属于未知信息。但论文强调,LRQ-FACT能够生成不同类型的相关问题,并能持续提升事实核查的性能。

🎯 应用场景

该研究成果可应用于新闻媒体的事实核查、社交媒体内容审核、虚假信息检测等领域。通过自动化生成相关问题并进行证据检索,可以显著提高事实核查的效率和准确性,从而减少虚假信息的传播,维护社会稳定。未来,该技术还可应用于教育、医疗等领域,辅助人们获取可靠的信息。

📄 摘要(原文)

Traditional fact-checking relies on humans to formulate relevant and targeted fact-checking questions (FCQs), search for evidence, and verify the factuality of claims. While Large Language Models (LLMs) have been commonly used to automate evidence retrieval and factuality verification at scale, their effectiveness for fact-checking is hindered by the absence of FCQ formulation. To bridge this gap, we seek to answer two research questions: (1) Can LLMs generate relevant FCQs? (2) Can LLM-generated FCQs improve multimodal fact-checking? We therefore introduce a framework LRQ-FACT for using LLMs to generate relevant FCQs to facilitate evidence retrieval and enhance fact-checking by probing information across multiple modalities. Through extensive experiments, we verify if LRQ-FACT can generate relevant FCQs of different types and if LRQ-FACT can consistently outperform baseline methods in multimodal fact-checking. Further analysis illustrates how each component in LRQ-FACT works toward improving the fact-checking performance.