ErrorRadar: Benchmarking Complex Mathematical Reasoning of Multimodal Large Language Models Via Error Detection

作者: Yibo Yan, Shen Wang, Jiahao Huo, Hang Li, Boyan Li, Jiamin Su, Xiong Gao, Yi-Fan Zhang, Tianlong Xu, Zhendong Chu, Aoxiao Zhong, Kun Wang, Hui Xiong, Philip S. Yu, Xuming Hu, Qingsong Wen

分类: cs.CL

发布日期: 2024-10-06 (更新: 2024-10-08)

💡 一句话要点

ErrorRadar:通过错误检测评估多模态大语言模型在复杂数学推理中的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 数学推理 错误检测 基准测试 智能教育

📋 核心要点

- 现有数学基准主要评估MLLM的问题解决能力,忽略了更复杂的错误检测场景,限制了对复杂推理能力的评估。

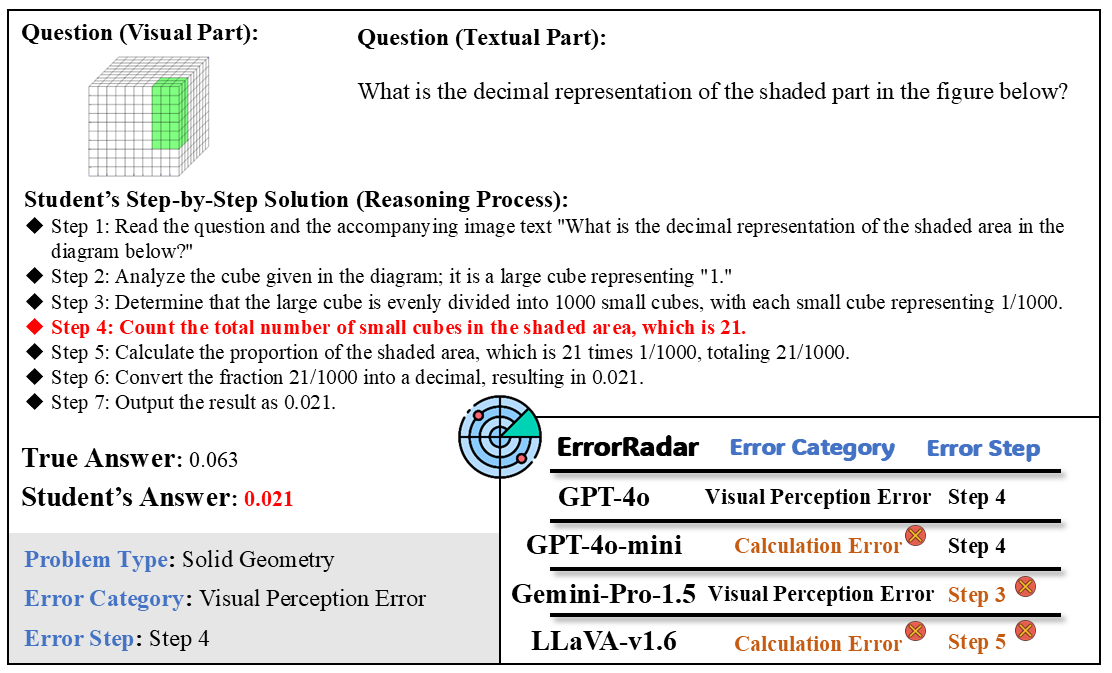

- ErrorRadar基准专注于多模态错误检测,包含错误步骤识别和错误分类两个子任务,全面评估MLLM的数学推理能力。

- 实验结果表明,即使是GPT-4o等先进的MLLM在错误检测任务中仍与人类专家存在差距,表明该领域仍有提升空间。

📝 摘要(中文)

随着多模态大语言模型(MLLMs)领域的不断发展,它们在人工智能领域具有巨大的潜力,尤其是在解决数学推理任务方面。当前的数学基准测试主要集中在评估MLLMs的问题解决能力,但在解决更复杂的场景(如错误检测)方面存在关键差距,这会影响复杂环境下的推理能力。为了填补这一空白,我们正式提出了多模态错误检测这一新任务,并推出了ErrorRadar,这是第一个旨在评估MLLMs在此类任务中能力的基准。ErrorRadar评估两个子任务:错误步骤识别和错误分类,为评估MLLMs的复杂数学推理能力提供了一个全面的框架。它包含2500个高质量的多模态K-12数学问题,这些问题来自教育机构中真实的师生互动,并经过严格的注释和丰富的元数据(如问题类型和错误类别)。通过广泛的实验,我们评估了开源和闭源的代表性MLLMs,并将它们的性能与教育专家评估员进行了比较。结果表明,仍然存在重大挑战,性能最佳的GPT-4o仍然落后于人类评估约10%。该数据集将在接收后提供。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLMs)在复杂数学推理中错误检测能力不足的问题。现有数学基准测试主要关注问题解决能力,忽略了在复杂场景下识别和分类错误的能力,这限制了对MLLMs推理能力的全面评估。因此,论文提出了多模态错误检测这一新任务,旨在更全面地评估MLLMs在复杂数学推理中的能力。

核心思路:论文的核心思路是构建一个专门用于评估MLLMs错误检测能力的基准数据集ErrorRadar。该数据集包含高质量的多模态K-12数学问题,这些问题来源于真实的师生互动,并经过了严格的标注,包括错误步骤的识别和错误类型的分类。通过在该数据集上评估MLLMs的性能,可以更准确地了解它们在复杂数学推理中的能力。

技术框架:ErrorRadar基准测试框架主要包含以下几个阶段:1) 数据收集:从教育机构收集真实师生互动产生的数学问题;2) 数据标注:由专家对问题进行标注,包括错误步骤的识别和错误类型的分类;3) 基准测试:使用ErrorRadar数据集评估各种MLLMs的性能,包括错误步骤识别和错误分类两个子任务;4) 性能分析:将MLLMs的性能与人类专家评估员进行比较,分析MLLMs在错误检测方面的优势和不足。

关键创新:论文的关键创新在于提出了多模态错误检测这一新任务,并构建了相应的基准数据集ErrorRadar。这是第一个专门用于评估MLLMs在复杂数学推理中错误检测能力的基准。与现有的数学基准测试相比,ErrorRadar更关注MLLMs在复杂场景下的推理能力,能够更全面地评估MLLMs的数学推理能力。

关键设计:ErrorRadar数据集包含2500个多模态K-12数学问题,涵盖多种问题类型和错误类别。每个问题都经过了严格的标注,包括错误步骤的识别和错误类型的分类。论文没有详细说明损失函数和网络结构等技术细节,但强调了数据集的质量和标注的准确性,以及与人类专家评估员的对比。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是性能最佳的GPT-4o在ErrorRadar基准测试中仍然落后于人类专家评估员约10%。这表明,尽管MLLMs在数学推理方面取得了显著进展,但在复杂场景下的错误检测能力仍有待提高。ErrorRadar为评估和改进MLLMs的复杂数学推理能力提供了一个有价值的工具。

🎯 应用场景

ErrorRadar的研究成果可应用于智能教育领域,例如开发能够自动检测学生作业错误的AI辅导系统,或者用于评估和改进MLLMs在数学教育中的应用。此外,该研究也为开发更可靠、更智能的AI系统提供了新的思路,这些系统需要在复杂环境中进行推理和决策。

📄 摘要(原文)

As the field of Multimodal Large Language Models (MLLMs) continues to evolve, their potential to revolutionize artificial intelligence is particularly promising, especially in addressing mathematical reasoning tasks. Current mathematical benchmarks predominantly focus on evaluating MLLMs' problem-solving ability, yet there is a crucial gap in addressing more complex scenarios such as error detection, for enhancing reasoning capability in complicated settings. To fill this gap, we formally formulate the new task: multimodal error detection, and introduce ErrorRadar, the first benchmark designed to assess MLLMs' capabilities in such a task. ErrorRadar evaluates two sub-tasks: error step identification and error categorization, providing a comprehensive framework for evaluating MLLMs' complex mathematical reasoning ability. It consists of 2,500 high-quality multimodal K-12 mathematical problems, collected from real-world student interactions in an educational organization, with rigorous annotation and rich metadata such as problem type and error category. Through extensive experiments, we evaluated both open-source and closed-source representative MLLMs, benchmarking their performance against educational expert evaluators. Results indicate significant challenges still remain, as GPT-4o with best performance is still around 10% behind human evaluation. The dataset will be available upon acceptance.