LongGenBench: Long-context Generation Benchmark

作者: Xiang Liu, Peijie Dong, Xuming Hu, Xiaowen Chu

分类: cs.CL, cs.AI

发布日期: 2024-10-05 (更新: 2024-10-24)

备注: EMNLP 2024 https://github.com/Dominic789654/LongGenBench

💡 一句话要点

提出LongGenBench,用于评估大型语言模型在长文本生成任务中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本生成 大型语言模型 基准测试 上下文理解 性能评估

📋 核心要点

- 现有长文本基准侧重检索,缺乏对LLM长文本生成能力的有效评估。

- 提出LongGenBench,一个可灵活配置上下文长度的合成基准,评估LLM生成连贯长文本答案的能力。

- 实验表明,API和开源LLM在LongGenBench上均出现性能下降,不同模型下降趋势各异。

📝 摘要(中文)

当前的长文本基准测试主要集中在基于检索的测试上,要求大型语言模型(LLM)在大量的输入上下文中定位特定信息,例如大海捞针(NIAH)基准。长文本生成是指语言模型生成连贯且上下文准确的文本的能力,这些文本跨越冗长的段落或文档。虽然最近的研究表明在NIAH和其他基于检索的长文本基准测试中表现出色,但非常缺乏用于评估长文本生成能力的基准测试。为了弥补这一差距并提供全面的评估,我们引入了一个合成基准测试LongGenBench,它允许灵活配置自定义生成上下文长度。LongGenBench通过重新设计问题的格式并要求LLM以单个、有凝聚力的长文本答案做出响应,从而超越了传统的基准测试。通过使用LongGenBench进行广泛的评估,我们观察到:(1)API访问和开源模型在长文本生成场景中都表现出性能下降,范围从1.2%到47.1%;(2)不同系列的LLM表现出不同的性能下降趋势,其中Gemini-1.5-Flash模型在API访问模型中表现出最小的下降,而Qwen2系列在开源模型中表现出LongGenBench中最小的下降。

🔬 方法详解

问题定义:现有长文本基准测试主要关注检索能力,例如大海捞针任务,而忽略了长文本生成能力。缺乏专门评估LLM生成连贯、上下文一致长文本的基准,阻碍了对LLM长文本理解和生成能力的全面评估。现有方法无法有效衡量LLM在复杂长文本生成场景下的性能。

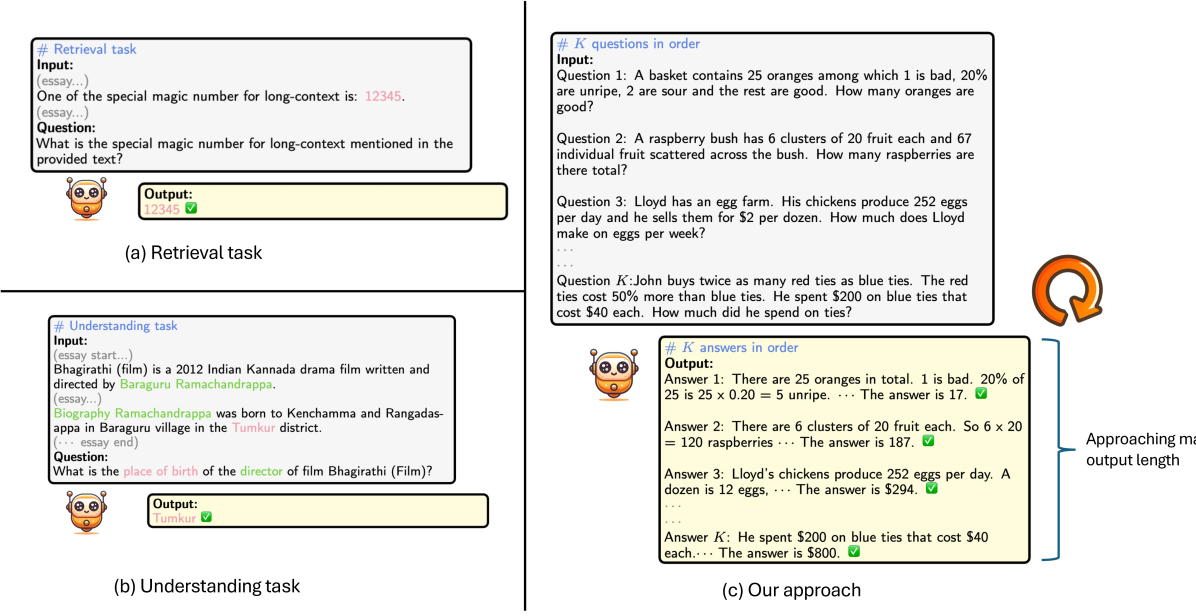

核心思路:LongGenBench的核心思路是构建一个合成的长文本生成基准,通过灵活配置上下文长度和重新设计问题格式,迫使LLM生成连贯且上下文相关的长文本答案。这种设计旨在更真实地模拟实际应用中LLM需要处理的长文本生成任务,从而更准确地评估LLM的长文本生成能力。

技术框架:LongGenBench是一个合成基准,其主要流程包括:1) 定义生成任务,包括上下文长度和问题类型;2) 生成相应的长文本上下文和问题;3) 使用LLM生成答案;4) 评估生成答案的质量。该基准允许灵活配置上下文长度,从而可以评估LLM在不同上下文长度下的性能表现。

关键创新:LongGenBench的关键创新在于其专注于长文本生成任务,并重新设计了问题格式,要求LLM生成单个、有凝聚力的长文本答案。这与传统的基于检索的基准测试形成对比,后者主要评估LLM在长文本中定位特定信息的能力。LongGenBench更侧重于评估LLM的生成能力和上下文理解能力。

关键设计:LongGenBench的关键设计包括:1) 可配置的上下文长度,允许评估LLM在不同上下文长度下的性能;2) 重新设计的问题格式,要求LLM生成长文本答案,而非简单的检索或分类;3) 使用合成数据,可以灵活控制数据的分布和难度,从而更好地评估LLM的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,API访问和开源LLM在LongGenBench上均出现性能下降,降幅从1.2%到47.1%不等。Gemini-1.5-Flash在API模型中表现出最小的性能下降,而Qwen2系列在开源模型中表现出最小的性能下降。这些结果揭示了现有LLM在长文本生成方面的局限性,并为未来的研究方向提供了启示。

🎯 应用场景

LongGenBench可用于评估和比较不同LLM在长文本生成任务中的性能,指导模型选择和优化。其结果有助于提升LLM在长文档摘要、故事生成、代码生成等领域的应用效果,推动长文本生成技术的进步,并为未来的长文本模型研究提供参考。

📄 摘要(原文)

Current long-context benchmarks primarily focus on retrieval-based tests, requiring Large Language Models (LLMs) to locate specific information within extensive input contexts, such as the needle-in-a-haystack (NIAH) benchmark. Long-context generation refers to the ability of a language model to generate coherent and contextually accurate text that spans across lengthy passages or documents. While recent studies show strong performance on NIAH and other retrieval-based long-context benchmarks, there is a significant lack of benchmarks for evaluating long-context generation capabilities. To bridge this gap and offer a comprehensive assessment, we introduce a synthetic benchmark, LongGenBench, which allows for flexible configurations of customized generation context lengths. LongGenBench advances beyond traditional benchmarks by redesigning the format of questions and necessitating that LLMs respond with a single, cohesive long-context answer. Upon extensive evaluation using LongGenBench, we observe that: (1) both API accessed and open source models exhibit performance degradation in long-context generation scenarios, ranging from 1.2% to 47.1%; (2) different series of LLMs exhibit varying trends of performance degradation, with the Gemini-1.5-Flash model showing the least degradation among API accessed models, and the Qwen2 series exhibiting the least degradation in LongGenBench among open source models.