BloomWise: Enhancing Problem-Solving capabilities of Large Language Models using Bloom's-Taxonomy-Inspired Prompts

作者: Maria-Eleni Zoumpoulidi, Georgios Paraskevopoulos, Alexandros Potamianos

分类: cs.CL

发布日期: 2024-10-05 (更新: 2025-08-07)

备注: 16 pages, 2 figures

💡 一句话要点

BloomWise:利用布鲁姆分类学提示增强大语言模型的问题解决能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 数学推理 布鲁姆分类学 提示工程 认知推理

📋 核心要点

- 现有大语言模型在数学推理方面仍面临挑战,缺乏有效的引导策略。

- BloomWise模仿人类认知过程,通过布鲁姆分类学指导模型逐步推理并生成可解释的答案。

- 实验表明,BloomWise在多个数学推理数据集上显著提升了模型性能,并进行了细致的消融分析。

📝 摘要(中文)

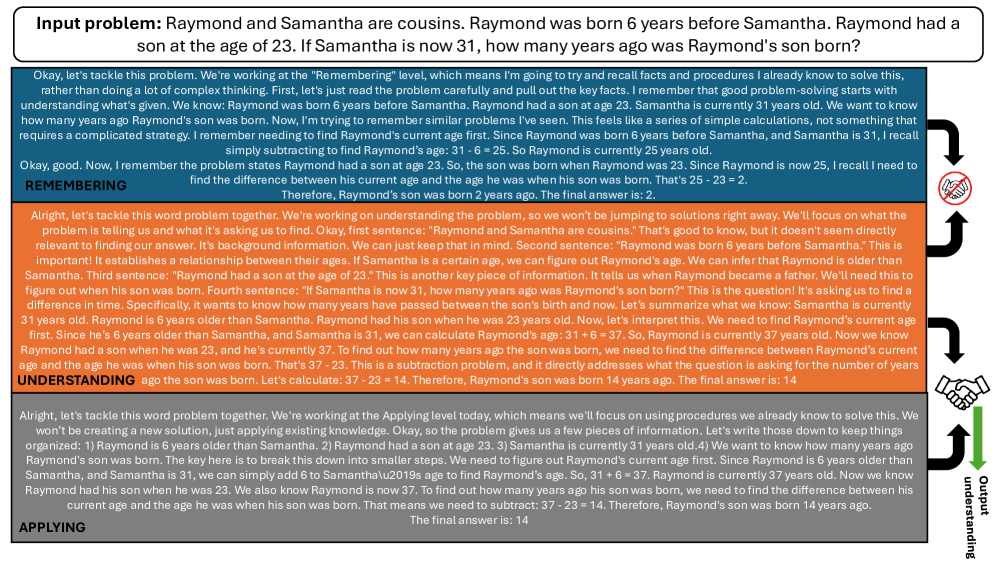

尽管大型语言模型(LLMs)在一系列任务中表现出卓越的能力,但数学推理仍然是一个具有挑战性的领域。受人类在被提示如何思考而非思考什么时能更有效地学习的启发,我们引入了BloomWise,这是一种认知启发式的提示技术,旨在提高LLMs在数学问题解决方面的性能,同时使其解决方案更具可解释性。BloomWise鼓励LLMs通过一系列认知操作(从基本的记忆到更高级的推理技能,如评估)来生成解决方案(以解释的形式),从而模仿人类建立理解的方式。该过程迭代地通过这些级别,如果满足收敛标准则提前停止:具体而言,如果两个或多个连续级别产生相同的答案,则输出最早级别的解决方案;否则,该过程将继续直到所有级别都完成。通过在五个流行的数学推理数据集上进行的大量实验,我们证明了BloomWise的有效性。我们还进行了全面的消融研究,以分析系统中每个组件的优势。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在数学推理问题上的不足。现有方法往往缺乏对模型推理过程的有效引导,导致结果不准确且缺乏可解释性。痛点在于如何让模型像人类一样,逐步构建对问题的理解并进行推理。

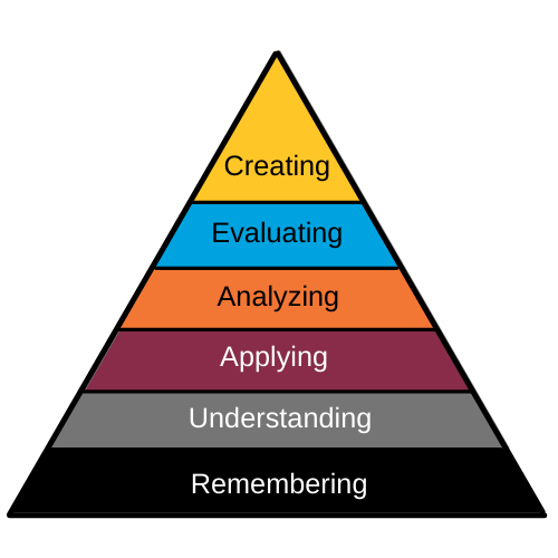

核心思路:论文的核心思路是借鉴布鲁姆分类学,将数学推理过程分解为一系列认知操作,从基础的记忆、理解到高级的分析、评估。通过提示模型逐步完成这些认知操作,引导模型进行更深入、更准确的推理。这种方法模仿了人类解决问题的认知过程,旨在提高模型推理的有效性和可解释性。

技术框架:BloomWise的技术框架主要包含以下几个阶段:1) 认知层级构建:基于布鲁姆分类学,定义一系列认知层级,例如记忆、理解、应用、分析、评估和创造。2) 提示生成:针对每个认知层级,设计相应的提示语,引导模型执行该层级的认知操作。3) 迭代推理:模型按照认知层级顺序,逐层生成答案。4) 收敛判断:在每个层级完成后,判断是否满足收敛条件(例如,连续两个层级生成相同的答案)。如果满足,则停止迭代,输出结果;否则,继续迭代到下一个层级。

关键创新:BloomWise的关键创新在于将布鲁姆分类学应用于大语言模型的提示工程中,通过认知层级引导模型进行逐步推理。与传统的提示方法相比,BloomWise更注重对模型推理过程的引导,使其能够像人类一样逐步构建对问题的理解,从而提高推理的准确性和可解释性。

关键设计:BloomWise的关键设计包括:1) 认知层级的划分:论文选择合适的布鲁姆分类学层级,并根据具体任务进行调整。2) 提示语的设计:针对每个认知层级,设计清晰、明确的提示语,引导模型执行相应的认知操作。3) 收敛条件的设定:选择合适的收敛条件,以平衡推理的准确性和效率。具体的参数设置、损失函数、网络结构等技术细节取决于所使用的大语言模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BloomWise在五个流行的数学推理数据集上显著提升了模型的性能。消融研究表明,BloomWise的每个组件都对最终性能有贡献。具体性能数据和对比基线在论文中有详细描述,证明了BloomWise的有效性。

🎯 应用场景

BloomWise可应用于各种需要数学推理能力的场景,例如自动解题、智能辅导系统、科学研究等。该方法能够提高模型在这些场景下的性能,并提供更具可解释性的解决方案。未来,BloomWise可以扩展到其他需要复杂推理的任务中,例如逻辑推理、常识推理等。

📄 摘要(原文)

Despite the remarkable capabilities of large language models (LLMs) across a range of tasks, mathematical reasoning remains a challenging frontier. Motivated by the observation that humans learn more effectively when prompted not what to think but how to think, we introduce BloomWise, a cognitively-inspired prompting technique designed to enhance LLMs' performance on mathematical problem solving while making their solutions more explainable. BloomWise encourages LLMs to generate solutions - in the form of explanations - by progressing through a sequence of cognitive operations-from basic (e.g., remembering) to more advanced reasoning skills (e.g., evaluating) - mirroring how humans build understanding. The process iterates through these levels, halting early if a convergence criterion is met: specifically, if two or more consecutive levels yield the same answer, the solution from the earliest such level is output; otherwise, the process continues until all levels are completed. Through extensive experiments across five popular math reasoning datasets, we demonstrate the effectiveness of BloomWise. We also present comprehensive ablation studies to analyze the strengths of each component within our system.