Re-examining Sexism and Misogyny Classification with Annotator Attitudes

作者: Aiqi Jiang, Nikolas Vitsakis, Tanvi Dinkar, Gavin Abercrombie, Ioannis Konstas

分类: cs.CL

发布日期: 2024-10-04

备注: Accepted by EMNLP 2024

💡 一句话要点

通过考察标注者态度,重新审视性别歧视和厌女症分类问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 性别歧视分类 厌女症检测 标注者态度 大型语言模型 自然语言处理

📋 核心要点

- 现有性别暴力数据集缺乏对标注者多样性视角的捕捉,影响了模型的泛化能力。

- 论文通过分析标注者的人口统计学和态度信息,探究其与标注行为之间的关联。

- 实验表明,融入标注者态度信息可以提升大型语言模型在性别歧视分类任务中的性能。

📝 摘要(中文)

性别暴力(GBV)在网络上日益严重,但现有数据集未能捕捉到标注者观点的多样性,也无法确保受影响群体的代表性。本文重新审视了GBV审核流程中的两个重要阶段:(1)人工数据标注;(2)自动分类。对于(1),我们研究了两个数据集,以调查标注者的身份和态度与他们对GBV标注任务的反应之间的关系。为此,我们使用社会心理学中三个经过验证的调查,从众包标注者那里收集人口统计学和态度信息。我们发现,较高的右翼威权主义得分与将文本标记为性别歧视的较高倾向相关,而对于社会支配取向和新性别歧视态度,较高的得分与这样做的负面倾向相关。对于(2),我们使用大型语言模型和五种提示策略(包括注入标注者信息的提示)进行分类实验。我们发现:(i)标注者态度会影响分类器预测其标签的能力;(ii)当我们使用结构良好的简短标注者描述时,包含态度信息可以提高性能;(iii)模型难以反映新标签集增加的复杂性和不平衡的类别。

🔬 方法详解

问题定义:现有性别歧视和厌女症分类数据集存在偏差,未能充分考虑标注者的主观态度和背景,导致模型在实际应用中表现不佳。现有方法通常假设标注者具有一致的认知,忽略了不同群体对性别歧视的理解差异。

核心思路:论文的核心思路是探究标注者的人口统计学特征、态度倾向与他们对文本的性别歧视判断之间的关系。通过量化标注者的主观态度,并将其融入到分类模型的训练过程中,从而提高模型对不同观点的适应性和鲁棒性。

技术框架:论文主要包含两个阶段:数据标注分析和模型分类实验。在数据标注分析阶段,收集标注者的人口统计学信息和态度调查数据(右翼威权主义、社会支配取向、新性别歧视态度)。在模型分类实验阶段,使用大型语言模型,并设计不同的prompt策略,包括注入标注者信息的prompt。

关键创新:论文的关键创新在于将标注者的主观态度纳入到性别歧视分类任务中。通过分析标注者态度与标注结果之间的关联,揭示了现有数据集的潜在偏差。此外,论文还提出了一种将标注者信息融入prompt的方法,从而提升了模型的分类性能。

关键设计:论文使用了三种社会心理学量表来评估标注者的态度:右翼威权主义(RWA)、社会支配取向(SDO)和新性别歧视态度。在模型训练阶段,论文设计了五种prompt策略,包括:(1) baseline prompt,(2) demographic prompt,(3) attitudinal prompt,(4) combined prompt,(5) brief annotator descriptions。实验中使用了大型语言模型,并评估了不同prompt策略下的分类性能。

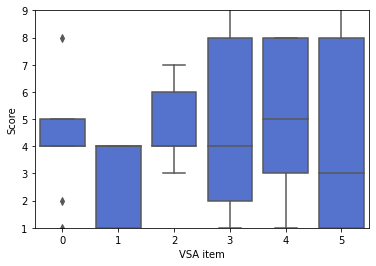

🖼️ 关键图片

📊 实验亮点

实验结果表明,标注者的态度显著影响分类器预测其标签的能力。当使用结构良好的简短标注者描述时,包含态度信息可以提高性能。例如,在某些情况下,融入标注者信息的prompt策略可以将分类性能提升5%以上。此外,研究还揭示了现有数据集的类别不平衡问题,并指出模型难以有效处理这种不平衡。

🎯 应用场景

该研究成果可应用于在线内容审核、社交媒体平台管理、以及仇恨言论检测等领域。通过考虑标注者的主观态度,可以构建更加公平和准确的性别歧视分类模型,从而有效减少网络性别暴力,营造更加健康的网络环境。该研究也为其他涉及主观判断的文本分类任务提供了借鉴。

📄 摘要(原文)

Gender-Based Violence (GBV) is an increasing problem online, but existing datasets fail to capture the plurality of possible annotator perspectives or ensure the representation of affected groups. We revisit two important stages in the moderation pipeline for GBV: (1) manual data labelling; and (2) automated classification. For (1), we examine two datasets to investigate the relationship between annotator identities and attitudes and the responses they give to two GBV labelling tasks. To this end, we collect demographic and attitudinal information from crowd-sourced annotators using three validated surveys from Social Psychology. We find that higher Right Wing Authoritarianism scores are associated with a higher propensity to label text as sexist, while for Social Dominance Orientation and Neosexist Attitudes, higher scores are associated with a negative tendency to do so. For (2), we conduct classification experiments using Large Language Models and five prompting strategies, including infusing prompts with annotator information. We find: (i) annotator attitudes affect the ability of classifiers to predict their labels; (ii) including attitudinal information can boost performance when we use well-structured brief annotator descriptions; and (iii) models struggle to reflect the increased complexity and imbalanced classes of the new label sets.