Zero-Shot Fact Verification via Natural Logic and Large Language Models

作者: Marek Strong, Rami Aly, Andreas Vlachos

分类: cs.CL

发布日期: 2024-10-04

备注: Accepted to EMNLP 2024

💡 一句话要点

提出一种基于自然逻辑和大型语言模型的零样本事实核查方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事实核查 自然逻辑 大型语言模型 零样本学习 指令调优

📋 核心要点

- 现有基于自然逻辑的事实核查系统依赖大量标注数据,限制了其应用。

- 利用指令调优的大型语言模型的泛化能力,实现零样本事实核查。

- 实验表明,该方法在零样本泛化和迁移设置中均优于现有系统。

📝 摘要(中文)

本文提出了一种零样本事实核查方法,该方法利用指令调优的大型语言模型的泛化能力。该方法旨在解决现有基于自然逻辑的事实核查系统依赖大量标注数据的难题。为了全面评估该方法和其他事实核查系统的零样本能力,我们在人工和真实世界的声明上评估了所有模型,包括多语言数据集。我们还在两种设置下将我们的方法与其他事实核查系统进行了比较。首先,在零样本泛化设置中,我们证明了我们的方法优于其他未经过自然逻辑数据专门训练的系统,平均准确率提高了8.96个百分点。其次,在零样本迁移设置中,我们表明当前在自然逻辑数据上训练的系统不能很好地泛化到其他领域,并且我们的方法在所有具有真实世界声明的数据集上都优于这些系统。

🔬 方法详解

问题定义:现有基于自然逻辑的事实核查系统,虽然在可解释性方面有所提升,但严重依赖于大量的、带有自然逻辑标注的训练数据。获取和标注这些数据成本高昂,限制了此类系统在数据稀缺场景下的应用。因此,如何降低对标注数据的依赖,实现零样本或少样本的事实核查,是一个亟待解决的问题。

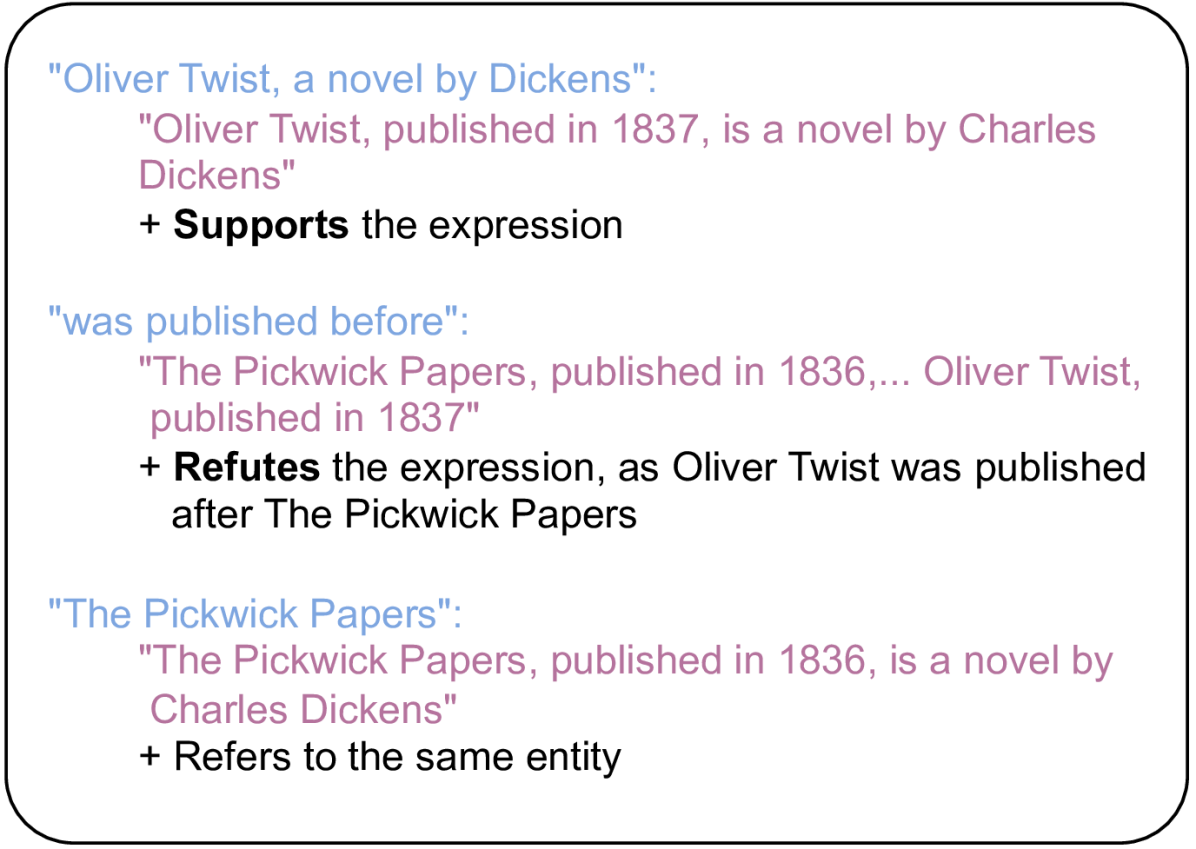

核心思路:本文的核心思路是利用大型语言模型(LLM)强大的泛化能力和指令遵循能力,直接进行零样本事实核查。通过精心设计的指令,引导LLM理解事实核查的任务,并利用其预训练知识和推理能力,判断声明的真伪。这种方法避免了对特定领域或自然逻辑标注数据的依赖,从而实现了零样本的学习能力。

技术框架:该方法的技术框架主要包括以下几个步骤:1) 输入声明和证据;2) 使用指令模板将声明和证据转化为LLM可以理解的自然语言指令;3) 将指令输入到指令调优的LLM中;4) LLM根据指令生成事实核查的结果(例如,支持、反对、未知)以及相应的解释。整个流程无需额外的训练或微调。

关键创新:该方法最重要的技术创新点在于,它将大型语言模型与自然逻辑推理相结合,实现了零样本的事实核查。与传统的需要大量标注数据的自然逻辑事实核查系统相比,该方法无需任何训练数据,即可在多个领域和数据集上取得良好的性能。此外,该方法还利用LLM生成事实核查的解释,提高了系统的可解释性。

关键设计:关键设计包括:1) 指令模板的设计,需要确保LLM能够准确理解事实核查的任务和目标;2) 选择合适的指令调优的LLM,以保证其具有足够的泛化能力和推理能力;3) 如何将自然逻辑推理融入到指令中,以提高LLM的推理准确性。论文中可能探讨了不同的指令模板和LLM的选择对最终性能的影响,但具体参数设置和损失函数等细节未知。

🖼️ 关键图片

📊 实验亮点

该方法在零样本泛化设置中,相较于未经过自然逻辑数据专门训练的基线系统,平均准确率提高了8.96个百分点。在零样本迁移设置中,该方法在所有具有真实世界声明的数据集上都优于在自然逻辑数据上训练的系统。这些实验结果表明,该方法具有良好的零样本学习能力和泛化能力。

🎯 应用场景

该研究成果可广泛应用于新闻事实核查、虚假信息检测、知识库构建与维护等领域。通过降低对标注数据的依赖,该方法使得事实核查系统能够更快速、更经济地部署到新的领域和语言中,具有重要的实际应用价值和潜在的社会影响。未来,该方法可以进一步扩展到多模态数据的事实核查,例如结合图像、视频等信息进行综合判断。

📄 摘要(原文)

The recent development of fact verification systems with natural logic has enhanced their explainability by aligning claims with evidence through set-theoretic operators, providing faithful justifications. Despite these advancements, such systems often rely on a large amount of training data annotated with natural logic. To address this issue, we propose a zero-shot method that utilizes the generalization capabilities of instruction-tuned large language models. To comprehensively assess the zero-shot capabilities of our method and other fact verification systems, we evaluate all models on both artificial and real-world claims, including multilingual datasets. We also compare our method against other fact verification systems in two setups. First, in the zero-shot generalization setup, we demonstrate that our approach outperforms other systems that were not specifically trained on natural logic data, achieving an average accuracy improvement of 8.96 points over the best-performing baseline. Second, in the zero-shot transfer setup, we show that current systems trained on natural logic data do not generalize well to other domains, and our method outperforms these systems across all datasets with real-world claims.