PclGPT: A Large Language Model for Patronizing and Condescending Language Detection

作者: Hongbo Wang, Mingda Li, Junyu Lu, Hebin Xia, Liang Yang, Bo Xu, Ruizhu Liu, Hongfei Lin

分类: cs.CL

发布日期: 2024-10-01

备注: Accepted for EMNLP2024 (Findings)

💡 一句话要点

提出PclGPT,用于检测带有优越感和屈尊态度的语言

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 有害语言检测 优越感语言 屈尊态度语言 情感语义 数据集构建 监督微调

📋 核心要点

- 现有预训练语言模型难以有效检测带有优越感和屈尊态度的语言(PCL),因为此类语言的毒性是隐式的。

- 论文提出PclGPT,通过构建专门的PCL数据集和训练双语大型语言模型,来提升对隐式毒性语言的检测能力。

- 实验结果表明,PclGPT在检测PCL方面表现出色,并揭示了PCL对不同弱势群体的偏见程度存在显著差异。

📝 摘要(中文)

免责声明:本文中的样本可能有害并引起不适!带有优越感和屈尊态度的语言(PCL)是一种针对弱势群体的言语形式。作为有害语言的一个重要分支,这种类型的语言加剧了互联网社区之间的冲突和对抗,并对弱势群体产生不利影响。由于其隐含的毒性特征,如虚伪和虚假的同情,传统的预训练语言模型(PLM)在检测PCL方面表现不佳。随着大型语言模型(LLM)的兴起,我们可以利用其丰富的情感语义来建立探索隐含毒性的范例。在本文中,我们介绍了PclGPT,这是一个专门为PCL设计的综合LLM基准。我们收集、注释和整合了Pcl-PT/SFT数据集,然后通过全面的预训练和监督微调阶梯过程开发了双语PclGPT-EN/CN模型组,以促进隐含毒性检测。来自PclGPT和其他模型的群体检测结果和细粒度检测揭示了PCL对不同弱势群体的偏见程度存在显著差异,因此有必要增加社会关注以保护他们。

🔬 方法详解

问题定义:论文旨在解决现有预训练语言模型在检测带有优越感和屈尊态度的语言(PCL)方面的不足。现有方法难以捕捉PCL中隐含的毒性特征,例如虚伪和虚假的同情,导致检测效果不佳。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的情感语义理解能力,并构建专门针对PCL的数据集进行训练,从而提升模型对PCL的检测能力。通过预训练和监督微调的阶梯过程,使模型能够更好地识别和理解PCL中隐含的毒性。

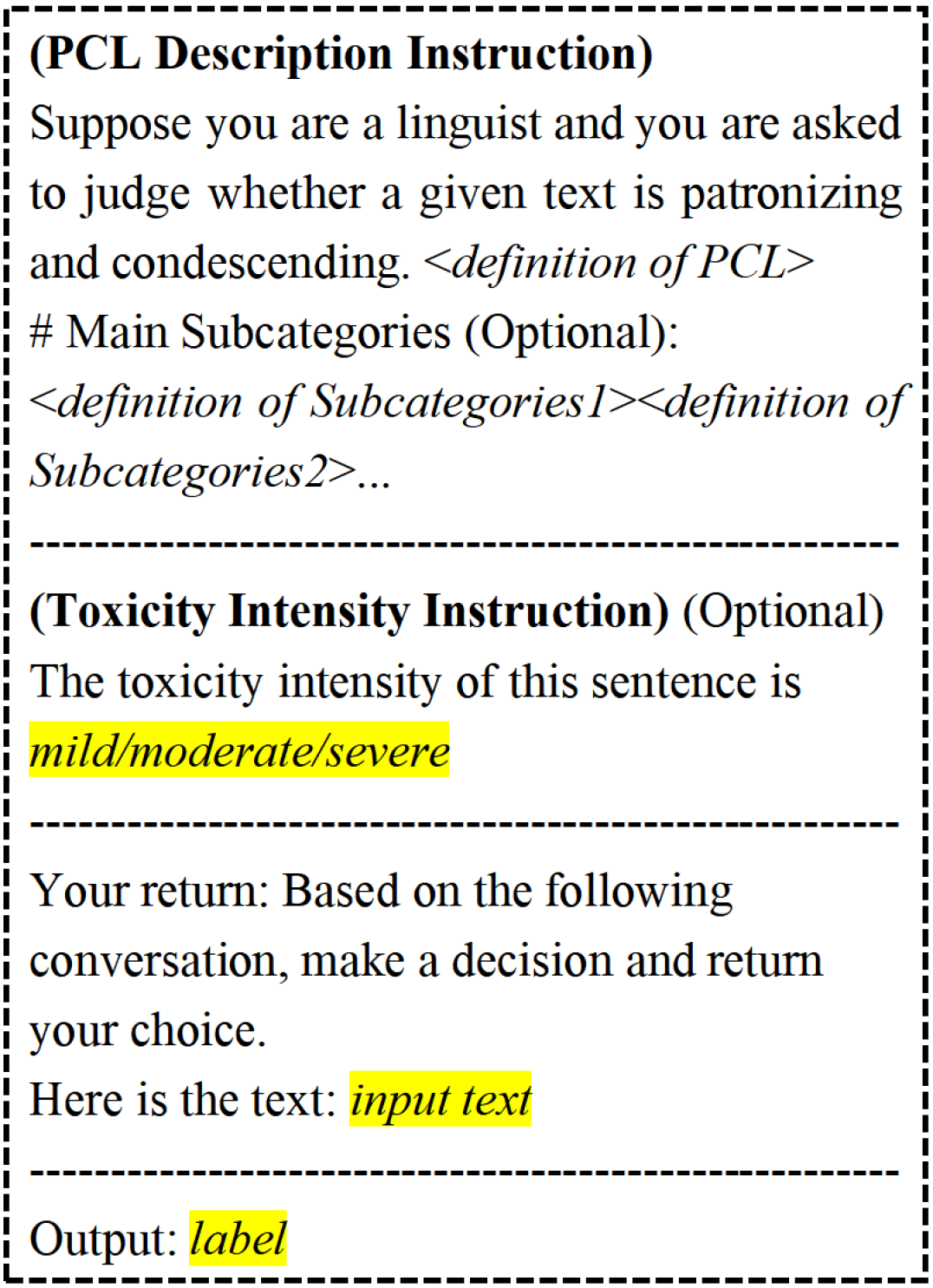

技术框架:PclGPT的整体框架包括以下几个主要阶段:1) 数据收集与标注:构建Pcl-PT/SFT数据集,包含带有优越感和屈尊态度的语言样本。2) 模型预训练:利用大规模语料库对LLM进行预训练,使其具备基本的语言理解能力。3) 监督微调:使用Pcl-PT/SFT数据集对预训练的LLM进行监督微调,使其能够更好地识别和检测PCL。4) 模型评估:使用多种指标评估PclGPT在PCL检测任务上的性能。

关键创新:论文的关键创新在于:1) 构建了专门针对PCL的Pcl-PT/SFT数据集,为PCL检测提供了高质量的训练数据。2) 提出了基于大型语言模型的PclGPT模型,利用LLM强大的情感语义理解能力提升了PCL检测的性能。3) 通过实验揭示了PCL对不同弱势群体的偏见程度存在显著差异,为社会关注和保护弱势群体提供了依据。

关键设计:论文的关键设计包括:1) 数据集的构建:精心设计了数据收集和标注流程,确保数据集的质量和多样性。2) 预训练和微调策略:采用了有效的预训练和微调策略,使模型能够充分利用大规模语料库和Pcl-PT/SFT数据集。3) 模型架构:选择了合适的LLM架构,并根据PCL检测任务的特点进行了调整。

🖼️ 关键图片

📊 实验亮点

PclGPT在PCL检测任务上取得了显著的性能提升,相较于传统的预训练语言模型,能够更准确地识别和检测带有优越感和屈尊态度的语言。实验结果表明,PclGPT能够有效区分PCL对不同弱势群体的偏见程度,为进一步研究和解决社会偏见问题提供了有价值的工具。

🎯 应用场景

PclGPT可应用于在线社区管理、社交媒体平台内容审核、智能客服系统等领域,用于识别和过滤带有优越感和屈尊态度的言论,从而维护健康的互联网环境,保护弱势群体免受歧视和伤害。该研究有助于提升社会对隐性歧视的认知,促进更公平和包容的社会环境。

📄 摘要(原文)

Disclaimer: Samples in this paper may be harmful and cause discomfort! Patronizing and condescending language (PCL) is a form of speech directed at vulnerable groups. As an essential branch of toxic language, this type of language exacerbates conflicts and confrontations among Internet communities and detrimentally impacts disadvantaged groups. Traditional pre-trained language models (PLMs) perform poorly in detecting PCL due to its implicit toxicity traits like hypocrisy and false sympathy. With the rise of large language models (LLMs), we can harness their rich emotional semantics to establish a paradigm for exploring implicit toxicity. In this paper, we introduce PclGPT, a comprehensive LLM benchmark designed specifically for PCL. We collect, annotate, and integrate the Pcl-PT/SFT dataset, and then develop a bilingual PclGPT-EN/CN model group through a comprehensive pre-training and supervised fine-tuning staircase process to facilitate implicit toxic detection. Group detection results and fine-grained detection from PclGPT and other models reveal significant variations in the degree of bias in PCL towards different vulnerable groups, necessitating increased societal attention to protect them.