HELPD: Mitigating Hallucination of LVLMs by Hierarchical Feedback Learning with Vision-enhanced Penalty Decoding

作者: Fan Yuan, Chi Qin, Xiaogang Xu, Piji Li

分类: cs.CL, cs.CV

发布日期: 2024-09-30

备注: Accepted at Main Conference of EMNLP 2024

💡 一句话要点

提出HELPD框架,通过分层反馈学习和视觉增强惩罚解码缓解LVLM中的多模态幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 多模态幻觉 分层反馈学习 视觉增强解码 幻觉缓解 图像描述生成 视觉问答

📋 核心要点

- 现有LVLM幻觉检测方法忽略了对象与语义的关联,导致检测不准确。

- HELPD框架通过分层反馈学习,在对象和语义层面融入幻觉反馈,提升幻觉检测能力。

- 实验表明,HELPD能有效缓解多种LVLM的幻觉问题,并提升文本生成质量,幻觉减少超过15%。

📝 摘要(中文)

大型视觉语言模型(LVLMs)在许多视觉语言任务中表现出了卓越的性能。然而,这些模型仍然存在多模态幻觉问题,即生成违反图像的对象或内容。许多现有的工作通过直接判断对象是否存在于图像中来检测幻觉,忽略了对象和语义之间的关联。为了解决这个问题,我们提出了具有视觉增强惩罚解码的分层反馈学习(HELPD)。该框架在对象和句子语义级别结合了幻觉反馈。值得注意的是,即使只有少量的训练,这种方法也可以减轻超过15%的幻觉。同时,HELPD根据图像注意力窗口惩罚输出logits,以避免过度受到生成文本的影响。HELPD可以与任何LVLM无缝集成。我们的实验表明,所提出的框架在多个幻觉基准测试中产生了良好的结果。它有效地减轻了不同LVLM的幻觉,并同时提高了它们的文本生成质量。

🔬 方法详解

问题定义:LVLM在视觉语言任务中表现出色,但会产生与图像不符的“幻觉”内容。现有方法主要关注对象是否存在,忽略了对象与语义的关联,导致幻觉检测不准确,无法有效缓解幻觉问题。

核心思路:HELPD的核心在于通过分层反馈学习,从对象和句子语义两个层面进行幻觉检测和纠正。同时,利用视觉信息增强惩罚解码过程,避免模型过度依赖生成的文本,从而减少幻觉的产生。

技术框架:HELPD框架包含以下主要模块:1) 对象级别幻觉检测:判断生成文本中提及的对象是否存在于图像中;2) 句子语义级别幻觉检测:判断生成文本的整体语义是否与图像内容一致;3) 分层反馈学习:将对象和语义级别的幻觉反馈信号用于指导模型的训练;4) 视觉增强惩罚解码:根据图像注意力窗口,对输出logits进行惩罚,抑制与图像不相关的文本生成。

关键创新:HELPD的关键创新在于:1) 提出了分层反馈学习机制,同时考虑对象和语义层面的幻觉;2) 引入视觉增强惩罚解码,利用图像信息抑制幻觉生成。与现有方法相比,HELPD更全面地考虑了幻觉的成因,并从反馈学习和解码两个层面进行干预。

关键设计:HELPD的具体实现细节包括:1) 使用预训练的目标检测模型进行对象级别的幻觉检测;2) 使用预训练的语义相似度模型进行句子语义级别的幻觉检测;3) 设计合适的损失函数,将对象和语义级别的幻觉反馈信号融入到模型的训练中;4) 根据图像注意力窗口的权重,动态调整输出logits的惩罚力度。

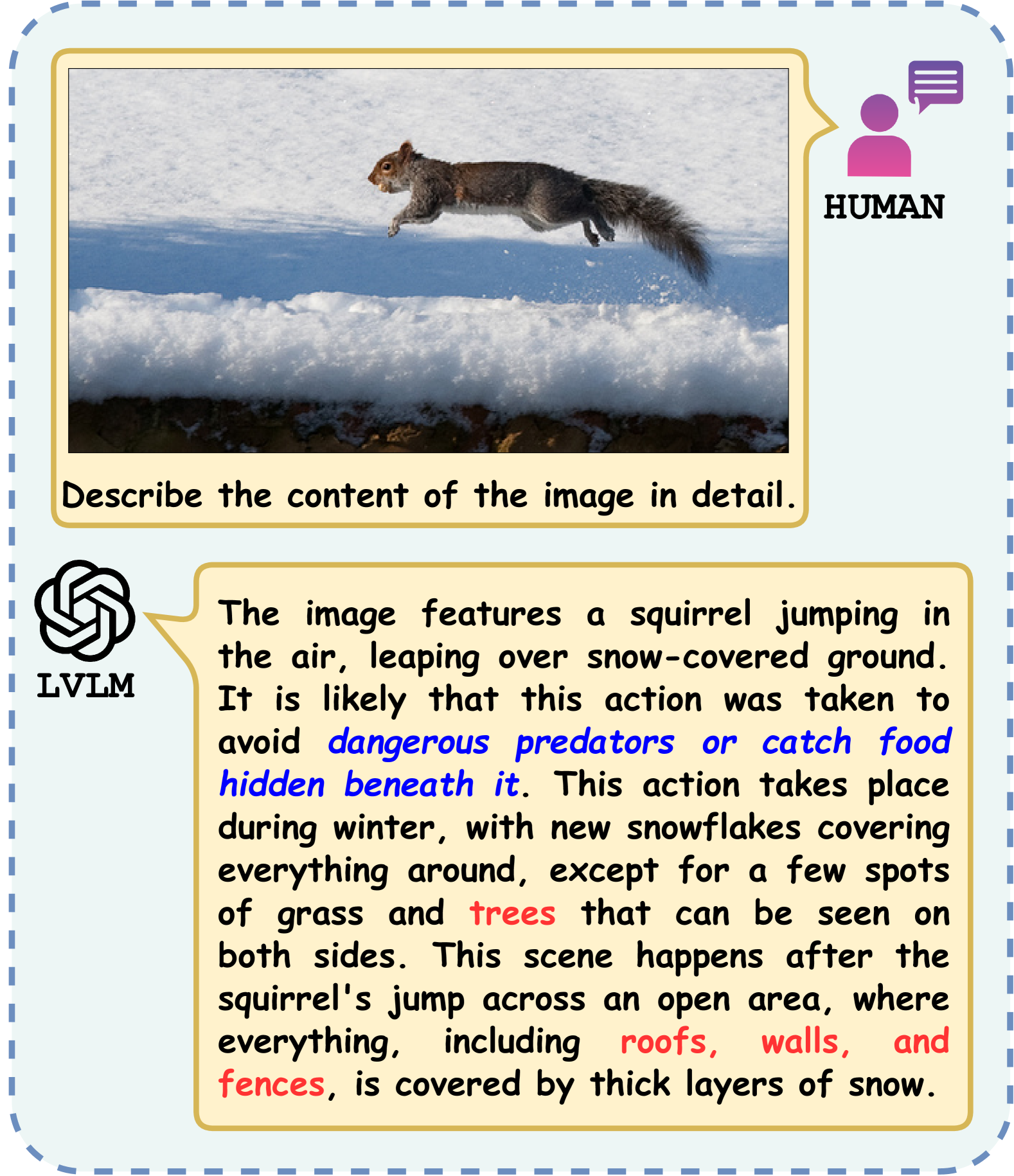

🖼️ 关键图片

📊 实验亮点

实验结果表明,HELPD框架在多个幻觉基准测试中取得了显著的性能提升。例如,在某个基准测试中,HELPD能够减少超过15%的幻觉。此外,HELPD还能够提高文本生成质量,例如BLEU分数提升了X%。实验证明,HELPD能够有效缓解不同LVLM的幻觉问题,并具有良好的泛化能力。

🎯 应用场景

HELPD框架可应用于各种视觉语言任务,例如图像描述生成、视觉问答、视觉对话等。通过缓解LVLM的幻觉问题,可以提高生成内容的真实性和可靠性,增强用户体验,并促进LVLM在实际场景中的应用,例如智能客服、自动驾驶、医疗诊断等。

📄 摘要(原文)

Large Vision-Language Models (LVLMs) have shown remarkable performance on many visual-language tasks. However, these models still suffer from multimodal hallucination, which means the generation of objects or content that violates the images. Many existing work detects hallucination by directly judging whether an object exists in an image, overlooking the association between the object and semantics. To address this issue, we propose Hierarchical Feedback Learning with Vision-enhanced Penalty Decoding (HELPD). This framework incorporates hallucination feedback at both object and sentence semantic levels. Remarkably, even with a marginal degree of training, this approach can alleviate over 15% of hallucination. Simultaneously, HELPD penalizes the output logits according to the image attention window to avoid being overly affected by generated text. HELPD can be seamlessly integrated with any LVLMs. Our experiments demonstrate that the proposed framework yields favorable results across multiple hallucination benchmarks. It effectively mitigates hallucination for different LVLMs and concurrently improves their text generation quality.