How Entangled is Factuality and Deception in German?

作者: Aswathy Velutharambath, Amelie Wührl, Roman Klinger

分类: cs.CL

发布日期: 2024-09-30

备注: Findings of EMNLP 2024 (accepted)

💡 一句话要点

研究德语中事实性与欺骗性的纠缠关系,揭示现有欺骗检测模型的局限性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 欺骗检测 事实核查 自然语言处理 德语 信念建模

📋 核心要点

- 现有欺骗检测研究常混淆事实准确性与陈述真实性,阻碍了对两者细微差别的研究。

- 该研究采用基于信念的欺骗框架,区分事实性与欺骗性,并评估其在德语文本中的表现。

- 实验表明,现有模型在德语欺骗检测任务中表现不佳,且欺骗性会影响事实核查模型的性能。

📝 摘要(中文)

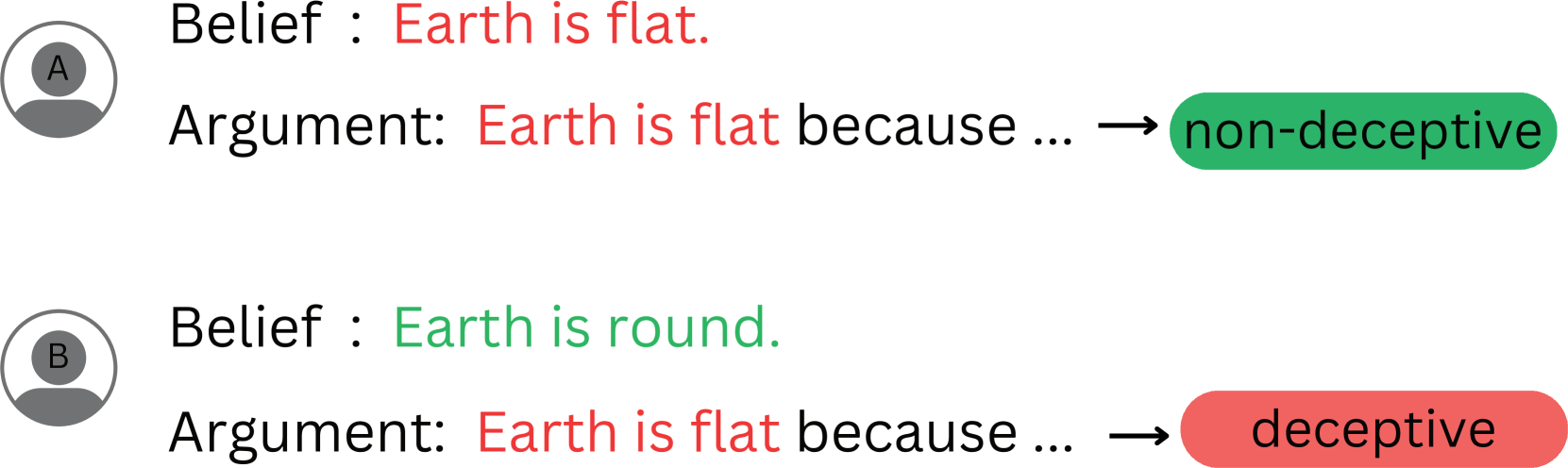

声明“地球是平的”在事实上是不准确的,但如果有人真的相信并为其辩护,那就不构成欺骗。欺骗检测和事实核查的研究常常将事实准确性与陈述的真实性混为一谈。这种假设使得(a)研究两者之间微妙的区别和相互作用以及(b)评估它们对下游任务的影响变得困难。基于信念的欺骗框架通过将文本定义为当人们所说与他们真正相信的之间存在不匹配时具有欺骗性来解开这些属性。在本研究中,我们评估了假定的欺骗模式是否可以推广到德语文本。我们测试了计算模型在使用已建立的基于信念的论证语料库中检测欺骗的有效性。最后,我们评估了欺骗对事实核查这一下游任务的影响,并探讨了这种属性是否会混淆验证模型。令人惊讶的是,我们的分析发现与已建立的欺骗线索没有相关性。之前的工作声称计算模型在欺骗检测准确率方面可以胜过人类,但是,我们的实验表明,传统模型和最先进的模型都在该任务中挣扎,表现不优于随机猜测。对于事实核查,我们发现基于自然语言推理的验证在非事实和欺骗性内容上的表现更差,而提示大型语言模型执行相同的任务对这些属性不太敏感。

🔬 方法详解

问题定义:现有欺骗检测研究常常将事实准确性与陈述的真实性混淆,忽略了信念在欺骗行为中的作用。这种混淆使得模型难以区分无意错误和有意欺骗,从而影响了欺骗检测的准确性和可靠性。此外,现有方法在跨语言环境下的泛化能力也存在问题。

核心思路:该研究的核心思路是采用基于信念的欺骗框架,将欺骗定义为陈述内容与说话者真实信念之间的不一致。通过区分事实准确性和信念真实性,可以更准确地识别欺骗行为,并研究两者之间的相互作用。这种方法强调了主观意图在欺骗行为中的重要性。

技术框架:该研究主要包含以下几个阶段:1) 使用已有的德语信念标注语料库;2) 使用传统机器学习模型(如SVM)和深度学习模型(如BERT)进行欺骗检测;3) 分析模型在欺骗检测任务中的表现,并与随机猜测进行比较;4) 将欺骗检测结果应用于事实核查任务,评估欺骗性对事实核查模型性能的影响。

关键创新:该研究的关键创新在于:1) 将基于信念的欺骗框架应用于德语文本分析,验证了该框架在不同语言环境下的适用性;2) 揭示了现有欺骗检测模型在处理德语欺骗性文本时的局限性,表明模型难以区分事实错误和有意欺骗;3) 探讨了欺骗性对事实核查任务的影响,发现欺骗性会降低基于自然语言推理的事实核查模型的性能。

关键设计:该研究使用了已有的德语信念标注语料库,该语料库包含了标注者对文本陈述的事实性和说话者信念的判断。研究者使用了SVM和BERT等模型进行欺骗检测,并采用了标准的分类评估指标(如准确率、精确率、召回率和F1值)来评估模型的性能。在事实核查任务中,研究者使用了基于自然语言推理的模型和大型语言模型,并比较了它们在处理欺骗性文本时的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,传统机器学习模型和深度学习模型在德语欺骗检测任务中表现不佳,其准确率与随机猜测相当,这与之前研究声称计算模型优于人类的表现相悖。此外,研究发现,欺骗性会降低基于自然语言推理的事实核查模型的性能,但对大型语言模型的影响较小。

🎯 应用场景

该研究成果可应用于虚假信息检测、网络安全、舆情分析等领域。通过更准确地识别欺骗行为,可以提高信息过滤的准确性和效率,减少虚假信息传播带来的负面影响。此外,该研究还可以为开发更鲁棒的事实核查系统提供参考。

📄 摘要(原文)

The statement "The earth is flat" is factually inaccurate, but if someone truly believes and argues in its favor, it is not deceptive. Research on deception detection and fact checking often conflates factual accuracy with the truthfulness of statements. This assumption makes it difficult to (a) study subtle distinctions and interactions between the two and (b) gauge their effects on downstream tasks. The belief-based deception framework disentangles these properties by defining texts as deceptive when there is a mismatch between what people say and what they truly believe. In this study, we assess if presumed patterns of deception generalize to German language texts. We test the effectiveness of computational models in detecting deception using an established corpus of belief-based argumentation. Finally, we gauge the impact of deception on the downstream task of fact checking and explore if this property confounds verification models. Surprisingly, our analysis finds no correlation with established cues of deception. Previous work claimed that computational models can outperform humans in deception detection accuracy, however, our experiments show that both traditional and state-of-the-art models struggle with the task, performing no better than random guessing. For fact checking, we find that Natural Language Inference-based verification performs worse on non-factual and deceptive content, while prompting Large Language Models for the same task is less sensitive to these properties.