Multimodal Misinformation Detection by Learning from Synthetic Data with Multimodal LLMs

作者: Fengzhu Zeng, Wenqian Li, Wei Gao, Yan Pang

分类: cs.CL

发布日期: 2024-09-29

备注: EMNLP 2024 Findings

💡 一句话要点

提出基于多模态LLM合成数据学习的方法,用于提升真实场景下的多模态虚假信息检测性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态虚假信息检测 合成数据学习 数据选择 多模态LLM 事实核查

📋 核心要点

- 现有方法缺乏大规模高质量的真实世界多模态虚假信息数据集,导致模型泛化能力不足。

- 该论文提出通过数据选择方法,缩小合成数据和真实数据之间的分布差异,提升模型在真实场景下的性能。

- 实验结果表明,该方法能有效提升小型MLLM在真实世界数据集上的表现,甚至超越GPT-4V。

📝 摘要(中文)

检测多模态虚假信息,特别是图像-文本对形式的信息,至关重要。然而,获取大规模、高质量的真实世界事实核查数据集来训练检测器成本高昂,导致研究人员使用AI技术生成的合成数据集。但是,由于分布差异,在合成数据上训练的检测器在真实世界场景中的泛化能力仍然不清楚。为了解决这个问题,我们提出通过两种模型无关的数据选择方法,匹配合成数据和真实世界数据分布,从而利用合成数据学习来检测真实世界的多模态虚假信息。实验表明,我们的方法增强了一个小型MLLM(13B)在真实世界事实核查数据集上的性能,使其甚至超过了GPT-4V。

🔬 方法详解

问题定义:论文旨在解决多模态虚假信息检测问题,特别是图像-文本对的虚假信息识别。现有方法依赖于真实世界标注数据集,但获取成本高昂且规模有限。使用AI合成数据进行训练虽然降低了成本,但由于合成数据与真实数据存在分布差异,导致模型在真实场景下的泛化能力较差。

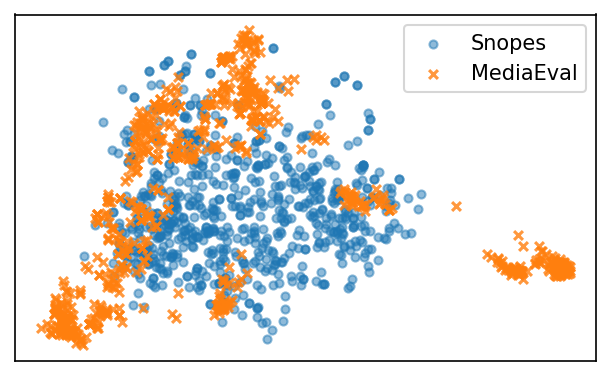

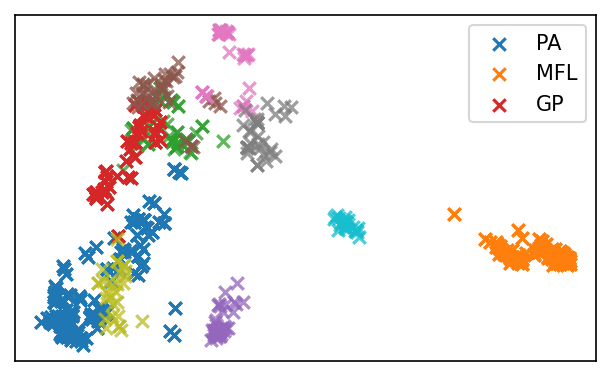

核心思路:论文的核心思路是通过数据选择方法,从合成数据集中选择与真实数据分布更接近的样本,从而缩小分布差异,提升模型在真实数据上的性能。这种方法旨在利用合成数据的丰富性,同时避免其带来的负面影响。

技术框架:该方法是模型无关的,可以应用于各种多模态模型。整体流程包括:1) 使用多模态LLM生成合成数据;2) 使用数据选择方法从合成数据中选择与真实数据分布相似的子集;3) 使用选择后的合成数据训练多模态虚假信息检测模型;4) 在真实世界数据集上评估模型性能。数据选择是关键步骤。

关键创新:该论文的关键创新在于提出了两种模型无关的数据选择方法,用于匹配合成数据和真实世界数据的分布。这两种方法能够有效地选择出更具代表性的合成数据,从而提升模型在真实场景下的泛化能力。与直接使用所有合成数据相比,该方法能够显著提高模型性能。

关键设计:论文中具体的数据选择方法细节未知,摘要中只提到是“两种模型无关的数据选择方法”,需要阅读论文全文才能了解具体实现。但可以推测,可能涉及到计算合成数据和真实数据之间的距离或相似度,并选择距离较近或相似度较高的样本。具体的损失函数和网络结构取决于所使用的多模态模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够显著提升小型MLLM(13B)在真实世界事实核查数据集上的性能,使其性能甚至超越了GPT-4V。这表明通过有效利用合成数据,即使是较小的模型也能在复杂任务中取得优异表现。具体的性能提升幅度需要在论文中查找。

🎯 应用场景

该研究成果可应用于社交媒体平台、新闻媒体网站等,用于自动检测和过滤虚假信息,帮助用户识别和避免受到误导。通过提升多模态虚假信息检测的准确性和效率,可以有效维护网络信息安全,营造健康的网络环境,并降低虚假信息传播带来的负面影响。

📄 摘要(原文)

Detecting multimodal misinformation, especially in the form of image-text pairs, is crucial. Obtaining large-scale, high-quality real-world fact-checking datasets for training detectors is costly, leading researchers to use synthetic datasets generated by AI technologies. However, the generalizability of detectors trained on synthetic data to real-world scenarios remains unclear due to the distribution gap. To address this, we propose learning from synthetic data for detecting real-world multimodal misinformation through two model-agnostic data selection methods that match synthetic and real-world data distributions. Experiments show that our method enhances the performance of a small MLLM (13B) on real-world fact-checking datasets, enabling it to even surpass GPT-4V~\cite{GPT-4V}.