Uncovering Differences in Persuasive Language in Russian versus English Wikipedia

作者: Bryan Li, Aleksey Panasyuk, Chris Callison-Burch

分类: cs.CL

发布日期: 2024-09-27

💡 一句话要点

利用大语言模型识别维基百科俄语和英语文章中的说服性语言差异,揭示文化视角差异

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 说服性语言识别 跨文化分析 大型语言模型 高层次问题 维基百科

📋 核心要点

- 现有方法难以有效识别多语言文本中主观的说服性语言,缺乏跨文化比较能力。

- 利用LLM生成并筛选高层次问题(HLQ),重新定义说服性语言识别任务,降低主观性。

- 实验表明,该方法能够有效识别不同语言维基百科文章的说服性差异,揭示文化视角差异。

📝 摘要(中文)

本文研究了英语和俄语维基百科文章中说服性语言的差异,以此揭示不同文化对不同主题的独特视角。我们开发了一个由大型语言模型(LLM)驱动的系统,用于识别多语言文本中说服性语言的实例。我们没有直接提示LLM检测说服性,因为这具有主观性和难度,而是将任务重新定义为提出高层次问题(HLQ),以捕捉不同的说服性方面。重要的是,这些HLQ由LLM自身生成。LLM过度生成大量的HLQ,然后将其过滤为与原始任务的人工标签对齐的一小部分。然后,我们将我们的方法应用于一个大规模的双语维基百科文章数据集(总共88K),使用两阶段的识别-然后-提取提示策略来查找说服性实例。我们量化了每篇文章的说服性程度,并通过对配对文章的几个实验探索了说服性的差异。值得注意的是,我们生成了两种语言中按说服性排列的文章排名。这些排名与我们对文化上显著主题的直觉相符;俄语维基百科突出了关于乌克兰的主题,而英语维基百科突出了中东。将主题分组为更大的主题,我们发现与政治相关的事件包含比其他事件更多的说服性。我们进一步证明,HLQ在用英语或俄语提出时获得相似的性能。我们的方法能够大规模地进行跨语言、跨文化的理解,并且我们发布了我们的代码、提示和数据。

🔬 方法详解

问题定义:论文旨在解决跨语言文化背景下,如何有效识别和量化文本中的说服性语言差异的问题。现有方法直接利用LLM进行说服性检测,但由于说服性本身的主观性和复杂性,导致检测效果不佳,且难以进行跨文化比较。

核心思路:论文的核心思路是将直接检测说服性语言的任务,转化为通过LLM生成并筛选高层次问题(HLQ)的方式,间接捕捉文本中蕴含的说服性。通过分析这些HLQ的答案,可以更客观地评估文本的说服程度,并进行跨语言、跨文化的比较。

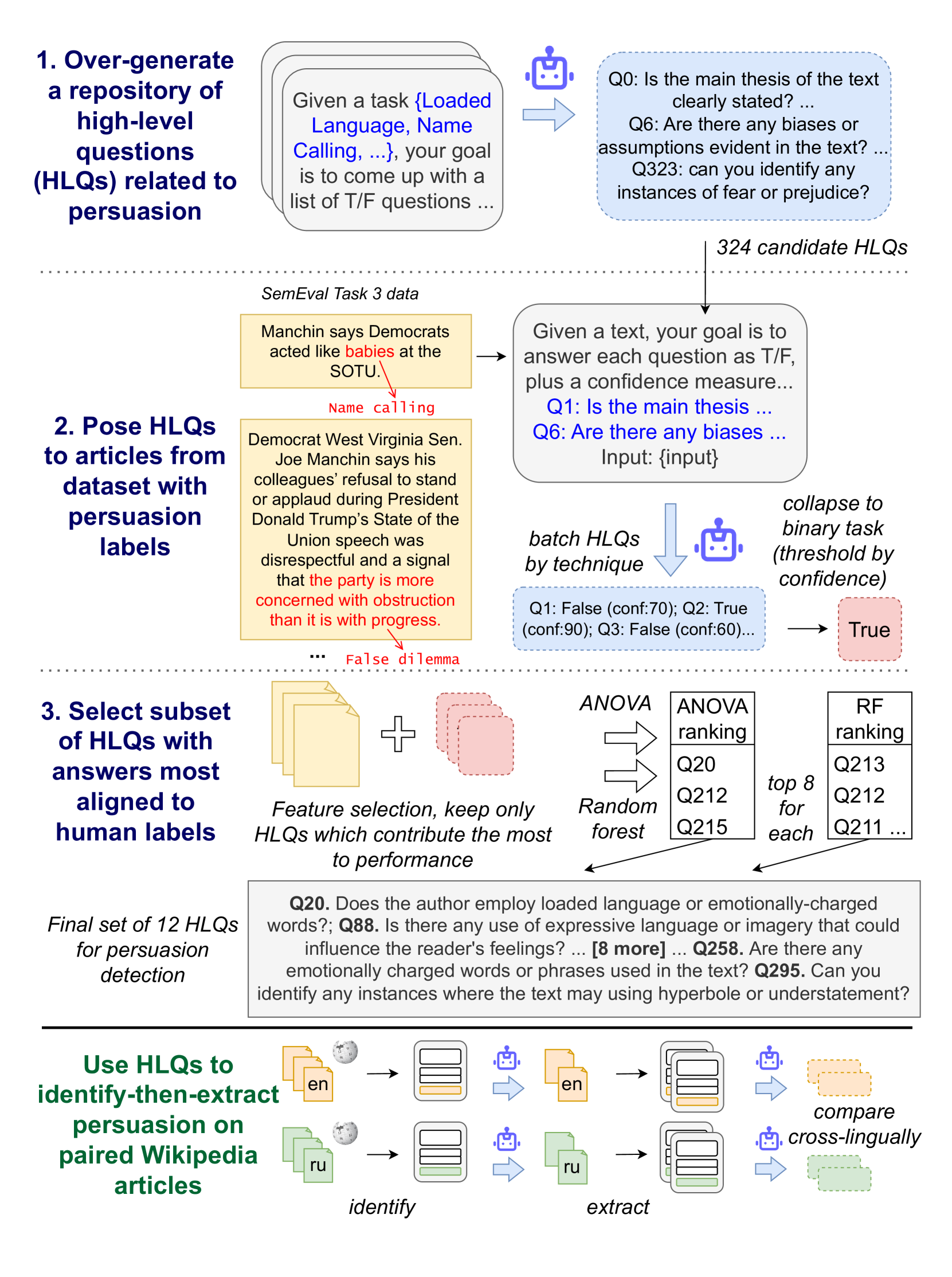

技术框架:整体框架包含以下几个主要阶段: 1. HLQ生成:利用LLM生成大量关于文本的说服性相关的高层次问题(HLQ)。 2. HLQ筛选:根据人工标注数据,筛选出与说服性相关的HLQ子集。 3. 说服性识别:使用筛选后的HLQ,通过两阶段的“识别-然后-提取”提示策略,从文本中识别出说服性语言的实例。 4. 说服性量化与比较:量化每篇文章的说服性程度,并进行跨语言、跨文化的比较分析。

关键创新:该方法最重要的创新点在于将主观的说服性检测任务转化为客观的HLQ生成与筛选任务。通过LLM自动生成HLQ,避免了人工定义说服性特征的主观性,并提高了跨语言的适用性。两阶段的提示策略也提高了说服性语言识别的准确性。

关键设计: * HLQ生成:使用LLM生成多种类型的HLQ,例如“这篇文章试图说服读者相信什么?”、“这篇文章使用了哪些修辞手法?”等。 * HLQ筛选:使用人工标注数据,计算每个HLQ与说服性标签的相关性,并选择相关性最高的HLQ子集。 * 两阶段提示策略:第一阶段识别文本中可能包含说服性语言的句子,第二阶段从这些句子中提取具体的说服性语言实例。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够有效识别不同语言维基百科文章的说服性差异。通过对俄语和英语维基百科文章的分析,发现俄语维基百科更关注乌克兰相关主题的说服性,而英语维基百科更关注中东相关主题。此外,实验还证明了HLQ在不同语言环境下具有相似的性能。

🎯 应用场景

该研究成果可应用于跨文化传播分析、舆情监控、政治宣传识别等领域。通过识别不同文化背景下文本的说服性差异,可以更好地理解不同文化群体的价值观和认知模式,从而促进跨文化交流与合作。此外,该方法还可以用于检测虚假信息和恶意宣传,维护网络安全。

📄 摘要(原文)

We study how differences in persuasive language across Wikipedia articles, written in either English and Russian, can uncover each culture's distinct perspective on different subjects. We develop a large language model (LLM) powered system to identify instances of persuasive language in multilingual texts. Instead of directly prompting LLMs to detect persuasion, which is subjective and difficult, we propose to reframe the task to instead ask high-level questions (HLQs) which capture different persuasive aspects. Importantly, these HLQs are authored by LLMs themselves. LLMs over-generate a large set of HLQs, which are subsequently filtered to a small set aligned with human labels for the original task. We then apply our approach to a large-scale, bilingual dataset of Wikipedia articles (88K total), using a two-stage identify-then-extract prompting strategy to find instances of persuasion. We quantify the amount of persuasion per article, and explore the differences in persuasion through several experiments on the paired articles. Notably, we generate rankings of articles by persuasion in both languages. These rankings match our intuitions on the culturally-salient subjects; Russian Wikipedia highlights subjects on Ukraine, while English Wikipedia highlights the Middle East. Grouping subjects into larger topics, we find politically-related events contain more persuasion than others. We further demonstrate that HLQs obtain similar performance when posed in either English or Russian. Our methodology enables cross-lingual, cross-cultural understanding at scale, and we release our code, prompts, and data.