AER-LLM: Ambiguity-aware Emotion Recognition Leveraging Large Language Models

作者: Xin Hong, Yuan Gong, Vidhyasaharan Sethu, Ting Dang

分类: cs.CL, cs.AI

发布日期: 2024-09-26 (更新: 2025-02-17)

备注: Accepted by ICASSP 2025

💡 一句话要点

AER-LLM:利用大语言模型进行歧义感知的多情感识别

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感识别 大型语言模型 模糊情感 上下文学习 提示学习

📋 核心要点

- 现有情感识别方法忽略了人类情感的复杂性和模糊性,通常只关注单一情感标签。

- 论文提出利用LLMs强大的泛化能力和上下文学习能力,通过设计零样本和少样本提示来识别模糊情感。

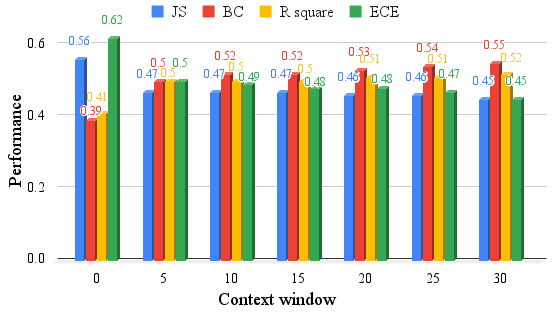

- 实验结果表明,LLMs在识别模糊情感方面具有显著潜力,且包含上下文信息能显著提升性能。

📝 摘要(中文)

近年来,大型语言模型(LLMs)在自然语言处理(NLP)任务中取得了显著进展。除了认知智能外,探索其在情感智能方面的能力也至关重要,因为这能实现更自然和更具同理心的对话式AI。目前的研究已经展示了LLMs在识别情感方面的能力,但它们通常侧重于单一情感标签,而忽略了人类情感的复杂性和模糊性。本研究首次填补了这一空白,通过利用LLMs强大的泛化能力和上下文学习能力,探索其在识别模糊情感方面的潜力。我们设计了零样本和少样本提示,并将过去的对话作为上下文信息,用于模糊情感识别。使用三个数据集进行的实验表明,LLMs在识别模糊情感方面具有显著潜力,并强调了包含上下文信息的巨大好处。此外,我们的研究结果表明,LLMs在识别不太模糊的情感方面表现出高度的有效性,并具有识别更模糊情感的潜力,与人类的感知能力相似。

🔬 方法详解

问题定义:论文旨在解决现有情感识别方法无法有效处理人类情感中普遍存在的模糊性的问题。现有方法通常只关注单一情感标签,忽略了情感的复杂性和多义性,导致识别结果不够准确和全面。

核心思路:论文的核心思路是利用大型语言模型(LLMs)强大的泛化能力和上下文学习能力,使其能够理解和识别模糊的情感。通过将LLMs作为情感识别器,并结合上下文信息,模型能够更好地理解情感的细微差别和潜在含义。

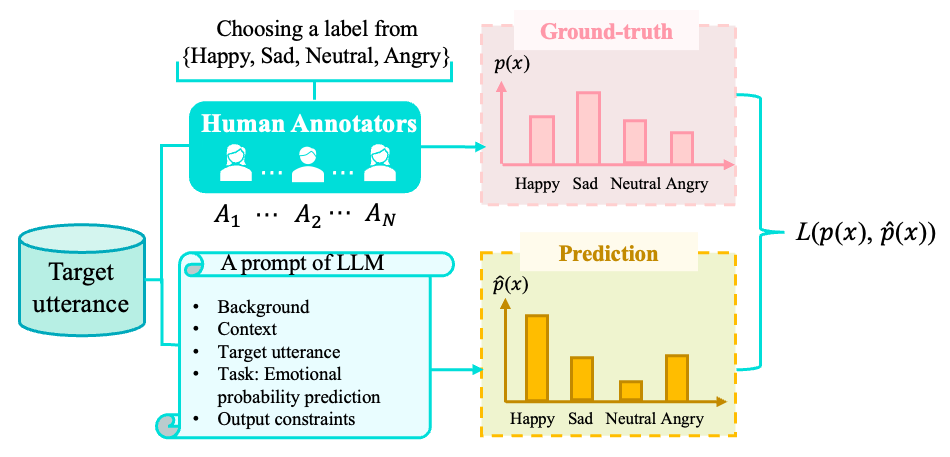

技术框架:论文采用基于提示学习(Prompt Learning)的技术框架。具体流程如下:1) 构建包含上下文信息的输入提示;2) 将提示输入到预训练的LLM中;3) LLM根据提示生成情感标签;4) 对生成的情感标签进行评估。论文设计了零样本和少样本两种提示方式,以探索LLMs在不同数据量下的性能表现。

关键创新:论文的关键创新在于首次将LLMs应用于模糊情感识别,并探索了上下文信息对情感识别的影响。通过设计合适的提示,LLMs能够有效地识别和理解情感的模糊性,从而提高情感识别的准确性和鲁棒性。

关键设计:论文的关键设计包括:1) 上下文信息的选择:选择过去的对话作为上下文信息,以提供情感识别的背景知识;2) 提示的设计:设计零样本和少样本提示,以探索LLMs在不同数据量下的性能表现;3) 评估指标的选择:采用合适的评估指标来衡量模型在模糊情感识别方面的性能。

🖼️ 关键图片

📊 实验亮点

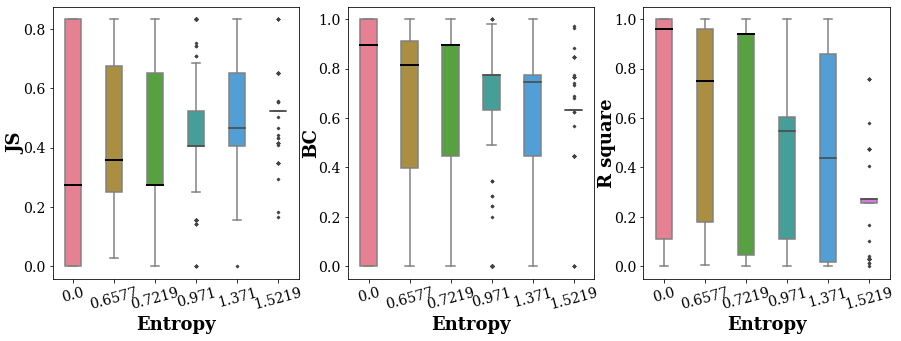

实验结果表明,LLMs在识别模糊情感方面具有显著潜力,尤其是在包含上下文信息的情况下。研究发现,LLMs在识别不太模糊的情感方面表现出高度的有效性,并具有识别更模糊情感的潜力,与人类的感知能力相似。具体性能数据未知,但论文强调了上下文信息带来的显著提升。

🎯 应用场景

该研究成果可应用于情感对话机器人、心理健康咨询、社交媒体情感分析等领域。通过提高机器对人类情感的理解能力,可以构建更自然、更具同理心的对话系统,并为心理健康提供更有效的支持。此外,该研究还可以帮助分析社交媒体上的用户情感,从而更好地了解社会舆情和用户需求。

📄 摘要(原文)

Recent advancements in Large Language Models (LLMs) have demonstrated great success in many Natural Language Processing (NLP) tasks. In addition to their cognitive intelligence, exploring their capabilities in emotional intelligence is also crucial, as it enables more natural and empathetic conversational AI. Recent studies have shown LLMs' capability in recognizing emotions, but they often focus on single emotion labels and overlook the complex and ambiguous nature of human emotions. This study is the first to address this gap by exploring the potential of LLMs in recognizing ambiguous emotions, leveraging their strong generalization capabilities and in-context learning. We design zero-shot and few-shot prompting and incorporate past dialogue as context information for ambiguous emotion recognition. Experiments conducted using three datasets indicate significant potential for LLMs in recognizing ambiguous emotions, and highlight the substantial benefits of including context information. Furthermore, our findings indicate that LLMs demonstrate a high degree of effectiveness in recognizing less ambiguous emotions and exhibit potential for identifying more ambiguous emotions, paralleling human perceptual capabilities.