Do the Right Thing, Just Debias! Multi-Category Bias Mitigation Using LLMs

作者: Amartya Roy, Danush Khanna, Devanshu Mahapatra, Vasanthakumar, Avirup Das, Kripabandhu Ghosh

分类: cs.CL

发布日期: 2024-09-24

备注: 17 pages, 5 Figures

💡 一句话要点

利用LLM进行多类别偏见缓解:提出ANUBIS数据集并探索多种去偏方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 偏见缓解 大型语言模型 数据集构建 强化学习 监督学习 上下文学习 社会公平 自然语言处理

📋 核心要点

- 现有数据集在偏见缓解方面存在局限性,难以训练出鲁棒且泛化性强的模型。

- 论文核心在于构建新的多类别偏见数据集ANUBIS,并探索多种LLM训练方法进行偏见缓解。

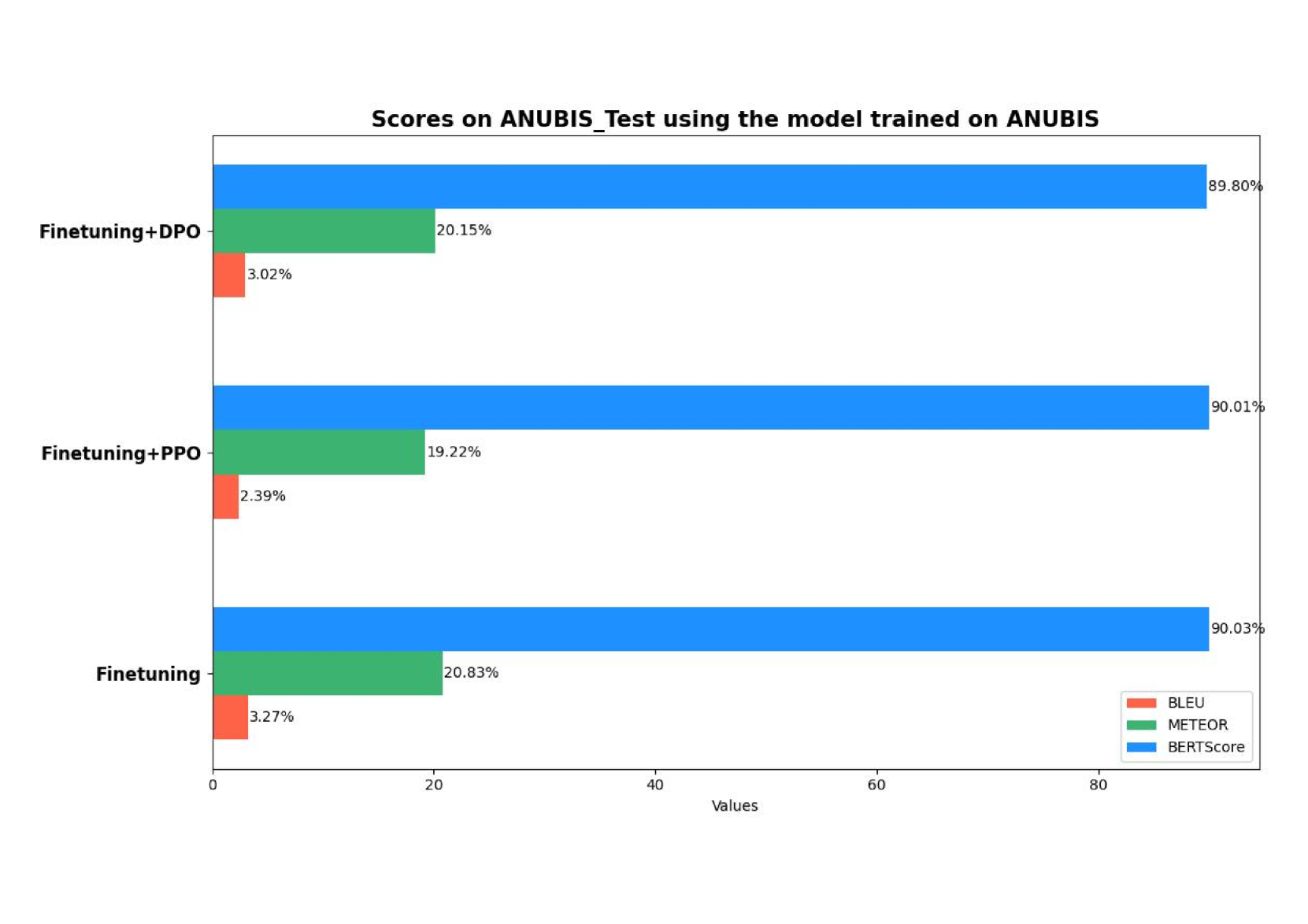

- 实验评估了SFT、PPO、DPO和ICL等方法在ANUBIS数据集上的性能,并分析了模型的泛化能力和环境影响。

📝 摘要(中文)

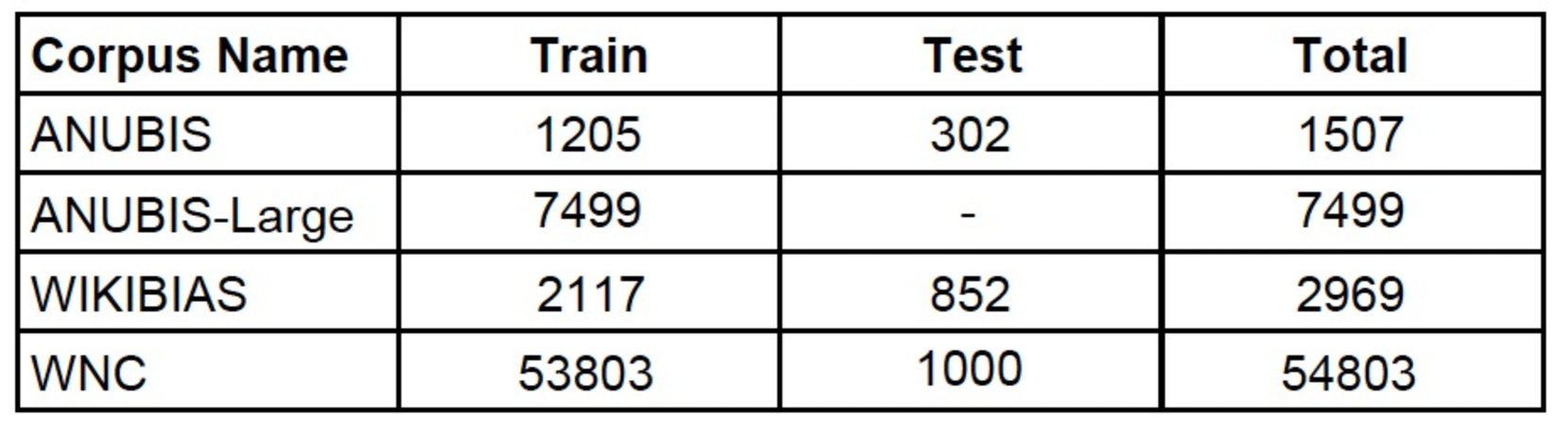

本文致力于构建鲁棒且泛化性强的语言偏见缓解模型。针对现有数据集的局限性,我们提出了ANUBIS,一个包含1507个精心设计的句子对的新数据集,涵盖九个社会偏见类别。我们评估了最先进的模型,如T5,并利用监督微调(SFT)、强化学习(PPO、DPO)和上下文学习(ICL)来实现有效的偏见缓解。我们的分析侧重于多类别社会偏见减少、跨数据集泛化能力以及训练模型的环境影响。ANUBIS和我们的研究结果为构建更公平的AI系统提供了宝贵的资源,并有助于开发具有广泛社会影响的负责任和无偏见的技术。

🔬 方法详解

问题定义:论文旨在解决语言模型中存在的社会偏见问题,特别是多类别偏见。现有方法依赖于有限且可能存在偏差的数据集,导致模型在实际应用中表现不佳,泛化能力不足。此外,训练大型语言模型的环境成本也是一个重要的考虑因素。

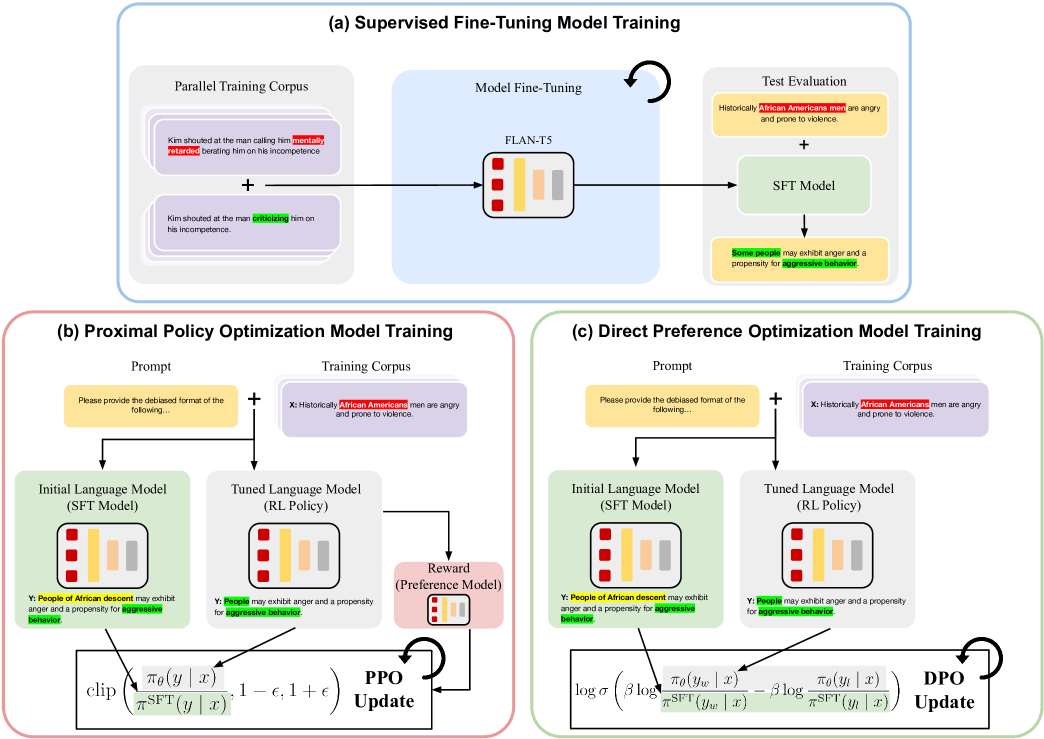

核心思路:论文的核心思路是构建一个高质量的多类别偏见数据集ANUBIS,并利用该数据集,结合不同的训练策略(SFT、PPO、DPO、ICL)来训练语言模型,从而有效地缓解模型中的偏见。通过比较不同训练策略的效果,找到最佳的偏见缓解方案。

技术框架:整体框架包括数据收集与构建、模型训练与评估两个主要阶段。数据收集阶段,作者精心设计了ANUBIS数据集,涵盖九个社会偏见类别。模型训练阶段,使用T5等先进语言模型,并采用SFT、PPO、DPO和ICL等不同的训练方法。模型评估阶段,评估模型在ANUBIS数据集上的偏见缓解效果,以及在其他数据集上的泛化能力,并分析模型的环境影响。

关键创新:论文的关键创新在于ANUBIS数据集的构建,该数据集覆盖了多个社会偏见类别,并且句子对经过精心设计,能够更有效地训练模型。此外,论文还系统地比较了多种训练策略在偏见缓解方面的效果,为未来的研究提供了有价值的参考。

关键设计:ANUBIS数据集包含1507个句子对,每个句子对包含一个带有偏见的句子和一个不带偏见的句子。数据集涵盖了九个社会偏见类别,包括种族、性别、宗教等。在模型训练方面,论文采用了不同的损失函数和超参数设置,以优化模型的性能。例如,在使用PPO和DPO进行强化学习时,需要仔细设计奖励函数,以引导模型生成无偏见的文本。

🖼️ 关键图片

📊 实验亮点

论文构建的ANUBIS数据集为多类别偏见缓解提供了新的基准。实验结果表明,通过监督微调(SFT)、强化学习(PPO、DPO)和上下文学习(ICL)等方法,可以有效缓解语言模型中的偏见。论文还分析了模型的泛化能力和环境影响,为构建更公平和可持续的AI系统提供了有价值的见解。

🎯 应用场景

该研究成果可应用于各种自然语言处理任务中,例如文本生成、机器翻译、情感分析等,以减少模型输出中的偏见,提高公平性和公正性。此外,该研究还可以帮助开发者构建更负责任和可持续的AI系统,降低AI技术的社会风险。

📄 摘要(原文)

This paper tackles the challenge of building robust and generalizable bias mitigation models for language. Recognizing the limitations of existing datasets, we introduce ANUBIS, a novel dataset with 1507 carefully curated sentence pairs encompassing nine social bias categories. We evaluate state-of-the-art models like T5, utilizing Supervised Fine-Tuning (SFT), Reinforcement Learning (PPO, DPO), and In-Context Learning (ICL) for effective bias mitigation. Our analysis focuses on multi-class social bias reduction, cross-dataset generalizability, and environmental impact of the trained models. ANUBIS and our findings offer valuable resources for building more equitable AI systems and contribute to the development of responsible and unbiased technologies with broad societal impact.