HLB: Benchmarking LLMs' Humanlikeness in Language Use

作者: Xufeng Duan, Bei Xiao, Xuemei Tang, Zhenguang G. Cai

分类: cs.CL

发布日期: 2024-09-24

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

HLB:构建LLM语言使用人性的综合评测基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 人性化评估 心理语言学 基准测试 语言使用 分布相似性 人机交互

📋 核心要点

- 现有语言模型训练依赖大量合成数据,可能导致模型偏离真实人类语言模式,降低交流的丰富性和创造性。

- 论文提出HLB基准,通过心理语言学实验对比LLM与人类在声音、词汇、句法等层面的语言使用差异,评估LLM的人性化程度。

- 实验结果表明,LLM在不同语言层面的人性化程度存在差异,且性能提升不一定带来人性化程度的提高,甚至可能降低。

📝 摘要(中文)

随着合成数据在训练语言模型中日益普及,尤其是在生成对话方面,人们越来越担心这些模型可能会偏离真实的人类语言模式,从而可能失去人类交流中固有的丰富性和创造性。这突显了评估语言模型在实际语言使用中人性化程度的关键需求。本文提出了一个全面的人性化基准(HLB),使用10个心理语言学实验评估了20个大型语言模型(LLM),这些实验旨在探测核心语言方面,包括声音、单词、句法、语义和语篇。为了锚定这些比较,我们收集了2000多名人类参与者的回复,并将它们与LLM在这些实验中的输出进行了比较。为了进行严格的评估,我们开发了一种编码算法,可以准确识别语言使用模式,从而能够提取每个任务的响应分布。通过比较人类参与者和LLM之间的响应分布,我们通过分布相似性来量化人性化程度。我们的结果揭示了LLM在不同语言层面上复制人类响应的精细差异。重要的是,我们发现其他性能指标的改进并不一定导致更高的人性化程度,在某些情况下,甚至导致了下降。通过引入心理语言学方法进行模型评估,该基准提供了第一个系统评估LLM在语言使用中人性化程度的框架。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在语言使用中逐渐偏离人类语言习惯的问题。现有方法主要关注LLM在特定任务上的性能指标,如准确率、流畅度等,而忽略了LLM是否真正模仿了人类的语言模式,缺乏对LLM“人性化”程度的系统评估。这种偏离可能导致LLM在实际应用中显得生硬、不自然,影响用户体验。

核心思路:论文的核心思路是借鉴心理语言学的方法,设计一系列实验来探测LLM在不同语言层面(声音、词汇、句法、语义、语篇)的语言使用模式,并将LLM的输出与人类的输出进行对比。通过量化LLM与人类在语言使用上的分布相似性,来评估LLM的人性化程度。这种方法能够更细粒度地分析LLM在哪些方面更接近人类,哪些方面存在差距。

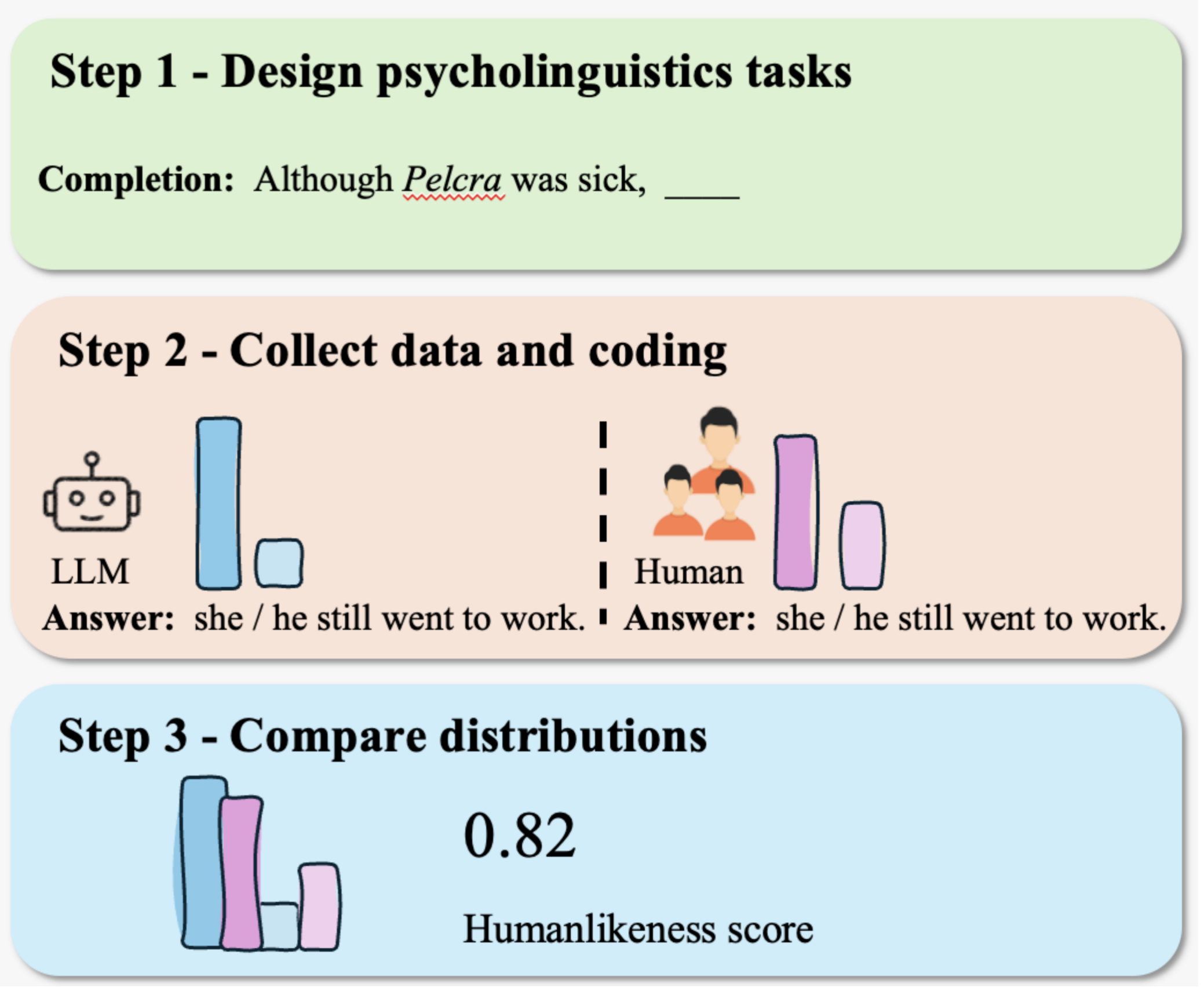

技术框架:HLB基准测试框架主要包含以下几个阶段:1) 设计心理语言学实验,涵盖声音、词汇、句法、语义、语篇等多个语言层面;2) 收集人类参与者在这些实验中的回复数据;3) 使用LLM生成在相同实验中的输出;4) 开发编码算法,准确识别语言使用模式,提取人类和LLM的响应分布;5) 通过比较人类和LLM的响应分布,计算分布相似性,量化LLM的人性化程度。

关键创新:论文最重要的技术创新点在于将心理语言学的方法引入到LLM的评估中,提出了一个系统评估LLM在语言使用中人性化程度的框架。与传统的评估方法相比,HLB基准能够更全面、细致地分析LLM的语言能力,揭示LLM在不同语言层面与人类的差异。此外,论文还开发了一种编码算法,能够准确识别语言使用模式,为量化LLM的人性化程度提供了技术支持。

关键设计:HLB基准的关键设计包括:1) 选择了10个具有代表性的心理语言学实验,涵盖了不同的语言层面;2) 收集了超过2000名人类参与者的回复数据,保证了评估的可靠性;3) 开发了一种基于分布相似性的量化指标,能够有效地衡量LLM与人类在语言使用上的差异;4) 对20个不同的LLM进行了评估,涵盖了不同规模和架构的模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,不同LLM在不同语言层面的人性化程度存在显著差异。例如,某些模型在句法层面表现较好,但在语义层面表现较差。更重要的是,实验发现,在某些情况下,提升LLM在传统性能指标(如困惑度)上的表现,反而会导致其人性化程度下降。这表明,追求更高的性能并不一定能使LLM更像人类。

🎯 应用场景

该研究成果可应用于评估和改进大型语言模型,使其在对话系统、文本生成等应用中更自然、更人性化。通过HLB基准,开发者可以了解模型在哪些语言层面存在不足,从而有针对性地进行优化。此外,该基准还可以用于比较不同模型的语言能力,为用户选择合适的模型提供参考。未来,该研究有望推动人机交互技术的进步,提升用户体验。

📄 摘要(原文)

As synthetic data becomes increasingly prevalent in training language models, particularly through generated dialogue, concerns have emerged that these models may deviate from authentic human language patterns, potentially losing the richness and creativity inherent in human communication. This highlights the critical need to assess the humanlikeness of language models in real-world language use. In this paper, we present a comprehensive humanlikeness benchmark (HLB) evaluating 20 large language models (LLMs) using 10 psycholinguistic experiments designed to probe core linguistic aspects, including sound, word, syntax, semantics, and discourse (see https://huggingface.co/spaces/XufengDuan/HumanLikeness). To anchor these comparisons, we collected responses from over 2,000 human participants and compared them to outputs from the LLMs in these experiments. For rigorous evaluation, we developed a coding algorithm that accurately identified language use patterns, enabling the extraction of response distributions for each task. By comparing the response distributions between human participants and LLMs, we quantified humanlikeness through distributional similarity. Our results reveal fine-grained differences in how well LLMs replicate human responses across various linguistic levels. Importantly, we found that improvements in other performance metrics did not necessarily lead to greater humanlikeness, and in some cases, even resulted in a decline. By introducing psycholinguistic methods to model evaluation, this benchmark offers the first framework for systematically assessing the humanlikeness of LLMs in language use.